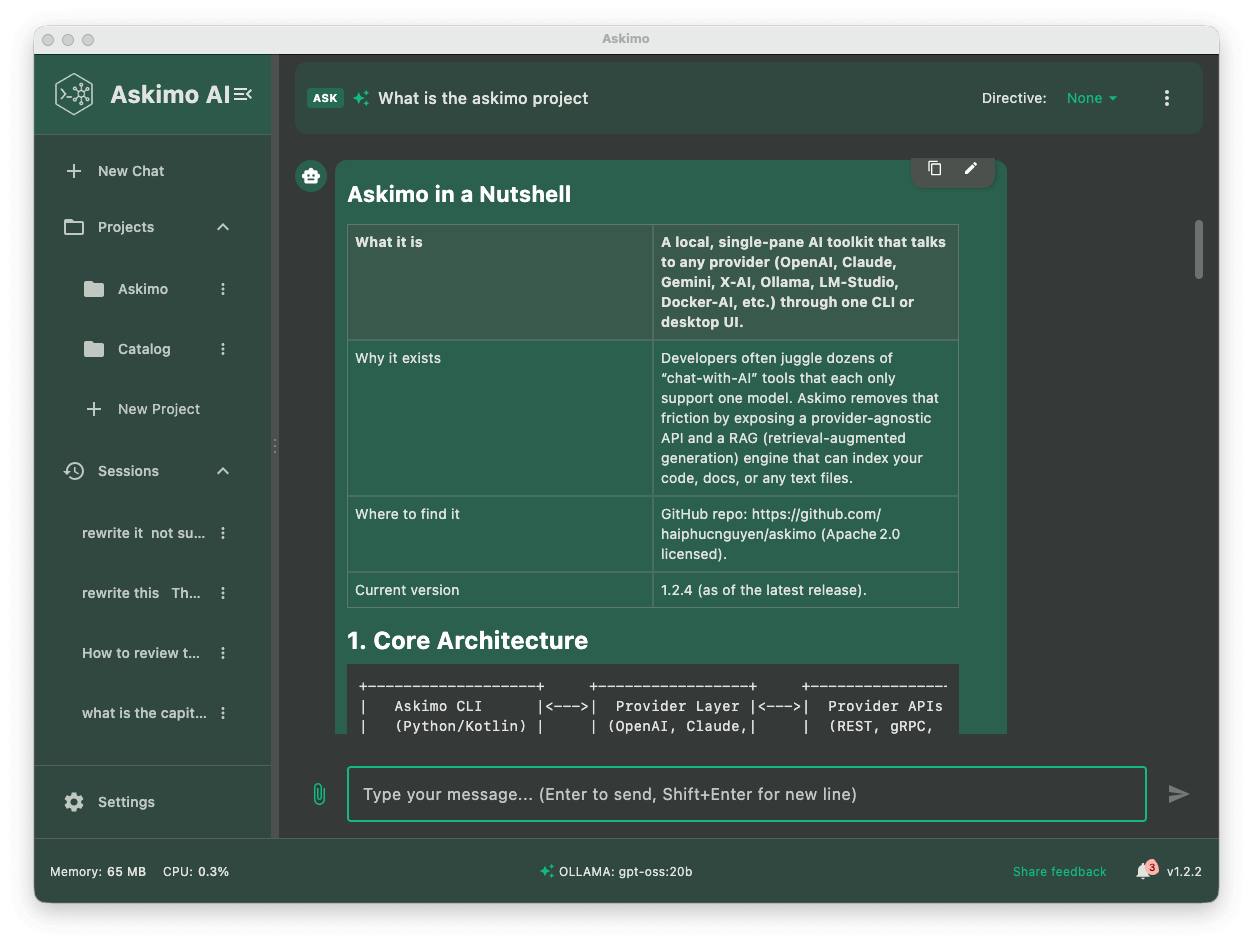

Wenn Sie nach einer Ollama-Desktop-App, einer Ollama-GUI, einem Ollama-Client oder einer schnellen Ollama-Chat-Oberfläche für lokale KI-Modelle auf macOS, Windows oder Linux suchen, stellt dieser Leitfaden Askimo App als eine ernstzunehmende Option vor. Askimo bietet eine native Ollama-Desktop-Erfahrung für lokale Modelle wie Llama 3, Llama 3.1, Llama 3.2, Mistral, Phi 3, Gemma sowie Hunderte weiterer Ollama-Modelle und unterstützt gleichzeitig Cloud-Anbieter wie OpenAI, Claude und Gemini in einer einheitlichen Oberfläche.

TL;DR: Installieren Sie Ollama, laden Sie die Askimo-Desktop-GUI herunter, konfigurieren Sie Askimo für die Verbindung mit

http://localhost:11434, wählen Sie Ihr bevorzugtes Ollama-Modell (llama3,mistral,phi3,gemma) und beginnen Sie mit vollständig durchsuchbaren, organisierbaren und exportierbaren lokalen KI-Unterhaltungen.

Warum eine Ollama-Desktop-GUI statt CLI oder Web-UI verwenden?

Während die Kommandozeilen-Schnittstelle (CLI) von Ollama für schnelle Prompts leistungsfähig ist, bietet eine dedizierte Desktop-App wie Askimo wesentliche Produktivitätsfunktionen für anspruchsvolle KI-Workflows:

- Persistenter Gesprächsverlauf über alle Ollama-Chat-Sitzungen hinweg

- Volltextsuche im Chat, um Nachrichten in Ihren Ollama-Unterhaltungen zu finden

- Markieren und Anheften wichtiger Ollama-Gespräche für den sofortigen Zugriff

- Export von Ollama-Chats in Markdown, JSON oder HTML für Dokumentation, Notizen oder Team-Sharing

- Ein-Klick-Wechsel des Anbieters zwischen lokalen KI-Anbietern und Cloud-KI-Anbietern

- Projektbezogenes RAG für kontextbezogene Unterhaltungen mit Ihren Projekten unter Verwendung lokaler Ollama-Modelle

- Benutzerdefinierte Themes und Tastenkombinationen sowie strukturierte Workflows für Ollama

- Lazy Loading für sehr große Chats (Askimo lädt ältere Ollama-Nachrichten nur beim Scrollen nach oben)

Askimo verwandelt das Experimentieren mit lokalen Ollama-Modellen von verstreuten Terminalbefehlen in einen reproduzierbaren, professionellen Desktop-Workflow.

Warum die Leistung von Askimo Ollama Desktop Web-UIs übertrifft

Die meisten „Ollama-Desktop“-Apps und Ollama-Web-UIs rendern die gesamte Unterhaltung in den DOM. Wenn Ihre Ollama-Chats mit lokalen Modellen wie Llama 3 oder Mistral auf Hunderte oder Tausende von Nachrichten anwachsen, steigt der Speicherverbrauch stark an und die GUI beginnt zu stocken. Das Scrollen ruckelt, die Eingabe verzögert sich und das Rendering wird langsamer.

Der Askimo-Ollama-Desktop-Client verfolgt einen anderen Ansatz. Er ist mit einem nativen, ressourcenschonenden Design aufgebaut, das speziell für Ollama-Workflows optimiert ist: Nachrichten werden während des Chats mit lokalen Modellen gestreamt, während ältere Verläufe virtualisiert bleiben. Ältere Ollama-Nachrichten werden nur geladen, wenn Sie nach oben scrollen. Dadurch bleibt der Speicherverbrauch niedrig und die Performance konstant flüssig – selbst bei langen Recherchesitzungen oder umfangreichen Coding-Unterhaltungen mit Llama 3.2, Mistral oder Phi-3.

Vergleich: Askimo Ollama Desktop vs Terminal-CLI vs Web-UI

| Workflow-Funktion | Ollama-Terminal | Generische Ollama-Web-UI | Askimo Ollama Desktop |

|---|---|---|---|

| Multi-Anbieter-Unterstützung | Manuelle Skripte | Meist nur Ollama | Integrierter Anbieter-Wechsler |

| Chat-Verlauf | Keine automatischen Logs | Einfach / variabel | Organisiert & durchsuchbar |

| Exportoptionen | Manuelles Kopieren | Selten | Markdown-, JSON- & HTML-Export |

| Chats markieren / organisieren | Nicht verfügbar | Begrenzt | Favoriten + strukturierte Sitzungen |

| Lokaler Datenschutz | Vollständig lokal | Abhängig vom Tool | Lokale KI + optionale Cloud |

| Plattformübergreifend | Linux/macOS/Windows | Stark variierend | Linux/macOS/Windows |

Schritt 1: Ollama unter macOS, Windows oder Linux installieren

Ollama läuft lokal unter macOS, Windows und Linux.

-

macOS Laden Sie das Installationsprogramm herunter: https://ollama.com/download/mac

-

Windows Laden Sie das Installationsprogramm herunter: https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | shTesten Sie Ihre Installation:

ollama run llama3Wenn ein Modell noch nicht heruntergeladen wurde, lädt Ollama es automatisch herunter.

Schritt 2: Askimo App installieren (Ollama-GUI)

Askimo-Desktop-Binärdateien:

Öffnen Sie die App (Programme-Ordner / Startmenü) und fahren Sie mit der Anbieter-Einrichtung fort.

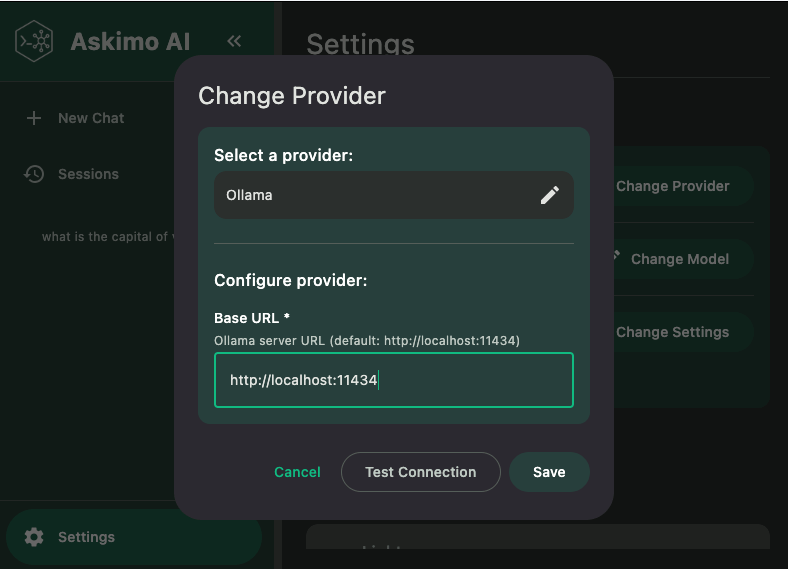

Schritt 3: Askimo App mit Ihrem Ollama-Server verbinden

Askimo erkennt automatisch den standardmäßigen Ollama-Endpunkt:

http://localhost:11434Wenn Sie Ports oder Remote-Zugriff geändert haben, aktualisieren Sie ihn manuell.

- Öffnen Sie Askimo App

- Gehen Sie zu Settings → Providers

- Wählen Sie Ollama

- Stellen Sie sicher, dass der Endpunkt

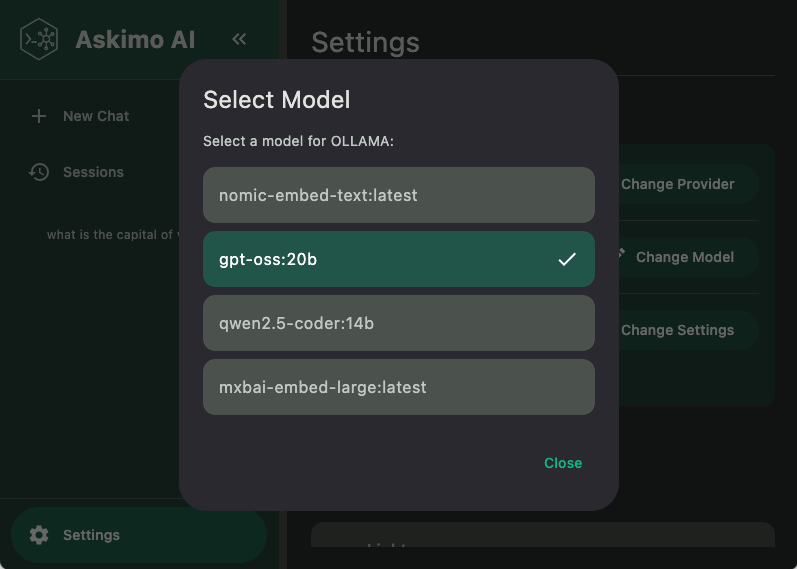

http://localhost:11434ist - Wählen Sie ein Modell (z. B.

llama3,mistral,phi3,gemma,gpt-oss:20b, usw.) - Speichern und chatten starten

Wechseln Sie Ollama-Modelle sofort ohne Terminalbefehle.

Funktions-Deep-Dive der Askimo Ollama Desktop App

1. Performance & Ressourceneffizienz für Ollama-Chats

- Lazy Loading älterer Ollama-Nachrichten (virtualisierter Verlauf für sehr große Chats)

- Streaming von Ollama-Antworten mit flüssigem inkrementellem Rendering

- Minimaler DOM-Footprint im Vergleich zu Ollama-Web-UIs, die komplette Threads neu rendern

- Effiziente Speichernutzung für Ollama-Recherchesitzungen mit Hunderten von Nachrichten

2. Multi-Anbieter- & Ollama-Modellverwaltung

- Sofortiger Wechsel zwischen lokalen KI-Anbietern (Ollama und andere) und Cloud-Anbietern (OpenAI, Claude, Gemini)

- Schneller Modellselektor (z. B. Wechsel von

llama3zumistralfür mehr Geschwindigkeit) - Automatische Endpunkt-Erkennung für lokales Ollama

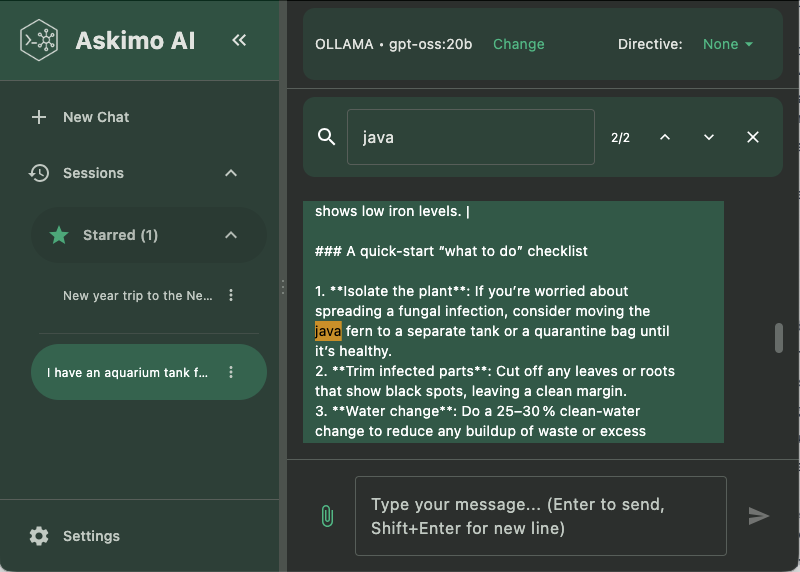

3. Suche & Wissensorganisation für Ollama-Unterhaltungen

- Volltextsuche im Chat zum Finden beliebiger Nachrichten innerhalb Ihrer Ollama-Sitzungen

- Schnelle Schlüsselwortfilterung zur gezielten Suche in langen Chats

- Markieren / Anheften wichtiger Ollama-Threads für schnellen Zugriff

4. Chat-Thread-Utilities für Ollama-Sitzungen

- Ein-Klick-Export nach Markdown, JSON oder HTML (sauberes, entwicklerfreundliches Format)

- Teilbare Ollama-Transkripte für Doku / PRDs / Spezifikationen

- Markieren, Entfernen von Markierungen und Neuordnen wichtiger Ollama-Sitzungen

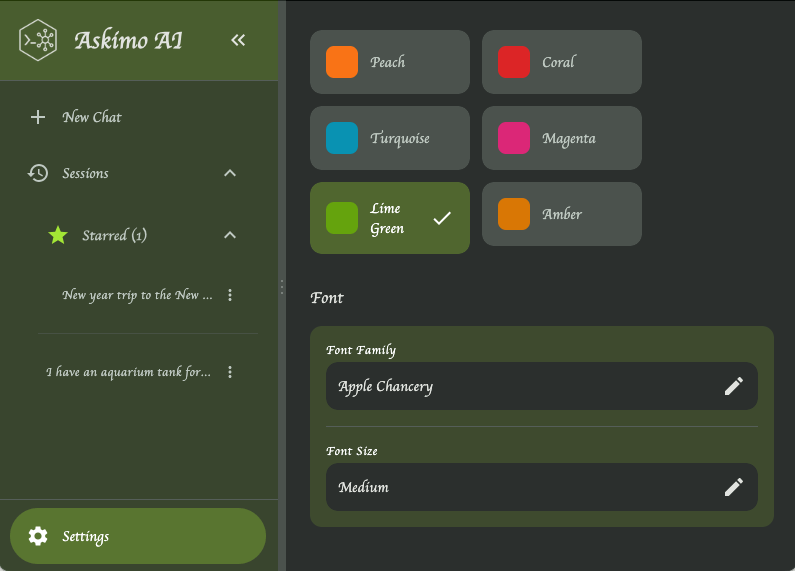

5. UI, Personalisierung & Barrierefreiheit für Ollama Desktop

- Helle & dunkle Themes (Themenwechsel ohne Neuladen)

- Schriftarten-Anpassung (Lesbarkeitsoptimierung für lange Ollama-Sitzungen)

- Tastenkombinationen für: neuen Chat, Anbieterwechsel, Suchfokus, Export

- Sanftes Scrollen und Layout-Stabilität (kein Springen während des Ollama-Streamings)

6. Datenschutz & Local-First-Workflow mit Ollama

- Antworten lokaler Modelle verlassen niemals Ihr Gerät (bei Nutzung lokaler KI-Anbieter wie Ollama)

- Cloud-Anbieter werden nur genutzt, wenn sie explizit ausgewählt werden

- Exporte bleiben lokal, sofern Sie sie nicht extern teilen

- Keine stille Hintergrund-Synchronisation oder Inhalts-Analysen

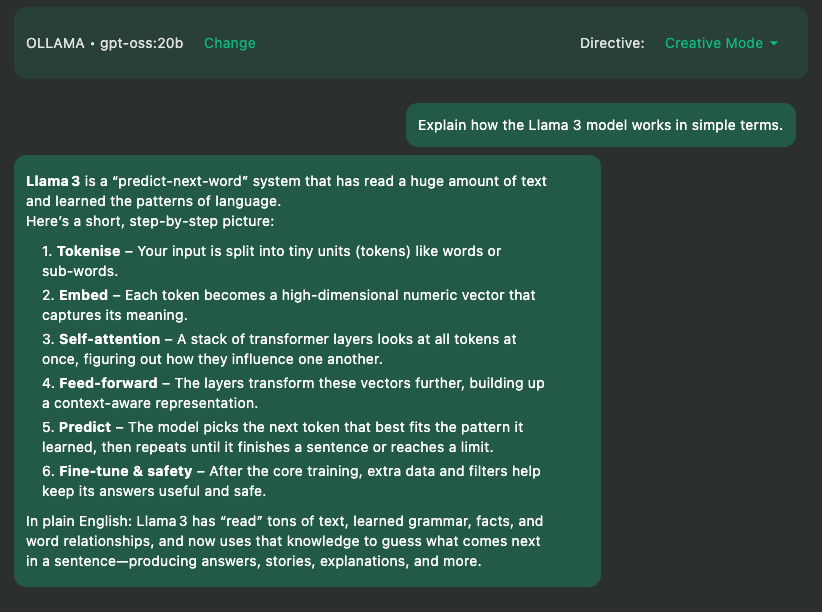

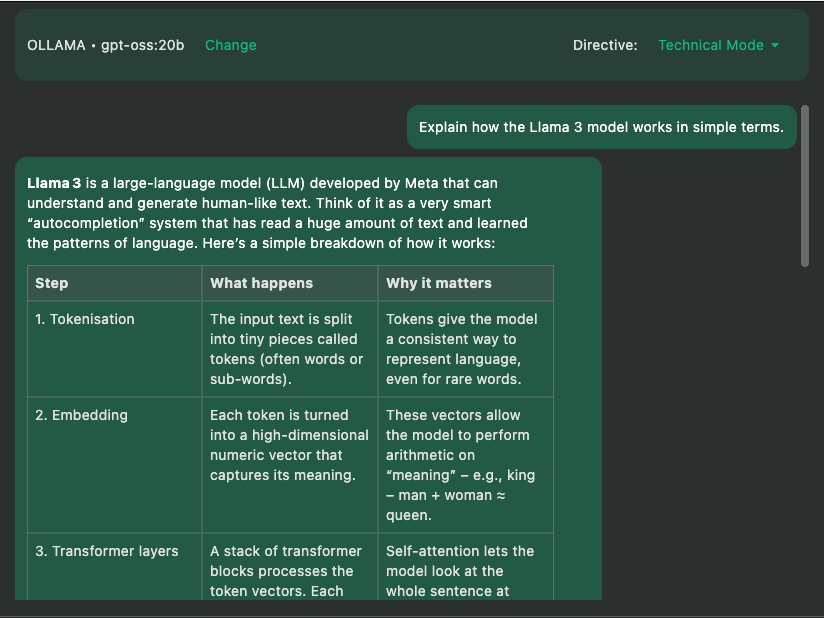

7. Benutzerdefinierte Direktiven in Askimo für Ollama-Modelle

Mit benutzerdefinierten Direktiven können Sie festlegen, wie sich die KI beim Ausführen lokaler KI-Modelle verhält. Anstatt bei jedem neuen Chat lange Anweisungen neu einzugeben, definieren Sie Ihre Präferenzen einmal, und Askimo wendet sie automatisch auf alle Unterhaltungen an.

-

Konsistentes Verhalten für lokale Modelle Halten Sie Ihre Llama-, Mistral-, Gemma- oder Phi-3-Chats im gewünschten Ton, Stil und Detailgrad.

-

Aufgabenbezogene Presets für wiederkehrende Workflows Erstellen Sie Direktiven für Programmierung, Debugging, Zusammenfassungen, Dokumentationserstellung oder andere regelmäßig ausgeführte Aufgaben mit lokalen KI-Modellen.

-

Sofortiger Wechsel ohne Prompt-Überladung Wechseln Sie Direktiven mit einem Klick, statt Anweisungsabsätze in jede Nachricht einzufügen.

-

Optimiert für lange Sitzungen mit lokaler Inferenz Direktiven helfen lokalen Modellen, fokussiert zu bleiben und unnötige Hin-und-her-Kommunikation zu reduzieren, wodurch lange Recherche- oder Coding-Sitzungen effizienter werden.

8. Projektbezogenes RAG mit lokalen Ollama-Modellen

Die RAG-Funktion (Retrieval-Augmented Generation) von Askimo ermöglicht es Ihnen, mit Ihrem gesamten Projekt über lokale Ollama-Modelle zu chatten. Statt Inhalte manuell in Prompts zu kopieren, ruft Askimo automatisch relevanten Kontext aus Ihren Projektdateien ab.

-

Kontextbezogene Unterhaltungen mit Ihren Projekten Stellen Sie Fragen zu Ihrer Arbeit und erhalten Sie Antworten, die auf Ihren tatsächlichen Dateien basieren – mit Llama 3, Mistral oder anderen Ollama-Modellen. Funktioniert mit Code-Projekten, Dokumentation, Forschungsarbeiten, Schreibprojekten und mehr.

-

Automatische Kontextabfrage Askimo indexiert Ihre Projektdateien und fügt relevanten Inhalt automatisch dem Gesprächskontext hinzu.

-

Datenschutzorientiertes lokales RAG Ihre Dateien verlassen niemals Ihr Gerät, wenn Sie lokale Ollama-Modelle mit RAG verwenden – im Gegensatz zu cloudbasierten Assistenten.

-

Multi-Datei-Verständnis Stellen Sie Fragen über mehrere Dateien hinweg, und die Ollama-Modelle erhalten relevanten Kontext aus Ihrem gesamten Projekt.

Beispielanwendungsfälle:

- Softwareprojekte: „Erkläre, wie der Authentifizierungsfluss funktioniert“ oder „Wo werden Benutzerdaten validiert?“

- Dokumentation: „Fasse die wichtigsten Änderungen in der API-Dokumentation zusammen“ oder „Wie läuft der Installationsprozess ab?“

- Forschungsarbeiten: „Welche Methodik habe ich in Kapitel 3 verwendet?“ oder „Finde alle Verweise auf Klimadaten“

- Schreibprojekte: „Welche Themen ziehen sich durch alle Kapitel?“ oder „Liste alle Interaktionen der Charaktere mit John auf“

- Technische Spezifikationen: „Was sind die Systemanforderungen?“ oder „Wie verbindet sich Modul A mit Modul B?“

Einzigartige Funktionen von Askimo (im Vergleich zu anderen Ollama-GUIs)

- Einheitlicher Multi-Anbieter-Chat (lokal + gehostet)

- Strukturierte Organisation mit Suche, Favoriten und Exportoptionen

- Native Desktop-Erfahrung mit macOS- und Windows-Installern

- Mehrere Exportformate (Markdown, JSON, HTML) für Entwickler- und Research-Workflows

- Projektbezogenes RAG für Unterhaltungen mit Ihren Projekten über lokale Ollama-Modelle (Dateien bleiben privat)

- Nahtlose Erweiterbarkeit durch eine gemeinsame CLI- und Desktop-Architektur

Andere Ollama-Oberflächen konzentrieren sich hauptsächlich auf ein Chat-Fenster. Askimo ist für langfristige Produktivität, strukturiertes Wissen und schnelle Workflows mit lokalen und Cloud-Modellen konzipiert.

Häufige Suchfragen (FAQ)

Gibt es eine offizielle Ollama-Desktop-GUI?

Nein. Ollama stellt eine CLI und eine lokale API bereit, aber keine offizielle GUI. Askimo App ist ein vollwertiger Desktop-Client, der lokal mit Ollama verbunden ist.

Welche gute Ollama-Desktop-App gibt es für macOS oder Windows?

Askimo bietet Multi-Anbieter-Wechsel, Suche, Favoriten, Export und eine ausgereifte UX für den täglichen Einsatz unter macOS und Windows.

Kann ich Ollama-Modelle und Cloud-Modelle gemeinsam nutzen?

Ja. Askimo ermöglicht es Ihnen, lokale KI-Modelle (einschließlich Ollama) auszuführen und mit einem Klick zu OpenAI, Claude oder Gemini zu wechseln.

Sind meine Daten privat, wenn ich Askimo mit Ollama nutze?

Ja. Die gesamte lokale Inferenz erfolgt über Ihre Ollama-Installation. Askimo kommuniziert nur mit Ihrem lokalen Endpunkt, wenn Sie Ollama verwenden. Weitere Informationen dazu finden Sie hier: Wie Askimo Ihre Daten schützt und keine sensiblen Informationen sammelt, austauscht oder speichert.

Warum sind Antworten mit Ollama langsam?

Große Modelle (z. B. größere Varianten von Llama 3) erfordern leistungsstarke Hardware. Wählen Sie kleinere Modelle wie mistral oder phi3 für schnellere Antworten oder rüsten Sie CPU/GPU auf.

Wie ändere ich Ollama-Modelle in Askimo?

Öffnen Sie Providers → Ollama und aktualisieren Sie den Modellnamen. Sie können ein Modell vorab herunterladen mit:

ollama pull mistralKann ich Askimo + Ollama offline verwenden?

Ja. Nach dem Herunterladen der Modelle funktionieren Askimo und Ollama vollständig offline.

Kann ich Askimo mit meinen Projekten über Ollama nutzen?

Ja. Mit der RAG-Funktion von Askimo können Sie mit Ihrem gesamten Projekt über lokale Ollama-Modelle chatten. Egal ob Code, Dokumentation, Forschungsarbeiten oder Schreibprojekte – Ihre Dateien werden lokal indexiert und relevanter Kontext automatisch zu den Unterhaltungen hinzugefügt, sodass alles privat auf Ihrem Gerät bleibt.

Fehlerbehebung

Modell reagiert nicht

Überprüfen Sie, ob der Ollama-Dienst läuft:

ollama listWenn leer, starten Sie ein Modell, um den Server zu starten:

ollama run mistralEndpunkt nicht erreichbar

Stellen Sie sicher, dass Port 11434 aktiv ist. Wenn Sie den Port angepasst haben, aktualisieren Sie die Anbieter-Einstellungen in Askimo.

Langsame Antworten

Verwenden Sie ein kleineres Modell oder schließen Sie ressourcenintensive Anwendungen.

Fehlendes Modell

Laden Sie es explizit herunter:

ollama pull phi3Askimo vs. andere Ollama-Desktop-Apps & Ollama-GUIs

Beim Vergleich von Ollama-Desktop-Clients und Ollama-GUI-Optionen für macOS, Windows oder Linux zeigt sich Folgendes:

Askimo Ollama Desktop vs. Open WebUI:

- Askimo: Native Desktop-App mit optimierter Performance für Ollama-Chats

- Open WebUI: Browserbasierte Ollama-Oberfläche mit Docker-Abhängigkeit

- Vorteil Askimo: Multi-Anbieter-Unterstützung (Ollama + ChatGPT + Claude + Gemini) und projektbezogenes RAG

Askimo vs. Ollama Terminal-CLI:

- Askimo: Vollständiger Gesprächsverlauf, Suche, Export, RAG und Organisation für Ollama-Chats

- CLI: Einfache Prompt/Response ohne Persistenz oder Chat-Verwaltung

- Vorteil Askimo: Professioneller Ollama-Workflow mit Tastenkombinationen und Themes

Askimo vs. generische Ollama-Web-UIs:

- Askimo: Lazy-Loaded Ollama-Nachrichten für flüssige Performance auch bei 1000+ Nachrichten

- Web-UIs: Vollständiges DOM-Rendering führt zu Verzögerungen bei langen Unterhaltungen

- Vorteil Askimo: Native Desktop-Geschwindigkeit und Ressourceneffizienz für Ollama-Modelle

Für Nutzer, die Llama 3, Mistral, Phi-3, Gemma oder andere Ollama-Modelle lokal ausführen, bietet Askimo im Jahr 2025 eine umfassende Ollama-Desktop-Erfahrung.

Fazit

Askimo bringt Ollama mit Geschwindigkeit, Struktur und ohne Reibungsverluste auf den Desktop. Lokale Modelle bleiben privat. Ihre Unterhaltungen bleiben organisiert. Und Ihre Prompts werden zu wiederverwendbarem Wissen statt zu Wegwerf-Befehlen.

Testen Sie Askimo noch heute: 👉 https://askimo.chat

Haben Sie Feedback oder Funktionswünsche? Geben Sie dem Repository einen Stern und eröffnen Sie ein Issue.