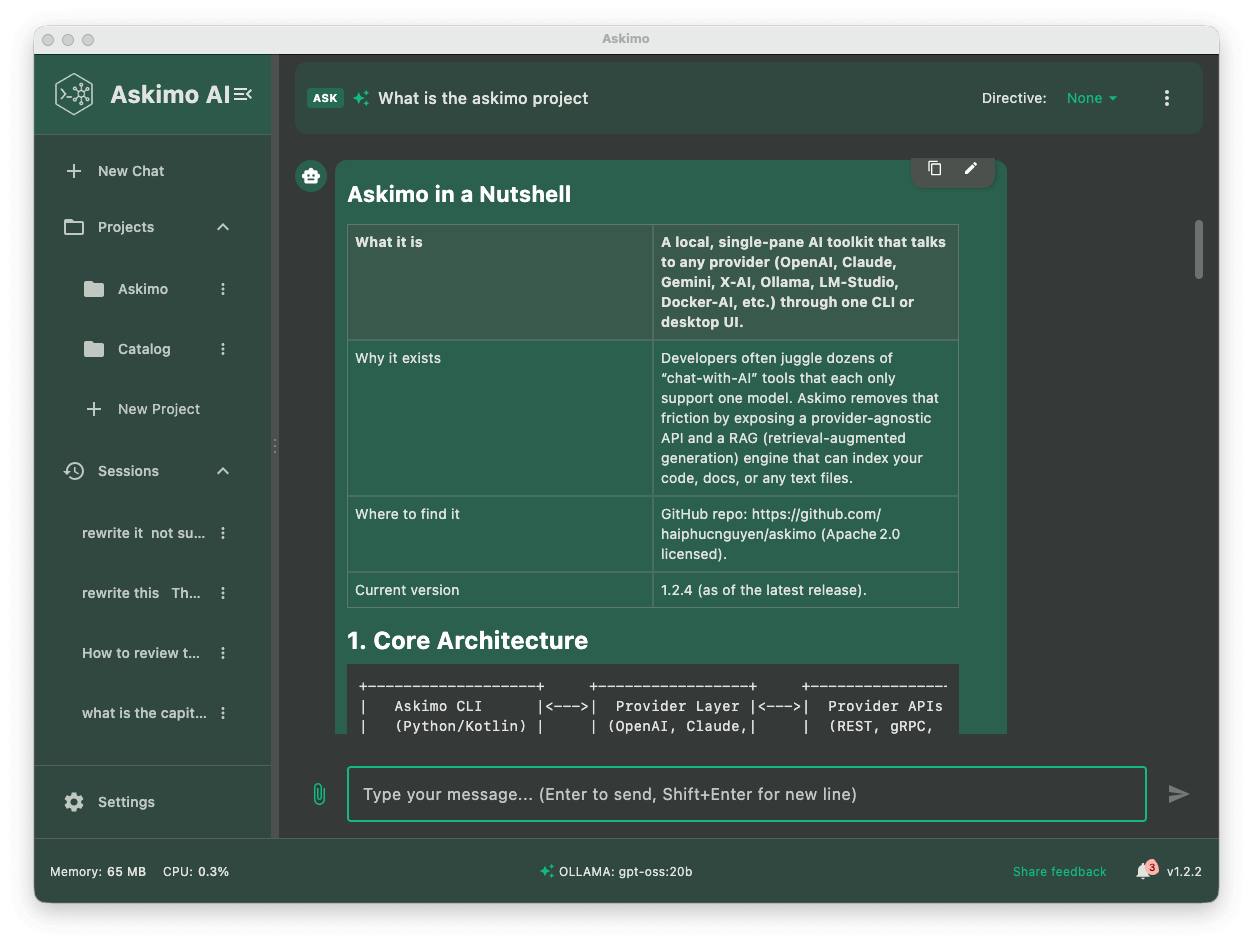

Si estás buscando una aplicación de escritorio de Ollama, una GUI de Ollama, un cliente de Ollama o una interfaz de chat rápida de Ollama para ejecutar modelos de IA locales en macOS, Windows o Linux, esta guía presenta Askimo App como una opción que vale la pena considerar. Askimo ofrece una experiencia de escritorio Ollama nativa para modelos locales como Llama 3, Llama 3.1, Llama 3.2, Mistral, Phi 3, Gemma y cientos de otros modelos de Ollama, además de admitir proveedores en la nube como OpenAI, Claude y Gemini en una interfaz unificada.

TL;DR: Instala Ollama, descarga la GUI de Askimo App, configura Askimo para conectarse a

http://localhost:11434, selecciona tu modelo Ollama preferido (llama3,mistral,phi3,gemma) y comienza a chatear con conversaciones de IA local totalmente buscables, organizables y exportables.

¿Por qué usar una GUI de escritorio de Ollama en lugar del CLI o una interfaz web?

Aunque la interfaz de línea de comandos (CLI) de Ollama es potente para solicitudes rápidas, una aplicación de escritorio dedicada como Askimo añade funciones de productividad esenciales para flujos de trabajo de IA serios:

- Historial de conversaciones persistente en todas tus sesiones de chat de Ollama

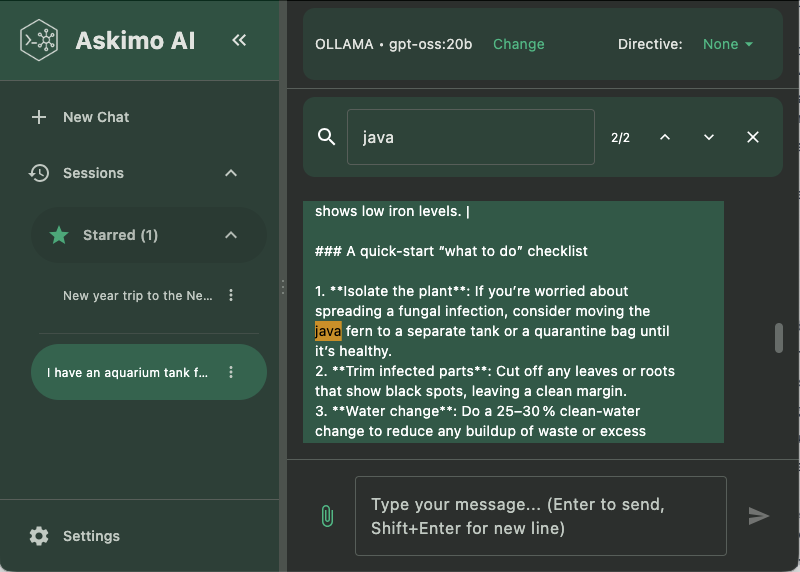

- Búsqueda de texto completo dentro del chat para encontrar mensajes en tus conversaciones de Ollama

- Marcar y fijar conversaciones importantes de Ollama para acceso instantáneo

- Exportar chats de Ollama a Markdown, JSON o HTML para documentación, notas o uso en equipo

- Cambio de proveedor con un solo clic entre proveedores de IA locales y en la nube

- RAG con conocimiento del proyecto para conversaciones con contexto usando modelos locales de Ollama

- Temas personalizados y atajos de teclado, y flujos de trabajo estructurados para Ollama

- Carga diferida para chats muy grandes (Askimo solo carga mensajes antiguos de Ollama al desplazarte hacia arriba)

Askimo transforma la experimentación con modelos Ollama locales de comandos de terminal dispersos en un flujo de trabajo de escritorio profesional y repetible.

Por qué el rendimiento de Askimo Ollama Desktop supera a las interfaces web:

La mayoría de las aplicaciones de escritorio “Ollama” y las interfaces web de Ollama renderizan toda la conversación en el DOM. A medida que tus chats de Ollama crecen hasta cientos o miles de mensajes con modelos locales como Llama 3 o Mistral, el uso de memoria se dispara y la GUI comienza a ralentizarse. El desplazamiento se vuelve irregular, la entrada se retrasa y el renderizado se vuelve lento.

El cliente de escritorio de Askimo adopta un enfoque diferente. Está construido con un diseño nativo y consciente de los recursos, optimizado específicamente para flujos de trabajo de Ollama: los mensajes se transmiten en tiempo real mientras chateas con tus modelos locales, y el historial antiguo permanece virtualizado. Los mensajes antiguos de Ollama solo se cargan cuando te desplazas hacia arriba. Esto mantiene bajo el uso de memoria y el rendimiento del escritorio de Ollama de forma constante y fluida, incluso durante largas sesiones de investigación o grandes conversaciones de programación con Llama 3.2, Mistral o Phi-3.

Comparación: Askimo Ollama Desktop vs CLI de terminal vs interfaz web

| Función de flujo de trabajo | Terminal Ollama | Interfaz web genérica de Ollama | Askimo Ollama Desktop |

|---|---|---|---|

| Soporte multiproveedor | Scripts manuales | Normalmente solo Ollama | Selector de proveedores integrado |

| Historial de chat | Sin registros automáticos | Básico / variable | Organizado y buscable |

| Opciones de exportación | Copia manual | Raro | Exportación Markdown, JSON y HTML |

| Marcar / organizar chats | No disponible | Limitado | Favoritos + sesiones estructuradas |

| Privacidad local | Totalmente local | Depende de la herramienta | IA local + nube opcional |

| Multiplataforma | Linux/macOS/Windows | Varía mucho | Linux/macOS/Windows |

Paso 1: Instalar Ollama en macOS, Windows o Linux

Ollama se ejecuta localmente en macOS, Windows y Linux.

-

macOS Descarga el instalador: https://ollama.com/download/mac

-

Windows Descarga el instalador: https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | shPrueba tu instalación:

ollama run llama3Si un modelo aún no está descargado, Ollama lo obtendrá automáticamente.

Paso 2: Instalar Askimo App (GUI de Ollama)

Binarios de Askimo App:

Abre la aplicación (carpeta Aplicaciones / Menú Inicio) y continúa con la configuración del proveedor.

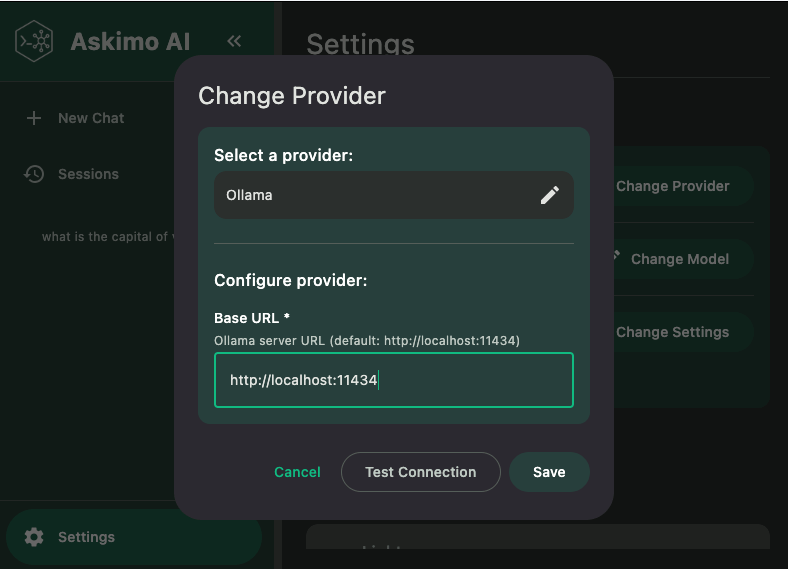

Paso 3: Conectar Askimo App a tu servidor Ollama

Askimo detecta automáticamente el endpoint predeterminado de Ollama:

http://localhost:11434Si cambiaste el puerto o el acceso remoto, actualízalo manualmente.

- Abre Askimo App

- Ve a Settings → Providers

- Selecciona Ollama

- Asegúrate de que el Endpoint sea

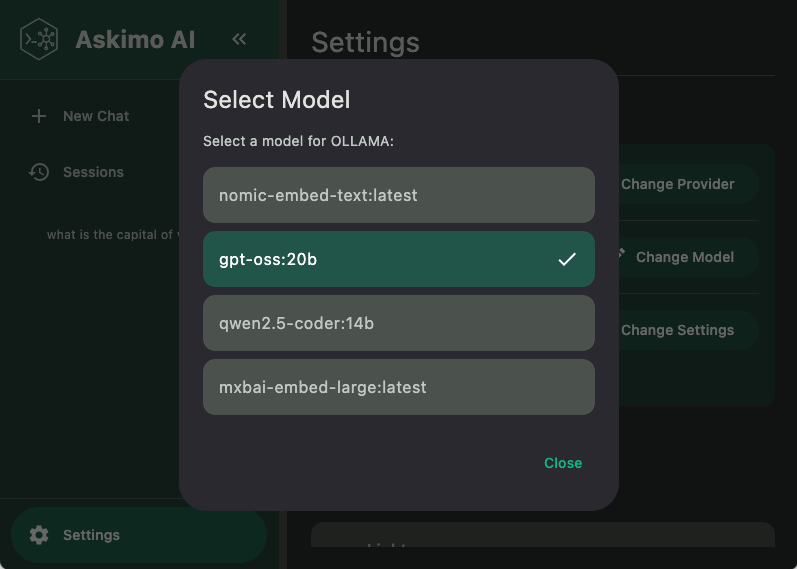

http://localhost:11434 - Elige un modelo (por ejemplo

llama3,mistral,phi3,gemma,gpt-oss:20b, etc.) - Guarda y comienza a chatear

Cambia de modelo Ollama al instante sin necesidad de comandos de terminal.

Análisis profundo de las funciones de Askimo Ollama Desktop

1. Rendimiento y eficiencia de recursos para chat de Ollama

- Carga diferida de mensajes antiguos de Ollama (historial virtualizado para chats masivos)

- Respuestas de Ollama en streaming con renderizado incremental fluido

- Huella mínima del DOM frente a interfaces web de Ollama que re-renderizan hilos completos

- Uso eficiente de memoria para sesiones de investigación de Ollama con cientos de interacciones

2. Gestión de modelos y multiproveedor en Ollama

- Cambio instantáneo entre proveedores de IA locales (Ollama y otros) y proveedores en la nube (OpenAI, Claude, Gemini)

- Selector rápido de modelos (por ejemplo, cambiar de

llama3amistralpara mayor velocidad) - Detección automática de endpoints para Ollama local

3. Búsqueda y organización del conocimiento en conversaciones de Ollama

- Búsqueda de texto completo dentro del chat para encontrar cualquier mensaje en tus sesiones de Ollama

- Filtrado rápido por palabras clave para localizar información específica en conversaciones largas

- Marcar / fijar hilos importantes de Ollama para recuperación rápida y fácil acceso

4. Utilidades de hilos de chat para sesiones de Ollama

- Exportación con un clic a Markdown, JSON o HTML (formato limpio y amigable para desarrolladores)

- Transcripciones de Ollama compartibles para documentos / PRD / especificaciones

- Marcar, desmarcar y reordenar sesiones importantes de Ollama

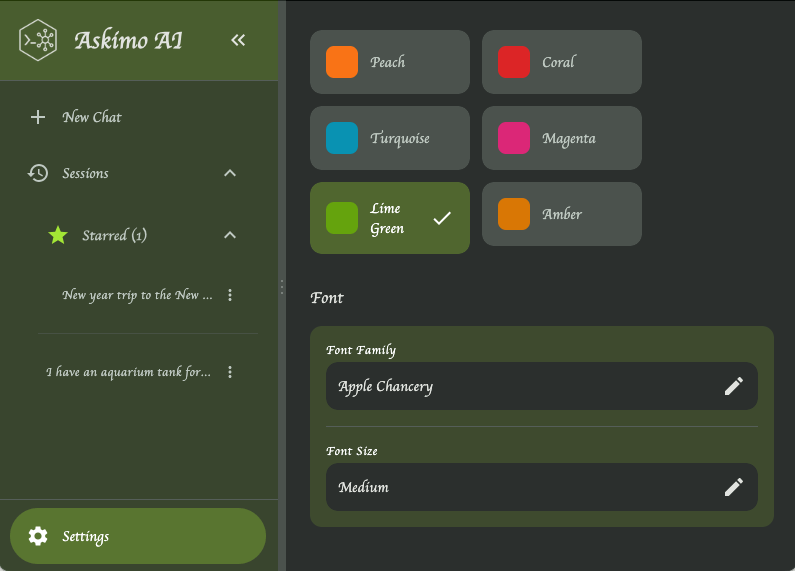

5. UI, personalización y accesibilidad para Ollama Desktop

- Temas claro y oscuro (cambio de tema sin recargar)

- Personalización de fuentes (ajuste de legibilidad para sesiones largas de Ollama)

- Atajos de teclado para: nuevo chat, cambio de proveedor, enfoque de búsqueda, exportación

- Desplazamiento suave y estabilidad del diseño (sin saltos durante el streaming de Ollama)

6. Privacidad y flujo de trabajo local-first con Ollama

- Las respuestas de modelos locales nunca salen de tu máquina (al usar proveedores locales como Ollama)

- Los proveedores en la nube solo se usan cuando los seleccionas explícitamente

- Las exportaciones permanecen locales a menos que decidas compartirlas externamente

- Sin sincronización silenciosa en segundo plano ni analíticas sobre el contenido

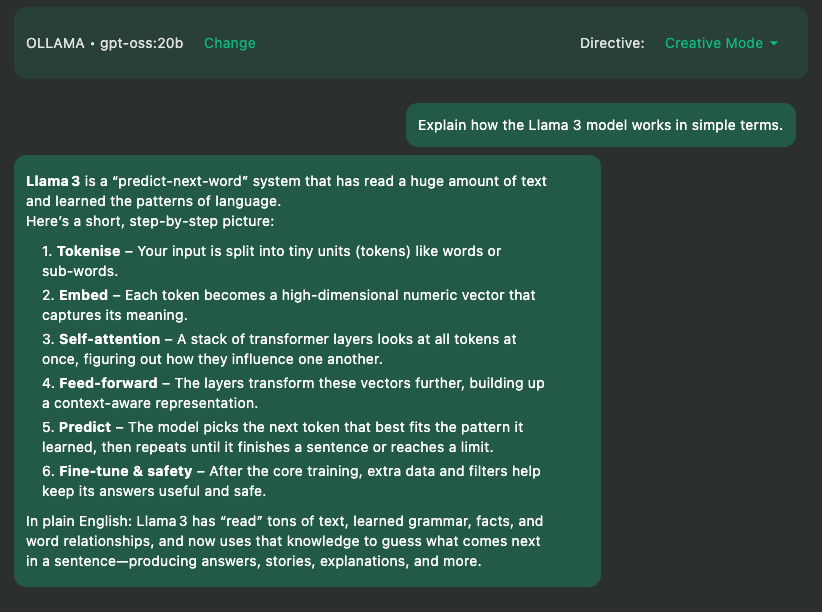

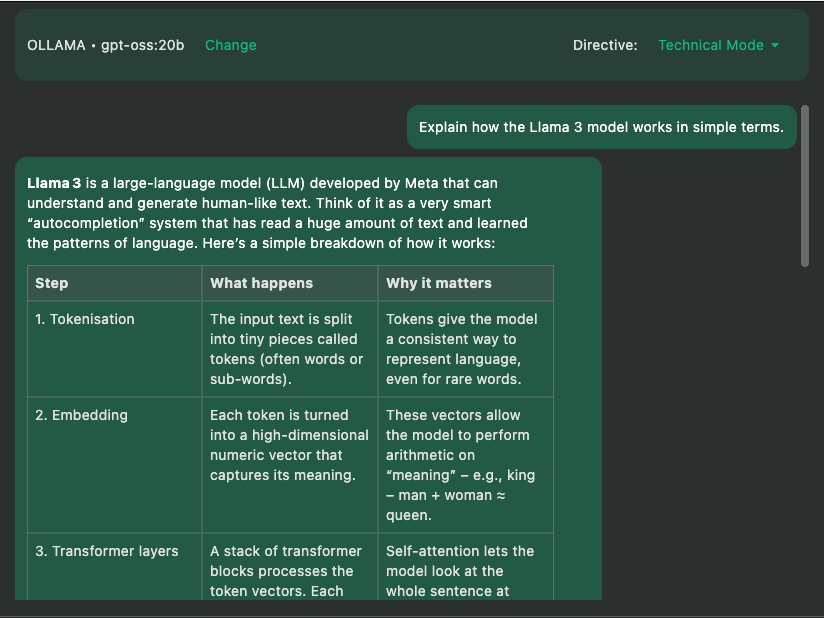

7. Directivas personalizadas en Askimo para modelos de Ollama

Las directivas personalizadas te permiten definir cómo se comporta la IA al ejecutar modelos de IA locales. En lugar de volver a escribir instrucciones largas cada vez que inicias un nuevo chat, configuras tus preferencias una vez y Askimo las aplica automáticamente en todas las conversaciones.

-

Comportamiento consistente para modelos locales Mantén tus chats de Llama, Mistral, Gemma o Phi-3 alineados con el tono, estilo y nivel de detalle que prefieres.

-

Preajustes específicos por tarea para flujos de trabajo repetidos Crea directivas para programación, depuración, resúmenes de artículos, generación de documentación u otras tareas habituales con modelos de IA locales.

-

Cambio instantáneo sin saturar los prompts Cambia directivas con un clic en lugar de pegar párrafos de instrucciones en cada mensaje.

-

Optimizado para sesiones largas con inferencia local Las directivas ayudan a los modelos locales a mantenerse enfocados y reducir ruido innecesario, haciendo más fluidas y eficientes las sesiones largas de investigación o programación.

8. RAG con conocimiento del proyecto usando modelos locales de Ollama

La función RAG (Retrieval-Augmented Generation) de Askimo te permite chatear con todo tu proyecto usando modelos locales de Ollama. En lugar de copiar manualmente contenido en los prompts, Askimo recupera automáticamente el contexto relevante de los archivos de tu proyecto.

-

Conversaciones con contexto de tus proyectos Haz preguntas sobre tu trabajo y obtén respuestas basadas en tus archivos reales usando Llama 3, Mistral u otros modelos de Ollama. Funciona con proyectos de código, documentación, artículos de investigación, proyectos de escritura y más.

-

Recuperación automática de contexto Askimo indexa los archivos de tu proyecto y extrae automáticamente el contenido relevante para el contexto de la conversación.

-

RAG local centrado en la privacidad Tus archivos nunca salen de tu máquina cuando usas modelos locales de Ollama con RAG, a diferencia de los asistentes en la nube.

-

Comprensión multifichero Haz preguntas que abarquen múltiples archivos, y los modelos de Ollama recibirán el contexto relevante de todo tu proyecto.

Ejemplos de uso:

- Proyectos de software: “Explica cómo funciona el flujo de autenticación” o “¿Dónde se validan los datos de usuario?”

- Documentación: “Resume los cambios clave en la documentación de la API” o “¿Cuál es el proceso de instalación?”

- Artículos de investigación: “¿Qué metodología utilicé en el capítulo 3?” o “Encuentra todas las referencias a datos climáticos”

- Proyectos de escritura: “¿Qué temas aparecen en todos los capítulos?” o “Enumera todas las interacciones de los personajes con John”

- Especificaciones técnicas: “¿Cuáles son los requisitos del sistema?” o “¿Cómo se conecta el módulo A con el módulo B?”

Funciones exclusivas de Askimo (en comparación con otras GUIs de Ollama)

- Chat multiproveedor unificado (local + alojado)

- Organización estructurada con búsqueda, favoritos y opciones de exportación

- Experiencia de escritorio nativa con instaladores para macOS y Windows

- Múltiples formatos de exportación (Markdown, JSON, HTML) diseñados para desarrolladores y flujos de trabajo de investigación

- RAG con conocimiento del proyecto para conversaciones con tus proyectos usando modelos locales de Ollama (tus archivos permanecen privados)

- Extensibilidad fluida mediante una arquitectura compartida de CLI y Desktop

Otras interfaces de Ollama se centran principalmente en proporcionar una ventana de chat. Askimo está diseñado para la productividad a largo plazo, el conocimiento estructurado y flujos de trabajo rápidos tanto con modelos locales como en la nube.

Preguntas frecuentes (FAQ)

¿Ollama tiene una GUI oficial de escritorio?

No. Ollama proporciona un CLI y una API local, pero no una GUI oficial. Askimo App es un cliente de escritorio completo que se conecta localmente a Ollama.

¿Cuál es una buena aplicación de escritorio de Ollama para macOS o Windows?

Askimo ofrece cambio multiproveedor, búsqueda, favoritos, exportación y una UX pulida diseñada para el uso diario en macOS y Windows.

¿Puedo usar modelos de Ollama y modelos en la nube juntos?

Sí. Askimo te permite ejecutar modelos de IA locales (incluido Ollama) y luego cambiar a OpenAI, Claude o Gemini con un solo clic.

¿Mis datos son privados al usar Askimo con Ollama?

Sí. Toda la inferencia local se realiza a través de tu instalación de Ollama. Askimo solo se comunica con tu endpoint local cuando usas Ollama. Obtén más información sobre cómo Askimo protege tus datos y no recopila, intercambia ni almacena información sensible.

¿Por qué las respuestas son lentas con Ollama?

Los modelos grandes (como variantes más grandes de Llama 3) requieren hardware potente. Elige modelos más pequeños como mistral o phi3 para respuestas más rápidas, o actualiza CPU/GPU.

¿Cómo cambio modelos de Ollama en Askimo?

Abre Providers → Ollama y actualiza el nombre del modelo. Puedes predescargar un modelo con:

ollama pull mistral¿Puedo ejecutar Askimo + Ollama sin conexión?

Sí. Después de descargar los modelos, tanto Askimo como Ollama funcionan completamente sin conexión.

¿Puedo usar Askimo con mis proyectos usando Ollama?

Sí. La función RAG de Askimo te permite chatear con todo tu proyecto usando modelos locales de Ollama. Ya sea código, documentación, artículos de investigación o proyectos de escritura, tus archivos se indexan localmente y el contexto relevante se añade automáticamente a las conversaciones, manteniendo todo privado en tu máquina.

Solución de problemas

El modelo no responde

Comprueba si el servicio Ollama está en ejecución:

ollama listSi está vacío, ejecuta un modelo para iniciar el servidor:

ollama run mistralEndpoint inaccesible

Confirma que el puerto 11434 esté activo. Si personalizaste el puerto, actualiza la configuración del proveedor en Askimo.

Respuestas lentas

Usa un modelo más pequeño o cierra aplicaciones que consuman muchos recursos.

Error de modelo faltante

Descárgalo explícitamente:

ollama pull phi3Askimo vs otras aplicaciones de escritorio de Ollama y GUIs de Ollama

Al evaluar clientes de escritorio de Ollama y opciones de GUI de Ollama para macOS, Windows o Linux, así es como se compara Askimo:

Askimo Ollama Desktop vs Open WebUI:

- Askimo: aplicación de escritorio nativa con rendimiento optimizado para chat de Ollama

- Open WebUI: interfaz de Ollama basada en navegador que requiere configuración con Docker

- Ventaja de Askimo: soporte multiproveedor (Ollama + ChatGPT + Claude + Gemini) y RAG con conocimiento del proyecto

Askimo vs Ollama Terminal CLI:

- Askimo: historial completo de conversaciones, búsqueda, exportación, RAG y organización para chats de Ollama

- CLI: prompt/respuesta básica sin persistencia ni gestión de chats de Ollama

- Ventaja de Askimo: flujo de trabajo profesional de Ollama con atajos de teclado y temas

Askimo vs GUIs web genéricas de Ollama:

- Askimo: mensajes de Ollama con carga diferida para un rendimiento fluido incluso con chats de más de 1000 mensajes

- GUIs web: renderizado completo del DOM que provoca retrasos en conversaciones largas de Ollama

- Ventaja de Askimo: velocidad nativa de escritorio y eficiencia de recursos para modelos de Ollama

Para usuarios que ejecutan Llama 3, Mistral, Phi-3, Gemma u otros modelos de Ollama de forma local, Askimo ofrece una experiencia de escritorio Ollama completa en 2025.

Reflexiones finales

Askimo lleva Ollama al escritorio con velocidad, estructura y cero fricción. Los modelos locales permanecen privados. Tus conversaciones se mantienen organizadas. Y tus prompts se convierten en conocimiento reutilizable en lugar de comandos desechables.

Prueba Askimo hoy: 👉 https://askimo.chat

¿Tienes comentarios o solicitudes de funciones? Dale una estrella al repositorio y abre un issue.