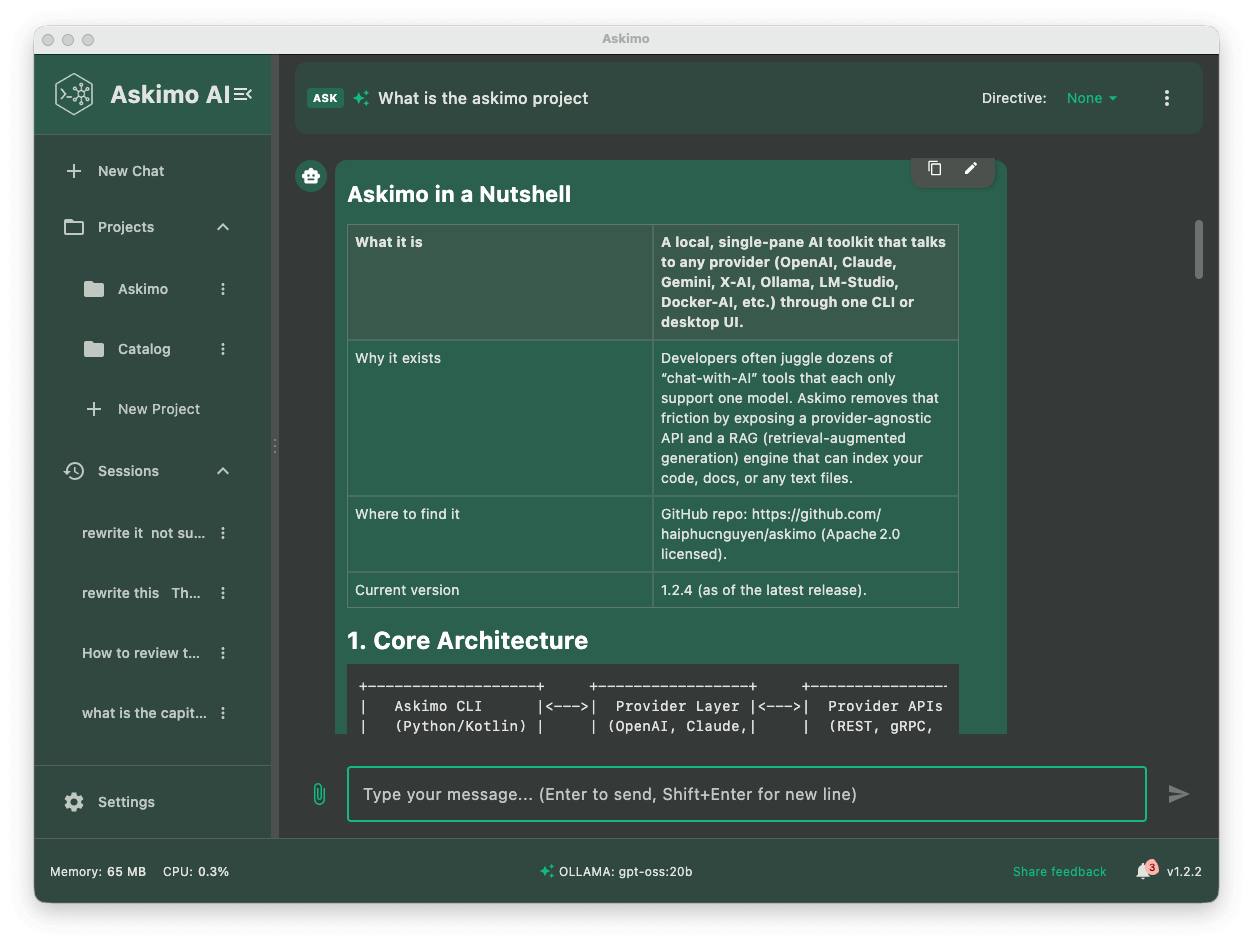

Se você está procurando um aplicativo desktop Ollama, uma GUI Ollama, um cliente Ollama ou uma interface de chat rápida para executar modelos de IA locais no macOS, Windows ou Linux, este guia apresenta o Askimo App como uma opção que vale a pena considerar. O Askimo oferece uma experiência desktop nativa para Ollama com modelos locais como Llama 3, Llama 3.1, Llama 3.2, Mistral, Phi 3, Gemma e centenas de outros modelos Ollama, além de oferecer suporte a provedores de nuvem como OpenAI, Claude e Gemini em uma interface unificada.

TL;DR: Instale o Ollama, baixe a GUI Askimo App, configure o Askimo para se conectar a

http://localhost:11434, selecione seu modelo Ollama preferido (llama3,mistral,phi3,gemma) e comece a conversar com conversas de IA locais totalmente pesquisáveis, organizáveis e exportáveis.

Por que usar uma GUI desktop Ollama em vez de CLI ou Web UI?

Embora a interface de linha de comando (CLI) do Ollama seja poderosa para prompts rápidos, um aplicativo desktop Ollama dedicado como o Askimo adiciona recursos essenciais de produtividade para fluxos de trabalho sérios de IA:

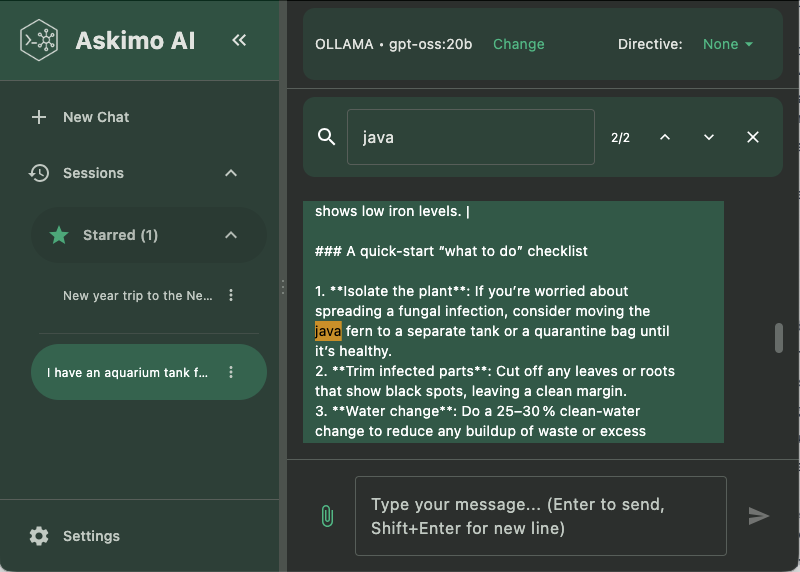

- Histórico de conversas persistente em todas as suas sessões de chat Ollama

- Busca de texto completo dentro do chat para encontrar mensagens nas suas conversas Ollama

- Marcar e fixar conversas Ollama importantes para acesso imediato

- Exportar chats Ollama para Markdown, JSON ou HTML para documentação, notas ou compartilhamento em equipe

- Troca de provedores com um clique entre provedores de IA local e de nuvem

- RAG orientado a projetos para conversas com contexto usando modelos Ollama locais

- Temas personalizados, atalhos de teclado e fluxos de trabalho estruturados

- Lazy loading para chats muito grandes (o Askimo carrega mensagens antigas apenas quando você rola para cima)

O Askimo transforma a experimentação com modelos Ollama locais de comandos dispersos no terminal em um fluxo de trabalho desktop repetível e profissional.

Por que o desempenho do Askimo Ollama Desktop supera as Web UIs

A maioria dos aplicativos de “Ollama desktop” e Web UIs Ollama renderizam toda a conversa no DOM. À medida que seus chats Ollama crescem para centenas ou milhares de mensagens com modelos locais como Llama 3 ou Mistral, o uso de memória aumenta e a GUI começa a ficar lenta. A rolagem engasga, a entrada fica atrasada e a renderização desacelera.

O cliente desktop Ollama do Askimo adota uma abordagem diferente. Ele é construído com um design nativo e consciente de recursos, otimizado especificamente para fluxos de trabalho Ollama: as mensagens são transmitidas à medida que você conversa com seus modelos locais, e o histórico mais antigo permanece virtualizado. As mensagens antigas do Ollama são carregadas apenas quando você rola para cima. Isso mantém o uso de memória baixo e o desempenho do desktop Ollama consistentemente suave, mesmo durante longas sessões de pesquisa ou grandes conversas de código com Llama 3.2, Mistral ou Phi-3.

Comparação: Askimo Ollama Desktop vs Terminal CLI vs Web UI

| Recurso de fluxo de trabalho | Apenas Terminal Ollama | Web UI Ollama genérica | Askimo Ollama Desktop |

|---|---|---|---|

| Suporte a múltiplos provedores | Scripts manuais | Geralmente apenas Ollama | Alternador de provedores integrado |

| Histórico de chat | Sem logs automáticos | Básico / variável | Organizado e pesquisável |

| Opções de exportação | Cópia manual | Raro | Exportação Markdown, JSON e HTML |

| Favoritar / organizar chats | Não disponível | Limitado | Favoritos + sessões estruturadas |

| Privacidade local | Totalmente local | Depende da ferramenta | IA local + nuvem opcional |

| Multiplataforma | Linux/macOS/Windows | Varia muito | Linux/macOS/Windows |

Etapa 1: Instalar o Ollama no macOS, Windows ou Linux

O Ollama é executado localmente no macOS, Windows e Linux.

-

macOS Baixe o instalador: https://ollama.com/download/mac

-

Windows Baixe o instalador: https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | shTeste a instalação:

ollama run llama3Se um modelo ainda não estiver baixado, o Ollama irá buscá-lo automaticamente.

Etapa 2: Instalar o Askimo App (GUI Ollama)

Binários do Askimo App:

Abra o aplicativo (pasta Aplicativos / Menu Iniciar) e prossiga para a configuração de provedores.

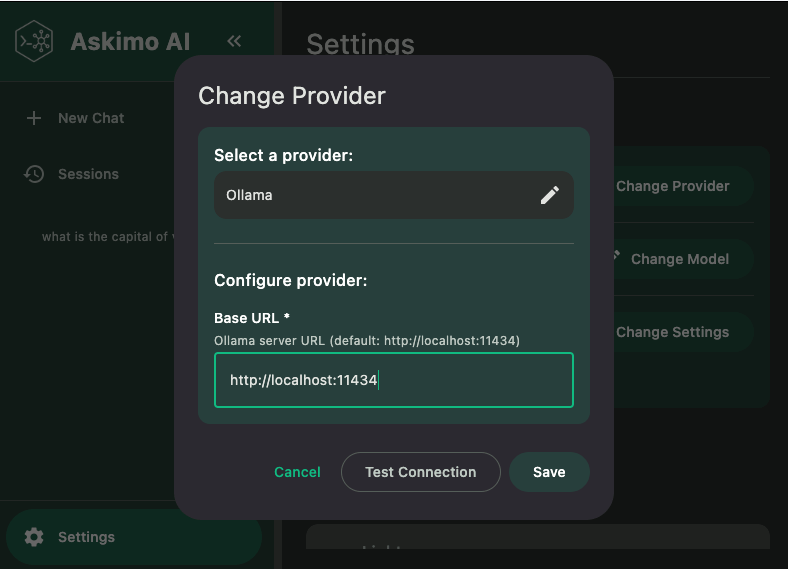

Etapa 3: Conectar o Askimo App ao seu servidor Ollama

O Askimo detecta automaticamente o endpoint padrão do Ollama:

http://localhost:11434

- Abra o Askimo App

- Vá para Settings → Providers

- Selecione Ollama

- Verifique se o endpoint é

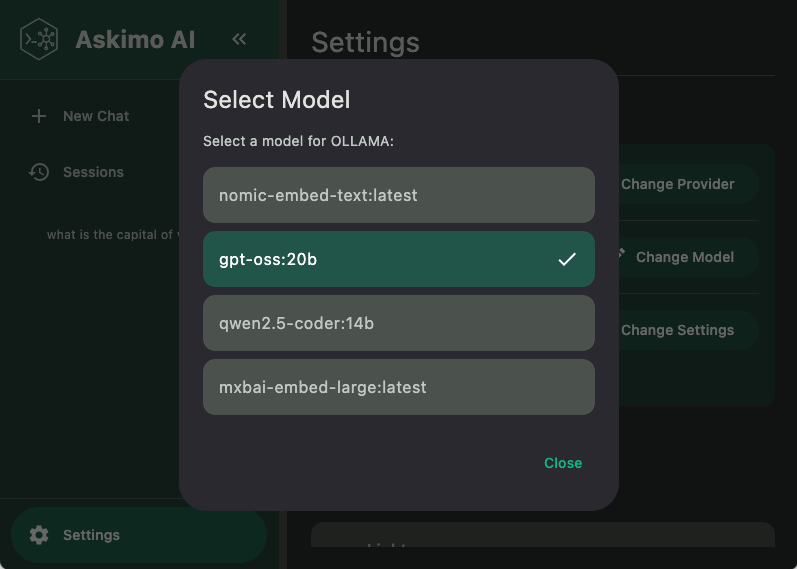

http://localhost:11434 - Escolha um modelo (ex.:

llama3,mistral,phi3,gemma,gpt-oss:20b, etc.) - Salve e comece a conversar

Alterne modelos Ollama instantaneamente sem precisar usar comandos de terminal.

Análise detalhada dos recursos do Askimo Ollama Desktop

A seguir, uma visão mais profunda do que torna o Askimo mais do que “apenas mais um wrapper Ollama”.

1. Desempenho e eficiência de recursos para chat Ollama

- Lazy loading de mensagens Ollama antigas (histórico virtualizado para chats massivos)

- Respostas Ollama em streaming com renderização incremental suave

- Uso mínimo de DOM em comparação com wrappers web que re-renderizam threads inteiros

- Uso eficiente de memória para sessões de pesquisa Ollama que abrangem centenas de interações

2. Gerenciamento de modelos Ollama e múltiplos provedores

- Alternância instantânea entre provedores de IA local (Ollama e outros) e provedores de nuvem (OpenAI, Claude, Gemini)

- Seletor rápido de modelos (ex.: trocar de

llama3paramistralpara maior velocidade) - Detecção automática de endpoint para Ollama local

3. Busca e organização de conhecimento para conversas Ollama

- Busca de texto completo dentro do chat para encontrar qualquer mensagem em suas sessões Ollama

- Filtragem rápida por palavras-chave para localizar informações específicas em chats longos

- Marcar / fixar threads Ollama importantes para recuperação rápida

4. Utilitários de threads de chat para sessões Ollama

- Exportação com um clique para Markdown, JSON ou HTML (formatação limpa e amigável para desenvolvedores)

- Transcrições Ollama compartilháveis para documentos / PRDs / especificações

- Marcar, desmarcar e reorganizar sessões Ollama importantes

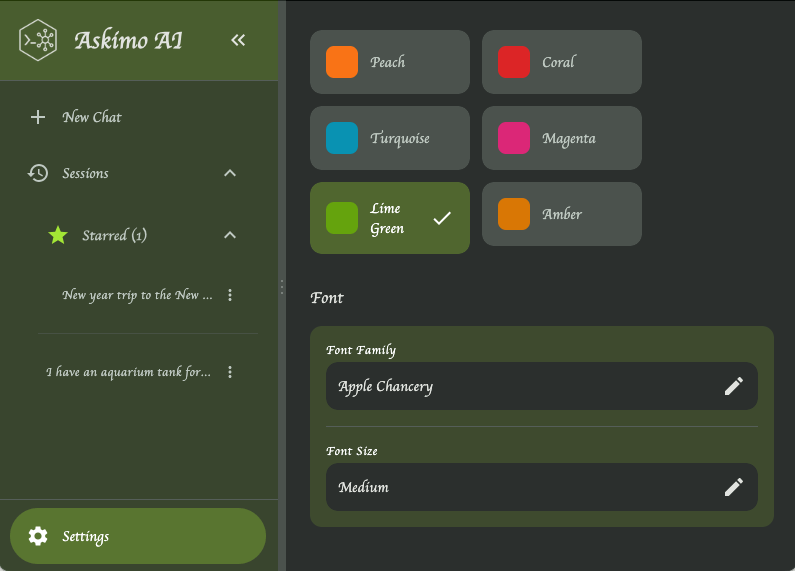

5. UI, personalização e acessibilidade para o Ollama Desktop

- Temas claro e escuro (troca de tema sem recarregar)

- Personalização de fonte (ajuste de legibilidade para longas sessões Ollama)

- Atalhos de teclado para: novo chat, troca de provedor, foco na busca, exportação

- Rolagem suave e estabilidade de layout (sem saltos durante streaming Ollama)

6. Privacidade e fluxo de trabalho local-first com Ollama

- Respostas de modelos locais nunca saem da sua máquina (ao usar provedores locais como Ollama)

- Provedores de nuvem apenas quando explicitamente selecionados

- Exportações permanecem locais, a menos que você opte por compartilhar externamente

- Nenhuma sincronização silenciosa em segundo plano ou coleta de análises de conteúdo

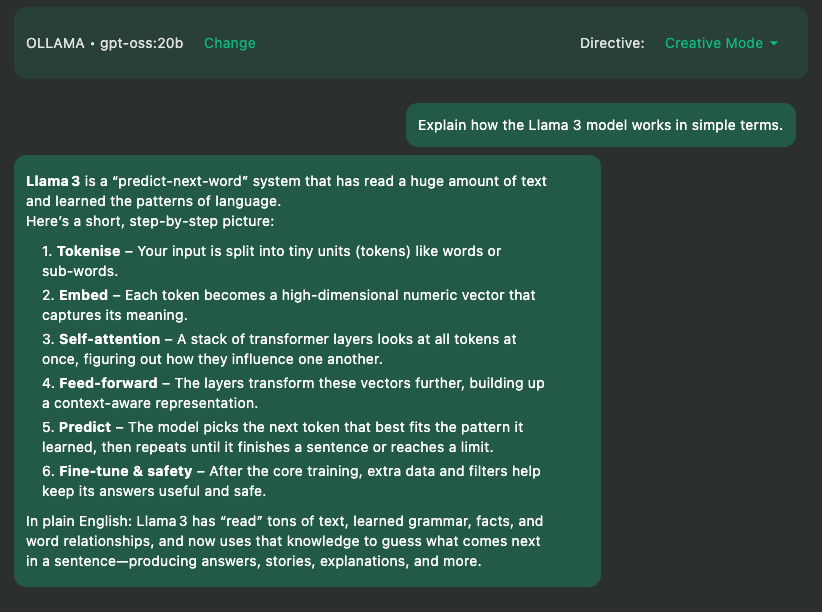

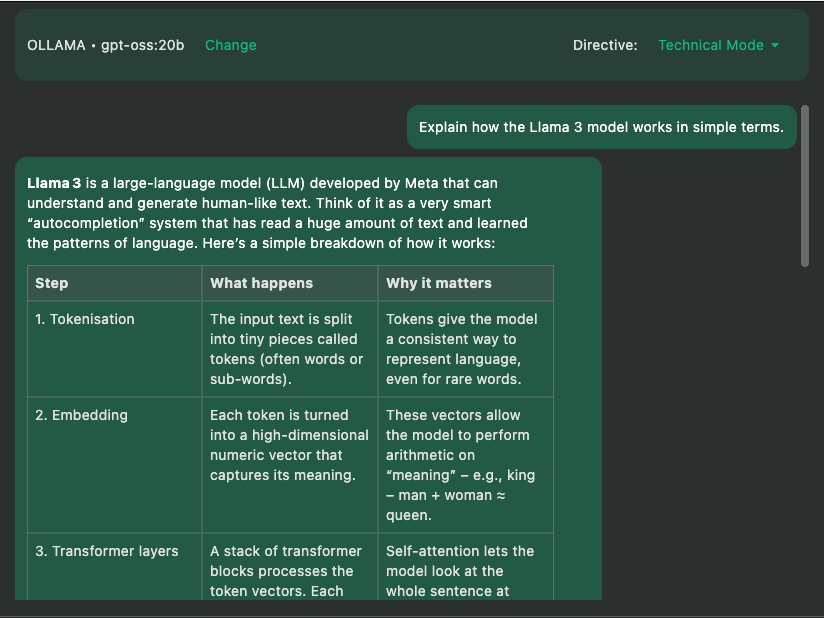

7. Diretivas personalizadas no Askimo para modelos Ollama

As Diretivas Personalizadas permitem definir como a IA se comporta ao executar modelos de IA locais. Em vez de redigitar instruções longas sempre que iniciar um novo chat, você define suas preferências uma vez e o Askimo as aplica automaticamente a todas as conversas.

-

Comportamento consistente para modelos locais Mantenha seus chats Llama, Mistral, Gemma ou Phi-3 alinhados ao tom, estilo e nível de detalhe que você prefere.

-

Predefinições específicas para tarefas recorrentes Crie diretivas para programação, depuração, resumo de artigos, geração de documentação ou qualquer outro fluxo de trabalho frequente com modelos locais.

-

Troca instantânea sem poluição de prompts Altere diretivas com um clique em vez de colar parágrafos de instruções em cada mensagem.

-

Otimizado para sessões longas com inferência local As diretivas ajudam os modelos locais a manter o foco e reduzem o ruído de ida e volta, tornando sessões longas de pesquisa ou codificação mais suaves e eficientes.

8. RAG orientado a projetos com modelos Ollama locais

O recurso de RAG (Geração Aumentada por Recuperação) do Askimo permite conversar com todo o seu projeto usando modelos Ollama locais. Em vez de copiar manualmente conteúdo para prompts, o Askimo recupera automaticamente o contexto relevante dos arquivos do seu projeto.

-

Conversas com contexto do projeto Faça perguntas sobre seu trabalho e obtenha respostas fundamentadas nos seus próprios arquivos usando Llama 3, Mistral ou outros modelos Ollama.

-

Recuperação automática de contexto O Askimo indexa os arquivos do projeto e insere automaticamente o conteúdo relevante no contexto da conversa.

-

RAG local com foco em privacidade Seus arquivos nunca saem da sua máquina ao usar modelos Ollama locais com RAG, ao contrário de assistentes baseados em nuvem.

-

Compreensão de múltiplos arquivos Faça perguntas que abrangem vários arquivos e os modelos Ollama receberão contexto relevante de todo o projeto.

Exemplos de uso:

- Projetos de software: “Explique como funciona o fluxo de autenticação” ou “Onde os dados do usuário são validados?”

- Documentação: “Resuma as principais mudanças na documentação da API” ou “Qual é o processo de instalação?”

- Artigos de pesquisa: “Qual metodologia foi usada no capítulo 3?” ou “Encontre todas as referências a dados climáticos”

- Projetos de escrita: “Quais temas aparecem ao longo de todos os capítulos?” ou “Liste todas as interações do personagem John”

- Especificações técnicas: “Quais são os requisitos do sistema?” ou “Como o módulo A se conecta ao módulo B?”

Recursos exclusivos do Askimo (comparado a outras GUIs Ollama)

- Chat unificado com múltiplos provedores (local + hospedado)

- Organização estruturada com busca, favoritos e opções de exportação

- Experiência desktop nativa com instaladores para macOS e Windows

- Múltiplos formatos de exportação (Markdown, JSON, HTML) projetados para fluxos de trabalho de desenvolvedores e pesquisadores

- RAG orientado a projetos para conversas com seus projetos usando modelos Ollama locais (seus arquivos permanecem privados)

- Extensibilidade contínua por meio de uma arquitetura compartilhada entre CLI e Desktop

Outras interfaces Ollama focam principalmente em fornecer uma janela de chat. O Askimo é projetado para produtividade de longo prazo, conhecimento estruturado e fluxos de trabalho rápidos em modelos locais e de nuvem.

Perguntas frequentes (FAQ)

O Ollama possui uma GUI desktop oficial?

Não. O Ollama fornece uma CLI e uma API local, mas nenhuma GUI oficial. O Askimo App é um cliente desktop completo que se conecta localmente ao Ollama.

Qual é um bom aplicativo desktop Ollama para macOS ou Windows?

O Askimo oferece troca de múltiplos provedores, busca, marcação, exportação e uma UX refinada para uso diário em macOS e Windows.

Posso usar modelos Ollama e modelos de nuvem juntos?

Sim. O Askimo permite executar modelos de IA locais (incluindo Ollama) e alternar para OpenAI, Claude ou Gemini com um único clique.

Meus dados são privados ao usar Askimo com Ollama?

Sim. Toda a inferência local ocorre por meio da sua instalação Ollama. O Askimo se comunica apenas com seu endpoint local ao usar Ollama. Saiba mais sobre como o Askimo protege seus dados e não coleta, troca ou armazena informações sensíveis.

Por que as respostas do Ollama são lentas?

Modelos grandes (como variantes maiores do Llama 3) exigem hardware potente. Escolha modelos menores como mistral ou phi3 para respostas mais rápidas, ou atualize CPU/GPU.

Como altero modelos Ollama no Askimo?

Abra Providers → Ollama e atualize o nome do modelo.

ollama pull mistralPosso executar Askimo + Ollama offline?

Sim. Após o download dos modelos, tanto o Askimo quanto o Ollama funcionam totalmente offline.

Posso usar o Askimo com meus projetos usando Ollama?

Sim. O recurso RAG do Askimo permite conversar com todo o seu projeto usando modelos Ollama locais. Seja código, documentação, artigos de pesquisa ou projetos de escrita, seus arquivos são indexados localmente e o contexto relevante é automaticamente adicionado às conversas, mantendo tudo privado na sua máquina.

Solução de problemas

O modelo não responde

Verifique se o serviço Ollama está em execução:

ollama listSe estiver vazio, execute um modelo para iniciar o servidor:

ollama run mistralEndpoint inacessível

Confirme se a porta 11434 está ativa. Se você personalizou a porta, atualize as configurações de provedor do Askimo.

Respostas lentas

Use um modelo menor ou feche aplicativos que consomem muitos recursos.

Erro de modelo ausente

Baixe explicitamente:

ollama pull phi3Askimo vs outros aplicativos desktop Ollama e GUIs Ollama

Ao avaliar clientes desktop Ollama e opções de GUI Ollama para macOS, Windows ou Linux, veja como o Askimo se compara:

Askimo Ollama Desktop vs Open WebUI:

- Askimo: Aplicativo desktop nativo com desempenho otimizado para chat Ollama

- Open WebUI: Interface Ollama baseada em navegador que requer configuração Docker

- Vantagem do Askimo: Suporte a múltiplos provedores (Ollama + ChatGPT + Claude + Gemini) e RAG orientado a projetos

Askimo vs Ollama Terminal CLI:

- Askimo: Histórico completo de conversas, busca, exportação, RAG e organização para chats Ollama

- CLI: Prompt/resposta básico sem persistência ou gerenciamento de chat

- Vantagem do Askimo: Fluxo de trabalho profissional Ollama com atalhos de teclado e temas

Askimo vs GUIs Ollama genéricas:

- Askimo: Mensagens Ollama com lazy loading para desempenho suave mesmo com chats de 1000+ mensagens

- GUIs Web: Renderização completa do DOM causa lentidão em conversas longas

- Vantagem do Askimo: Velocidade nativa de desktop e eficiência de recursos para modelos Ollama

Para usuários que executam Llama 3, Mistral, Phi-3, Gemma ou outros modelos Ollama localmente, o Askimo oferece uma experiência desktop Ollama abrangente em 2025.

Considerações finais

O Askimo leva o Ollama ao desktop com velocidade, estrutura e zero atrito. Os modelos locais permanecem privados. Suas conversas ficam organizadas. E seus prompts se tornam conhecimento reutilizável, não comandos descartáveis.

Experimente o Askimo hoje: 👉 https://askimo.chat