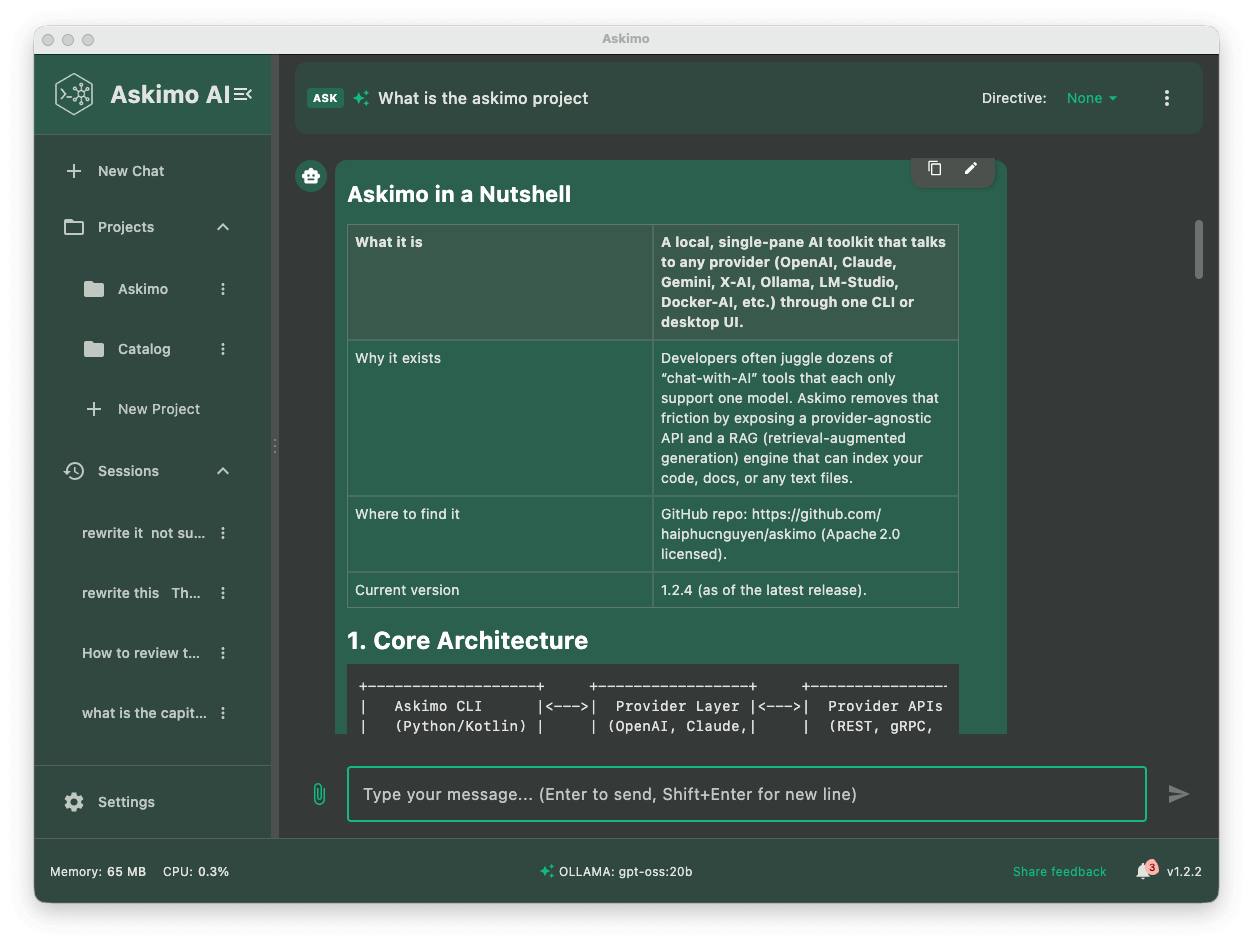

Nếu bạn đang tìm kiếm một ứng dụng desktop Ollama, GUI Ollama, client Ollama hoặc giao diện chat Ollama nhanh để chạy các mô hình AI cục bộ trên macOS, Windows hoặc Linux, hướng dẫn này giới thiệu Askimo App như một lựa chọn đáng cân nhắc. Askimo mang đến trải nghiệm desktop Ollama gốc cho các mô hình cục bộ như Llama 3, Llama 3.1, Llama 3.2, Mistral, Phi 3, Gemma và hàng trăm mô hình Ollama khác, đồng thời hỗ trợ các nhà cung cấp đám mây như OpenAI, Claude và Gemini trong một giao diện thống nhất.

TL;DR: Cài đặt Ollama, tải GUI Askimo App, cấu hình Askimo kết nối tới

http://localhost:11434, chọn mô hình Ollama bạn yêu thích (llama3,mistral,phi3,gemma) và bắt đầu trò chuyện với các cuộc hội thoại AI cục bộ có thể tìm kiếm đầy đủ, tổ chức gọn gàng và xuất dữ liệu.

Vì sao nên dùng GUI desktop Ollama thay vì CLI hoặc Web UI?

Mặc dù giao diện dòng lệnh (CLI) của Ollama rất mạnh cho các prompt nhanh, một ứng dụng desktop Ollama chuyên dụng như Askimo bổ sung những tính năng năng suất thiết yếu cho các workflow AI nghiêm túc:

- Lịch sử hội thoại lâu dài trên tất cả các phiên chat Ollama

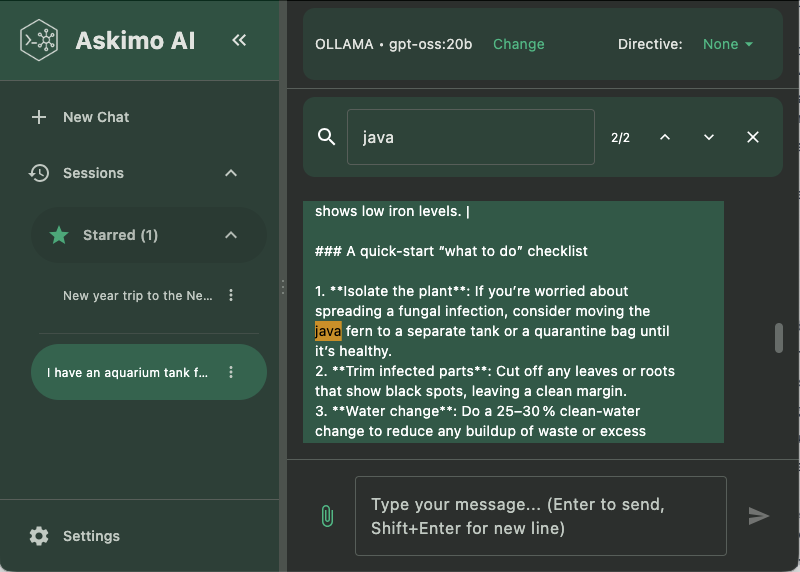

- Tìm kiếm toàn văn trong chat để tìm nhanh thông điệp trong hội thoại Ollama

- Đánh dấu sao và ghim các hội thoại Ollama quan trọng để truy cập tức thì

- Xuất chat Ollama sang Markdown, JSON hoặc HTML cho tài liệu, ghi chú hoặc chia sẻ nhóm

- Chuyển đổi nhà cung cấp chỉ với một cú nhấp giữa AI cục bộ và AI đám mây

- RAG nhận biết dự án cho các cuộc hội thoại có ngữ cảnh với mô hình Ollama cục bộ

- Chủ đề tùy chỉnh, phím tắt bàn phím và workflow có cấu trúc

- Lazy loading cho các chat rất lớn (Askimo chỉ tải các tin nhắn cũ khi bạn cuộn lên)

Askimo biến việc thử nghiệm mô hình Ollama cục bộ từ các lệnh terminal rời rạc thành một workflow desktop chuyên nghiệp, có thể lặp lại.

Vì sao hiệu năng Ollama Desktop của Askimo vượt trội so với Web UI

Hầu hết các ứng dụng “Ollama desktop” và Web UI Ollama đều render toàn bộ cuộc hội thoại vào DOM. Khi các cuộc chat Ollama phát triển lên hàng trăm hoặc hàng nghìn tin nhắn với các mô hình cục bộ như Llama 3 hoặc Mistral, mức sử dụng bộ nhớ tăng cao và GUI bắt đầu chậm lại. Cuộn bị giật, nhập liệu bị trễ và hiệu năng render giảm.

Client desktop Ollama của Askimo áp dụng một cách tiếp cận khác. Nó được xây dựng với thiết kế ưu tiên native và nhận biết tài nguyên, được tối ưu riêng cho workflow Ollama: tin nhắn được stream khi bạn trò chuyện với mô hình cục bộ, còn lịch sử cũ được ảo hóa. Các tin nhắn Ollama cũ chỉ được tải khi bạn cuộn lên, giúp giữ mức sử dụng bộ nhớ thấp và hiệu năng desktop Ollama luôn mượt mà, ngay cả trong các phiên nghiên cứu dài hoặc các cuộc trò chuyện code lớn với Llama 3.2, Mistral hoặc Phi-3.

So sánh Askimo Ollama Desktop với Terminal CLI và Web UI

| Tính năng workflow | Chỉ Ollama Terminal | Web UI Ollama thông thường | Askimo Ollama Desktop |

|---|---|---|---|

| Hỗ trợ đa nhà cung cấp | Script thủ công | Thường chỉ Ollama | Trình chuyển nhà cung cấp tích hợp |

| Lịch sử chat | Không có log tự động | Cơ bản / tùy công cụ | Có tổ chức & tìm kiếm được |

| Tùy chọn xuất dữ liệu | Sao chép thủ công | Hiếm | Xuất Markdown, JSON & HTML |

| Đánh dấu / tổ chức chat | Không hỗ trợ | Hạn chế | Yêu thích + phiên có cấu trúc |

| Quyền riêng tư cục bộ | Hoàn toàn cục bộ | Phụ thuộc công cụ | AI cục bộ + đám mây tùy chọn |

| Đa nền tảng | Linux/macOS/Windows | Rất khác nhau | Linux/macOS/Windows |

Bước 1: Cài đặt Ollama trên macOS, Windows hoặc Linux

Ollama chạy cục bộ trên macOS, Windows và Linux.

-

macOS Tải trình cài đặt: https://ollama.com/download/mac

-

Windows Tải trình cài đặt: https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | shKiểm tra cài đặt:

ollama run llama3Nếu mô hình chưa được tải, Ollama sẽ tự động tải về.

Bước 2: Cài đặt Askimo App (GUI Ollama)

Các bản nhị phân Askimo App:

Mở ứng dụng (thư mục Applications / Start Menu) và tiếp tục cấu hình nhà cung cấp.

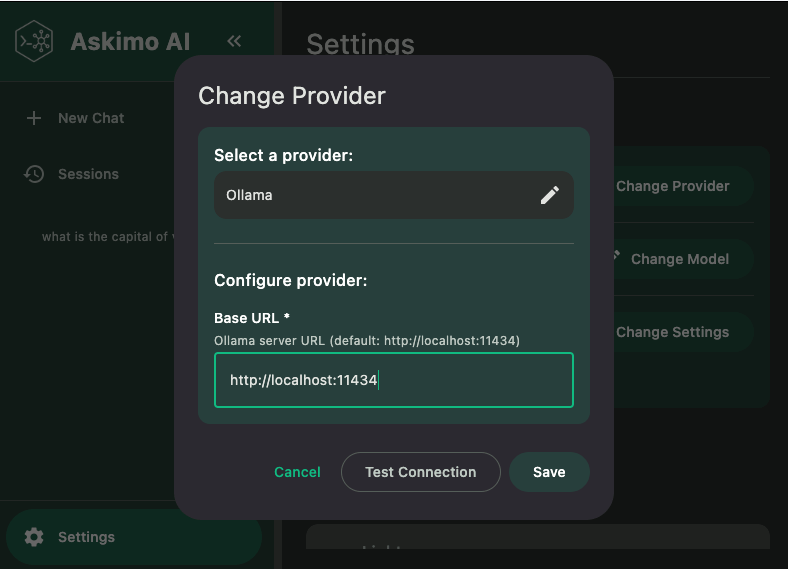

Bước 3: Kết nối Askimo App với máy chủ Ollama của bạn

Askimo tự động phát hiện endpoint Ollama mặc định:

http://localhost:11434

- Mở Askimo App

- Vào Settings → Providers

- Chọn Ollama

- Đảm bảo Endpoint =

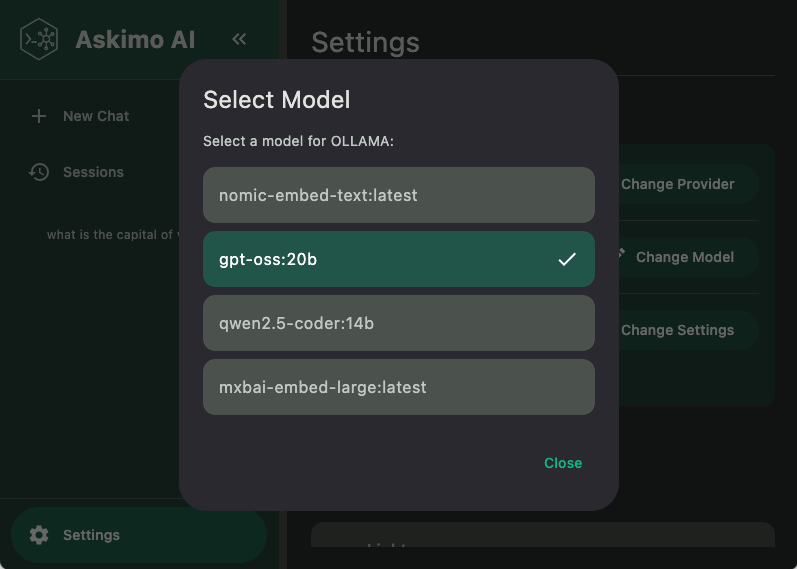

http://localhost:11434 - Chọn mô hình (ví dụ:

llama3,mistral,phi3,gemma,gpt-oss:20b, v.v.) - Lưu và bắt đầu trò chuyện

Chuyển đổi mô hình Ollama ngay lập tức mà không cần dùng lệnh terminal.

Phân tích chi tiết các tính năng của Askimo Ollama Desktop

Dưới đây là cái nhìn sâu hơn về những yếu tố khiến Askimo không chỉ là “một wrapper Ollama khác”.

1. Hiệu năng & hiệu quả tài nguyên cho chat Ollama

- Lazy loading các tin nhắn Ollama cũ (lịch sử ảo hóa cho chat rất lớn)

- Stream phản hồi Ollama với render tăng dần mượt mà

- Dấu chân DOM tối thiểu so với wrapper web render lại toàn bộ luồng

- Sử dụng bộ nhớ hiệu quả cho các phiên nghiên cứu Ollama kéo dài hàng trăm lượt

2. Quản lý đa nhà cung cấp & mô hình Ollama

- Chuyển đổi tức thì giữa AI cục bộ (Ollama và các nhà cung cấp khác) và AI đám mây (OpenAI, Claude, Gemini)

- Trình chọn mô hình nhanh (ví dụ: đổi từ

llama3→mistralđể tăng tốc) - Tự động phát hiện endpoint cho Ollama cục bộ

3. Tìm kiếm & tổ chức tri thức cho hội thoại Ollama

- Tìm kiếm toàn văn trong chat để tìm bất kỳ tin nhắn nào trong các phiên Ollama

- Lọc từ khóa nhanh để xác định thông tin cụ thể trong các chat dài

- Đánh dấu sao / ghim các luồng Ollama quan trọng để truy cập nhanh

4. Tiện ích luồng chat cho các phiên Ollama

- Xuất một cú nhấp sang Markdown, JSON hoặc HTML (định dạng sạch, thân thiện với dev)

- Bản ghi Ollama có thể chia sẻ cho tài liệu / PRD / đặc tả

- Đánh dấu sao, bỏ sao và sắp xếp lại các phiên Ollama quan trọng

5. UI, cá nhân hóa & khả năng truy cập cho Ollama Desktop

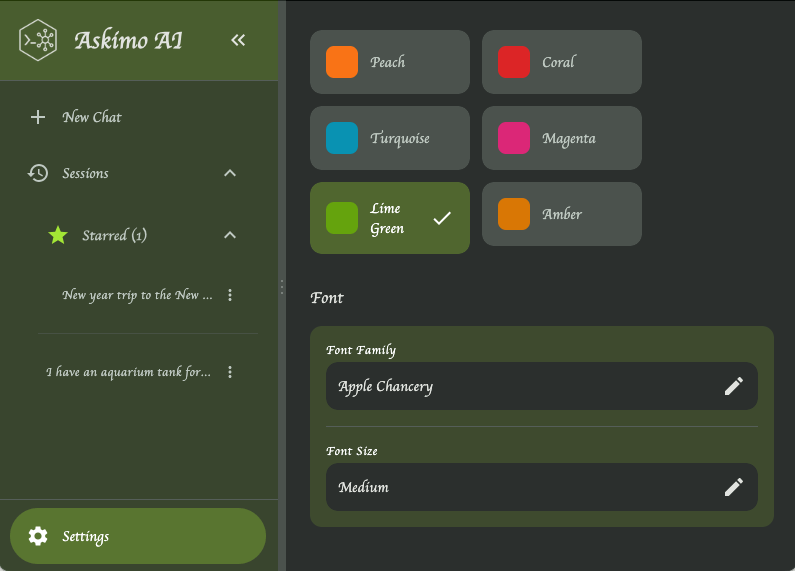

- Chủ đề sáng / tối (chuyển chủ đề không cần reload)

- Tùy chỉnh font (tối ưu khả năng đọc cho các phiên Ollama dài)

- Phím tắt cho: chat mới, chuyển nhà cung cấp, focus tìm kiếm, xuất dữ liệu

- Cuộn mượt và bố cục ổn định (không giật khi streaming Ollama)

6. Quyền riêng tư & workflow local-first với Ollama

- Phản hồi mô hình cục bộ không bao giờ rời khỏi máy của bạn (khi dùng Ollama)

- Nhà cung cấp đám mây chỉ được dùng khi bạn chủ động chọn

- Dữ liệu xuất vẫn ở cục bộ trừ khi bạn chọn chia sẻ ra ngoài

- Không có đồng bộ nền hoặc analytics nội dung âm thầm

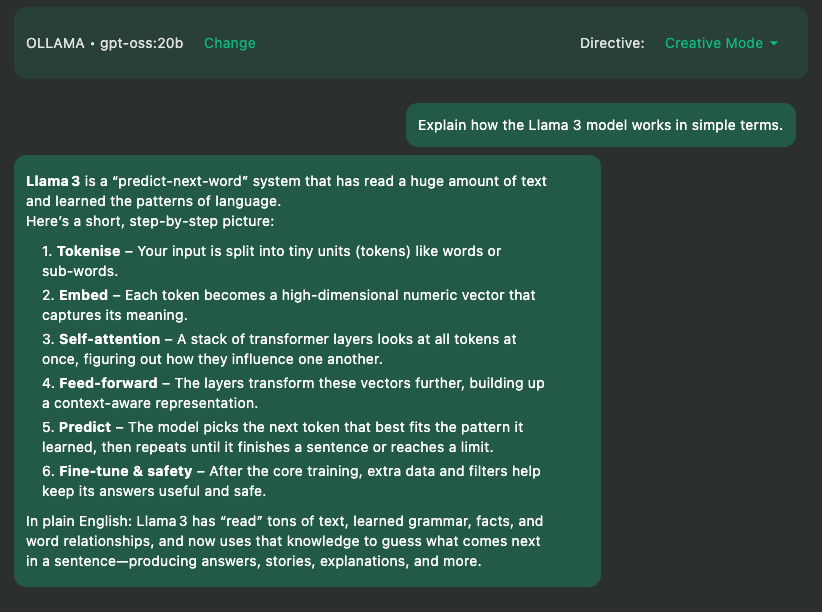

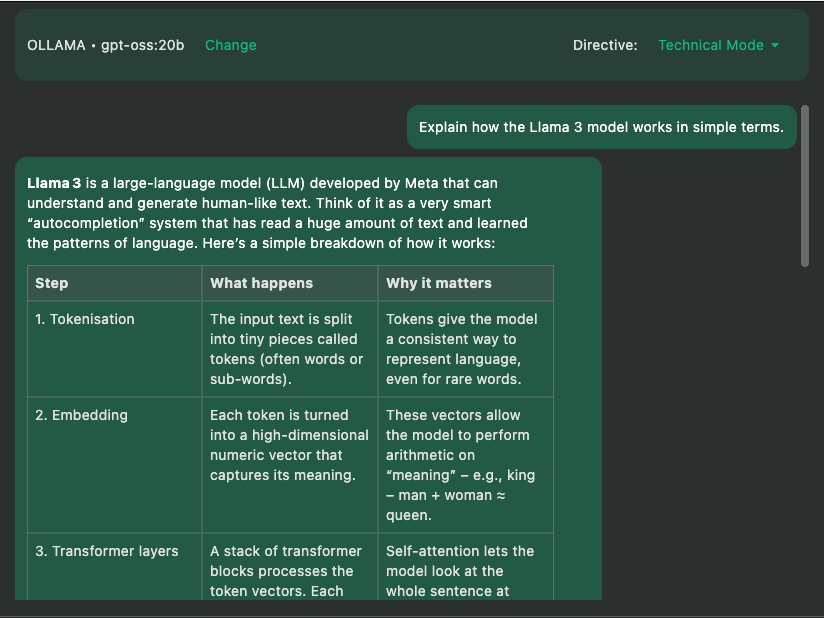

7. Chỉ thị tùy chỉnh trong Askimo cho mô hình Ollama

Chỉ thị tùy chỉnh cho phép bạn xác định cách AI hoạt động khi chạy mô hình AI cục bộ. Thay vì phải nhập lại các hướng dẫn dài mỗi khi bắt đầu chat mới, bạn thiết lập một lần và Askimo sẽ tự động áp dụng cho tất cả các cuộc hội thoại.

-

Hành vi nhất quán cho mô hình cục bộ Giữ cho các chat Llama, Mistral, Gemma hoặc Phi-3 phù hợp với tông, phong cách và mức độ chi tiết bạn mong muốn.

-

Preset theo tác vụ cho workflow lặp lại Tạo chỉ thị cho lập trình, debug, tóm tắt tài liệu, tạo tài liệu hoặc bất kỳ tác vụ nào bạn thường làm với AI cục bộ.

-

Chuyển đổi tức thì không làm rối prompt Thay đổi chỉ thị chỉ với một cú nhấp thay vì dán đoạn hướng dẫn dài vào mỗi tin nhắn.

-

Tối ưu cho các phiên suy luận cục bộ dài Chỉ thị giúp mô hình cục bộ tập trung và giảm nhiễu qua lại, giúp các phiên nghiên cứu hoặc code dài hiệu quả hơn.

8. RAG nhận biết dự án với mô hình Ollama cục bộ

Tính năng RAG (Retrieval-Augmented Generation) của Askimo cho phép bạn trò chuyện với toàn bộ dự án bằng mô hình Ollama cục bộ. Thay vì sao chép nội dung thủ công vào prompt, Askimo tự động truy xuất ngữ cảnh liên quan từ các tệp dự án.

-

Hội thoại có ngữ cảnh dự án Đặt câu hỏi về công việc của bạn và nhận câu trả lời dựa trên chính các tệp bằng Llama 3, Mistral hoặc mô hình Ollama khác.

-

Tự động truy xuất ngữ cảnh Askimo index các tệp dự án và tự động đưa nội dung liên quan vào ngữ cảnh hội thoại.

-

RAG cục bộ ưu tiên quyền riêng tư Các tệp của bạn không bao giờ rời khỏi máy khi dùng RAG với mô hình Ollama cục bộ, khác với trợ lý đám mây.

-

Hiểu nhiều tệp Đặt câu hỏi trải rộng nhiều tệp và mô hình Ollama sẽ nhận ngữ cảnh liên quan từ toàn bộ dự án.

Ví dụ sử dụng:

- Dự án phần mềm: “Giải thích cách hoạt động của luồng xác thực” hoặc “Dữ liệu người dùng được kiểm tra ở đâu?”

- Tài liệu: “Tóm tắt các thay đổi chính trong tài liệu API” hoặc “Quy trình cài đặt là gì?”

- Bài nghiên cứu: “Phương pháp nào được dùng trong chương 3?” hoặc “Tìm tất cả các tham chiếu đến dữ liệu khí hậu”

- Dự án viết: “Những chủ đề nào xuất hiện xuyên suốt các chương?” hoặc “Liệt kê tất cả các tương tác của nhân vật John”

- Đặc tả kỹ thuật: “Yêu cầu hệ thống là gì?” hoặc “Module A kết nối với module B như thế nào?”

Các tính năng độc đáo của Askimo (so với các GUI Ollama khác)

- Chat đa nhà cung cấp thống nhất (cục bộ + host)

- Tổ chức có cấu trúc với tìm kiếm, yêu thích và tùy chọn xuất

- Trải nghiệm desktop native với trình cài đặt cho macOS và Windows

- Nhiều định dạng xuất (Markdown, JSON, HTML) được thiết kế cho workflow dev và nghiên cứu

- RAG nhận biết dự án cho hội thoại với dự án bằng mô hình Ollama cục bộ (tệp của bạn luôn riêng tư)

- Khả năng mở rộng liền mạch thông qua kiến trúc CLI + Desktop dùng chung

Các giao diện Ollama khác chủ yếu chỉ cung cấp cửa sổ chat. Askimo được thiết kế cho năng suất dài hạn, tri thức có cấu trúc và workflow nhanh trên cả mô hình cục bộ lẫn đám mây.

Câu hỏi thường gặp (FAQ)

Ollama có GUI desktop chính thức không?

Không. Ollama chỉ cung cấp CLI và API cục bộ, không có GUI chính thức. Askimo App là client desktop đầy đủ tính năng kết nối với Ollama cục bộ.

Ứng dụng desktop Ollama nào tốt cho macOS hoặc Windows?

Askimo cung cấp chuyển đổi đa nhà cung cấp, tìm kiếm, đánh dấu sao, xuất dữ liệu và UX hoàn thiện cho sử dụng hàng ngày trên macOS và Windows.

Tôi có thể dùng chung mô hình Ollama và mô hình đám mây không?

Có. Askimo cho phép chạy mô hình AI cục bộ (bao gồm Ollama), sau đó chuyển sang OpenAI, Claude hoặc Gemini chỉ với một cú nhấp.

Dữ liệu của tôi có riêng tư khi dùng Askimo với Ollama không?

Có. Mọi suy luận cục bộ đều diễn ra thông qua cài đặt Ollama của bạn. Askimo chỉ giao tiếp với endpoint cục bộ khi dùng Ollama. Tìm hiểu thêm tại Askimo bảo vệ dữ liệu của bạn như thế nào.

Vì sao phản hồi của Ollama chậm?

Các mô hình lớn (như biến thể Llama 3 lớn) yêu cầu phần cứng mạnh. Hãy chọn mô hình nhỏ hơn như mistral hoặc phi3 để phản hồi nhanh hơn, hoặc nâng cấp CPU/GPU.

Làm thế nào để thay đổi mô hình Ollama trong Askimo?

Mở Providers → Ollama, sau đó cập nhật tên mô hình.

ollama pull mistralTôi có thể chạy Askimo + Ollama offline không?

Có. Sau khi mô hình được tải, cả Askimo và Ollama đều hoạt động hoàn toàn offline.

Tôi có thể dùng Askimo với dự án của mình thông qua Ollama không?

Có. Tính năng RAG của Askimo cho phép bạn trò chuyện với toàn bộ dự án bằng mô hình Ollama cục bộ. Dù là code, tài liệu, bài nghiên cứu hay dự án viết, các tệp đều được index cục bộ và ngữ cảnh liên quan được tự động thêm vào hội thoại, giữ mọi thứ riêng tư trên máy của bạn.

Khắc phục sự cố

Mô hình không phản hồi

Kiểm tra dịch vụ Ollama có đang chạy không:

ollama listNếu trống, chạy một mô hình để khởi động server:

ollama run mistralKhông thể truy cập endpoint

Xác nhận cổng 11434 đang hoạt động. Nếu bạn đã tùy chỉnh cổng, hãy cập nhật cài đặt nhà cung cấp trong Askimo.

Phản hồi chậm

Sử dụng mô hình nhỏ hơn hoặc đóng các ứng dụng tiêu tốn nhiều tài nguyên.

Lỗi thiếu mô hình

Tải trực tiếp:

ollama pull phi3Askimo so với các ứng dụng desktop Ollama và GUI Ollama khác

Khi đánh giá các client desktop Ollama và tùy chọn GUI Ollama cho macOS, Windows hoặc Linux, đây là cách Askimo so sánh:

Askimo Ollama Desktop vs Open WebUI:

- Askimo: Ứng dụng desktop native với hiệu năng tối ưu cho chat Ollama

- Open WebUI: Giao diện Ollama dựa trên trình duyệt, yêu cầu thiết lập Docker

- Lợi thế Askimo: Hỗ trợ đa nhà cung cấp (Ollama + ChatGPT + Claude + Gemini) và RAG nhận biết dự án

Askimo vs Ollama Terminal CLI:

- Askimo: Lịch sử hội thoại đầy đủ, tìm kiếm, xuất dữ liệu, RAG và tổ chức cho chat Ollama

- CLI: Prompt/response cơ bản, không có tính bền vững hay quản lý chat

- Lợi thế Askimo: Workflow Ollama chuyên nghiệp với phím tắt và chủ đề

Askimo vs GUI Ollama thông thường:

- Askimo: Tin nhắn Ollama được lazy load cho hiệu năng mượt ngay cả với chat 1000+ tin nhắn

- Web UI: Render DOM toàn phần gây lag trong hội thoại dài

- Lợi thế Askimo: Tốc độ desktop native và hiệu quả tài nguyên cho mô hình Ollama

Với người dùng chạy Llama 3, Mistral, Phi-3, Gemma hoặc các mô hình Ollama khác cục bộ, Askimo mang lại trải nghiệm desktop Ollama toàn diện trong năm 2025.

Kết luận

Askimo mang Ollama lên desktop với tốc độ, cấu trúc và không ma sát. Mô hình cục bộ luôn riêng tư. Hội thoại được tổ chức gọn gàng. Và prompt của bạn trở thành tri thức có thể tái sử dụng, thay vì các lệnh dùng một lần.

Dùng thử Askimo ngay hôm nay: 👉 https://askimo.chat