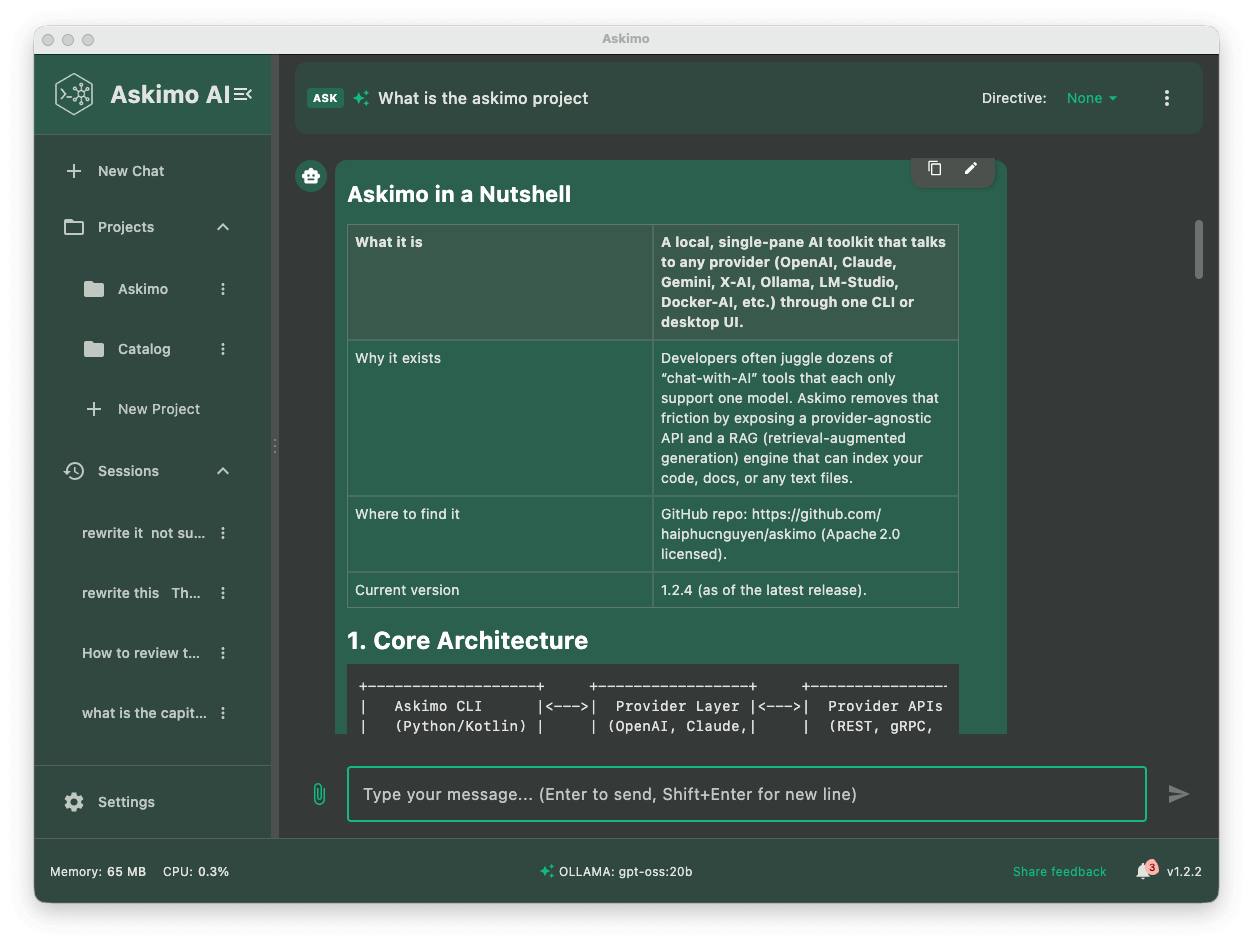

Si vous recherchez une application de bureau Ollama, une interface graphique Ollama, un client Ollama ou une interface de chat Ollama rapide pour exécuter des modèles d’IA locaux sur macOS, Windows ou Linux, ce guide présente Askimo App comme une option à considérer sérieusement. Askimo offre une expérience Ollama native sur ordinateur pour les modèles locaux, notamment Llama 3, Llama 3.1, Llama 3.2, Mistral, Phi 3, Gemma et des centaines d’autres modèles Ollama, tout en prenant également en charge des fournisseurs cloud comme OpenAI, Claude et Gemini dans une interface unifiée.

TL;DR : Installez Ollama, téléchargez l’interface graphique Askimo App, configurez Askimo pour se connecter à

http://localhost:11434, sélectionnez votre modèle Ollama préféré (llama3,mistral,phi3,gemma) et commencez à discuter avec des conversations IA locales entièrement consultables, organisables et exportables.

Pourquoi utiliser une interface graphique Ollama plutôt qu’un CLI ou une interface Web ?

Bien que l’interface en ligne de commande (CLI) d’Ollama soit puissante pour des invites rapides, une application de bureau dédiée comme Askimo ajoute des fonctionnalités de productivité essentielles pour des flux de travail IA sérieux :

- Historique de conversation persistant sur toutes vos sessions de chat Ollama

- Recherche plein texte intégrée au chat pour retrouver des messages dans vos conversations Ollama

- Favoriser et épingler les conversations Ollama importantes pour un accès instantané

- Exporter les conversations Ollama en Markdown, JSON ou HTML pour la documentation, les notes ou le partage en équipe

- Changement de fournisseur en un clic entre fournisseurs IA locaux et fournisseurs IA cloud

- RAG orienté projet pour des conversations contextualisées avec vos projets à l’aide de modèles Ollama locaux

- Thèmes personnalisés, raccourcis clavier, et flux de travail structurés pour Ollama

- Chargement paresseux pour les conversations volumineuses (Askimo ne charge les anciens messages Ollama que lorsque vous faites défiler vers le haut)

Askimo transforme l’expérimentation avec des modèles Ollama locaux, auparavant dispersée dans des commandes de terminal, en un flux de travail de bureau reproductible et professionnel.

Pourquoi les performances d’Askimo Ollama Desktop surpassent les interfaces Web :

La plupart des applications de bureau « Ollama » et des interfaces Web Ollama rendent l’intégralité de la conversation dans le DOM. À mesure que vos discussions Ollama atteignent des centaines ou des milliers de messages avec des modèles locaux comme Llama 3 ou Mistral, l’utilisation mémoire augmente fortement et l’interface commence à ralentir. Le défilement devient saccadé, la saisie prend du retard, et le rendu ralentit.

Le client de bureau Askimo adopte une approche différente. Il est conçu avec une architecture native, consciente des ressources, optimisée spécifiquement pour les flux de travail Ollama : les messages arrivent en streaming pendant que vous discutez avec vos modèles locaux, et l’historique plus ancien reste virtualisé. Les anciens messages Ollama ne sont chargés que lorsque vous faites défiler vers le haut. Cela maintient l’utilisation mémoire faible et les performances d’Askimo constamment fluides, même pendant de longues sessions de recherche ou de grandes conversations de code avec Llama 3.2, Mistral ou Phi-3.

Comparaison : Askimo Ollama Desktop vs CLI terminal vs interface Web

| Fonctionnalité de workflow | Terminal Ollama uniquement | Interface Web Ollama générique | Askimo Ollama Desktop |

|---|---|---|---|

| Support multi-fournisseurs | Scripts manuels | Généralement uniquement Ollama | Sélecteur de fournisseurs intégré |

| Historique de chat | Aucun journal automatique | Basique / variable | Organisé et consultable |

| Options d’export | Copie manuelle | Rare | Export Markdown, JSON et HTML |

| Favoriser / organiser | Non disponible | Limité | Favoris + sessions structurées |

| Confidentialité locale | Entièrement local | Dépend de l’outil | IA locale + cloud optionnel |

| Multiplateforme | Linux/macOS/Windows | Variable | Linux/macOS/Windows |

Étape 1 : Installer Ollama sur macOS, Windows ou Linux

Ollama s’exécute localement sur macOS, Windows et Linux.

- macOS

Téléchargez l’installateur : https://ollama.com/download/mac

- Windows

Téléchargez l’installateur : https://ollama.com/download/windows

- Linux

curl -fsSL https://ollama.com/install.sh | shTestez votre installation :

ollama run llama3Si un modèle n’est pas encore téléchargé, Ollama le récupérera automatiquement.

Étape 2 : Installer Askimo App (interface graphique Ollama)

Binaires Askimo App :

Ouvrez l’application (dossier Applications / menu Démarrer) et passez à la configuration du fournisseur.

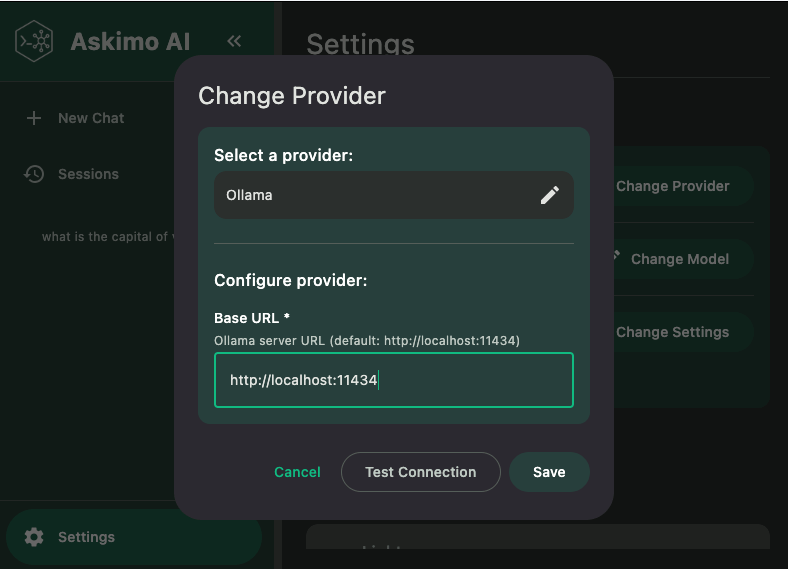

Étape 3 : Connecter Askimo App à votre serveur Ollama

Askimo détecte automatiquement l’endpoint Ollama par défaut :

http://localhost:11434Si vous avez modifié le port ou l’accès distant, mettez-le à jour manuellement.

- Ouvrez Askimo App

- Allez dans Settings → Providers

- Sélectionnez Ollama

- Vérifiez que Endpoint =

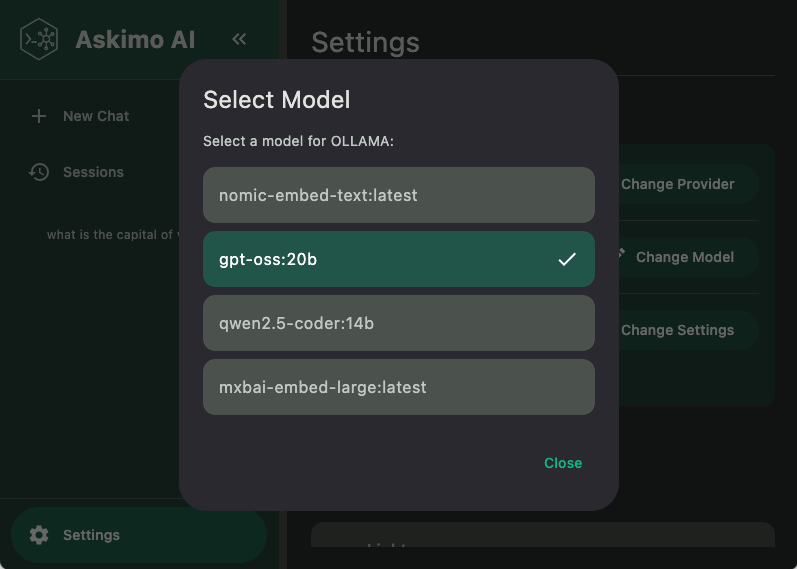

http://localhost:11434 - Choisissez un modèle (par ex.

llama3,mistral,phi3,gemma,gpt-oss:20b, etc.) - Enregistrez et commencez à discuter

Changez instantanément de modèle Ollama sans aucune commande terminal.

Analyse approfondie des fonctionnalités d’Askimo Ollama Desktop

Voici un aperçu plus détaillé de ce qui fait d’Askimo plus qu’« un simple wrapper Ollama ». N’hésitez pas à insérer des captures d’écran là où c’est indiqué.

1. Performances et efficacité des ressources pour le chat Ollama

- Chargement paresseux des anciens messages Ollama (historique virtualisé pour les conversations volumineuses)

- Streaming des réponses Ollama avec un rendu progressif fluide

- Empreinte DOM minimale par rapport aux wrappers Web Ollama qui re-rendent les fils entiers

- Utilisation mémoire efficace pour les sessions de recherche Ollama pouvant atteindre des centaines d’échanges

2. Gestion multi-fournisseurs et modèles Ollama

- Bascule instantanée entre fournisseurs IA locaux (Ollama et autres) et fournisseurs cloud (OpenAI, Claude, Gemini)

- Sélecteur de modèles rapide (par ex. passer de

llama3→mistralpour plus de rapidité) - Détection automatique des endpoints pour Ollama local

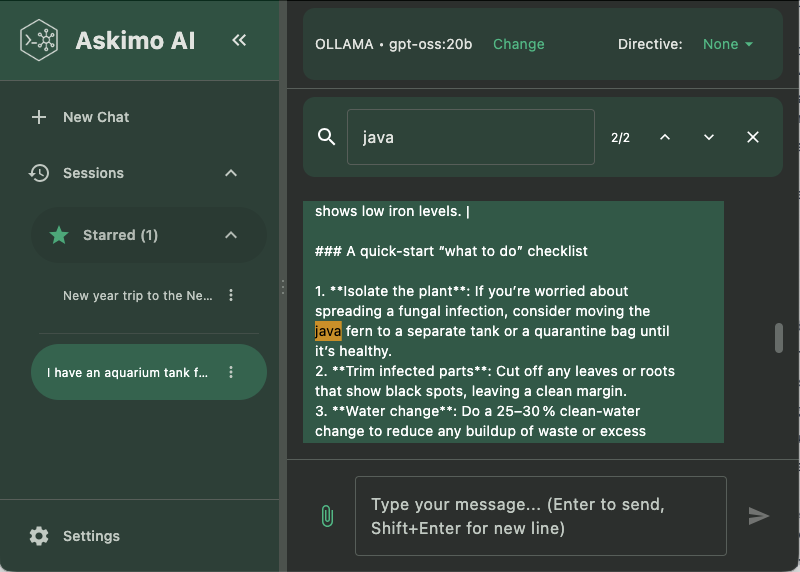

3. Recherche et organisation des connaissances pour les conversations Ollama

- Recherche plein texte intégrée au chat pour retrouver n’importe quel message dans vos sessions Ollama

- Filtrage rapide par mots-clés pour localiser rapidement des informations dans de longues conversations

- Favoriser / épingler des fils Ollama importants pour un rappel rapide et un accès simplifié

4. Outils utilitaires pour les fils de discussion des sessions Ollama

- Export en un clic vers Markdown, JSON ou HTML (formatage propre, adapté aux développeurs)

- Transcriptions Ollama partageables pour docs / PRD / specs

- Favoriser, retirer des favoris et réordonner les sessions Ollama importantes

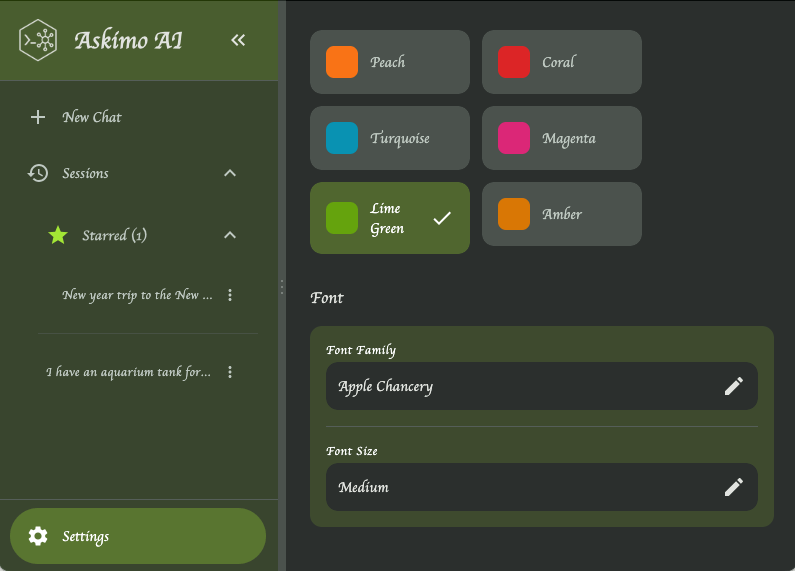

5. UI, personnalisation et accessibilité pour Ollama Desktop

- Thèmes clair et sombre (changement de thème sans rechargement)

- Personnalisation des polices (réglages de lisibilité pour les longues sessions Ollama)

- Raccourcis clavier pour : nouvelle conversation, changement de fournisseur, focus sur la recherche, export

- Défilement fluide et stabilité de la mise en page (pas de « sauts » pendant le streaming Ollama)

6. Confidentialité et workflow local-first avec Ollama

- Les réponses des modèles locaux ne quittent jamais votre machine (lorsque vous utilisez des fournisseurs IA locaux comme Ollama)

- Les fournisseurs cloud ne sont utilisés que lorsque vous les sélectionnez explicitement

- Les exports restent locaux sauf si vous choisissez de les partager à l’extérieur

- Aucun sync en arrière-plan ni analytics silencieux sur le contenu

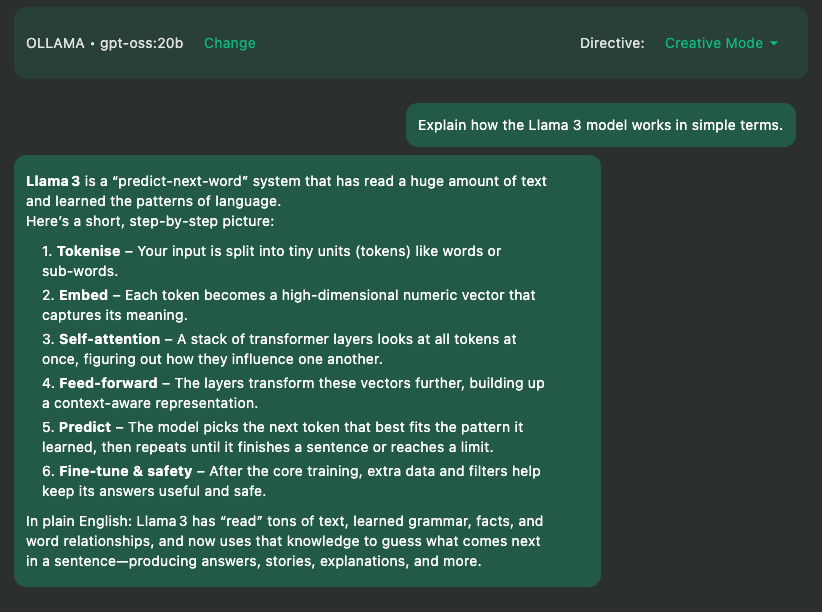

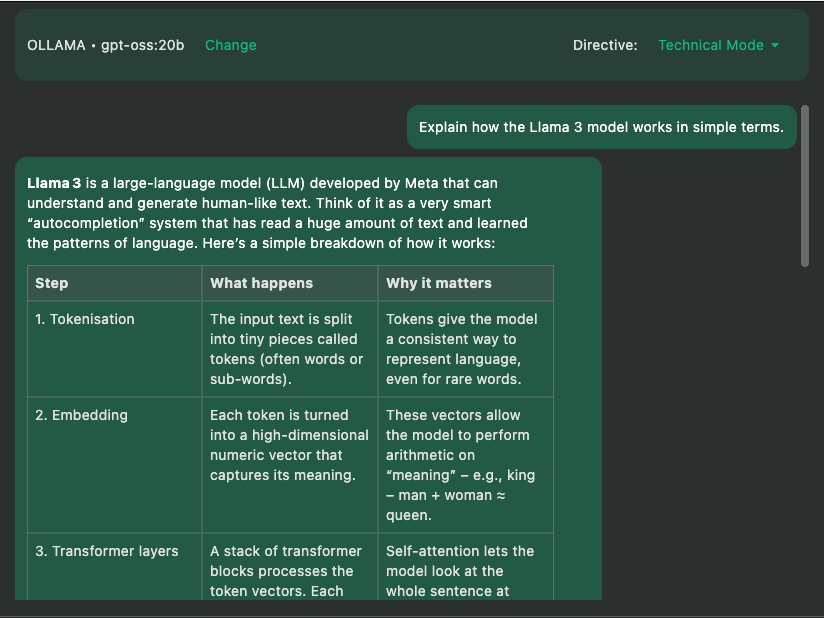

7. Directives personnalisées dans Askimo pour les modèles Ollama

Les directives personnalisées vous permettent de définir comment l’IA se comporte lors de l’exécution de modèles IA locaux. Au lieu de retaper de longues instructions à chaque nouvelle conversation, vous définissez vos préférences une fois et Askimo les applique automatiquement à toutes les conversations.

-

Comportement cohérent pour les modèles locaux Gardez vos conversations Llama, Mistral, Gemma ou Phi-3 alignées avec le ton, le style et le niveau de détail que vous préférez.

-

Préréglages spécifiques aux tâches pour les workflows récurrents Créez des directives pour coder, déboguer, résumer des articles, générer de la documentation ou toute autre tâche que vous faites régulièrement avec des modèles IA locaux.

-

Changement instantané sans encombrer les prompts Changez de directives en un clic au lieu de coller des paragraphes d’instructions dans chaque message.

-

Optimisé pour les longues sessions avec inférence locale Les directives aident les modèles locaux à rester concentrés et à réduire le bruit (aller-retour inutile), rendant les longues sessions de recherche ou de code plus fluides et plus efficaces.

8. RAG orienté projet avec des modèles Ollama locaux

La fonctionnalité RAG (Retrieval-Augmented Generation) d’Askimo vous permet de discuter avec l’ensemble de votre projet en utilisant des modèles Ollama locaux. Au lieu de copier manuellement du contenu dans des prompts, Askimo récupère automatiquement le contexte pertinent à partir de vos fichiers de projet.

-

Conversations contextualisées avec vos projets Posez des questions sur votre travail et obtenez des réponses ancrées dans vos fichiers réels avec Llama 3, Mistral ou d’autres modèles Ollama. Fonctionne pour des projets de code, de la documentation, des articles de recherche, des projets d’écriture, etc.

-

Récupération automatique du contexte Askimo indexe vos fichiers de projet et injecte automatiquement le contenu pertinent dans le contexte de la conversation.

-

RAG local axé confidentialité Vos fichiers ne quittent jamais votre machine lorsque vous utilisez des modèles Ollama locaux avec le RAG, contrairement aux assistants cloud.

-

Compréhension multi-fichiers Posez des questions qui couvrent plusieurs fichiers : les modèles Ollama recevront le contexte pertinent provenant de tout votre projet.

Exemples de cas d’usage :

- Projets logiciels : « Explique comment fonctionne le flux d’authentification » ou « Où les données utilisateur sont-elles validées ? »

- Documentation : « Résume les changements clés dans la documentation de l’API » ou « Quel est le processus d’installation ? »

- Articles de recherche : « Quelle méthodologie ai-je utilisée au chapitre 3 ? » ou « Trouve toutes les références aux données climatiques »

- Projets d’écriture : « Quels thèmes apparaissent dans tous les chapitres ? » ou « Liste toutes les interactions des personnages avec John »

- Spécifications techniques : « Quelles sont les exigences système ? » ou « Comment le module A se connecte-t-il au module B ? »

Fonctionnalités uniques à Askimo (comparé à d’autres interfaces graphiques Ollama)

- Chat multi-fournisseurs unifié (local + hébergé)

- Organisation structurée avec recherche, favoris et options d’export

- Expérience de bureau native avec installateurs macOS et Windows

- Plusieurs formats d’export (Markdown, JSON, HTML) conçus pour les développeurs et les workflows de recherche

- RAG orienté projet pour discuter avec vos projets à l’aide de modèles Ollama locaux (vos fichiers restent privés)

- Extensibilité fluide via une architecture CLI et Desktop partagée

Les autres interfaces Ollama se concentrent surtout sur la fourniture d’une fenêtre de chat. Askimo est conçu pour la productivité à long terme, la connaissance structurée et des workflows rapides, à la fois pour les modèles locaux et cloud.

Questions fréquentes (FAQ)

Ollama dispose-t-il d’une interface graphique officielle ?

Non. Ollama fournit un CLI et une API locale, mais aucune interface graphique officielle. Askimo App est un client de bureau complet qui se connecte localement à Ollama.

Quelle est une bonne application de bureau Ollama pour macOS ou Windows ?

Askimo propose le changement multi-fournisseurs, la recherche, les favoris, l’export, et une UX soignée conçue pour un usage quotidien sur macOS et Windows.

Puis-je utiliser des modèles Ollama et des modèles cloud ensemble ?

Oui. Askimo vous permet d’exécuter des modèles IA locaux (y compris Ollama), puis de basculer vers OpenAI, Claude ou Gemini en un clic.

Mes données sont-elles privées lorsque j’utilise Askimo avec Ollama ?

Oui. Toute l’inférence locale passe par votre installation Ollama. Askimo ne communique qu’avec votre endpoint local lorsque vous utilisez Ollama. Pour en savoir plus sur la façon dont Askimo protège vos données et ne collecte, n’échange ni ne stocke d’informations sensibles.

Pourquoi les réponses sont-elles lentes avec Ollama ?

Les grands modèles (comme les variantes plus volumineuses de Llama 3) exigent du matériel puissant. Choisissez des modèles plus petits comme mistral ou phi3 pour des réponses plus rapides, ou mettez à niveau votre CPU/GPU.

Comment changer de modèle Ollama dans Askimo ?

Ouvrez Providers → Ollama, puis mettez à jour le nom du modèle. Vous pouvez pré-télécharger un modèle avec :

ollama pull mistralPuis-je exécuter Askimo + Ollama hors ligne ?

Oui. Après le téléchargement des modèles, Askimo et Ollama fonctionnent entièrement hors ligne.

Puis-je utiliser Askimo avec mes projets via Ollama ?

Oui. La fonctionnalité RAG d’Askimo vous permet de discuter avec l’ensemble de votre projet en utilisant des modèles Ollama locaux. Qu’il s’agisse de code, de documentation, d’articles de recherche ou de projets d’écriture, vos fichiers sont indexés localement et le contexte pertinent est automatiquement ajouté aux conversations, ce qui maintient tout en privé sur votre machine.

Dépannage

Le modèle ne répond pas

Vérifiez si le service Ollama est en cours d’exécution :

ollama listSi la liste est vide, exécutez un modèle pour démarrer le serveur :

ollama run mistralEndpoint injoignable

Vérifiez que le port 11434 est actif. Si vous avez personnalisé le port, mettez à jour les paramètres du fournisseur dans Askimo.

Réponses lentes

Utilisez un modèle plus petit ou fermez des applications gourmandes en ressources.

Erreur de modèle manquant

Téléchargez-le explicitement :

ollama pull phi3Askimo vs autres applications de bureau Ollama et interfaces graphiques Ollama

Lorsque vous évaluez des clients de bureau Ollama et des options d’interface graphique Ollama pour macOS, Windows ou Linux, voici comment Askimo se compare :

Askimo Ollama Desktop vs Open WebUI :

- Askimo : application de bureau native optimisée pour les performances du chat Ollama

- Open WebUI : interface Ollama dans le navigateur nécessitant une configuration Docker

- Avantage Askimo : support multi-fournisseurs (Ollama + ChatGPT + Claude + Gemini) et RAG orienté projet

Askimo vs Ollama Terminal CLI :

- Askimo : historique complet, recherche, export, RAG et organisation pour les chats Ollama

- CLI : prompt/réponse basique sans persistance ni gestion des conversations Ollama

- Avantage Askimo : workflow Ollama professionnel avec raccourcis clavier et thèmes

Askimo vs interfaces Web Ollama génériques :

- Askimo : messages Ollama en chargement paresseux pour des performances fluides même avec des chats de 1000+ messages

- Interfaces Web : rendu DOM complet qui provoque des lenteurs sur les longues conversations Ollama

- Avantage Askimo : vitesse native de bureau et efficacité des ressources pour les modèles Ollama

Pour les utilisateurs exécutant localement Llama 3, Mistral, Phi-3, Gemma ou d’autres modèles Ollama, Askimo offre une expérience de bureau Ollama complète en 2025.

Conclusion

Askimo apporte Ollama sur le bureau avec vitesse, structure et zéro friction. Les modèles locaux restent privés. Vos conversations restent organisées. Et vos prompts deviennent une connaissance réutilisable plutôt que des commandes jetables.

Essayez Askimo dès aujourd’hui : 👉 https://askimo.chat

Vous avez des retours ou des demandes de fonctionnalités ? Mettez une étoile au repo et ouvrez une issue.