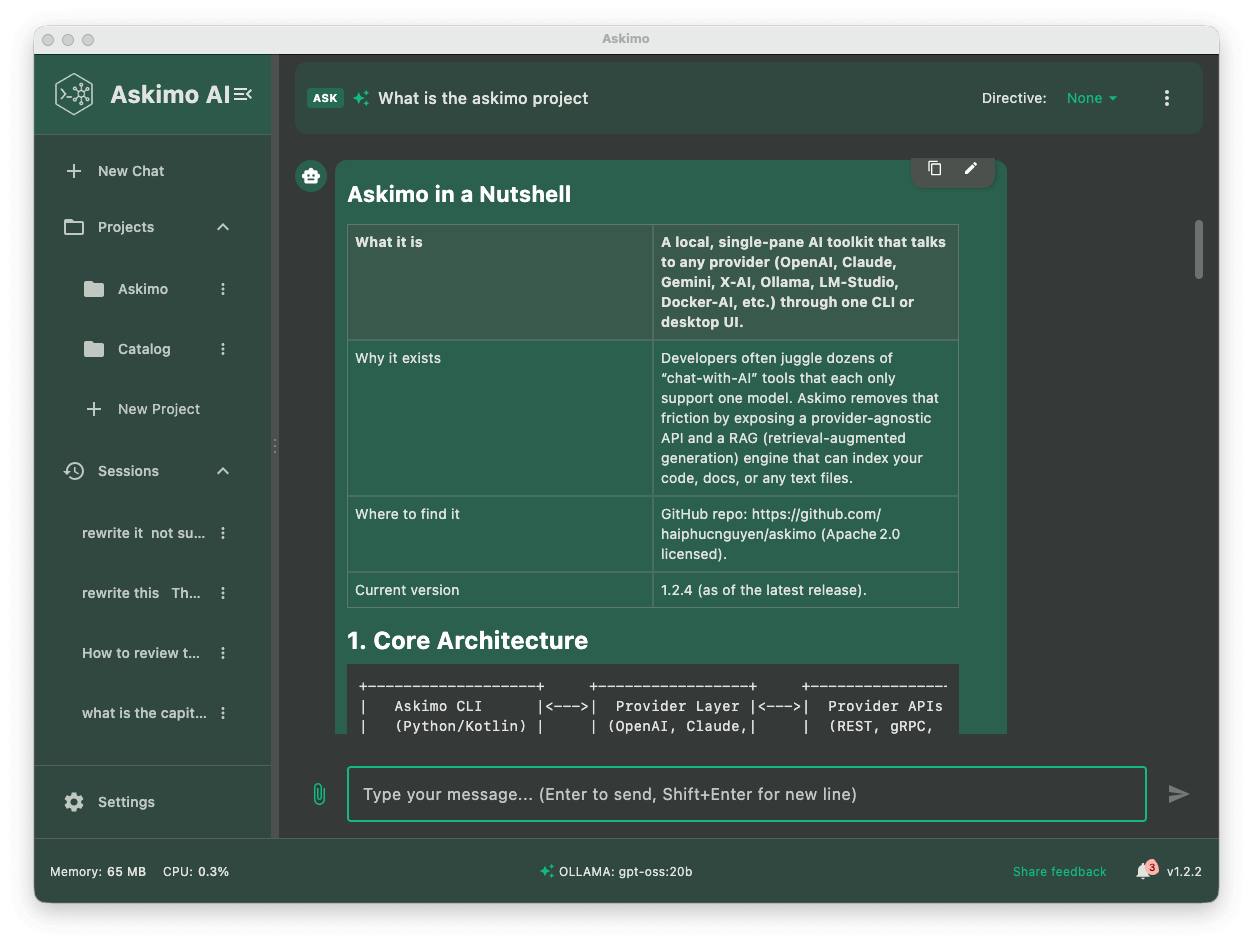

macOS, Windows 또는 Linux에서 로컬 AI 모델을 실행하기 위한 Ollama 데스크톱 앱, Ollama GUI, Ollama 클라이언트 또는 빠른 Ollama 채팅 인터페이스를 찾고 있다면, 이 가이드는 Askimo App을 고려할 만한 옵션으로 소개합니다. Askimo는 Llama 3, Llama 3.1, Llama 3.2, Mistral, Phi 3, Gemma를 포함한 수백 개의 Ollama 모델을 지원하는 네이티브 Ollama 데스크톱 경험을 제공하며, OpenAI, Claude, Gemini와 같은 클라우드 제공자도 하나의 통합된 인터페이스에서 지원합니다.

TL;DR: Ollama를 설치하고 Askimo App GUI를 다운로드한 뒤, Askimo를

http://localhost:11434에 연결하도록 설정하고 선호하는 Ollama 모델(llama3,mistral,phi3,gemma)을 선택하면, 완전히 검색 가능하고 정리 및 내보내기가 가능한 로컬 AI 대화를 바로 시작할 수 있습니다.

CLI 또는 Web UI 대신 Ollama 데스크톱 GUI를 사용하는 이유

Ollama의 커맨드라인 인터페이스(CLI)는 빠른 프롬프트 실행에는 강력하지만, Askimo와 같은 전용 Ollama 데스크톱 앱은 본격적인 AI 워크플로를 위한 필수 생산성 기능을 제공합니다.

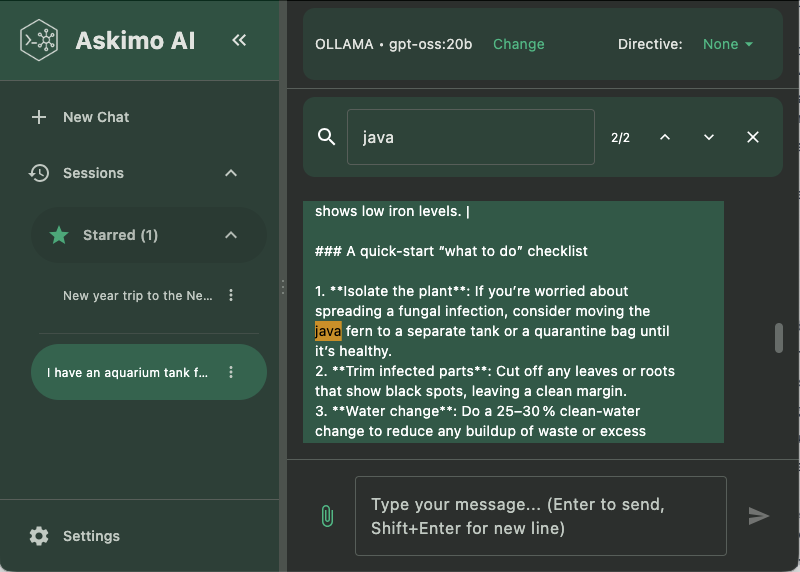

- 모든 Ollama 채팅 세션에 걸친 영구적인 대화 기록

- 채팅 내 전체 텍스트 검색으로 Ollama 대화에서 메시지를 빠르게 찾기

- 중요한 Ollama 대화에 별표 표시 및 고정

- Ollama 채팅을 Markdown, JSON, HTML로 내보내기 (문서, 노트, 팀 공유용)

- 로컬 AI 제공자와 클라우드 AI 제공자 간 원클릭 전환

- 로컬 Ollama 모델을 사용하는 프로젝트 인식 RAG

- 사용자 정의 테마, 키보드 단축키, 구조화된 워크플로

- 대규모 채팅을 위한 Lazy Loading (스크롤 시 이전 메시지만 로드)

Askimo는 흩어진 터미널 명령으로 이루어지던 로컬 Ollama 모델 실험을 반복 가능하고 전문적인 데스크톱 워크플로로 전환합니다.

Askimo의 Ollama 데스크톱 성능이 Web UI보다 뛰어난 이유

대부분의 “Ollama 데스크톱” 앱과 Ollama Web UI는 전체 대화를 DOM에 렌더링합니다. Llama 3나 Mistral과 같은 로컬 모델로 수백, 수천 개의 메시지가 쌓이면 메모리 사용량이 급증하고 UI가 느려지기 시작합니다. 스크롤이 끊기고 입력 지연이 발생하며 렌더링 성능이 저하됩니다.

Askimo의 Ollama 데스크톱 클라이언트는 다른 접근 방식을 취합니다. Ollama 워크플로에 최적화된 네이티브 우선, 리소스 인식 설계로 채팅 중 메시지는 스트리밍되고 이전 기록은 가상화된 상태로 유지됩니다. 과거 Ollama 메시지는 위로 스크롤할 때만 로드되므로, 장시간의 리서치 세션이나 대규모 코딩 대화에서도 항상 부드러운 성능을 유지합니다.

Askimo Ollama Desktop vs Terminal CLI vs Web UI 비교

| 워크플로 기능 | Ollama 터미널만 사용 | 일반 Ollama Web UI | Askimo Ollama Desktop |

|---|---|---|---|

| 멀티 제공자 지원 | 수동 스크립트 | 보통 Ollama 전용 | 내장 제공자 전환기 |

| 채팅 기록 | 자동 로그 없음 | 기본 / 도구별 상이 | 정리되고 검색 가능 |

| 내보내기 옵션 | 수동 복사 | 드묾 | Markdown, JSON, HTML |

| 대화 정리 | 불가 | 제한적 | 즐겨찾기 + 구조화된 세션 |

| 로컬 개인정보 보호 | 완전 로컬 | 도구에 따라 다름 | 로컬 AI + 선택적 클라우드 |

| 크로스 플랫폼 | Linux/macOS/Windows | 다양함 | Linux/macOS/Windows |

1단계: macOS, Windows 또는 Linux에 Ollama 설치

Ollama는 macOS, Windows, Linux에서 로컬로 실행됩니다.

-

macOS 설치 파일 다운로드: https://ollama.com/download/mac

-

Windows 설치 파일 다운로드: https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | sh설치 테스트:

ollama run llama3아직 모델이 다운로드되지 않았다면 Ollama가 자동으로 가져옵니다.

2단계: Askimo App(Ollama GUI) 설치

Askimo App 바이너리:

앱을 열고(응용 프로그램 폴더 / 시작 메뉴) 제공자 설정으로 이동합니다.

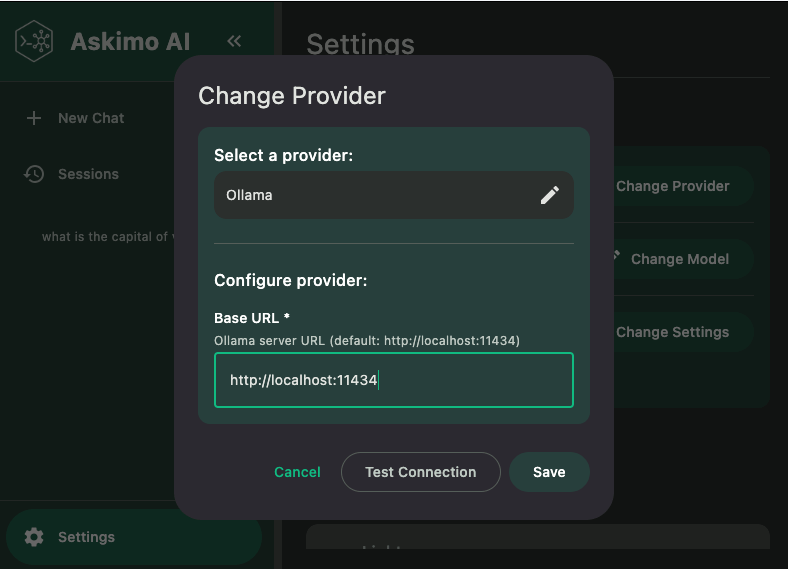

3단계: Askimo App을 Ollama 서버에 연결

Askimo는 기본 Ollama 엔드포인트를 자동으로 감지합니다:

http://localhost:11434

- Askimo App 열기

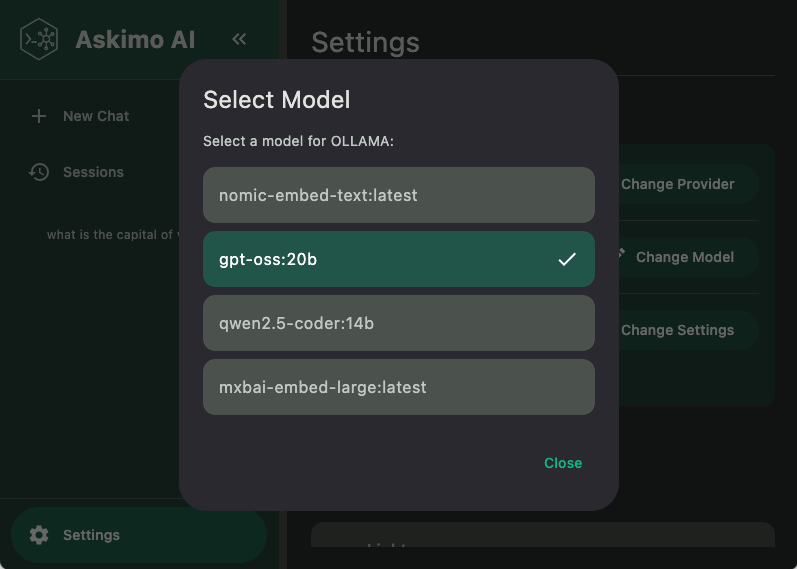

- Settings → Providers로 이동

- Ollama 선택

- 엔드포인트가

http://localhost:11434인지 확인 - 모델 선택 (예:

llama3,mistral,phi3,gemma,gpt-oss:20b등) - 저장 후 채팅 시작

터미널 명령 없이 Ollama 모델을 즉시 전환할 수 있습니다.

Askimo Ollama Desktop 앱 기능 심층 분석

아래는 Askimo가 단순한 “Ollama 래퍼”를 넘어서는 이유를 자세히 살펴봅니다.

1. Ollama 채팅을 위한 성능 및 리소스 효율성

- 이전 Ollama 메시지에 대한 Lazy Loading(대규모 채팅용 가상화 기록)

- 부드러운 점진적 렌더링을 통한 Ollama 응답 스트리밍

- 전체 스레드를 다시 렌더링하는 Web 래퍼 대비 최소한의 DOM 사용

- 수백 턴에 걸친 Ollama 리서치 세션에서도 효율적인 메모리 사용

2. 멀티 제공자 및 Ollama 모델 관리

- 로컬 AI 제공자(Ollama 등)와 클라우드 제공자(OpenAI, Claude, Gemini) 간 즉시 전환

- 빠른 모델 선택기(예:

llama3→mistral전환) - 로컬 Ollama에 대한 자동 엔드포인트 감지

3. Ollama 대화를 위한 검색 및 지식 정리

- 채팅 내 전체 텍스트 검색으로 어떤 메시지도 빠르게 찾기

- 긴 대화에서도 특정 정보를 즉시 찾을 수 있는 키워드 필터링

- 중요한 Ollama 스레드에 대한 별표 표시 및 고정

4. Ollama 세션을 위한 채팅 스레드 유틸리티

- Markdown, JSON, HTML로 원클릭 내보내기

- 문서 / PRD / 사양용으로 공유 가능한 Ollama 대화 기록

- 중요한 Ollama 세션의 별표 지정, 해제 및 재정렬

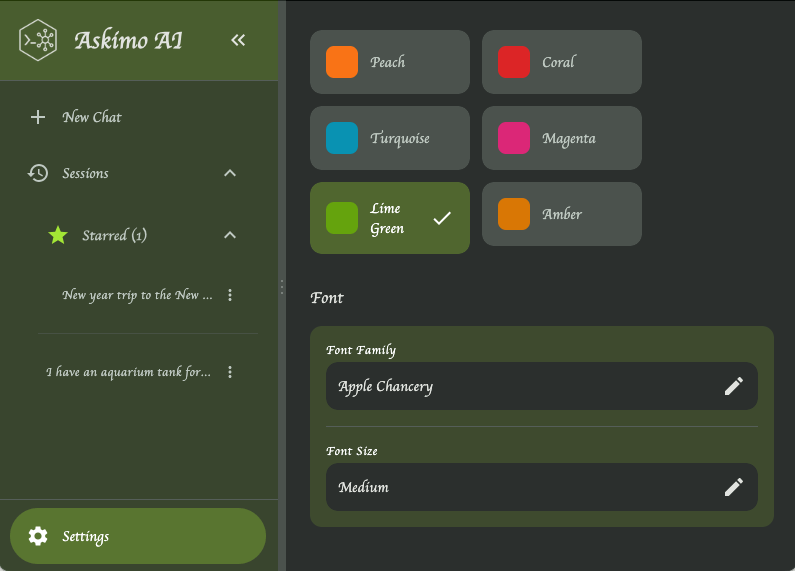

5. Ollama Desktop을 위한 UI, 개인화 및 접근성

- 라이트 / 다크 테마(새로고침 없이 전환)

- 폰트 사용자 정의(장시간 Ollama 세션을 위한 가독성 조정)

- 새 채팅, 제공자 전환, 검색 포커스, 내보내기용 키보드 단축키

- Ollama 스트리밍 중에도 안정적인 스크롤 및 레이아웃

6. Ollama를 위한 개인정보 보호 및 로컬 우선 워크플로

- 로컬 AI 제공자(Ollama)를 사용할 때 모델 응답은 기기를 벗어나지 않음

- 클라우드 제공자는 명시적으로 선택한 경우에만 사용

- 내보내기는 외부 공유를 선택하지 않는 한 로컬에 유지

- 콘텐츠에 대한 무단 백그라운드 동기화나 분석 없음

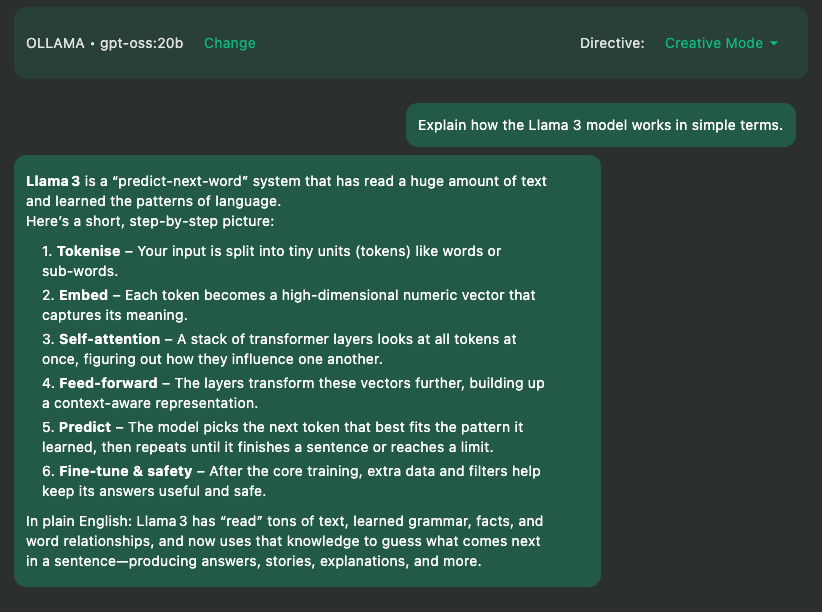

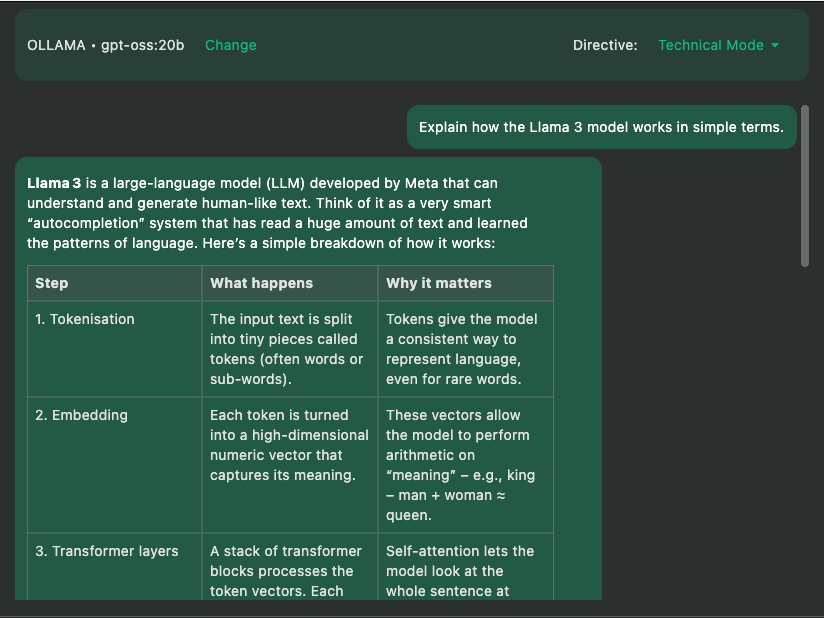

7. Ollama 모델을 위한 Askimo의 사용자 정의 지시문

사용자 정의 지시문을 사용하면 로컬 AI 모델 실행 시 AI의 동작 방식을 정의할 수 있습니다. 새 채팅을 시작할 때마다 긴 지시를 반복 입력하는 대신, 한 번 설정하면 Askimo가 모든 대화에 자동으로 적용합니다.

-

로컬 모델에 대한 일관된 동작 Llama, Mistral, Gemma, Phi-3 대화를 선호하는 톤, 스타일, 상세 수준에 맞출 수 있습니다.

-

반복 작업을 위한 작업별 프리셋 코딩, 디버깅, 논문 요약, 문서 생성 등 반복적인 로컬 AI 작업에 적합합니다.

-

프롬프트 복잡성 제거 매번 지시문을 붙여넣지 않고 원클릭으로 변경합니다.

-

장시간 로컬 추론에 최적화 지시문은 로컬 모델의 집중도를 높이고 불필요한 왕복을 줄여줍니다.

8. 로컬 Ollama 모델을 활용한 프로젝트 인식 RAG

Askimo의 RAG(검색 증강 생성) 기능을 사용하면 전체 프로젝트와 대화할 수 있습니다. 프롬프트에 내용을 수동으로 복사할 필요가 없습니다.

-

프로젝트 기반 컨텍스트 대화 Llama 3, Mistral 등 Ollama 모델을 사용해 실제 파일에 기반한 답변 제공

-

자동 컨텍스트 검색 Askimo가 프로젝트 파일을 인덱싱하고 관련 내용을 자동으로 대화에 포함

-

개인정보 보호 우선 로컬 RAG 로컬 Ollama 모델을 사용할 때 파일은 절대 외부로 전송되지 않음

-

다중 파일 이해 여러 파일에 걸친 질문도 전체 프로젝트 컨텍스트를 기반으로 답변 가능

예시 사용 사례:

- 소프트웨어 프로젝트: “인증 흐름은 어떻게 동작하나요?”

- 문서: “API 문서의 주요 변경 사항을 요약해 주세요”

- 연구 논문: “3장에서 사용한 방법론은 무엇인가요?”

- 집필 프로젝트: “모든 장에 공통으로 나타나는 주제는 무엇인가요?”

- 기술 사양: “시스템 요구 사항은 무엇인가요?”

다른 Ollama GUI와 비교했을 때 Askimo만의 기능

- 로컬 + 호스팅 모델을 통합한 멀티 제공자 채팅

- 검색, 즐겨찾기, 내보내기를 통한 구조화된 정리

- macOS 및 Windows 설치 프로그램을 포함한 네이티브 데스크톱 경험

- 개발자 및 연구 워크플로에 최적화된 다양한 내보내기 형식

- 로컬 Ollama 모델을 사용한 프로젝트 인식 RAG(파일은 로컬에 유지)

- CLI와 Desktop을 공유하는 확장 가능한 아키텍처

다른 Ollama 인터페이스는 주로 채팅 창만 제공합니다. Askimo는 장기적인 생산성, 구조화된 지식, 빠른 워크플로를 위해 설계되었습니다.

자주 묻는 질문(FAQ)

Ollama에 공식 데스크톱 GUI가 있나요?

아니요. Ollama는 CLI와 로컬 API만 제공합니다. Askimo App은 로컬에서 Ollama에 연결하는 완전한 기능의 데스크톱 클라이언트입니다.

macOS 또는 Windows에 적합한 Ollama 데스크톱 앱은 무엇인가요?

Askimo는 멀티 제공자 전환, 검색, 즐겨찾기, 내보내기, 일상적인 사용을 위한 세련된 UX를 제공합니다.

Ollama 모델과 클라우드 모델을 함께 사용할 수 있나요?

네. Askimo를 사용하면 로컬 AI 모델(Ollama)에서 OpenAI, Claude, Gemini로 한 번의 클릭으로 전환할 수 있습니다.

Askimo를 Ollama와 함께 사용할 때 데이터는 안전한가요?

네. 모든 로컬 추론은 Ollama 설치를 통해 이루어지며, Askimo는 Ollama 사용 시 로컬 엔드포인트와만 통신합니다. 자세한 내용은 Askimo의 데이터 보호 정책을 참고하세요.

Ollama 응답이 느린 이유는 무엇인가요?

대형 모델(Llama 3 대형 변형 등)은 강력한 하드웨어가 필요합니다. 더 빠른 응답을 위해 mistral 또는 phi3와 같은 소형 모델을 선택하거나 CPU/GPU를 업그레이드하세요.

Askimo에서 Ollama 모델을 변경하는 방법은?

Providers → Ollama에서 모델 이름을 변경하세요.

ollama pull mistralAskimo + Ollama를 오프라인으로 실행할 수 있나요?

네. 모델이 다운로드된 이후에는 Askimo와 Ollama 모두 완전히 오프라인에서 작동합니다.

Ollama를 사용해 프로젝트와 대화할 수 있나요?

네. Askimo의 RAG 기능을 사용하면 코드, 문서, 연구 자료, 집필 프로젝트 등과 로컬에서 안전하게 대화할 수 있습니다.

문제 해결

모델이 응답하지 않음

ollama list비어 있다면:

ollama run mistral엔드포인트에 연결할 수 없음

포트 11434가 활성화되어 있는지 확인하세요.

응답이 느림

더 작은 모델을 사용하거나 리소스를 많이 사용하는 애플리케이션을 종료하세요.

모델 누락 오류

ollama pull phi3Askimo와 다른 Ollama 데스크톱 앱 비교

Askimo Ollama Desktop vs Open WebUI

- Askimo: Ollama 채팅에 최적화된 성능을 갖춘 네이티브 데스크톱 앱

- Open WebUI: Docker 설정이 필요한 브라우저 기반 Ollama 인터페이스

- Askimo의 장점: 멀티 제공자 지원(Ollama + ChatGPT + Claude + Gemini) 및 프로젝트 인식 RAG

Askimo vs Ollama Terminal CLI

- Askimo: 전체 대화 기록, 검색, 내보내기, RAG, 정리 기능 제공

- CLI: 지속성이나 관리 기능 없는 기본 프롬프트/응답

Askimo vs 일반 Ollama Web UI

- Askimo: 1000개 이상의 메시지 채팅에서도 부드러운 성능을 위한 Lazy Loading

- Web UI: 전체 DOM 렌더링으로 인한 지연

- Askimo의 장점: Ollama 모델을 위한 네이티브 데스크톱 속도와 리소스 효율성

2025년에 Llama 3, Mistral, Phi-3, Gemma 또는 기타 Ollama 모델을 로컬로 실행하는 사용자에게 Askimo는 포괄적인 Ollama 데스크톱 경험을 제공합니다.

마무리

Askimo는 속도, 구조, 그리고 마찰 없는 경험으로 Ollama를 데스크톱에 제공합니다. 로컬 모델은 비공개로 유지되고, 대화는 정리되며, 프롬프트는 일회성이 아닌 재사용 가능한 지식이 됩니다.

Askimo를 지금 사용해 보세요: 👉 https://askimo.chat