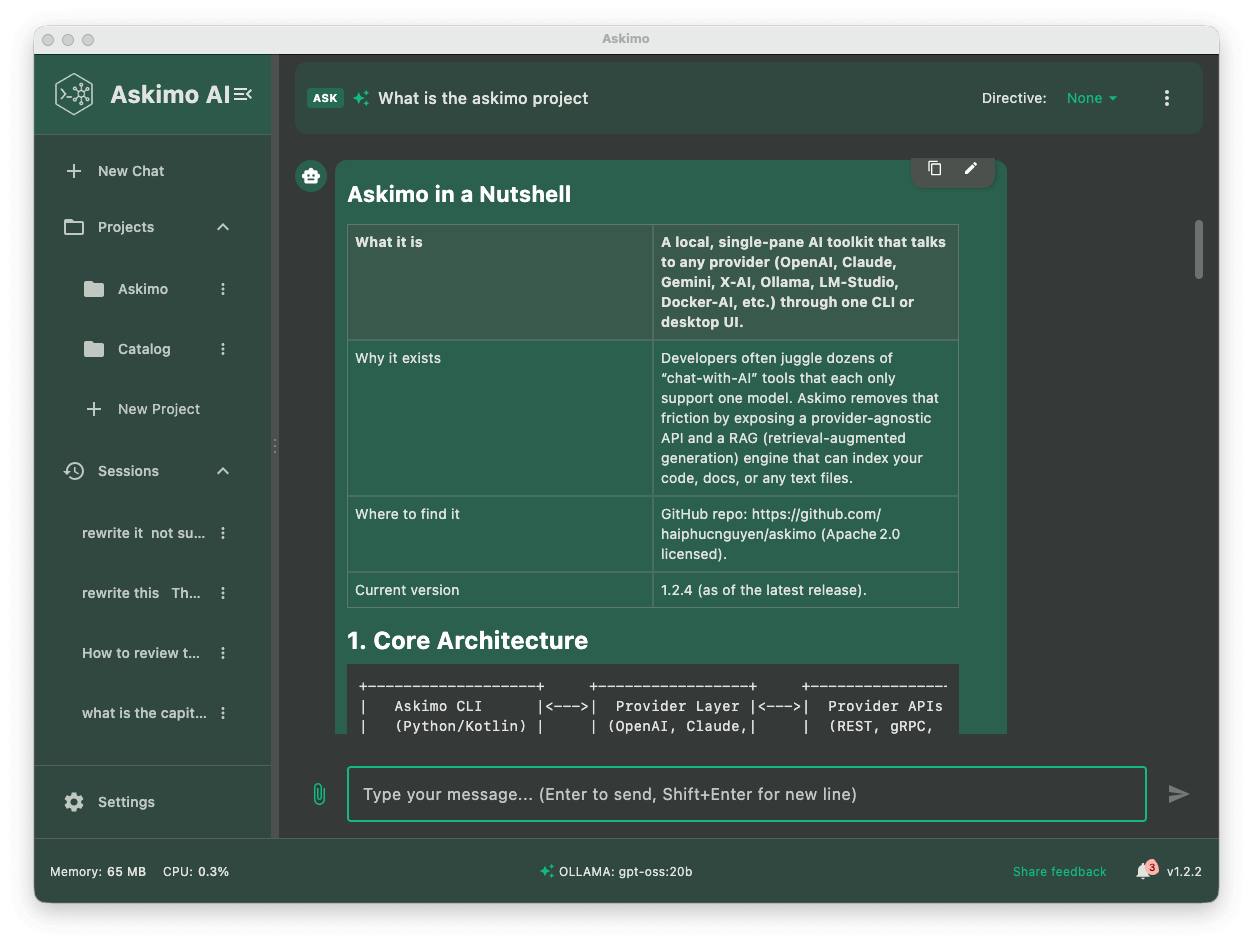

如果你正在寻找一款 Ollama 桌面应用、Ollama GUI、Ollama 客户端,或用于在 macOS、Windows 或 Linux 上运行本地 AI 模型的高速 Ollama 聊天界面,那么本指南将向你介绍一个值得考虑的选择——Askimo App。Askimo 为 Llama 3、Llama 3.1、Llama 3.2、Mistral、Phi 3、Gemma 以及数百种其他 Ollama 模型提供原生桌面体验,同时还在一个统一的界面中支持 OpenAI、Claude、Gemini 等云端模型提供商。

TL;DR:安装 Ollama,下载 Askimo App GUI,将 Askimo 配置为连接到

http://localhost:11434,选择你偏好的 Ollama 模型(llama3、mistral、phi3、gemma),即可开始进行完全可搜索、可组织、可导出的本地 AI 对话。

为什么要使用 Ollama 桌面 GUI,而不是 CLI 或 Web UI?

尽管 Ollama 的命令行界面(CLI)非常适合快速提示,但像 Askimo 这样的专用 Ollama 桌面应用为严肃的 AI 工作流提供了关键的生产力功能:

- 跨所有 Ollama 聊天会话的持久化对话历史

- 聊天内全文搜索,快速定位 Ollama 对话中的任意消息

- 收藏和置顶重要的 Ollama 会话,便于即时访问

- 将 Ollama 聊天导出为 Markdown、JSON 或 HTML,用于文档、笔记或团队共享

- 一键切换提供商(本地 AI 与云端 AI)

- 项目感知型 RAG,使用本地 Ollama 模型进行上下文感知对话

- 自定义主题、键盘快捷键和结构化工作流

- 针对超大聊天的懒加载(仅在向上滚动时加载旧消息)

Askimo 将零散的终端命令式 Ollama 模型实验,转变为可重复、专业的桌面级工作流。

为什么 Askimo 的 Ollama 桌面性能优于 Web UI

大多数“Ollama 桌面”应用和 Ollama Web UI 会将整个对话渲染到 DOM 中。随着使用 Llama 3 或 Mistral 等本地模型的聊天记录增长到数百甚至上千条消息,内存占用会急剧上升,界面开始变得卡顿,滚动不流畅、输入延迟、渲染变慢。

Askimo 的 Ollama 桌面客户端采用了不同的方法。它基于原生优先、资源感知的设计,专门为 Ollama 工作流优化:在你与本地模型聊天时,消息以流式方式显示,而旧的历史记录保持虚拟化,仅在向上滚动时才加载。这使得内存占用保持较低,即使在使用 Llama 3.2、Mistral 或 Phi‑3 进行长时间研究或大型代码对话时,也能保持流畅的桌面性能。

Askimo Ollama Desktop 与 Terminal CLI / Web UI 对比

| 工作流功能 | 仅 Ollama 终端 | 通用 Ollama Web UI | Askimo Ollama Desktop |

|---|---|---|---|

| 多提供商支持 | 手动脚本 | 通常仅 Ollama | 内置提供商切换器 |

| 聊天历史 | 无自动日志 | 基础 / 视工具而定 | 有序且可搜索 |

| 导出选项 | 手动复制 | 很少 | Markdown、JSON、HTML |

| 收藏 / 组织聊天 | 不支持 | 有限 | 收藏 + 结构化会话 |

| 本地隐私 | 完全本地 | 取决于工具 | 本地 AI + 可选云端 |

| 跨平台 | Linux/macOS/Windows | 差异较大 | Linux/macOS/Windows |

第一步:在 macOS、Windows 或 Linux 上安装 Ollama

Ollama 可在 macOS、Windows 和 Linux 上本地运行。

-

macOS 下载安装程序:https://ollama.com/download/mac

-

Windows 下载安装程序:https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | sh测试安装:

ollama run llama3如果模型尚未下载,Ollama 会自动获取。

第二步:安装 Askimo App(Ollama GUI)

Askimo App 二进制文件:

打开应用(应用程序文件夹 / 开始菜单),进入提供商设置。

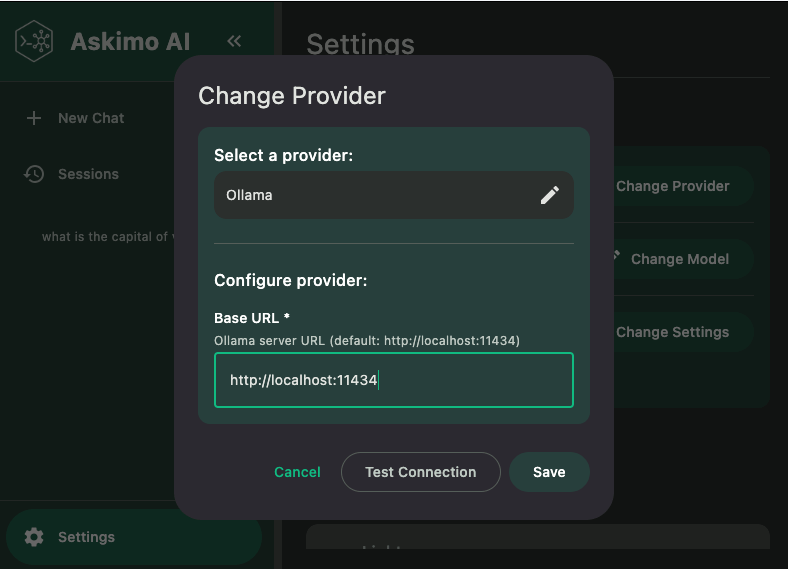

第三步:将 Askimo App 连接到你的 Ollama 服务器

Askimo 会自动检测默认的 Ollama 端点:

http://localhost:11434

- 打开 Askimo App

- 进入 Settings → Providers

- 选择 Ollama

- 确认端点为

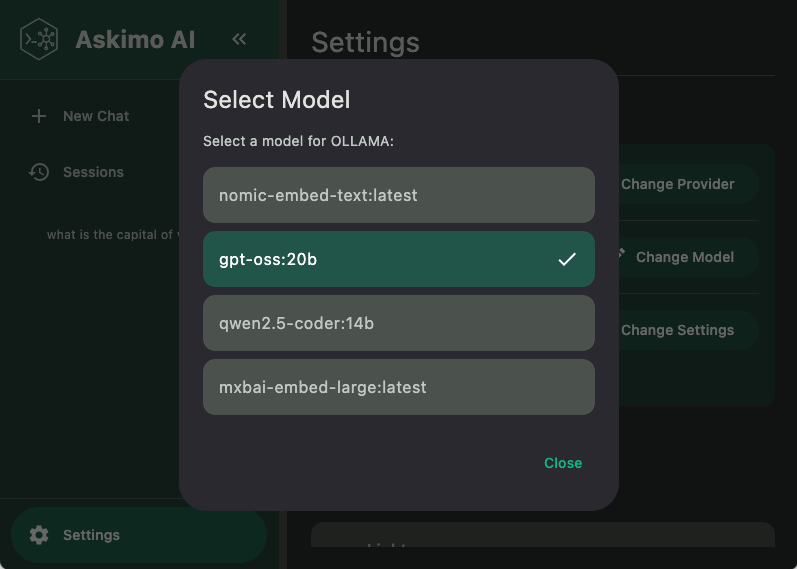

http://localhost:11434 - 选择模型(如

llama3、mistral、phi3、gemma、gpt-oss:20b等) - 保存并开始聊天

无需终端命令即可即时切换 Ollama 模型。

Askimo Ollama Desktop 应用功能深度解析

下面将更深入地介绍 Askimo 为什么不仅仅是“另一个 Ollama 封装工具”。

1. Ollama 聊天的性能与资源效率

- 旧 Ollama 消息的懒加载(适用于超大聊天的虚拟化历史)

- 流式 Ollama 响应,平滑的增量渲染

- 相比重新渲染整个线程的 Web 封装工具,占用更少的 DOM

- 在跨越数百轮的 Ollama 研究会话中保持高效的内存使用

2. 多提供商与 Ollama 模型管理

- 在本地 AI 提供商(Ollama 等)与云端提供商(OpenAI、Claude、Gemini)之间即时切换

- 快速模型选择器(例如从

llama3切换到mistral提升速度) - 本地 Ollama 的自动端点检测

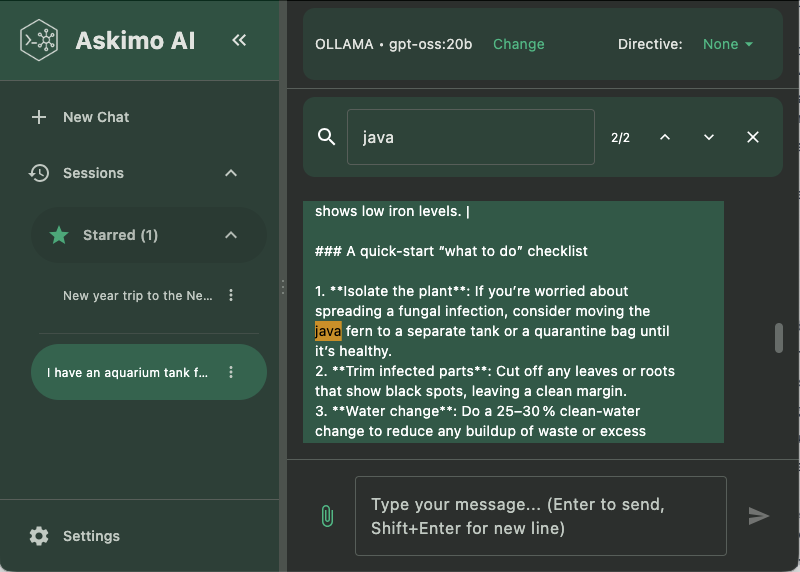

3. Ollama 会话的搜索与知识组织

- 聊天内全文搜索,快速找到任意消息

- 快速关键词过滤,在长对话中定位特定信息

- 收藏 / 置顶重要的 Ollama 线程,便于快速回顾

4. Ollama 会话的聊天线程工具

- 一键导出为 Markdown、JSON 或 HTML(干净、对开发者友好的格式)

- 可共享的 Ollama 对话记录,用于文档 / PRD / 规范

- 收藏、取消收藏并重新排序重要的 Ollama 会话

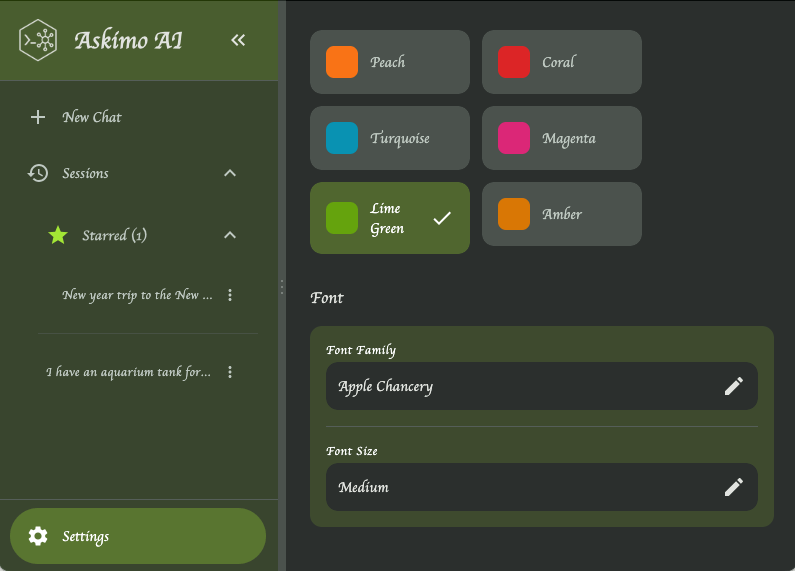

5. Ollama Desktop 的 UI、个性化与可访问性

- 明亮 / 深色主题(无需刷新即可切换)

- 字体自定义(提升长时间 Ollama 会话的可读性)

- 键盘快捷键:新建聊天、切换提供商、聚焦搜索、导出

- 平滑滚动与稳定布局(Ollama 流式输出期间无跳动)

6. 使用 Ollama 的隐私优先、本地优先工作流

- 使用本地 AI 提供商(如 Ollama)时,模型响应永远不会离开你的设备

- 仅在你明确选择时才使用云端提供商

- 导出内容保持本地,除非你选择外部共享

- 无内容的后台静默同步或分析

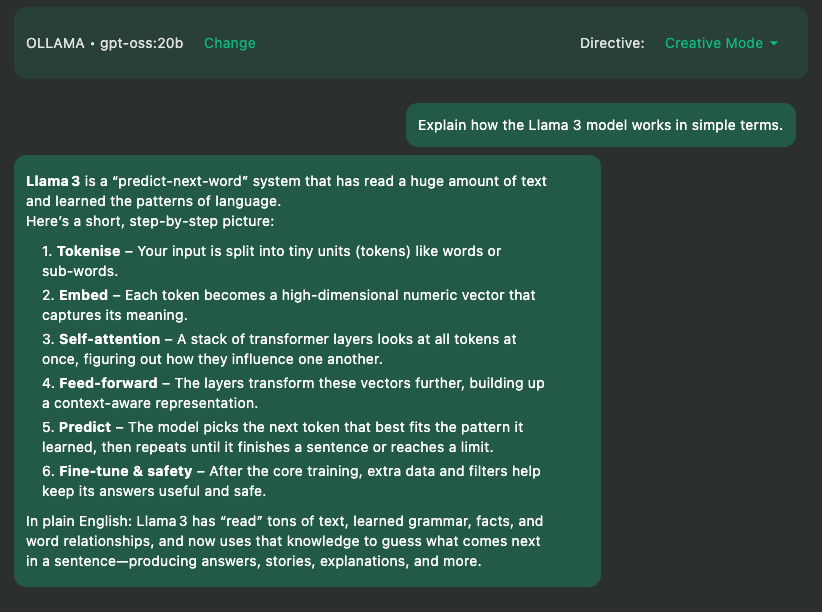

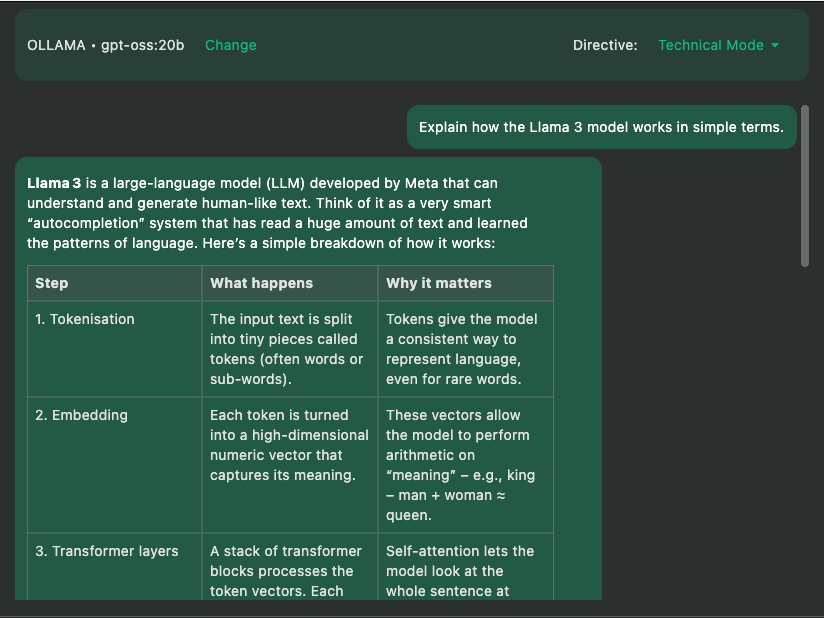

7. Askimo 中用于 Ollama 模型的自定义指令

自定义指令允许你定义在运行本地 AI 模型时 AI 的行为方式。你无需在每次新聊天时重复输入冗长的说明,只需设置一次,Askimo 即可在所有会话中自动应用。

-

本地模型的一致行为 让 Llama、Mistral、Gemma 或 Phi‑3 的对话始终符合你偏好的语气、风格和细节程度。

-

适用于重复工作流的任务预设 为编码、调试、论文总结、文档生成等常见本地 AI 任务创建指令。

-

无需堆叠提示即可即时切换 一键切换指令,而不是在每条消息中粘贴大段说明。

-

针对长时间本地推理进行优化 指令可帮助本地模型保持专注,减少无效往返,使长时间研究或编码更高效。

8. 使用本地 Ollama 模型的项目感知型 RAG

Askimo 的 RAG(检索增强生成)功能可让你使用本地 Ollama 模型与整个项目进行对话。无需手动将内容复制到提示中,Askimo 会自动从项目文件中检索相关上下文。

-

与项目相关的上下文对话 基于你的实际文件,使用 Llama 3、Mistral 或其他 Ollama 模型回答问题。

-

自动上下文检索 Askimo 会索引项目文件,并自动将相关内容注入对话上下文。

-

隐私优先的本地 RAG 使用本地 Ollama 模型时,你的文件永远不会离开你的设备。

-

多文件理解 提出跨多个文件的问题,Ollama 模型将接收到来自整个项目的相关上下文。

示例用例:

- 软件项目: “解释一下认证流程是如何工作的?”或“用户数据在哪里被校验?”

- 文档: “总结 API 文档中的关键变更”或“安装流程是什么?”

- 研究论文: “第三章使用了什么方法?”或“查找所有提到气候数据的地方”

- 写作项目: “所有章节中出现了哪些主题?”或“列出 John 与其他角色的所有互动”

- 技术规范: “系统需求是什么?”或“模块 A 如何连接到模块 B?”

Askimo 的独有功能(相较于其他 Ollama GUI)

- 统一的多提供商聊天(本地 + 托管)

- 通过搜索、收藏和导出实现结构化组织

- 提供 macOS 和 Windows 安装包的原生桌面体验

- 为开发者和研究工作流设计的多种导出格式(Markdown、JSON、HTML)

- 使用本地 Ollama 模型与项目对话的项目感知型 RAG(文件保持私有)

- 通过共享的 CLI 与 Desktop 架构实现无缝扩展

其他 Ollama 界面主要只提供一个聊天窗口。 Askimo 专为长期生产力、结构化知识和跨本地与云端模型的快速工作流而设计。

常见搜索问题(FAQ)

Ollama 是否有官方桌面 GUI?

没有。Ollama 提供 CLI 和本地 API,但没有官方 GUI。Askimo App 是一个功能完整的桌面客户端,可本地连接 Ollama。

macOS 或 Windows 上有哪些好的 Ollama 桌面应用?

Askimo 提供多提供商切换、搜索、收藏、导出以及为日常使用设计的精致 UX。

我可以同时使用 Ollama 模型和云端模型吗?

可以。Askimo 允许你运行本地 AI 模型(包括 Ollama),并一键切换到 OpenAI、Claude 或 Gemini。

使用 Askimo + Ollama 时,我的数据安全吗?

是的。所有本地推理都通过你的 Ollama 安装进行。使用 Ollama 时,Askimo 仅与本地端点通信。了解更多:Askimo 如何保护你的数据。

为什么 Ollama 的响应较慢?

大型模型(如更大的 Llama 3 变体)需要较强的硬件。可选择 mistral 或 phi3 等较小模型以获得更快响应,或升级 CPU/GPU。

如何在 Askimo 中切换 Ollama 模型?

打开 Providers → Ollama,然后更新模型名称。

ollama pull mistral我可以离线运行 Askimo + Ollama 吗?

可以。模型下载完成后,Askimo 和 Ollama 均可完全离线运行。

我可以使用 Askimo 通过 Ollama 与项目交互吗?

可以。Askimo 的 RAG 功能允许你使用本地 Ollama 模型与整个项目对话。无论是代码、文档、研究论文还是写作项目,文件都会在本地建立索引,并将相关上下文自动加入对话,确保数据始终保留在你的设备上。

故障排查

模型无响应

检查 Ollama 服务是否正在运行:

ollama list如果为空,运行模型以启动服务器:

ollama run mistral无法访问端点

确认 11434 端口处于活动状态。如果你自定义了端口,请更新 Askimo 的提供商设置。

响应缓慢

使用更小的模型,或关闭占用大量资源的应用程序。

缺少模型错误

显式拉取模型:

ollama pull phi3Askimo 与其他 Ollama 桌面应用和 GUI 对比

在评估 macOS、Windows 或 Linux 的 Ollama 桌面客户端和 GUI 选项时,Askimo 的表现如下:

Askimo Ollama Desktop vs Open WebUI:

- Askimo:针对 Ollama 聊天优化性能的原生桌面应用

- Open WebUI:需要 Docker 设置的基于浏览器的 Ollama 界面

- Askimo 优势:多提供商支持(Ollama + ChatGPT + Claude + Gemini)与项目感知型 RAG

Askimo vs Ollama Terminal CLI:

- Askimo:完整的聊天历史、搜索、导出、RAG 和会话组织

- CLI:无持久化或聊天管理的基础提示/响应

- Askimo 优势:具备快捷键和主题的专业 Ollama 工作流

Askimo vs 通用 Ollama Web UI:

- Askimo:采用懒加载,即使在 1000+ 消息的聊天中也能保持流畅性能

- Web UI:完整 DOM 渲染导致长对话卡顿

- Askimo 优势:为 Ollama 模型提供原生桌面速度和资源效率

对于在本地运行 Llama 3、Mistral、Phi‑3、Gemma 或其他 Ollama 模型的用户来说,Askimo 在 2025 年提供了全面的 Ollama 桌面体验。

最终总结

Askimo 以速度、结构和零摩擦的方式将 Ollama 带到桌面。 本地模型保持私密。你的对话井然有序。你的提示不再是一次性命令,而是可复用的知识。

立即体验 Askimo: 👉 https://askimo.chat