AI 智能体桌面应用,支持

一个应用,支持所有 AI 模型。在原生桌面应用中同时使用 ChatGPT、Claude、Gemini、Grok 和本地 LLM。通过 Plans 实现 AI 工作流自动化,支持 MCP 客户端和文档 RAG。所有对话均采用本地存储,确保隐私安全。

100% 免费 • 开源 • Windows、Mac 与 Linux

交互式演示

通过我们的交互式演示探索 Askimo 的功能与能力。

为什么选择桌面 AI 聊天应用,而不是网页浏览器?

使用原生桌面 AI 聊天软件获得更快的性能,在一个应用中使用多种 AI 模型和本地 LLM,并通过本地数据存储确保对话隐私。

在一个应用中使用 ChatGPT、Claude、Gemini 与 Ollama

一键切换 ChatGPT、Claude、Gemini 和 Ollama。并排对比不同 AI 模型的回答,找到最佳答案。针对特定任务测试不同语言模型。无需在浏览器标签页之间切换,也无需管理多个 AI 订阅。

比基于网页的 AI 聊天工具更快

使用 Kotlin 和 Compose Multiplatform 构建的原生桌面应用 - 不是缓慢的 Electron Web 封装。针对 macOS(Apple Silicon Mx)、Windows 和 Linux 进行了优化。启动迅速、内存占用低,并可通过 Ollama 使用 Llama、Mistral 等本地 LLM 离线运行。对话加载即时,几乎可瞬间搜索全部 AI 聊天记录。

本地存储的私密 AI 聊天

所有 AI 对话、API 密钥和聊天设置均经过加密并存储在你的电脑本地。无需云同步。不进行数据跟踪、不做分析、不收集个人信息。你可随时导出 AI 聊天记录。对 AI 对话数据拥有完全的所有权与控制权。

适用于 Windows、Mac 与 Linux 的 AI 桌面聊天应用功能

客户端完整功能:多模型支持、对话搜索、Markdown渲染、键盘快捷键,以及隐私优先的本地存储。

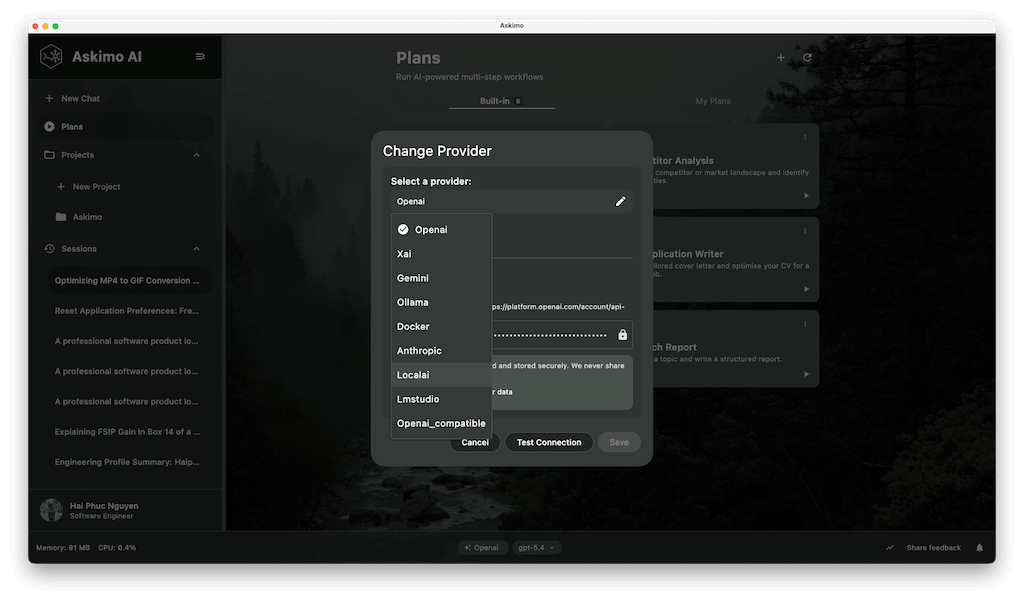

多 AI 模型聊天应用

使用 ChatGPT、Claude、Gemini、Ollama、Grok、LM Studio、LocalAI 和 Docker AI。无需打开多个应用,即可即时切换 AI 提供商。

搜索 AI 对话历史

对所有 AI 聊天进行全文搜索。可按关键词、AI 提供方、日期或内容即时查找历史对话,高效管理与检索聊天记录。

Markdown 与代码语法高亮

支持 Markdown 的精美 AI 回答渲染。为 50+ 种编程语言提供语法高亮。支持表格、列表、LaTeX 数学公式和代码图示。一键复制代码。

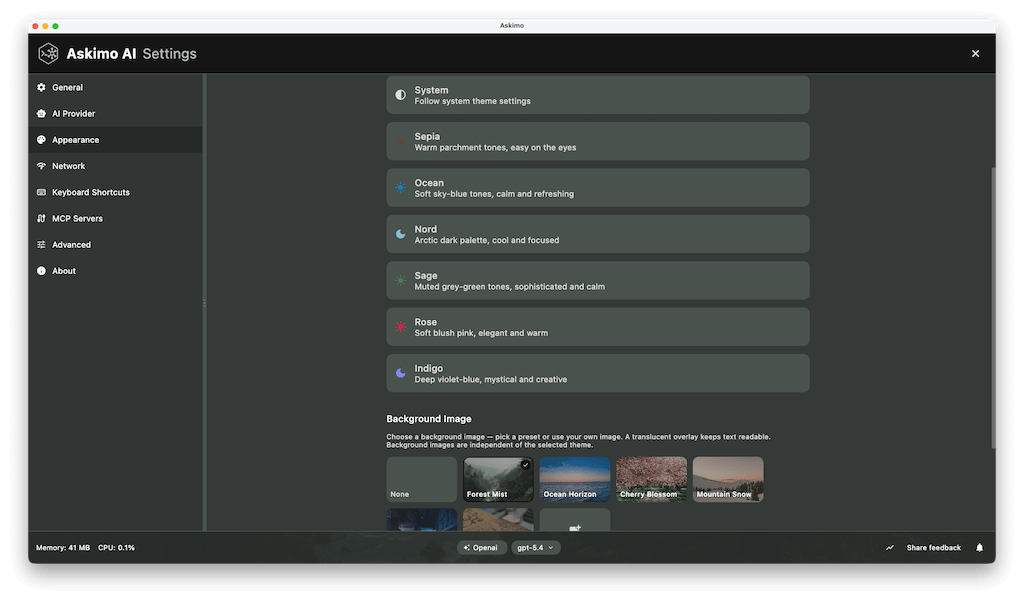

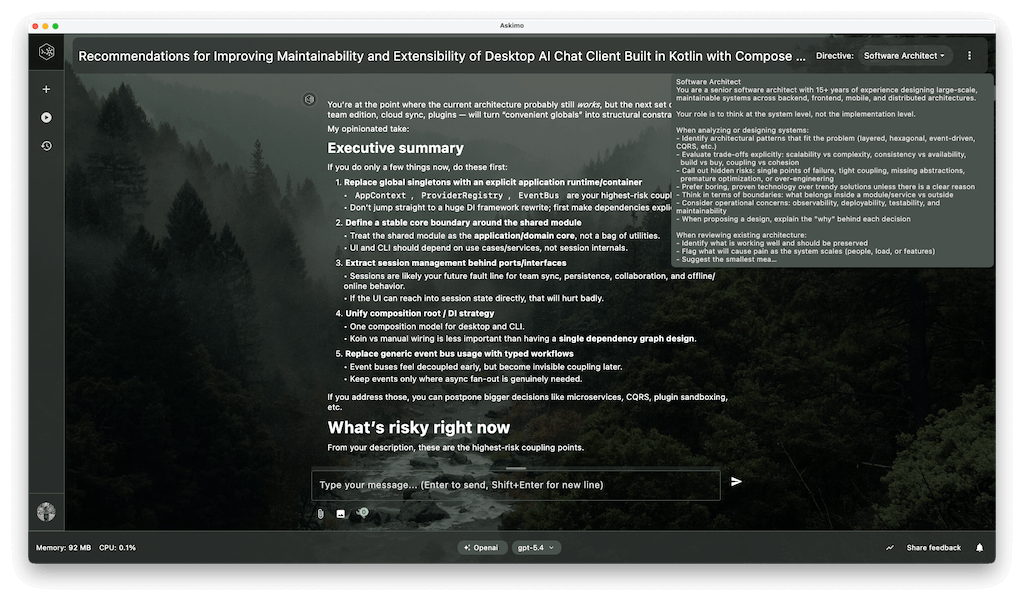

自定义 AI 聊天模板

为常见 AI 任务创建可复用的提示模板。通过自定义指令、语气设置和上下文,构建你的个人 AI 助手库。使用预配置的 AI 聊天工作流节省时间。

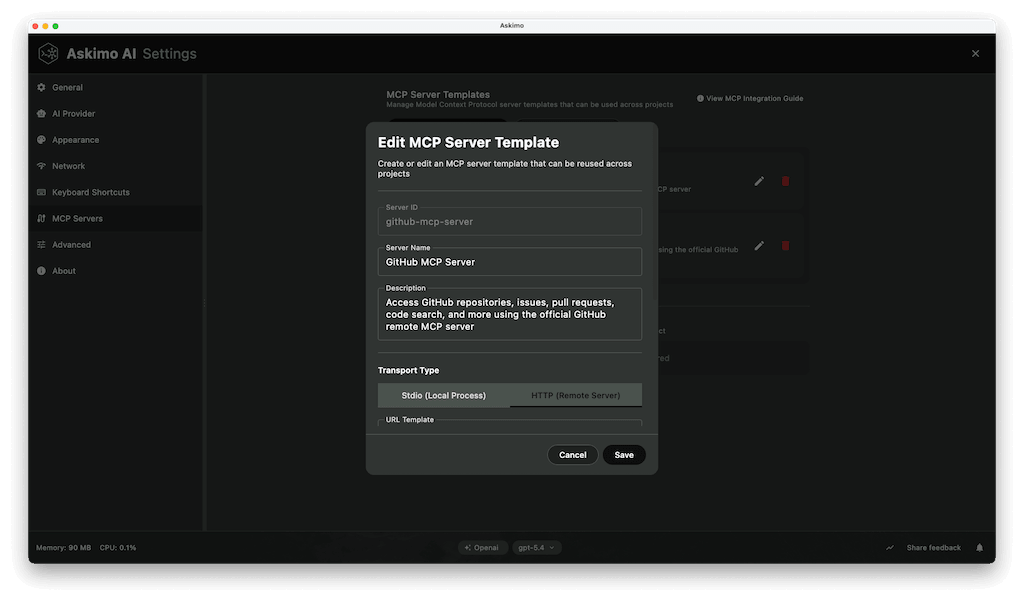

MCP 客户端桌面应用

Askimo 是功能完整的 MCP 客户端桌面应用。通过 stdio 或 HTTP 连接任何 MCP 兼容服务器。发出请求,让 AI 智能体运行 MCP 工具,并在同一响应中返回结果。带来你自己的工具 - 网络搜索、数据库、API 等。

加密的本地 AI 聊天存储

对 API 密钥和敏感数据使用 AES-256 加密。使用 SQLite 数据库存储本地会话。零遥测、无需云同步。你的 AI 聊天完全保留在本机。

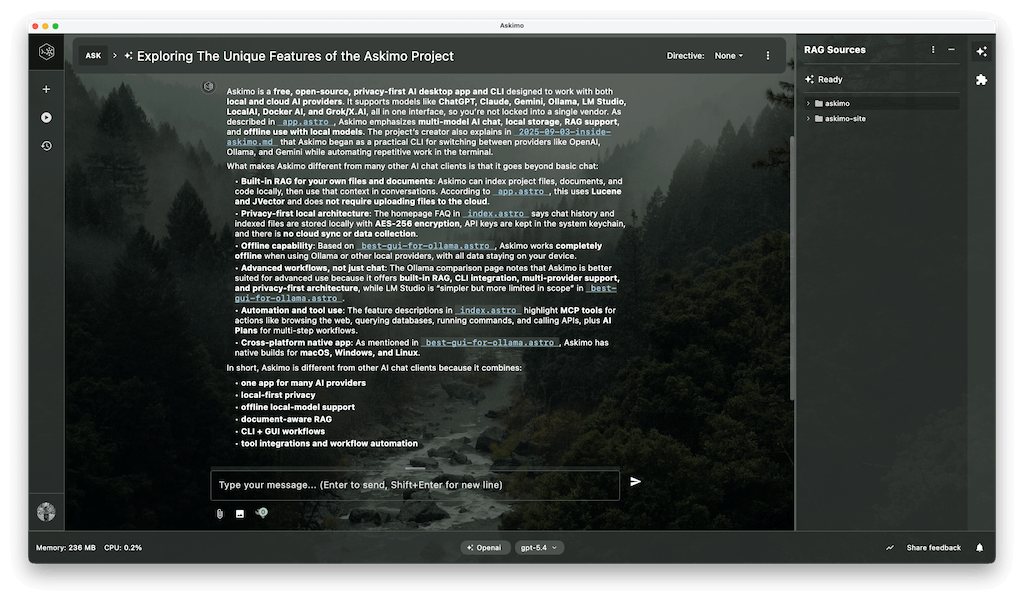

RAG:基于你的文档进行 AI 聊天

通过检索增强生成(RAG)将 AI 连接到你的文件和文档。AI 基于你的代码库、PDF 和文档上下文进行回答,而非通用答案。采用 JVector 与 Lucene 的混合搜索。

AI 聊天使用分析

跟踪各 AI 提供方的令牌消耗、API 成本和响应时间。通过检索指标监控 RAG 性能。查看详细的 AI 使用统计。所有分析数据均存储在本地。

备份与导出 AI 对话

导出所有 AI 对话、设置、RAG 索引和自定义模板。可在任意设备导入数据,在不同电脑之间迁移完整的 AI 聊天工作区而不丢失历史记录。

看看专业人士如何评价 Askimo 的 AI 桌面聊天体验。

"终于有一款桌面 AI 应用可以让我随心所欲地使用任何模型。在对话中途切换 OpenAI 和 Claude 正是我所需要的。"

Emily Chen

全栈开发工程师

"Askimo 非常快。即使通过 Ollama 使用本地模型,也依然轻量且响应迅速。这是我用过最好的 AI 桌面客户端。"

David Rodriguez

DevOps 工程师

"多语言支持让它成为我父母也能使用的第一款 AI 应用。隐私优先的架构对我们团队来说是巨大优势。"

Sarah Thompson

产品经理

"简洁的 UI 和高度的灵活性令人喜爱。它像一款真正的生产力工具,而不只是另一个 Electron 封装。RAG 支持非常出色。"

Alex Kumar

软件工程师

"我试过多款 AI 桌面客户端--Askimo 是最平衡、最稳定的一款。本地存储意味着我真正拥有自己的数据,没有厂商锁定。"

Michael Park

技术负责人

"在一个应用中使用多种 AI 模型彻底改变了工作流自动化。并排对比 Claude 与 OpenAI 的回答极具价值。"

Jessica Martinez

AI 研究员

支持 ChatGPT、Claude、Gemini、Ollama 及另外 4 种 AI 提供方

支持 OpenAI、Anthropic Claude、Google Gemini,以及通过 Ollama、LM Studio 和 LocalAI 运行的本地 AI 模型。在一个界面中切换 AI 提供方。

Askimo vs ChatGPT Desktop vs LM Studio vs Ollama GUI 对比

免费 AI 智能体桌面应用对比:Askimo、ChatGPT Desktop、LM Studio 与 Ollama GUI。比较本地 LLM 支持、MCP 客户端、AI 工作流自动化、多模型聊天、本地存储、RAG 与隐私特性。

| 功能 | Askimo | LM Studio | Ollama 桌面 GUI | ChatGPT Desktop |

|---|---|---|---|---|

| 使用多种 AI 模型(ChatGPT、Claude、Gemini) | | | | |

| 支持本地 AI 模型(Ollama、LM Studio) | | | | |

| 云端 AI 提供方(OpenAI、Claude、Gemini) | | | | |

| 原生桌面应用 | | | 视情况而定 | |

| 包含命令行界面(CLI) | | | | |

| AI 自动化与脚本 | | | | |

| 文档与代码的 RAG | 仅 CLI (桌面版即将推出) | | | |

| 搜索会话历史 | | | | |

| 收藏/标星 AI 对话 | | | | |

| 自定义 AI 提示模板 | | | | |

| 导出 AI 聊天历史 | | | 视情况而定 | |

| 私密的本地数据存储 | | | 视情况而定 | |

| 离线 AI 聊天历史 | | | 视情况而定 | |

| 离线运行(本地模型) | | | | |

谁在使用 Askimo?开发者、写作者、研究人员和企业团队

从使用 RAG 对代码库建立索引,到通过多步骤 Plans 运行 AI 工作流自动化、连接 MCP 工具,Askimo 将任何 AI 模型或本地 LLM 转化为完整的生产力工作流 - 完全在本地私密运行。

软件开发者与程序员

- ✦ 使用 RAG 对整个代码库建立索引,并对任意函数、模块或架构决策进行提问

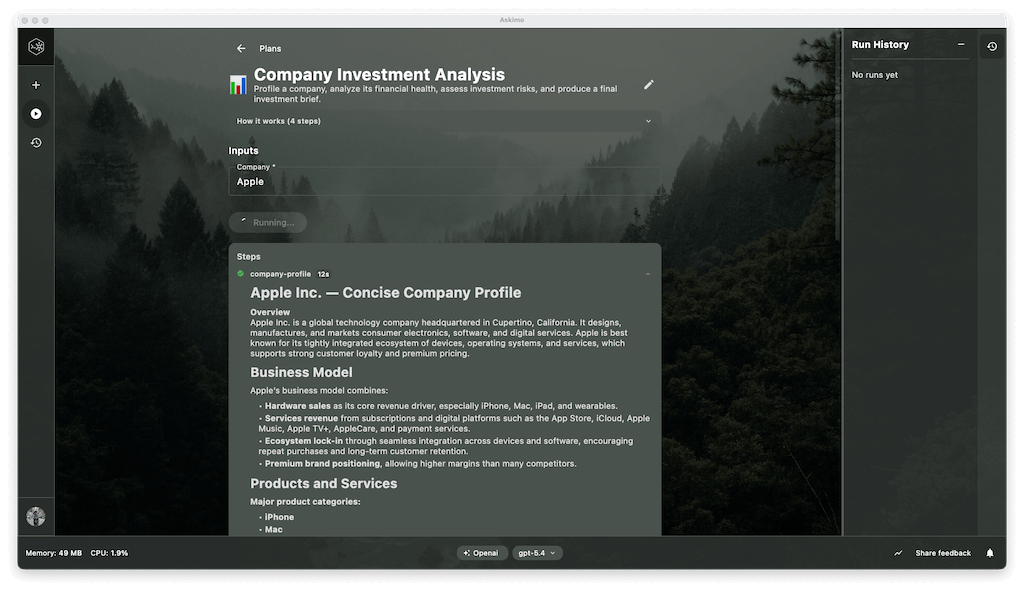

- ✦ 创建一个 AI 计划:分析 bug、提出修复方案、编写补丁并生成单元测试--全部在一次自动化运行中完成

- ✦ 连接 MCP 工具,在聊天中直接调用 API、查询数据库或触发 CI/CD 流水线

- ✦ 在安全的沙箱环境中即时运行 AI 生成的 Python 或 Bash 脚本,无需切换终端

内容写作者与文案人员

- ✦ 对品牌指南进行索引,使 AI 在每次会话中都能保持一致的语气进行写作

- ✦ 创建一个 AI 计划:研究主题、撰写文章,然后按顺序将其重新格式化为 Twitter 线程、新闻通讯和 LinkedIn 帖子

- ✦ 比较 Claude、GPT 和 Gemini 在同一主题上的不同处理方式,选择最佳方向

学术研究人员与学生

- ✦ 上传论文和笔记,并通过本地 RAG 索引对整个集合进行跨文档提问

- ✦ 运行一个多步骤计划:汇总参考文献、识别研究空白、起草文献综述并格式化引用--无需在步骤之间复制粘贴

- ✦ 让 AI 生成分析脚本,并在 Askimo 中安全运行,无需额外配置或终端切换

商业专业人士与顾问

- ✦ 对内部政策、合同和报告进行提问,所有内容均在本地索引,不会上传至云端

- ✦ 运行一个 AI 计划:通过 MCP 获取数据、分析绩效、识别风险并撰写执行摘要--一键即可完成演示准备

- ✦ 使用完全本地的 AI 模型处理机密文档,确保数据不会离开你的设备

关于 AI 桌面聊天应用的常见问题

关于在一个桌面应用中使用多种 AI 模型(ChatGPT、Claude、Gemini、Ollama)的常见问题。

我可以在一个桌面应用中使用 Claude、Gemini、Grok 等多个 AI 模型吗?

可以。Askimo 是一款免费开源桌面应用,让你在一个地方使用 ChatGPT、Claude、Gemini、Grok 和本地 LLM。可在对话中随时切换提供商,并通过 Plans 运行 AI 工作流。Askimo 支持任何提供商,所有数据本地存储,无需账户或订阅。

Askimo 是否支持 Mac 上的本地 LLM,包括 Apple Silicon?

是的。Askimo 是针对 macOS(包括 Apple Silicon Mx)优化的原生本地 LLM 桌面应用。通过 Ollama 或 LM Studio 连接任何本地模型 - Llama、Mistral、Phi、DeepSeek 等。一切在你的 Mac 上本地运行,无需联网,且无 Electron 开销,启动迅速。

Askimo 可以作为支持 MCP 工具的 AI 智能体桌面应用使用吗?

可以。Askimo 是内置 MCP 客户端的完整 AI 智能体桌面应用。连接任何 MCP 兼容服务器,让 AI 访问网络搜索、数据库、API、文件系统或自定义工具。智能体运行工具、获取结果并继续对话 - 一切尽在流畅的流程中。

Askimo 是否支持 AI 工作流自动化?

是的,通过 Plans 功能实现。Plans 允许你定义多步骤 AI 工作流,每个步骤有专注的角色 - 研究员、分析师、撰稿人,每个步骤的输出自动传入下一个步骤。填写表单,点击运行,即可获得完成的交付物。你可以用 YAML 创建自定义 Plans,也可以用中文描述工作流来自动生成。

我可以在一个桌面应用中同时使用 ChatGPT 和 Claude 吗?

可以!Askimo 是一款免费的桌面 AI 聊天应用,让你在统一界面中使用 ChatGPT、Claude、Gemini、Ollama 等 AI 模型。一键切换 AI 提供商,或并排比较响应。

我的 AI 聊天数据是本地存储还是云端存储?

所有 AI 对话、API 密钥和应用设置均经过加密并存储在你的电脑本地。Askimo 采用隐私优先架构,无云同步、无在线追踪、无数据收集。你对 AI 聊天历史和个人数据拥有 100% 的控制权。

使用这款 AI 桌面聊天应用需要 API 密钥吗?

对于云端 AI 提供方(OpenAI ChatGPT、Anthropic Claude、Google Gemini),需要你自己的 API 密钥,并会在本地安全加密存储。对于本地 AI 模型(Ollama、LM Studio、LocalAI),无需 API 密钥--只需安装本地 AI 软件并连接即可。

可以使用本地模型离线进行 AI 聊天吗?

可以!使用 Ollama、LM Studio 或 LocalAI 时,Askimo 可完全离线运行。无需互联网即可在你的电脑上运行 Llama 3、Mistral、DeepSeek 等开源模型。完整的聊天历史在离线状态下依然可访问。

这个应用中的 RAG(基于文档的 AI)是如何工作的?

Askimo 的 RAG(检索增强生成)功能使用 Lucene 与 JVector 在本地索引你的项目文件、文档和代码。与 AI 对话时,它会搜索索引内容,基于你自己的文件提供上下文相关的回答,而非通用互联网知识。无需将文件上传到云端。

该 AI 桌面聊天应用支持哪些操作系统?

Askimo 支持 Windows(7、10、11)、macOS(10.14+,包括 Apple Silicon Mx)以及 Linux(Ubuntu、Debian、Fedora、Arch)。可下载原生安装包:Mac 的 DMG、Windows 的 MSI、Linux 的 DEB,或适用于 Java 21+ 的通用 JAR。

我可以导出和备份 AI 对话吗?

可以。你可以导出单个 AI 对话或全部历史用于备份、文档或分享。Askimo 也支持导入聊天历史,方便在电脑之间迁移或从备份中恢复。

这款 AI 桌面聊天应用是免费的吗?有订阅费用吗?

Askimo 是 100% 免费且开源(GNU AGPLv3 许可证)。无订阅费、无付费墙、无需注册账号。你只需支付自己使用的 AI API 费用(OpenAI、Claude、Gemini)。通过 Ollama 使用的本地 AI 模型完全免费。

下载适用于 Windows、Mac 与 Linux 的免费 AI 桌面聊天应用

⭐ 永久免费 · 🚀 开源 · 💜 社区驱动的 AI 聊天应用