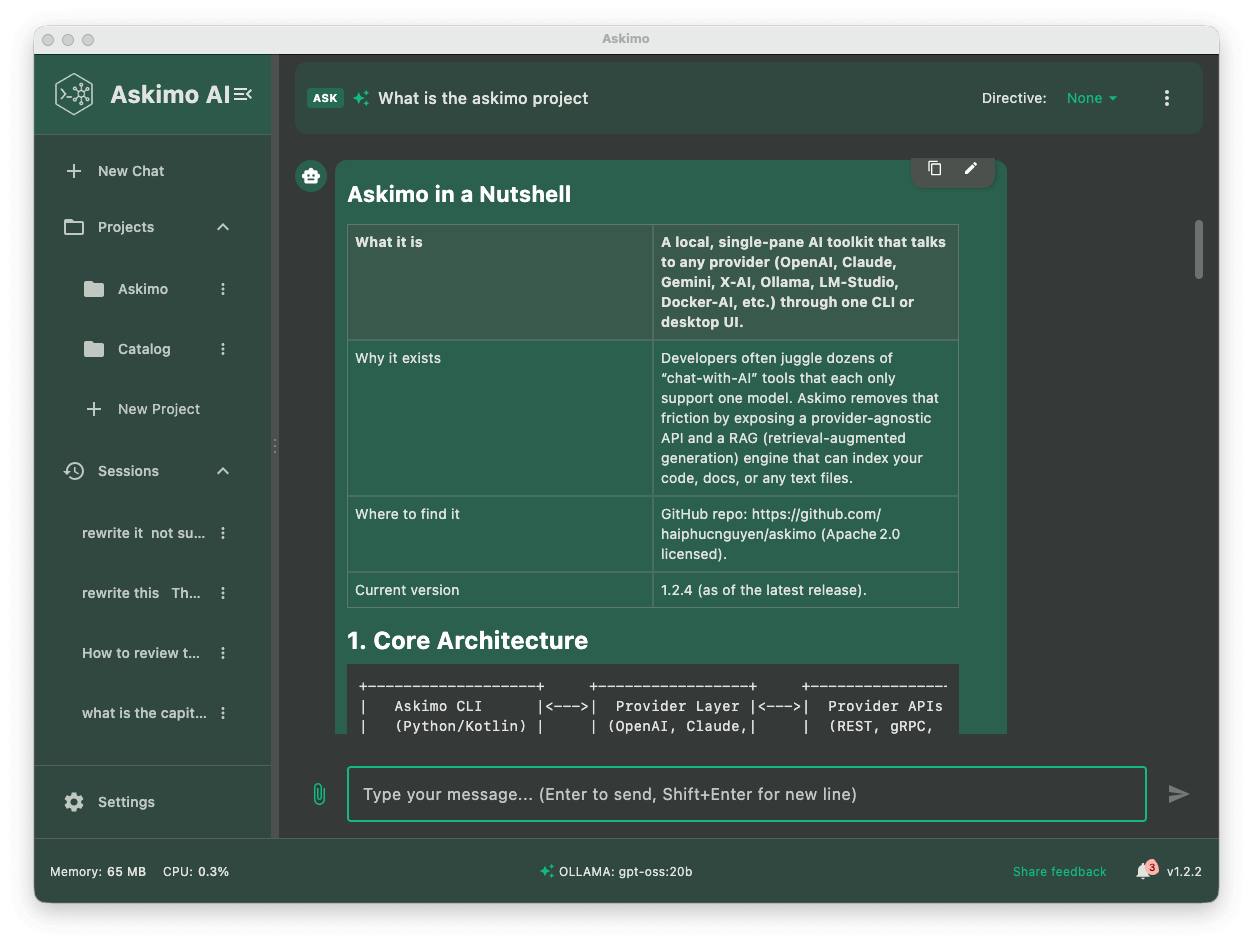

macOS、Windows、Linux でローカル AI モデルを実行するための Ollama デスクトップアプリ、Ollama GUI、Ollama クライアント、または高速な Ollama チャットインターフェースを探しているなら、本ガイドでは Askimo App を検討する価値のある選択肢として紹介します。Askimo は、Llama 3、Llama 3.1、Llama 3.2、Mistral、Phi 3、Gemma、そして数百種類の Ollama モデルをサポートするネイティブな Ollama デスクトップ体験を提供すると同時に、OpenAI、Claude、Gemini といったクラウドプロバイダーも統合されたインターフェースで利用できます。

TL;DR: Ollama をインストールし、Askimo App GUI をダウンロードし、Askimo を

http://localhost:11434に接続するよう設定し、好みの Ollama モデル(llama3、mistral、phi3、gemma)を選択すれば、完全に検索可能で整理・エクスポート可能なローカル AI チャットをすぐに開始できます。

CLI や Web UI の代わりに Ollama デスクトップ GUI を使う理由

Ollama のコマンドラインインターフェース(CLI)は素早いプロンプトには非常に強力ですが、Askimo のような専用の Ollama デスクトップアプリは、本格的な AI ワークフローに不可欠な生産性機能を追加します。

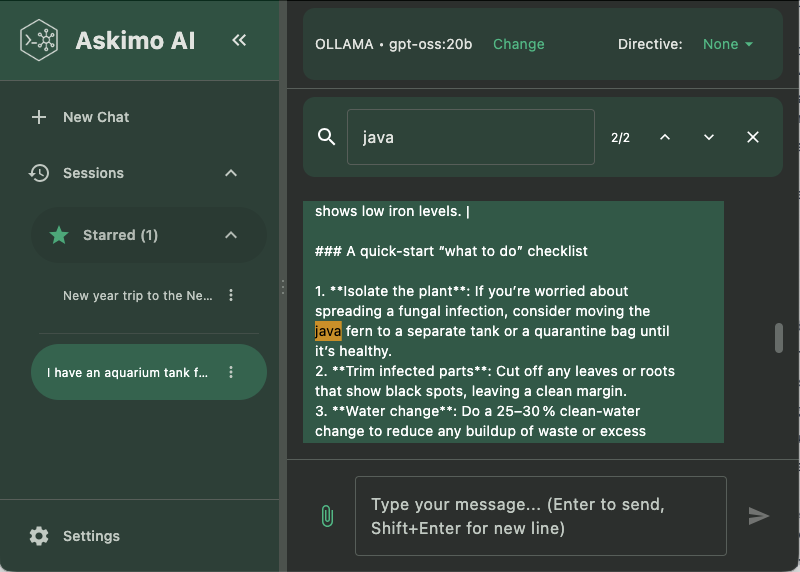

- すべての Ollama チャットセッションにわたる永続的な会話履歴

- チャット内全文検索 により、Ollama 会話内のメッセージを即座に検索可能

- 重要な Ollama 会話のスター付け・ピン留め

- Ollama チャットを Markdown、JSON、HTML にエクスポート(ドキュメント、メモ、チーム共有用)

- ローカル AI プロバイダーとクラウド AI プロバイダーのワンクリック切り替え

- ローカル Ollama モデルを使ったプロジェクト対応 RAG

- カスタムテーマ、キーボードショートカット、構造化されたワークフロー

- 大規模チャット向け Lazy Loading(スクロール時にのみ過去のメッセージを読み込み)

Askimo は、断片的なターミナルコマンドによるローカル Ollama モデルの実験を、再現性のあるプロフェッショナルなデスクトップワークフローへと変革します。

なぜ Askimo の Ollama デスクトップは Web UI より高速なのか

多くの「Ollama デスクトップ」アプリや Ollama Web UI は、会話全体を DOM にレンダリングします。Llama 3 や Mistral のようなローカルモデルで会話が数百、数千メッセージに増えると、メモリ使用量が急増し、スクロールのカクつきや入力遅延、描画の低下が発生します。

Askimo の Ollama デスクトップクライアントは異なるアプローチを取ります。Ollama ワークフローに最適化されたネイティブファーストかつリソース効率重視の設計により、チャット中はメッセージがストリーミングされ、古い履歴は仮想化されたまま保持されます。過去の Ollama メッセージは上にスクロールしたときにのみ読み込まれるため、長時間のリサーチや大規模なコーディングセッションでも常に滑らかなパフォーマンスを維持します。

Askimo Ollama Desktop と Terminal CLI / Web UI の比較

| ワークフロー機能 | Ollama Terminal のみ | 一般的な Ollama Web UI | Askimo Ollama Desktop |

|---|---|---|---|

| マルチプロバイダー対応 | 手動スクリプト | 通常は Ollama のみ | 組み込みプロバイダー切替 |

| チャット履歴 | 自動ログなし | 基本的 / ツール依存 | 整理・検索可能 |

| エクスポート | 手動コピー | ほぼなし | Markdown / JSON / HTML |

| 会話の整理 | 不可 | 限定的 | お気に入り + 構造化セッション |

| ローカルプライバシー | 完全ローカル | ツール依存 | ローカル AI + 任意のクラウド |

| クロスプラットフォーム | Linux / macOS / Windows | バラバラ | Linux / macOS / Windows |

ステップ 1:macOS、Windows、Linux に Ollama をインストール

Ollama は macOS、Windows、Linux 上でローカルに動作します。

-

macOS インストーラーをダウンロード: https://ollama.com/download/mac

-

Windows インストーラーをダウンロード: https://ollama.com/download/windows

-

Linux

curl -fsSL https://ollama.com/install.sh | shインストール確認:

ollama run llama3モデルがまだダウンロードされていない場合、Ollama が自動的に取得します。

ステップ 2:Askimo App(Ollama GUI)をインストール

Askimo App バイナリ:

アプリを起動し(アプリケーションフォルダ / スタートメニュー)、プロバイダー設定に進みます。

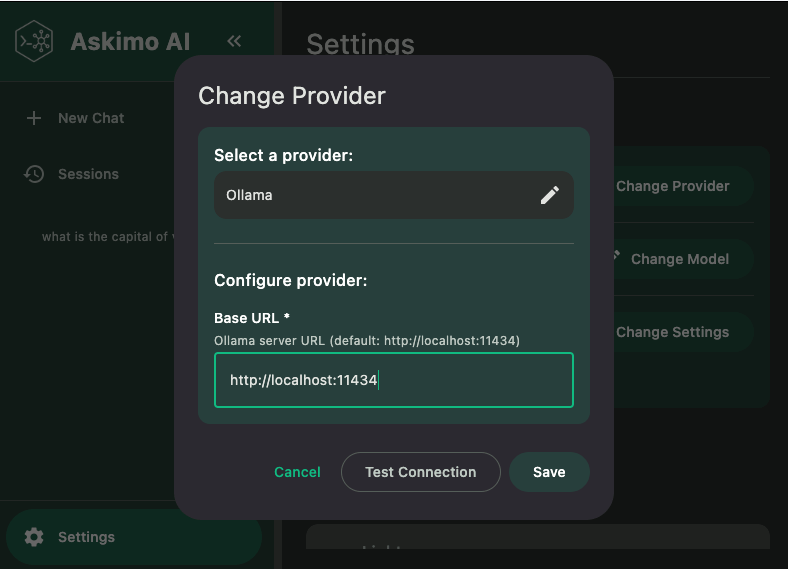

ステップ 3:Askimo App を Ollama サーバーに接続

Askimo はデフォルトの Ollama エンドポイントを自動検出します:

http://localhost:11434

- Askimo App を開く

- Settings → Providers に移動

- Ollama を選択

- エンドポイントが

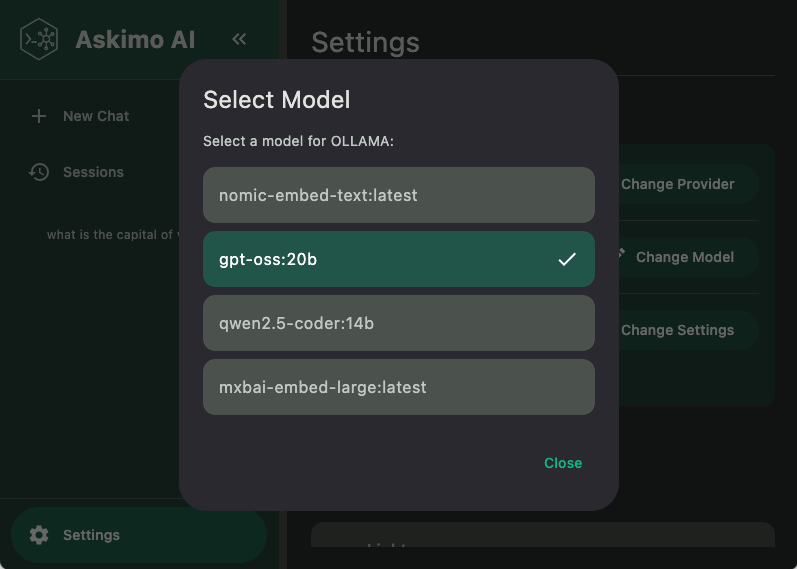

http://localhost:11434であることを確認 - モデルを選択(例:

llama3、mistral、phi3、gemma、gpt-oss:20bなど) - 保存してチャット開始

ターミナルコマンドを使わずに Ollama モデルを即座に切り替えられます。

Askimo Ollama Desktop アプリ機能の詳細

以下では、Askimo が単なる「Ollama ラッパー」以上である理由を詳しく説明します。

1. Ollama チャット向けパフォーマンスとリソース効率

- 古い Ollama メッセージの Lazy Loading(大規模チャット向け仮想化履歴)

- スムーズなインクリメンタル描画による Ollama 応答のストリーミング

- スレッド全体を再描画する Web ラッパーと比べた最小限の DOM 使用

- 数百ターンに及ぶ Ollama リサーチセッションでも効率的なメモリ使用

2. マルチプロバイダー & Ollama モデル管理

- ローカル AI プロバイダー(Ollama など)とクラウド(OpenAI、Claude、Gemini)の即時切り替え

- 高速なモデルセレクター(例:

llama3→mistral) - ローカル Ollama の自動エンドポイント検出

3. Ollama 会話の検索とナレッジ整理

- チャット内全文検索で任意のメッセージを検索

- 長い会話でも素早く情報を見つけられるキーワードフィルタ

- 重要な Ollama スレッドのスター・ピン留め

4. Ollama セッション向けチャットユーティリティ

- ワンクリックで Markdown、JSON、HTML にエクスポート

- ドキュメント / PRD / 仕様書向けに共有可能な Ollama トランスクリプト

- 重要なセッションのスター付け、解除、並び替え

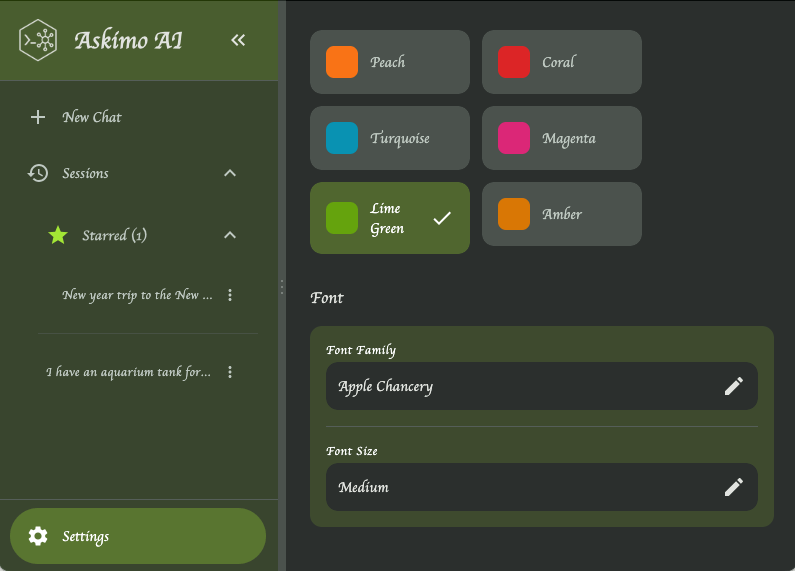

5. Ollama Desktop 向け UI、パーソナライズ、アクセシビリティ

- ライト / ダークテーマ(再読み込み不要)

- フォントカスタマイズ(長時間セッション向け可読性調整)

- 新規チャット、プロバイダー切替、検索、エクスポート用ショートカット

- ストリーミング中でも安定したスクロールとレイアウト

6. Ollama におけるプライバシー重視・ローカルファーストワークフロー

- ローカル AI プロバイダー(Ollama)使用時、モデル応答は外部に送信されない

- クラウドは明示的に選択した場合のみ使用

- エクスポートは共有しない限りローカルに保持

- コンテンツのサイレント同期や分析なし

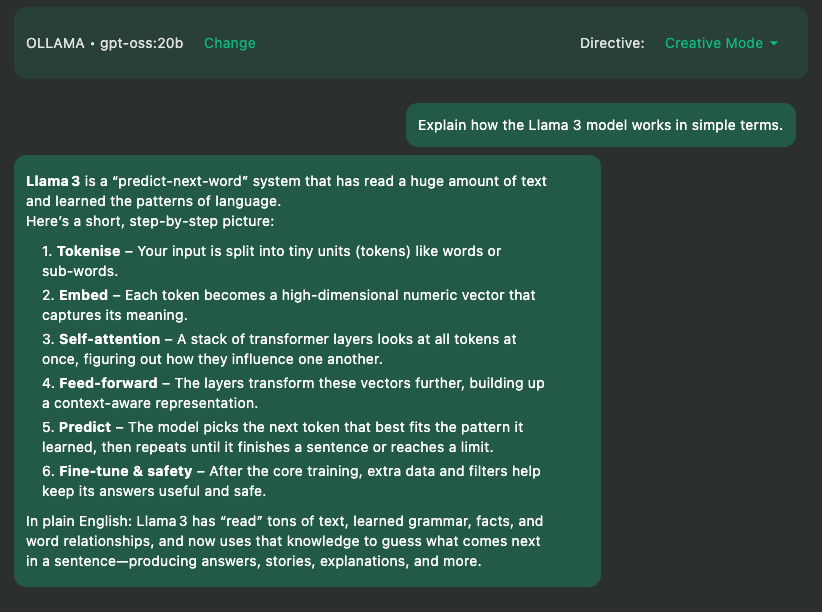

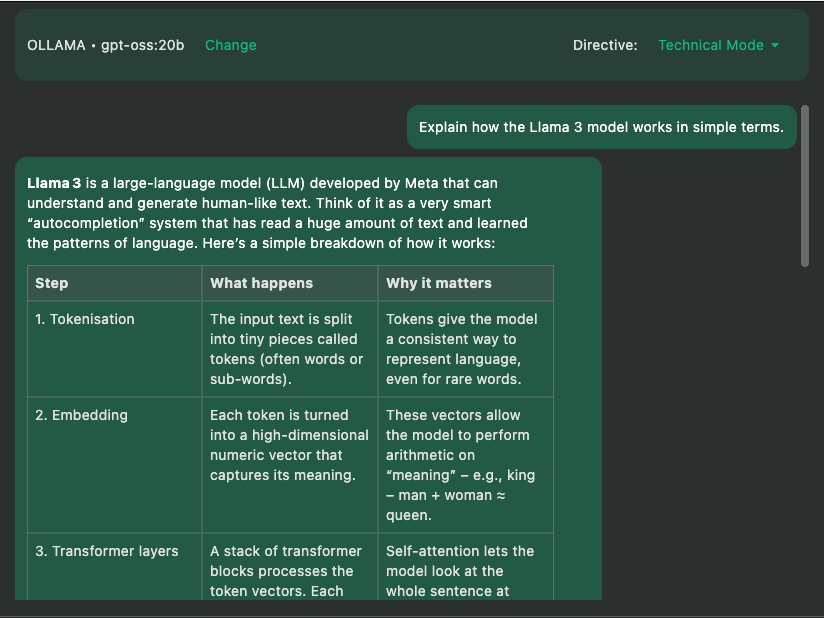

7. Ollama モデル向け Askimo のカスタムディレクティブ

カスタムディレクティブを使うと、ローカル AI モデル 実行時の AI の振る舞いを定義できます。毎回長い指示を入力する代わりに、一度設定すればすべての会話に自動適用されます。

-

ローカルモデルの一貫した挙動 Llama、Mistral、Gemma、Phi-3 を好みのトーンや詳細度に揃えられます。

-

繰り返し作業向けプリセット コーディング、デバッグ、論文要約、ドキュメント生成などに最適。

-

プロンプトの煩雑さを排除 ワンクリックでディレクティブ切替。

-

長時間ローカル推論向け最適化 ノイズを減らし、集中したセッションを実現。

8. ローカル Ollama モデルによるプロジェクト対応 RAG

Askimo の RAG(検索拡張生成)機能を使うと、プロジェクト全体と対話できます。プロンプトに手動でコピーする必要はありません。

-

プロジェクトに基づくコンテキスト会話 Llama 3、Mistral などで実ファイルに基づく回答を取得。

-

自動コンテキスト取得 Askimo がファイルをインデックスし、関連部分を自動注入。

-

プライバシー重視のローカル RAG ファイルは一切外部に送信されません。

-

複数ファイル理解 プロジェクト全体を横断した質問が可能。

使用例:

- ソフトウェア: 「認証フローの仕組みを説明して」

- ドキュメント: 「API ドキュメントの変更点を要約して」

- 研究: 「第 3 章で使った手法は?」

- 執筆: 「全章に共通するテーマは?」

- 技術仕様: 「システム要件は?」

他の Ollama GUI と比較した Askimo 独自の機能

- ローカル + ホスト型を統合したマルチプロバイダーチャット

- 検索・お気に入り・エクスポートによる構造化管理

- macOS / Windows インストーラー付きネイティブデスクトップ体験

- 開発者・研究向けに最適化された複数エクスポート形式

- ローカル Ollama モデルを使ったプロジェクト対応 RAG

- CLI と Desktop を共有する拡張可能なアーキテクチャ

他の Ollama インターフェースは単なるチャット画面に留まります。 Askimo は、長期的な生産性と構造化ナレッジを重視して設計されています。

よくある質問(FAQ)

Ollama に公式デスクトップ GUI はありますか?

いいえ。Ollama は CLI とローカル API のみを提供しています。Askimo App は Ollama に接続するフル機能のデスクトップクライアントです。

macOS や Windows に最適な Ollama デスクトップアプリは?

Askimo は、マルチプロバイダー切替、検索、スター、エクスポート、洗練された UX を提供します。

Ollama とクラウドモデルを併用できますか?

はい。Askimo ではローカル AI(Ollama)と OpenAI、Claude、Gemini をワンクリックで切り替えられます。

Askimo + Ollama 使用時、データは安全ですか?

はい。ローカル推論はすべて Ollama 経由で行われ、Askimo はローカルエンドポイントとのみ通信します。データ保護についてはこちら

Ollama の応答が遅いのはなぜ?

大規模モデルは高性能ハードウェアが必要です。mistral や phi3 などの小型モデルを使用してください。

Askimo で Ollama モデルを変更する方法は?

Providers → Ollama でモデル名を変更します。

ollama pull mistralAskimo + Ollama をオフラインで使えますか?

はい。モデルをダウンロード後は完全にオフラインで動作します。

Ollama を使ってプロジェクトと対話できますか?

はい。Askimo の RAG 機能により、コード、ドキュメント、研究資料などとローカルで安全に対話できます。

トラブルシューティング

モデルが応答しない

ollama list空の場合:

ollama run mistralエンドポイントに接続できない

ポート 11434 が有効か確認してください。

応答が遅い

小さいモデルを使うか、他の重いアプリを終了してください。

モデルが見つからない

ollama pull phi3Askimo と他の Ollama デスクトップアプリの比較

Askimo vs Open WebUI

- Askimo: ネイティブデスクトップ、最適化されたパフォーマンス

- Open WebUI: Docker 必須のブラウザ UI

- 強み: マルチプロバイダー + RAG

Askimo vs Ollama CLI

- Askimo: 履歴、検索、エクスポート、RAG

- CLI: 単純な入出力のみ

Askimo vs 一般的な Ollama Web UI

- Askimo: Lazy Loading による高速性能

- Web UI: 長文で遅延

2025 年にローカルで Llama 3、Mistral、Phi-3、Gemma を使うなら、Askimo は包括的な Ollama デスクトップ体験を提供します。

最後に

Askimo は Ollama をスピード、構造、摩擦ゼロでデスクトップにもたらします。 ローカルモデルはプライベートに保たれ、会話は整理され、プロンプトは再利用可能な知識になります。

Askimo を今すぐ試す: 👉 https://askimo.chat