Si usas solo un modelo de IA para todo, estás dejando rendimiento, privacidad y dinero sobre la mesa.

ChatGPT, Claude, Gemini y Ollama tienen fortalezas distintas. Claude escribe mejor código. Gemini maneja imágenes. Ollama corre localmente gratis sin que ningún dato salga de tu máquina. El flujo de trabajo más inteligente no es elegir uno, sino usar el correcto para cada tarea, todo en la misma conversación.

Esta guía explica exactamente por qué, y muestra cómo Askimo - una app de IA de escritorio gratuita y open source - lo hace sin esfuerzo.

ChatGPT vs Claude vs Gemini vs Ollama: ¿Cuál modelo de IA es el mejor?

La respuesta honesta: ninguno. Cada uno domina en diferentes áreas.

| Modelo | Mejor para | Privacidad | Costo |

|---|---|---|---|

| Claude (Anthropic) | Código, documentos largos, instrucciones detalladas | Nube | Pago por token |

| ChatGPT (OpenAI) | Tareas generales, escritura creativa, salida estructurada | Nube | Pago por token |

| Gemini (Google) | Imágenes, multimodal, datos en tiempo real | Nube | Pago por token |

| Ollama / LM Studio | Datos privados, uso offline, costo cero | Local ✅ | Gratis ✅ |

| LocalAI / Docker AI | Flujos de trabajo empresariales autoalojados | Local ✅ | Gratis ✅ |

Claude (Anthropic) destaca en:

- Generación, refactorización y depuración de código

- Razonamiento complejo de múltiples pasos

- Contenido de formato largo con matices y estructura

- Seguir instrucciones detalladas y por capas con precisión

ChatGPT (OpenAI) es fuerte en:

- Conocimiento general y conversación natural

- Escritura creativa, lluvia de ideas e ideación

- Análisis de negocios y salida JSON estructurada

- Cobertura amplia de tareas en distintos dominios

Gemini (Google) se destaca en:

- Comprensión multimodal - texto, imágenes, video y audio

- Información en tiempo real e integración con Google Search

- Análisis de documentos y gráficos

- Tareas de razonamiento visual

Ollama, LM Studio, LocalAI (modelos locales) ofrecen:

- Privacidad total - tus datos nunca salen de tu máquina

- Cero costos de API - ejecuta Llama, Mistral, Phi y más de 100 modelos gratis

- Funcionalidad offline completa

- Sin límites de uso ni limitación de velocidad

Con todos estos en una app de IA de escritorio, eliges la herramienta correcta por tarea en lugar de forzar un modelo a hacerlo todo.

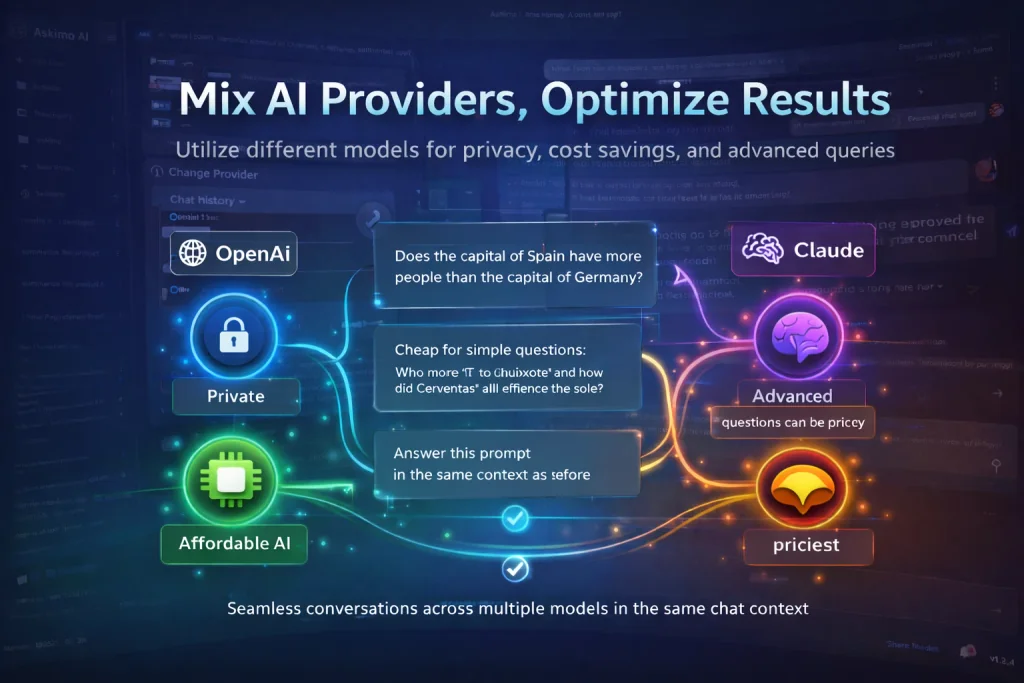

Privacidad: Enruta los datos sensibles a modelos de IA locales

No toda conversación debería ir a la nube.

Al trabajar con código propietario, registros financieros, datos médicos, documentos legales o información empresarial confidencial, enviar ese contenido a OpenAI o Google conlleva riesgos reales, desde políticas de retención de datos hasta el entrenamiento de modelos con tus entradas.

Los modelos de IA locales como Ollama eliminan ese riesgo por completo. Tus datos permanecen en tu máquina. Sin servidores de terceros. Sin políticas de retención. Sin necesidad de internet.

Una app de IA de escritorio con soporte multi-proveedor te permite:

- Usar Claude o ChatGPT para trabajo general no sensible

- Cambiar a Ollama o LocalAI en el momento en que la conversación se vuelve confidencial

- Hacer ambas cosas en la misma sesión de chat sin perder el contexto

Esto es especialmente valioso para:

- Desarrolladores trabajando en bases de código privadas o sin publicar

- Analistas de negocio manejando modelos financieros sensibles

- Profesionales de salud y derecho sujetos a requisitos de cumplimiento

- Cualquiera que se tome en serio la soberanía de datos

Optimización de costos: Deja de pagar tarifas premium por tareas simples

Los costos de API de IA se acumulan rápido. Usar los mejores modelos de nube para cada consulta, incluso las simples, suma cientos de dólares al mes a escala.

La solución es el enrutamiento:

| Tipo de tarea | Ejemplo | Modelo recomendado |

|---|---|---|

| Búsqueda simple | ”¿Cuál es la capital de Francia?” | Local (gratis) |

| Conversión de formato | ”Convierte esta fecha a ISO 8601” | Local (gratis) |

| Resumen de párrafo | ”Resume esto en 2 oraciones” | Local (gratis) |

| Generación de código | ”Refactoriza esta clase usando principios SOLID” | Claude |

| Análisis de datos | ”Encuentra patrones en este conjunto de datos financieros” | Gemini |

| Escritura técnica | ”Escribe una especificación para esta función” | Claude |

Con los modelos locales manejando la carga simple, gastas el presupuesto premium de API solo donde realmente importa. La mayoría de los equipos puede reducir su gasto en API de IA entre un 40-70% con este enfoque sin ninguna caída en la calidad del resultado.

Cambia modelos de IA en medio de una conversación sin perder el contexto

Esta es la capacidad que cambia cómo la gente trabaja con IA.

En una sola conversación de Askimo puedes:

- Comenzar con ChatGPT para hacer lluvia de ideas sobre una función

- Cambiar a Claude para escribir el plan de implementación y el código

- Bajar a Ollama (local) para procesar un archivo de configuración sensible o una clave API

- Saltar a Gemini para analizar una captura de pantalla o un diagrama de arquitectura

La misma sesión. El mismo historial. Cero copiar y pegar entre herramientas.

No te repites, no pierdes el hilo ni mantienes cinco pestañas del navegador. La conversación fluye naturalmente y el modelo correcto maneja cada parte del trabajo.

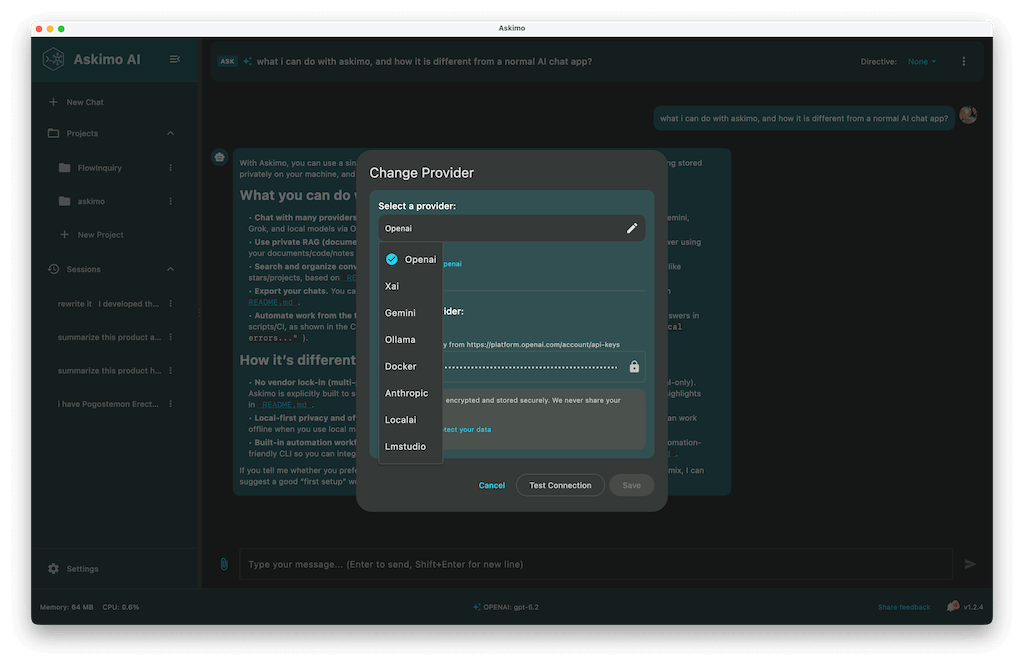

Askimo: App de IA de escritorio gratuita para ChatGPT, Claude, Gemini y Ollama

Askimo es una app de IA de escritorio gratuita y open source construida específicamente para flujos de trabajo multi-proveedor. Una interfaz para cada modelo.

Proveedores compatibles:

- OpenAI (últimos modelos GPT)

- Anthropic (últimos modelos Claude)

- Google (últimos modelos Gemini)

- Ollama (Llama, Mistral, Phi, CodeLlama y más de 100 modelos locales)

- LM Studio, LocalAI, Docker AI (configuraciones autoalojadas y empresariales)

- Grok (xAI)

Funciones principales

Búsqueda de texto completo en todas las conversaciones Cada mensaje de cada modelo se indexa localmente. Encuentra cualquier insight, fragmento de código o decisión de hace semanas en segundos.

RAG - Chatea con tus propios documentos Indexa PDFs, repositorios de código, wikis internas o cualquier colección de documentos. Haz preguntas y obtén respuestas fundamentadas en tus datos reales, no alucinadas de los pesos de entrenamiento. Ver RAG en acción ->

Planes de IA - Flujos de trabajo automatizados de múltiples pasos Encadena prompts entre modelos en pipelines automatizados. Cada paso pasa su resultado al siguiente: investigar, escribir, revisar, exportar. Sin copiar y pegar manualmente entre pasos. Ver Planes de IA ->

Integración de herramientas MCP Conéctate a GitHub, bases de datos, archivos locales y APIs externas directamente desde el chat mediante el Model Context Protocol. Guía de integración MCP ->

Script Runner Ejecuta scripts Python, Bash o Node generados por IA en un entorno sandbox sin salir de la app.

Personalización visual completa Temas, fuentes, iconos personalizados, soporte para monitores 4K/8K.

Quienes más se benefician

Desarrolladores - Claude para código, GPT para documentación, Ollama para repos privados, Gemini para diagramas. Todo en un lugar, todo buscable.

Analistas de negocio - Gemini para gráficos financieros, OpenAI para resúmenes, Ollama para modelos confidenciales.

Investigadores - RAG en toda la biblioteca de papers, comparación multi-modelo, capacidad offline.

Empresarios - Modelos más baratos para tareas rutinarias, modelos premium para estrategia, privacidad total para documentos sensibles.

El argumento contra usar un solo modelo de IA

La IA evoluciona mensualmente. Nuevos modelos llegan con nuevas fortalezas y nuevos precios. Atarse a una sola plataforma significa:

- Perderse capacidades de vanguardia en el momento en que llega un modelo mejor

- Pagar tarifas premium incluso por tareas que un modelo local gratuito maneja igual de bien

- No tener alternativa cuando un proveedor sufre una interrupción o te limita la velocidad

- No tener opción de privacidad cuando el trabajo lo requiere

Una app de IA de escritorio multi-proveedor te da la libertad de adaptarte conforme cambia el panorama, sin cambiar tu flujo de trabajo ni migrar el historial de conversaciones.

Preguntas frecuentes

¿Puedo cambiar de modelo de IA en medio de una conversación? Sí. Askimo te permite cambiar el modelo activo en cualquier punto de una conversación. El historial completo del chat se pasa al nuevo modelo para que continúe exactamente donde el anterior se quedó.

¿Necesito una clave API para cada proveedor? Necesitas claves API para proveedores en la nube (OpenAI, Anthropic, Google). Los modelos locales a través de Ollama o LM Studio no requieren clave API, se ejecutan completamente en tu máquina.

¿Askimo es realmente gratuito? Sí. Askimo es gratuito y open source. Solo pagas el uso de API en la nube a las tarifas estándar del proveedor. Los modelos locales (Ollama, LM Studio, LocalAI) no tienen ningún costo.

¿Cómo protege Askimo mis claves API? Las claves API se almacenan en el llavero del sistema operativo: macOS Keychain, Windows Credential Manager o Linux Secret Service. Nunca se escriben en disco en texto plano.

¿Qué modelo local debería usar con Ollama? Para tareas generales: Llama o Mistral. Para código: CodeLlama o DeepSeek Coder. Para máquinas con poca memoria: Phi. Todos son gratuitos para descargar y ejecutar mediante Ollama.

¿Funciona Askimo sin conexión? Sí, para modelos locales. Las conversaciones con Ollama, LM Studio y LocalAI funcionan sin conexión a internet. Los proveedores en la nube requieren una conexión activa.

Empieza ahora - Gratis en macOS, Windows y Linux

Descarga Askimo y empieza a usar ChatGPT, Claude, Gemini y Ollama juntos en una sola app. Sin cuenta requerida. Sin tarjeta de crédito.

- ✅ Gratis y open source

- ✅ macOS, Windows, Linux

- ✅ Modelos en la nube y locales

- ✅ Búsqueda, RAG, Planes de IA, herramientas MCP integradas

O prueba Askimo CLI para flujos de trabajo en terminal y automatización.

⭐ Dale una estrella a Askimo en GitHub para seguir el desarrollo y ayudar a dar forma a lo que se construye a continuación.