Se você usa apenas um modelo de IA para tudo, está deixando desempenho, privacidade e dinheiro na mesa.

ChatGPT, Claude, Gemini e Ollama têm pontos fortes distintos. Claude escreve código melhor. Gemini lida com imagens. Ollama roda localmente de graça sem que nenhum dado saia da sua máquina. O fluxo de trabalho mais inteligente não é escolher um, mas usar o certo para cada tarefa, tudo na mesma conversa.

Este guia explica exatamente o porquê, e mostra como o Askimo - um app de IA para desktop gratuito e open source - torna isso fácil.

ChatGPT vs Claude vs Gemini vs Ollama: Qual modelo de IA é o melhor?

A resposta honesta: nenhum. Cada um domina em áreas diferentes.

| Modelo | Melhor para | Privacidade | Custo |

|---|---|---|---|

| Claude (Anthropic) | Código, documentos longos, instruções detalhadas | Nuvem | Pagamento por token |

| ChatGPT (OpenAI) | Tarefas gerais, escrita criativa, saída estruturada | Nuvem | Pagamento por token |

| Gemini (Google) | Imagens, multimodal, dados em tempo real | Nuvem | Pagamento por token |

| Ollama / LM Studio | Dados privados, uso offline, custo zero | Local ✅ | Grátis ✅ |

| LocalAI / Docker AI | Fluxos de trabalho empresariais auto-hospedados | Local ✅ | Grátis ✅ |

Claude (Anthropic) se destaca em:

- Geração, refatoração e depuração de código

- Raciocínio complexo de múltiplas etapas

- Conteúdo longo com nuances e estrutura

- Seguir instruções detalhadas e em camadas com precisão

ChatGPT (OpenAI) é forte em:

- Conhecimento geral e conversa natural

- Escrita criativa, brainstorming e ideação

- Análise de negócios e saída JSON estruturada

- Ampla cobertura de tarefas em diferentes domínios

Gemini (Google) se destaca em:

- Compreensão multimodal - texto, imagens, vídeo e áudio

- Informações em tempo real e integração com Google Search

- Análise de documentos e gráficos

- Tarefas de raciocínio visual

Ollama, LM Studio, LocalAI (modelos locais) oferecem:

- Privacidade total - seus dados nunca saem da sua máquina

- Zero custos de API - execute Llama, Mistral, Phi e mais de 100 modelos de graça

- Funcionalidade offline completa

- Sem limites de uso ou limitação de velocidade

Com todos estes em um app de IA para desktop, você escolhe a ferramenta certa por tarefa em vez de forçar um modelo a fazer tudo.

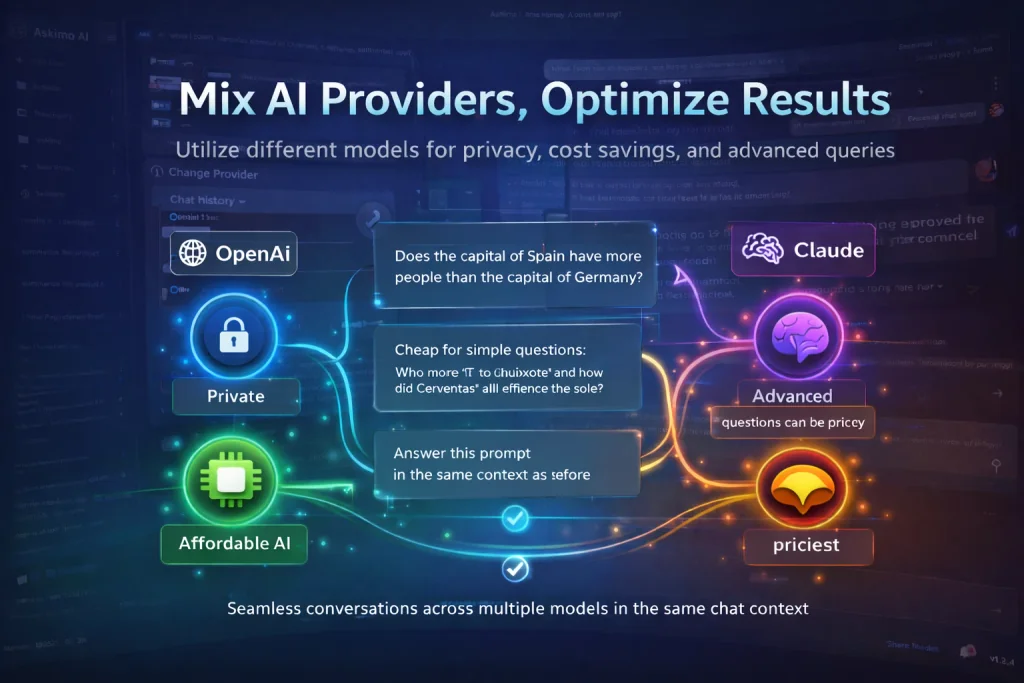

Privacidade: Roteie dados sensíveis para modelos de IA locais

Nem toda conversa deveria ir para a nuvem.

Ao trabalhar com código proprietário, registros financeiros, dados médicos, documentos jurídicos ou informações empresariais confidenciais, enviar esse conteúdo para OpenAI ou Google traz riscos reais, das políticas de retenção de dados ao treinamento de modelos com suas entradas.

Modelos de IA locais como Ollama eliminam esse risco completamente. Seus dados ficam na sua máquina. Sem servidores de terceiros. Sem políticas de retenção. Sem necessidade de internet.

Um app de IA para desktop com suporte multi-provedor permite:

- Usar Claude ou ChatGPT para trabalho geral não sensível

- Mudar para Ollama ou LocalAI no momento em que a conversa se torna confidencial

- Fazer ambos na mesma sessão de chat sem perder o contexto

Isso é especialmente valioso para:

- Desenvolvedores trabalhando em bases de código privadas ou não publicadas

- Analistas de negócios lidando com modelos financeiros sensíveis

- Profissionais de saúde e jurídicos sujeitos a requisitos de conformidade

- Qualquer pessoa que leva a sério a soberania dos dados

Otimização de custos: Pare de pagar tarifas premium por tarefas simples

Os custos de API de IA se acumulam rápido. Usar os melhores modelos de nuvem para cada consulta, mesmo as simples, soma centenas de reais por mês em escala.

A solução é o roteamento:

| Tipo de tarefa | Exemplo | Modelo recomendado |

|---|---|---|

| Pesquisa simples | ”Qual é a capital da França?” | Local (grátis) |

| Conversão de formato | ”Converta esta data para ISO 8601” | Local (grátis) |

| Resumo de parágrafo | ”Resuma isto em 2 frases” | Local (grátis) |

| Geração de código | ”Refatore esta classe usando princípios SOLID” | Claude |

| Análise de dados | ”Encontre padrões neste conjunto de dados financeiros” | Gemini |

| Documentação técnica | ”Escreva uma especificação para esta funcionalidade” | Claude |

Com modelos locais lidando com a carga simples, você gasta o orçamento premium de API apenas onde realmente faz diferença. A maioria das equipes consegue reduzir seus gastos com API de IA em 40-70% com esta abordagem sem nenhuma queda na qualidade do resultado.

Troque modelos de IA no meio de uma conversa sem perder o contexto

Esta é a capacidade que muda como as pessoas trabalham com IA.

Em uma única conversa do Askimo você pode:

- Começar com ChatGPT para fazer brainstorming de uma ideia de funcionalidade

- Mudar para Claude para escrever o plano de implementação e o código

- Ir para Ollama (local) para processar um arquivo de configuração sensível ou uma chave de API

- Pular para Gemini para analisar uma captura de tela ou diagrama de arquitetura

Mesma sessão. Mesmo histórico. Zero copiar e colar entre ferramentas.

Você não se repete, não perde o fio, não gerencia cinco abas do navegador. A conversa flui naturalmente e o modelo certo lida com cada parte do trabalho.

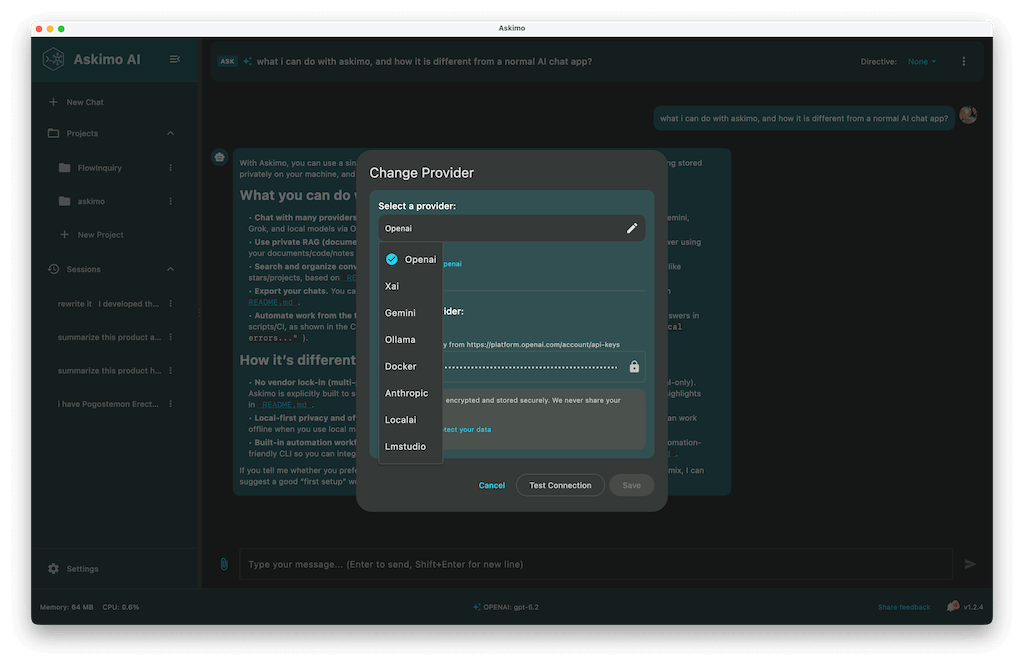

Askimo: App de IA gratuito para ChatGPT, Claude, Gemini & Ollama

O Askimo é um app de IA para desktop gratuito e open source construído especificamente para fluxos de trabalho multi-provedor. Uma interface para cada modelo.

Provedores suportados:

- OpenAI (últimos modelos GPT)

- Anthropic (últimos modelos Claude)

- Google (últimos modelos Gemini)

- Ollama (Llama, Mistral, Phi, CodeLlama e mais de 100 modelos locais)

- LM Studio, LocalAI, Docker AI (configurações auto-hospedadas e empresariais)

- Grok (xAI)

Funcionalidades principais

Busca de texto completo em todas as conversas Cada mensagem de cada modelo é indexada localmente. Encontre qualquer insight, trecho de código ou decisão de semanas atrás em segundos.

RAG - Converse com seus próprios documentos Indexe PDFs, repositórios de código, wikis internas ou qualquer coleção de documentos. Faça perguntas e obtenha respostas baseadas em seus dados reais, não em alucinações dos pesos de treinamento. Ver RAG em ação ->

Planos de IA - Fluxos de trabalho automatizados de múltiplos passos Encadeie prompts entre modelos em pipelines automatizados. Cada etapa passa sua saída para a próxima - pesquisar, escrever, revisar, exportar. Sem copiar e colar manual entre etapas. Ver Planos de IA ->

Integração de ferramentas MCP Conecte-se ao GitHub, bancos de dados, arquivos locais e APIs externas diretamente do chat via Model Context Protocol. Guia de integração MCP ->

Script Runner Execute scripts Python, Bash ou Node gerados por IA em um ambiente sandbox sem sair do app.

Personalização visual completa Temas, fontes, ícones personalizados, suporte a monitores 4K/8K.

Quem mais se beneficia

Desenvolvedores - Claude para código, GPT para documentação, Ollama para repos privados, Gemini para diagramas. Tudo em um lugar, tudo pesquisável.

Analistas de negócios - Gemini para gráficos financeiros, OpenAI para resumos, Ollama para modelos confidenciais.

Pesquisadores - RAG em toda a biblioteca de artigos, comparação multi-modelo, capacidade offline.

Empresários - Modelos mais baratos para tarefas rotineiras, modelos premium para estratégia, privacidade total para documentos sensíveis.

O argumento contra usar apenas um modelo de IA

A IA evolui mensalmente. Novos modelos chegam com novos pontos fortes e novos preços. Ficar preso a uma única plataforma significa:

- Perder capacidades de ponta no momento em que um modelo melhor chega

- Pagar tarifas premium mesmo por tarefas que um modelo local gratuito resolve igualmente bem

- Sem alternativa quando um provedor tem interrupção ou te limita a velocidade

- Sem opção de privacidade quando o trabalho exige

Um app de IA para desktop multi-provedor dá a você a liberdade de se adaptar conforme o cenário muda, sem alterar seu fluxo de trabalho nem migrar o histórico de conversas.

Perguntas frequentes

Posso trocar de modelo de IA no meio de uma conversa? Sim. O Askimo permite mudar o modelo ativo em qualquer ponto de uma conversa. O histórico completo do chat é passado para o novo modelo para que ele continue exatamente de onde o anterior parou.

Preciso de uma chave de API para cada provedor? Você precisa de chaves de API para provedores em nuvem (OpenAI, Anthropic, Google). Modelos locais via Ollama ou LM Studio não requerem chave de API - eles rodam completamente na sua máquina.

O Askimo é realmente gratuito? Sim. O Askimo é gratuito e open source. Você só paga pelo uso de API em nuvem nas tarifas padrão do provedor. Modelos locais (Ollama, LM Studio, LocalAI) não têm nenhum custo.

Como o Askimo protege minhas chaves de API? As chaves de API são armazenadas no chaveiro do sistema operacional - macOS Keychain, Windows Credential Manager ou Linux Secret Service. Elas nunca são gravadas no disco em texto simples.

Qual modelo local devo usar com o Ollama? Para tarefas gerais: Llama ou Mistral. Para código: CodeLlama ou DeepSeek Coder. Para máquinas com pouca memória: Phi. Todos são gratuitos para baixar e executar via Ollama.

O Askimo funciona offline? Sim, para modelos locais. Conversas com Ollama, LM Studio e LocalAI funcionam sem conexão com a internet. Provedores em nuvem requerem uma conexão ativa.

Comece agora - Grátis no macOS, Windows e Linux

Baixe o Askimo e comece a usar ChatGPT, Claude, Gemini e Ollama juntos em um único app. Sem necessidade de conta. Sem cartão de crédito.

- ✅ Gratuito e open source

- ✅ macOS, Windows, Linux

- ✅ Modelos em nuvem e locais

- ✅ Busca, RAG, Planos de IA, ferramentas MCP integradas

Ou experimente o Askimo CLI para fluxos de trabalho em terminal e automação.

⭐ Dê uma estrela ao Askimo no GitHub para acompanhar o desenvolvimento e ajudar a moldar o que será construído em seguida.