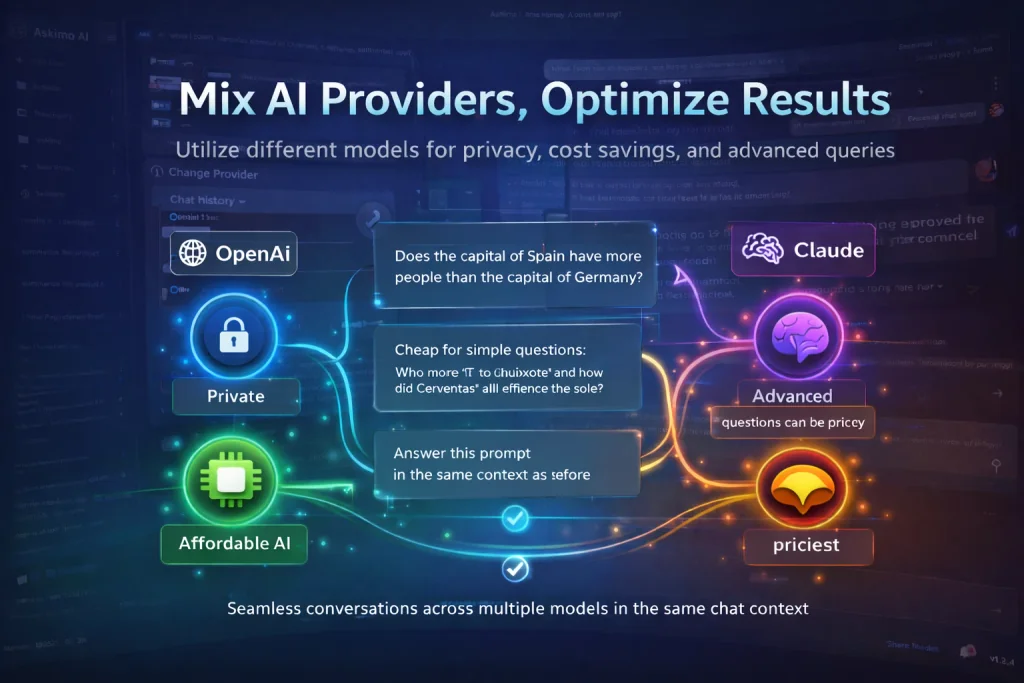

Si vous utilisez un seul modèle IA pour tout, vous laissez des performances, de la confidentialité et de l’argent sur la table.

ChatGPT, Claude, Gemini et Ollama ont chacun des forces distinctes. Claude écrit un meilleur code. Gemini gère les images. Ollama fonctionne localement et gratuitement, sans qu’aucune donnée ne quitte votre machine. Le flux de travail le plus intelligent n’est pas d’en choisir un, c’est d’utiliser le bon pour chaque tâche, le tout dans la même conversation.

Ce guide explique exactement pourquoi, et montre comment Askimo - une app IA de bureau gratuite et open source - y parvient sans effort.

ChatGPT vs Claude vs Gemini vs Ollama : quel modèle IA est le meilleur ?

La réponse honnête : aucun. Chacun domine dans des domaines différents.

| Modèle | Meilleur pour | Confidentialité | Coût |

|---|---|---|---|

| Claude (Anthropic) | Code, longs documents, instructions détaillées | Cloud | Paiement par token |

| ChatGPT (OpenAI) | Tâches générales, écriture créative, sortie structurée | Cloud | Paiement par token |

| Gemini (Google) | Images, multimodal, données en temps réel | Cloud | Paiement par token |

| Ollama / LM Studio | Données privées, utilisation hors ligne, coût nul | Local ✅ | Gratuit ✅ |

| LocalAI / Docker AI | Workflows d’entreprise auto-hébergés | Local ✅ | Gratuit ✅ |

Claude (Anthropic) excelle dans :

- La génération, le refactoring et le débogage de code

- Le raisonnement complexe à plusieurs étapes

- Le contenu long avec nuance et structure

- Le suivi précis d’instructions détaillées et en couches

ChatGPT (OpenAI) est fort dans :

- La connaissance générale et la conversation naturelle

- L’écriture créative, le brainstorming et l’idéation

- L’analyse d’entreprise et la sortie JSON structurée

- La couverture large de tâches dans différents domaines

Gemini (Google) se distingue par :

- La compréhension multimodale - texte, images, vidéo et audio

- L’information en temps réel et l’intégration Google Search

- L’analyse de documents et de graphiques

- Les tâches de raisonnement visuel

Ollama, LM Studio, LocalAI (modèles locaux) offrent :

- Confidentialité totale - vos données ne quittent jamais votre machine

- Zéro coût API - exécutez Llama, Mistral, Phi et 100+ modèles gratuitement

- Fonctionnalité hors ligne complète

- Pas de limites d’utilisation ni de limitation de débit

Avec tous ces modèles dans une app IA de bureau, vous choisissez le bon outil par tâche au lieu de forcer un modèle à tout faire.

Confidentialité : Acheminez les données sensibles vers des modèles IA locaux

Toutes les conversations ne devraient pas aller dans le cloud.

Quand vous travaillez avec du code propriétaire, des données financières, des données médicales, des documents juridiques ou des informations d’entreprise confidentielles, envoyer ce contenu à OpenAI ou Google comporte de vrais risques - des politiques de rétention des données à l’entraînement des modèles sur vos entrées.

Les modèles IA locaux comme Ollama éliminent ce risque entièrement. Vos données restent sur votre machine. Pas de serveurs tiers. Pas de politiques de rétention. Pas d’internet requis.

Une app IA de bureau avec support multi-fournisseur vous permet de :

- Utiliser Claude ou ChatGPT pour le travail général non sensible

- Basculer vers Ollama ou LocalAI dès que la conversation devient confidentielle

- Faire les deux dans la même session de chat sans perdre le contexte

C’est particulièrement précieux pour :

- Les développeurs travaillant sur des bases de code privées ou non publiées

- Les analystes d’affaires gérant des modèles financiers sensibles

- Les professionnels de la santé et du droit soumis à des obligations de conformité

- Toute personne qui prend la souveraineté des données au sérieux

Optimisation des coûts : Arrêtez de payer des tarifs premium pour des tâches simples

Les coûts d’API IA s’accumulent vite. Utiliser les meilleurs modèles cloud pour chaque requête, même les simples, représente des centaines d’euros par mois à grande échelle.

La solution est l’acheminement :

| Type de tâche | Exemple | Modèle recommandé |

|---|---|---|

| Recherche simple | ”Quelle est la capitale de la France ?” | Local (gratuit) |

| Conversion de format | ”Convertis cette date en ISO 8601” | Local (gratuit) |

| Résumé de paragraphe | ”Résume ceci en 2 phrases” | Local (gratuit) |

| Génération de code | ”Refactorise cette classe selon les principes SOLID” | Claude |

| Analyse de données | ”Trouve des patterns dans ce jeu de données financières” | Gemini |

| Rédaction technique | ”Écris une spécification pour cette fonctionnalité” | Claude |

Avec les modèles locaux gérant la charge simple, vous dépensez le budget API premium uniquement là où cela fait une réelle différence. La plupart des équipes peuvent réduire leurs dépenses API IA de 40-70% avec cette approche sans aucune baisse de qualité.

Changer de modèle IA en cours de conversation sans perdre le contexte

C’est la capacité qui change la façon dont les gens travaillent avec l’IA.

Dans une seule conversation Askimo, vous pouvez :

- Commencer avec ChatGPT pour brainstormer une idée de fonctionnalité

- Passer à Claude pour écrire le plan d’implémentation et le code

- Descendre vers Ollama (local) pour traiter un fichier de configuration sensible ou une clé API

- Sauter vers Gemini pour analyser une capture d’écran ou un diagramme d’architecture

Même session. Même historique. Zéro copier-coller entre outils.

Vous ne vous répétez pas, ne perdez pas le fil, ne gérez pas cinq onglets de navigateur. La conversation coule naturellement et le bon modèle gère chaque partie du travail.

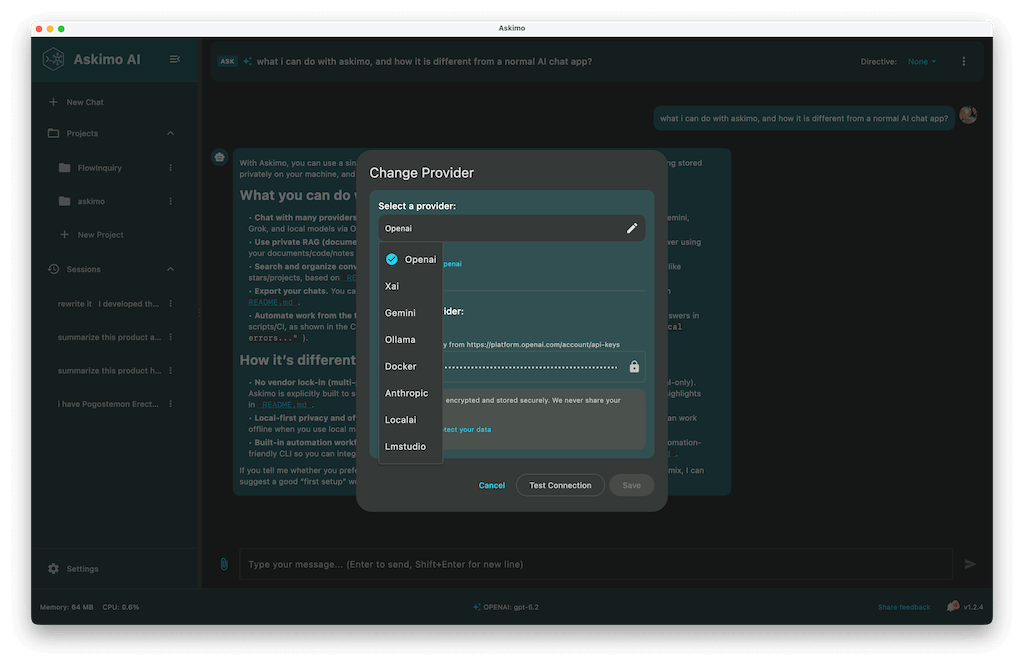

Askimo : App IA de bureau gratuite pour ChatGPT, Claude, Gemini & Ollama

Askimo est une app IA de bureau gratuite et open source conçue spécifiquement pour les workflows multi-fournisseurs. Une interface pour chaque modèle.

Fournisseurs supportés :

- OpenAI (derniers modèles GPT)

- Anthropic (derniers modèles Claude)

- Google (derniers modèles Gemini)

- Ollama (Llama, Mistral, Phi, CodeLlama et plus de 100 modèles locaux)

- LM Studio, LocalAI, Docker AI (configurations auto-hébergées et entreprise)

- Grok (xAI)

Fonctionnalités clés

Recherche plein texte dans toutes les conversations Chaque message de chaque modèle est indexé localement. Retrouvez tout insight, extrait de code ou décision de il y a des semaines en quelques secondes.

RAG - Chattez avec vos propres documents Indexez des PDFs, des dépôts de code, des wikis internes ou toute collection de documents. Posez des questions et obtenez des réponses basées sur vos données réelles, pas sur des hallucinations des poids d’entraînement. Voir RAG en action ->

Plans IA - Workflows automatisés multi-étapes Enchaînez des prompts entre modèles dans des pipelines automatisés. Chaque étape passe sa sortie à la suivante - recherche, écriture, révision, export. Sans copier-coller manuel entre étapes. Voir les Plans IA ->

Intégration d’outils MCP Connectez-vous à GitHub, bases de données, fichiers locaux et APIs externes directement depuis le chat via le Model Context Protocol. Guide d’intégration MCP ->

Script Runner Exécutez des scripts Python, Bash ou Node générés par l’IA dans un environnement sandbox sans quitter l’app.

Personnalisation visuelle complète Thèmes, polices, icônes personnalisées, support moniteurs 4K/8K.

Qui en profite le plus

Développeurs - Claude pour le code, GPT pour la documentation, Ollama pour les repos privés, Gemini pour les diagrammes. Tout au même endroit, tout indexé.

Analystes d’affaires - Gemini pour les graphiques financiers, OpenAI pour les résumés, Ollama pour les modèles confidentiels.

Chercheurs - RAG sur toute la bibliothèque de papers, comparaison multi-modèles, capacité hors ligne.

Chefs d’entreprise - Modèles moins chers pour les tâches routinières, modèles premium pour la stratégie, confidentialité totale pour les documents sensibles.

L’argument contre l’utilisation d’un seul modèle IA

L’IA évolue mensuellement. De nouveaux modèles arrivent avec de nouvelles forces et de nouveaux tarifs. Se verrouiller sur une seule plateforme signifie :

- Rater les capacités de pointe dès qu’un meilleur modèle arrive

- Payer des tarifs premium même pour des tâches qu’un modèle local gratuit gère aussi bien

- Pas de solution de repli quand un fournisseur tombe en panne ou vous limite

- Pas d’option de confidentialité quand le travail le requiert

Une app IA de bureau multi-fournisseur vous donne la liberté de vous adapter sans changer votre workflow ni migrer l’historique des conversations.

Questions fréquentes

Puis-je changer de modèle IA en cours de conversation ? Oui. Askimo vous permet de changer le modèle actif à n’importe quel point d’une conversation. L’historique complet du chat est transmis au nouveau modèle pour qu’il reprenne exactement là où le précédent s’était arrêté.

Ai-je besoin d’une clé API pour chaque fournisseur ? Vous avez besoin de clés API pour les fournisseurs cloud (OpenAI, Anthropic, Google). Les modèles locaux via Ollama ou LM Studio ne nécessitent pas de clé API - ils s’exécutent entièrement sur votre machine.

Askimo est-il vraiment gratuit ? Oui. Askimo est gratuit et open source. Vous ne payez que l’utilisation de l’API cloud aux tarifs standard du fournisseur. Les modèles locaux (Ollama, LM Studio, LocalAI) n’ont aucun coût.

Comment Askimo protège-t-il mes clés API ? Les clés API sont stockées dans le trousseau du système d’exploitation - macOS Keychain, Windows Credential Manager ou Linux Secret Service. Elles ne sont jamais écrites sur le disque en clair.

Quel modèle local utiliser avec Ollama ? Pour les tâches générales : Llama ou Mistral. Pour le code : CodeLlama ou DeepSeek Coder. Pour les machines avec peu de mémoire : Phi. Tous sont gratuits à télécharger et exécuter via Ollama.

Askimo fonctionne-t-il hors ligne ? Oui, pour les modèles locaux. Les conversations avec Ollama, LM Studio et LocalAI fonctionnent sans connexion internet. Les fournisseurs cloud nécessitent une connexion active.

Commencez maintenant - Gratuit sur macOS, Windows et Linux

Téléchargez Askimo et commencez à utiliser ChatGPT, Claude, Gemini et Ollama ensemble dans une seule app. Aucun compte requis. Pas de carte de crédit.

- ✅ Gratuit et open source

- ✅ macOS, Windows, Linux

- ✅ Modèles cloud et locaux

- ✅ Recherche, RAG, Plans IA, outils MCP intégrés

Ou essayez Askimo CLI pour les workflows en ligne de commande et d’automatisation.

⭐ Mettez une étoile à Askimo sur GitHub pour suivre le développement et aider à façonner ce qui sera construit ensuite.