1つのAIモデルだけですべてをこなそうとしているなら、パフォーマンス・プライバシー・コストの面で損をしています。

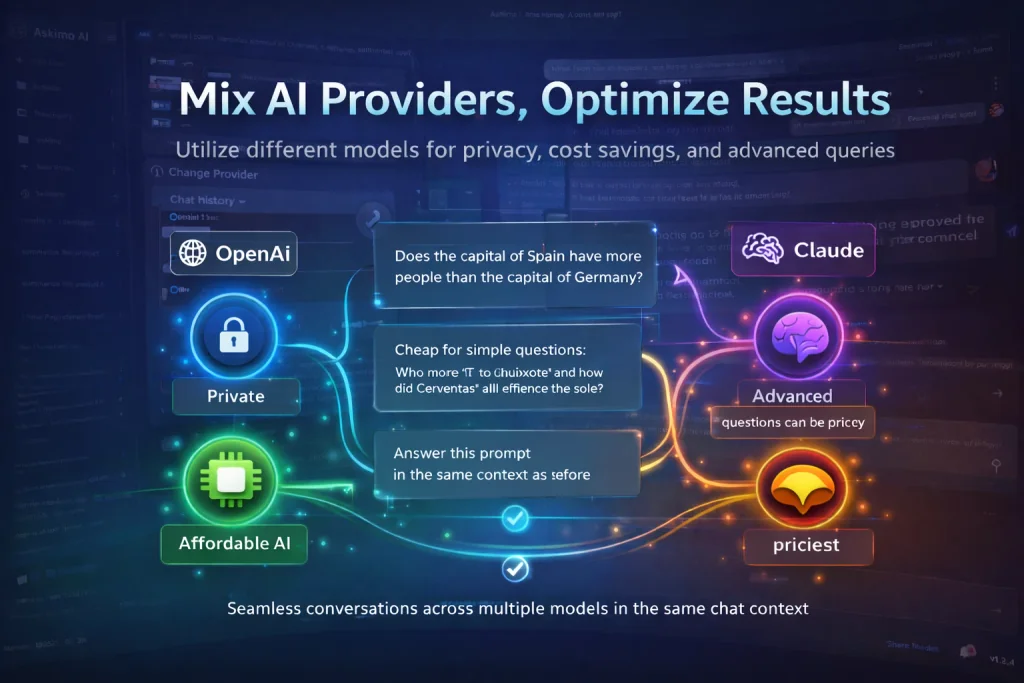

ChatGPT、Claude、Gemini、Ollamaはそれぞれ異なる強みを持っています。Claudeはコードが得意。Geminiは画像を扱える。Ollamaはデータをマシン外に一切送らず無料でローカル動作します。賢いワークフローとは1つを選ぶことではなく、同じ会話の中でタスクに応じて最適なモデルを使い分けることです。

このガイドではその理由を詳しく解説し、Askimo - 無料のオープンソースAIデスクトップアプリ - がいかに簡単に実現するかを紹介します。

ChatGPT vs Claude vs Gemini vs Ollama: どのAIモデルが最良か?

正直な答え: どれも最良ではありません。それぞれが異なる領域で優れています。

| モデル | 得意分野 | プライバシー | コスト |

|---|---|---|---|

| Claude (Anthropic) | コード、長文ドキュメント、詳細な指示 | クラウド | トークン課金 |

| ChatGPT (OpenAI) | 一般タスク、ライティング、構造化出力 | クラウド | トークン課金 |

| Gemini (Google) | 画像、マルチモーダル、リアルタイムデータ | クラウド | トークン課金 |

| Ollama / LM Studio | 機密データ、オフライン利用、ゼロコスト | ローカル ✅ | 無料 ✅ |

| LocalAI / Docker AI | セルフホスト型企業ワークフロー | ローカル ✅ | 無料 ✅ |

Claude (Anthropic) の強み:

- コード生成、リファクタリング、デバッグ

- 複雑なマルチステップの推論

- 構造と繊細さを持つ長文コンテンツ

- 詳細で多層的な指示への対応

ChatGPT (OpenAI) の強み:

- 一般常識と自然な会話

- クリエイティブライティング、ブレインストーミング、アイデア出し

- ビジネス分析と構造化JSON出力

- 幅広いタスクへの対応力

Gemini (Google) の強み:

- マルチモーダル理解 - テキスト、画像、動画、音声

- リアルタイム情報とGoogle検索との連携

- ドキュメントとグラフの分析

- 視覚的推論タスク

Ollama、LM Studio、LocalAI(ローカルモデル)の強み:

- 完全なプライバシー - データがマシン外に出ない

- APIコストゼロ - Llama、Mistral、Phi、100以上のモデルを無料で実行

- 完全なオフライン動作

- 利用制限やレート制限なし

これらすべてを1つのAIデスクトップアプリで使えれば、1つのモデルに無理をさせることなく、タスクごとに最適なツールを選べます。

プライバシー: 機密データはローカルAIモデルへ

すべての会話をクラウドに送るべきではありません。

独自コード、財務記録、医療データ、法的文書、機密ビジネス情報を扱う場合、その内容をOpenAIやGoogleに送信することには実際のリスクがあります。データ保持ポリシーからモデルの学習への利用まで様々な懸念があります。

OllamaのようなローカルAIモデルはそのリスクを完全に排除します。 データはあなたのマシン上に留まります。サードパーティのサーバーなし。保持ポリシーなし。インターネット不要。

マルチプロバイダー対応のAIデスクトップアプリを使えば:

- 一般的な非機密作業にはClaudeやChatGPTを使用

- 会話が機密に関わる瞬間にOllamaやLocalAIへ切り替え

- コンテキストを失わずに同じチャットセッション内で両方を実行

これが特に価値を発揮するのは:

- 未公開のプライベートコードベースに取り組む開発者

- 機密性の高い財務モデルを扱うビジネスアナリスト

- コンプライアンス要件のある医療・法律専門家

- データ主権を重視するすべての人

コスト最適化: シンプルなタスクにプレミアム料金を払うのをやめる

AIのAPIコストは急速に積み重なります。シンプルなクエリにもGPT-4oやClaude Sonnetを使い続けると、大規模では月数百ドルになります。

解決策はルーティングです:

| タスク種別 | 例 | 推奨モデル |

|---|---|---|

| 単純な検索 | 「フランスの首都は?」 | ローカル(無料) |

| フォーマット変換 | 「この日付をISO 8601に変換して」 | ローカル(無料) |

| 段落の要約 | 「これを2文で要約して」 | ローカル(無料) |

| コード生成 | 「SOLIDの原則でこのクラスをリファクタして」 | Claude |

| データ分析 | 「この財務データセットのパターンを見つけて」 | Gemini |

| テクニカルライティング | 「この機能の仕様書を書いて」 | Claude |

シンプルな作業をローカルモデルに任せることで、プレミアムAPIの予算を本当に価値のある場面だけに使えます。このアプローチで出力品質を落とさずにAI APIの支出を40~70%削減したチームも多くいます。

会話の途中でコンテキストを失わずにモデルを切り替える

これがAIを使った仕事の仕方を変える機能です。

1つのAskimoの会話の中で:

- ChatGPT でアイデアをブレインストーミング

- Claude に切り替えて実装計画とコードを作成

- Ollama(ローカル) に落として機密設定ファイルやAPIキーを処理

- Gemini にジャンプしてスクリーンショットやアーキテクチャ図を分析

同じセッション。同じ履歴。ツール間のコピペはゼロ。

繰り返す必要も、流れを見失うことも、5つのブラウザタブを管理することもありません。会話は自然に流れ、各部分を最適なモデルが担当します。

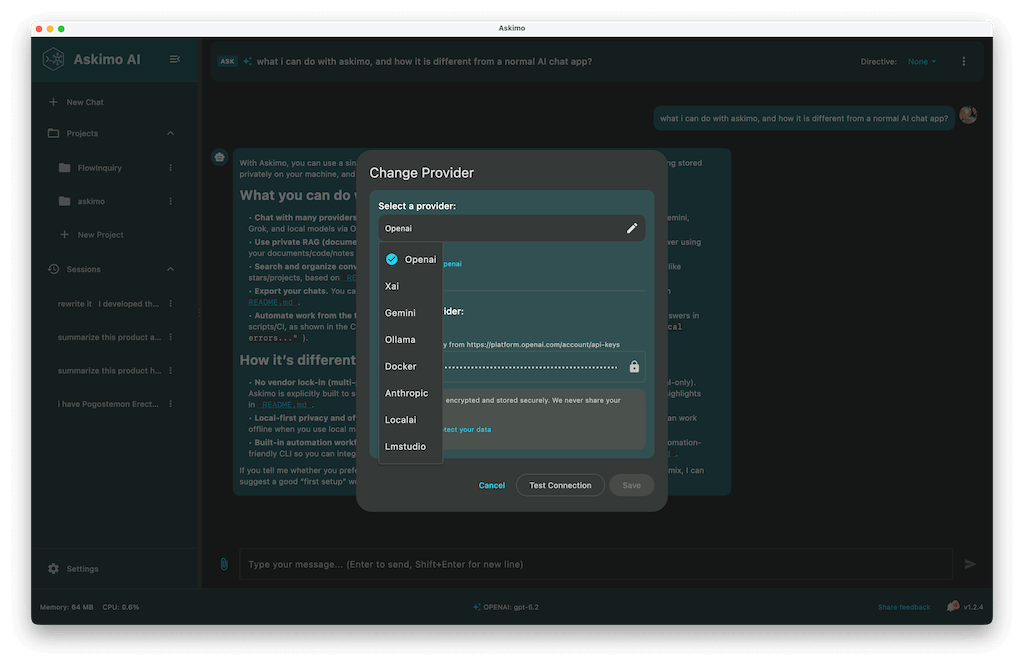

Askimo: ChatGPT、Claude、Gemini & Ollama対応の無料AIデスクトップアプリ

Askimoはマルチプロバイダーのワークフローのために設計された無料のオープンソースAIデスクトップアプリです。あらゆるモデルのための1つのインターフェース。

対応プロバイダー:

- OpenAI(最新のGPTモデル)

- Anthropic(最新のClaudeモデル)

- Google(最新のGeminiモデル)

- Ollama(Llama、Mistral、Phi、CodeLlama、100以上のローカルモデル)

- LM Studio、LocalAI、Docker AI(セルフホストおよびエンタープライズ環境)

- Grok (xAI)

主な機能

全会話の全文検索 すべてのモデルのすべてのメッセージがローカルにインデックスされます。数週間前のインサイト、コードスニペット、意思決定を数秒で見つけられます。

RAG - 自分のドキュメントとチャット PDF、コードリポジトリ、社内wiki、あらゆるドキュメントコレクションをインデックス化。学習データからの幻覚ではなく、実際のデータに基づいた回答を取得できます。RAGの実例を見る ->

AIプラン - マルチステップ自動ワークフロー モデルをまたいだプロンプトを自動パイプラインに連鎖。各ステップが出力を次に渡します - リサーチ、執筆、レビュー、エクスポート。手動のコピペは不要。AIプランを見る ->

MCPツール統合 GitHub、データベース、ローカルファイル、外部APIにModel Context Protocol経由でチャットから直接接続。MCPインテグレーションガイド ->

スクリプトランナー AIが生成したPython、Bash、Nodeスクリプトをアプリを離れることなくサンドボックス環境で実行。

完全なビジュアルカスタマイズ テーマ、フォント、カスタムアイコン、4K/8Kモニター対応。

最も恩恵を受けるのは誰か

開発者 - コードにClauде、ドキュメントにGPT、プライベートリポジトリにOllama、図表にGemini。すべて1か所で、すべて検索可能。

ビジネスアナリスト - 財務グラフにGemini、要約にOpenAI、機密モデルにOllama。

研究者 - 論文ライブラリ全体へのRAG、マルチモデル比較、オフライン機能。

ビジネスオーナー - ルーティンタスクには安価なモデル、戦略には高性能モデル、機密文書には完全プライバシー。

1つのAIモデルだけを使う場合のデメリット

AIは毎月進化します。新しいモデルが新しい強みと価格で登場します。1つのプラットフォームに縛られると:

- より良いモデルが登場した瞬間に最先端の機能を逃す

- 無料のローカルモデルで十分なタスクにもプレミアム料金を払い続ける

- プロバイダーが障害やレート制限を起こしたときのフォールバックがない

- 必要なときのプライバシーオプションがない

マルチプロバイダー対応AIデスクトップアプリは、ワークフローを変えたり会話履歴を移行したりすることなく、AI業界の変化に適応する自由を与えてくれます。

よくある質問

会話の途中でAIモデルを切り替えられますか? はい。Askimoでは会話中の任意の時点でアクティブなモデルを変更できます。完全なチャット履歴が新しいモデルに渡されるため、前のモデルが止まったところからそのまま続けられます。

プロバイダーごとにAPIキーが必要ですか? クラウドプロバイダー(OpenAI、Anthropic、Google)にはAPIキーが必要です。OllamaやLM Studio経由のローカルモデルはAPIキー不要で、完全にマシン上で動作します。

Askimoは本当に無料ですか? はい。AskimoはオープンソースSoftwareで無料です。支払うのはプロバイダーの標準料金でのクラウドAPI使用量のみです。ローカルモデル(Ollama、LM Studio、LocalAI)は一切コストがかかりません。

AskimoはAPIキーをどのように保護しますか? APIキーはOSのキーチェーンに保存されます。macOS Keychain、Windows Credential Manager、またはLinux Secret Serviceです。平文でディスクに書き込まれることは一切ありません。

Ollamaでどのローカルモデルを使うべきですか? 一般タスクには Llama または Mistral。コードには CodeLlama または DeepSeek Coder。メモリが少ないマシンには Phi が最適です。すべてOllamaで無料でダウンロード・実行できます。

Askimoはオフラインで動作しますか? はい、ローカルモデルに限り動作します。Ollama、LM Studio、LocalAIとの会話はインターネット接続なしで機能します。クラウドプロバイダーはアクティブな接続が必要です。

始めましょう - macOS、Windows、Linuxで無料

Askimoをダウンロードして、ChatGPT、Claude、Gemini、Ollamaを1つのアプリでまとめて使い始めましょう。アカウント不要。クレジットカード不要。

- ✅ 無料・オープンソース

- ✅ macOS、Windows、Linux対応

- ✅ クラウドとローカルモデル

- ✅ 検索、RAG、AIプラン、MCPツール搭載

コマンドライン・自動化ワークフローにはAskimo CLIもお試しください。

⭐ GitHubでAskimoにスターを付けて、開発をフォローし次に何を作るかを一緒に形にしましょう。