¿Alguna vez quisiste hacer preguntas sobre tus documentos, artículos de investigación o archivos de proyecto sin subirlos a la nube? RAG (Recuperación Aumentada por Generación) con Ollama en Askimo lo hace posible. Modelos de IA locales como Llama, Mistral o Phi pueden responder preguntas sobre tus PDFs, documentos Word, notas y cualquier archivo de texto, todo ejecutándose completamente en tu máquina.

TL;DR: Instala Ollama, descarga un modelo como

llama3omistral, descarga Askimo, crea un proyecto apuntando a tu carpeta de documentos y empieza a hacer preguntas. Tus archivos se indexan localmente y la IA recupera información relevante para responder tus preguntas. Sin internet tras la configuración.

¿Nuevo en Ollama? Lee nuestra guía sobre por qué Askimo es la mejor app de escritorio para Ollama.

¿Por qué usar RAG con Ollama para tus documentos?

El problema: la IA no conoce tus archivos

Cuando aparecieron ChatGPT y asistentes similares, revolucionaron las respuestas a preguntas generales. Estos herramientas destacan en conocimiento general porque están entrenadas con enormes cantidades de datos públicos.

Pero al intentar aplicar IA a su trabajo real, los usuarios chocaron con una pared:

La limitación del documento único: Al principio podías subir un documento y hacer preguntas. Funcionaba para tareas rápidas como “resume este informe”. Pero el trabajo real implica mucho más:

- Artículos de investigación: No tienes un artículo, tienes 20, 50 o más de 100 que necesitas sintetizar

- Políticas de empresa: Tu organización tiene decenas de documentos de políticas, manuales y guías

- Documentación de proyectos: Notas de reuniones, requisitos, especificaciones técnicas y comunicaciones dispersas en archivos

- Conocimiento personal: Años de notas, investigación y escritura que quieres consultar

El problema más profundo: Cuando preguntas a un asistente de IA típico sobre tu trabajo:

- Respuestas genéricas: La IA responde basándose en sus datos de entrenamiento de internet, no en lo que hay en tus archivos específicos.

- Alucinaciones: Sin acceso a tus documentos, la IA puede inventar información que suena plausible pero no existe en tus archivos.

- Sin contexto entre múltiples archivos: No puedes preguntar “¿Qué dicen todos mis artículos sobre metodología?” La IA no tiene una visión holística de tu colección.

- Conocimiento perdido: Todos esos años de notas acumuladas, la IA no puede ayudarte a encontrar patrones o conexiones enterradas en tus archivos.

- Preocupaciones de privacidad: Para obtener ayuda específica de documentos, tendrías que subir documentos sensibles a servicios en la nube.

Esto es exactamente lo que RAG con Ollama resuelve.

La solución: RAG hace que la IA local sea consciente de los documentos

Con RAG, los modelos Ollama se convierten en tu asistente de investigación personal que realmente conoce tus archivos:

- Respuestas fundamentadas: Las respuestas referencian tus documentos reales, no información genérica

- Memoria de archivos: La IA “recuerda” todos tus documentos y su contenido

- Contexto instantáneo: Recupera automáticamente información relevante cuando haces preguntas

- Privacidad completa: Todo se ejecuta localmente - tus archivos nunca salen de tu máquina

Más información: Para una comparación detallada de clientes Ollama, consulta nuestra guía Mejores clientes Ollama en 2026.

Cómo funciona RAG con Ollama

Cuando creas un proyecto en Askimo y activas RAG:

- Indexación: Tus archivos se leen, dividen en fragmentos y organizan para búsqueda rápida

- Almacenamiento: El índice vive en tu máquina (normalmente ocupa el 10-30% del tamaño de tus archivos)

- Recuperación: Cuando haces una pregunta, se encuentra automáticamente información relevante

- Inyección: Estos fragmentos se muestran a la IA antes de que responda

- Generación: Los modelos Ollama usan este contexto para dar respuestas precisas y específicas

Todo esto sucede localmente - sin llamadas a API externas para indexación o recuperación.

¿Quieres detalles técnicos? Visita nuestra documentación RAG.

Casos de uso del mundo real

Investigación: Síntesis a través de múltiples artículos

El desafío: Tienes 50+ artículos de investigación sobre cambio climático. La búsqueda tradicional encuentra palabras clave pero no puede sintetizar hallazgos entre documentos.

Con RAG:

You: "What are the main findings across all my climate research papers?"

Llama 3: Based on your papers, three key findings emerge:1. Temperature increases correlate with CO2 levels (mentioned in 12 papers)2. Ocean acidification is accelerating faster than predicted (7 papers)3. Renewable energy adoption is cost-effective (15 papers with economic data)

Sources: climate-change-2023.pdf, renewable-study.docx, ocean-research.pdf [and 9 more]Preguntas reales que puedes hacer:

- “Compara las metodologías usadas en mis estudios de energía renovable”

- “¿Qué conjuntos de datos aparecen más frecuentemente en mi colección de investigación?”

- “Encuentra conclusiones contradictorias sobre la eficiencia de los paneles solares”

Escritura: Gestión de proyectos de formato largo

El desafío: Tu novela tiene 30 capítulos, notas de personajes, documentos de construcción del mundo y esquemas de trama. Hacer un seguimiento de los detalles en cientos de páginas es difícil.

Con RAG:

You: "Has Elena ever mentioned being afraid of water in any chapter?"

Mistral: Yes, in chapter 7 Elena mentions she nearly drowned as a child. She alsoavoids the harbor scene in chapter 12 saying "I don't do boats." Your characternotes list this as a key personality trait stemming from her childhood incident.

Sources: chapter-07.docx, chapter-12.docx, character-profiles.mdPreguntas reales que puedes hacer:

- “¿Qué habilidades mágicas ha demostrado el antagonista hasta ahora?”

- “Lista todos los lugares que he descrito en el Reino Oriental”

- “¿Qué inconsistencias de línea temporal existen entre los capítulos 3, 8 y 15?”

Trabajo: Acceso rápido al conocimiento de la empresa

El desafío: Tu equipo tiene cientos de documentos: políticas, notas de reuniones, especificaciones de proyectos, retroalimentación de clientes. Encontrar información específica desperdicia horas cada semana.

Con RAG:

You: "What's our policy on remote work expenses?"

Llama 3: According to the HR Policy Handbook (updated Jan 2026), employees canexpense up to $500/month for home office equipment and $150/month for internet.Receipts must be submitted within 30 days. See section 4.2 for full details.

Source: HR-Policies-2026.pdf (page 23)Preguntas reales que puedes hacer:

- “¿Cuáles fueron los puntos de acción de la reunión del equipo de la semana pasada?”

- “Encuentra todos los comentarios de clientes que mencionan la app móvil”

- “Resume las métricas de rendimiento del Q4 2025”

Configurar RAG con Ollama

Paso 1: Instalar Ollama

Ollama se ejecuta localmente en macOS, Windows y Linux.

macOS:

# Download from https://ollama.com/download/mac# Or use Homebrewbrew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | shWindows:

# Download installer from https://ollama.com/download/windowsPrueba la instalación:

ollama run llama3Configuración detallada de Ollama: Mira nuestra guía del proveedor Ollama.

Paso 2: Descargar un modelo de embeddings

RAG necesita un modelo de embeddings para convertir tus documentos en información buscable:

ollama pull nomic-embed-textEste es el modelo de embeddings predeterminado de Askimo para Ollama - es rápido y funciona bien para todos los tipos de documentos.

Paso 3: Descargar un modelo de chat

Elige un modelo según la memoria de tu computadora:

# For 8GB+ RAM - Fast and capableollama pull llama3

# For 16GB+ RAM - Excellent for complex questionsollama pull mistral

# For 4-8GB RAM - Lightweightollama pull phi3Paso 4: Instalar Askimo

Descarga Askimo para tu plataforma:

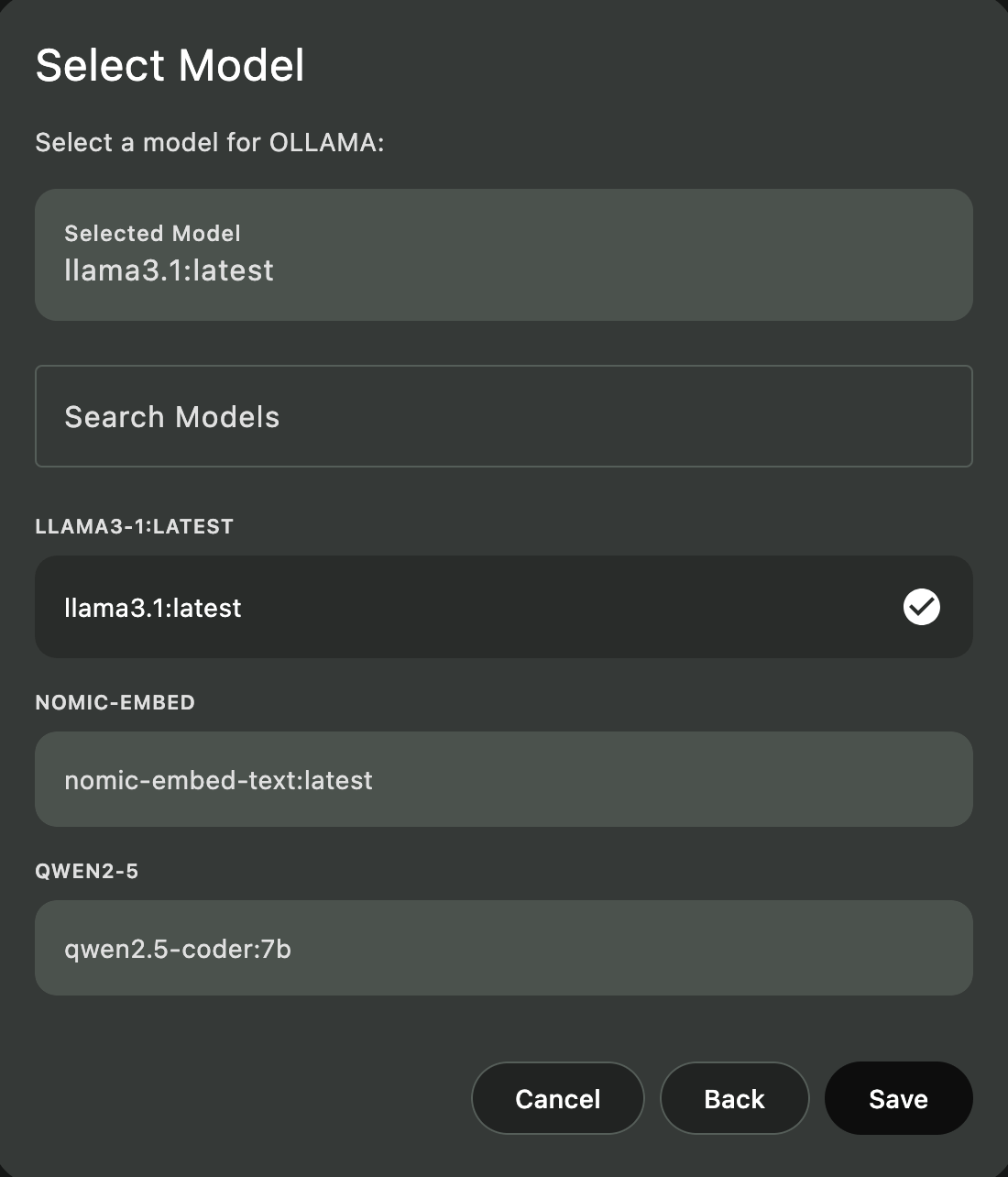

Paso 5: Configurar Ollama en Askimo

- Abre Askimo

- Ve a Configuración → Proveedores

- Activa Ollama

- Establece el endpoint en

http://localhost:11434 - Selecciona tu modelo de chat (ej.

llama3) - Establece el modelo de embeddings en

nomic-embed-text

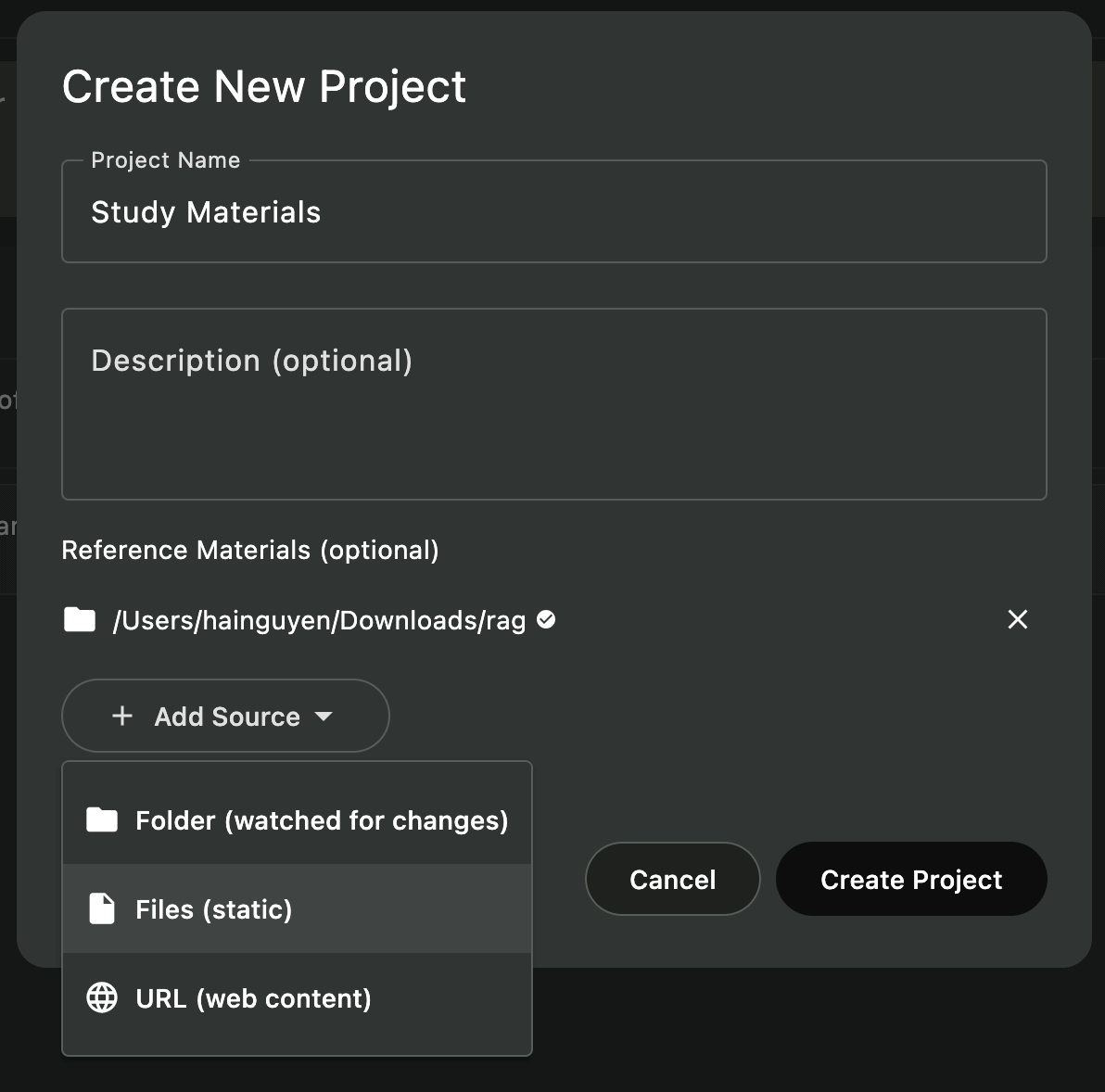

Paso 6: Crear un proyecto con RAG

-

Abrir el Gestor de Proyectos

- Haz clic en el ícono “Proyectos” en la barra lateral

- O usa

⌘/Ctrl + P

-

Crear nuevo proyecto

- Haz clic en ”+ Nuevo Proyecto”

- Ingresa un nombre (ej. “Mis Artículos de Investigación”, “Notas del Libro”, “Materiales de Estudio”)

- Haz clic en “Seleccionar Carpeta” y elige tu carpeta de documentos

-

Indexación automática

- Askimo detecta tus archivos automáticamente

- La indexación comienza en segundo plano

- Espera a que finalice (10-60 segundos para colecciones típicas)

-

Comenzar a chatear

- Crea un nuevo chat dentro del proyecto

- RAG se activa automáticamente

- ¡Haz preguntas sobre tus documentos!

Consejo profesional: Puedes crear múltiples proyectos para diferentes propósitos - uno para documentos de trabajo, uno para investigación personal, uno para materiales de estudio, etc.

Qué se indexa

Askimo indexa tus archivos de manera inteligente:

Archivos incluidos

- Documentos:

.pdf,.docx,.doc,.odt(el texto se extrae automáticamente) - Hojas de cálculo:

.xlsx,.xls,.ods - Presentaciones:

.pptx,.ppt,.odp - Archivos de texto:

.txt,.md,.rtf - Correos electrónicos:

.eml,.msg - Notas y escritura: Markdown, texto plano, texto enriquecido

- Código fuente:

.js,.py,.java,.html,.css(para usuarios técnicos) - Configuración:

.json,.yaml,.xml

Excluidos automáticamente

- Archivos del sistema: Archivos ocultos, archivos temporales

- Archivos grandes: Archivos mayores de 5 MB (para mantener la indexación rápida)

- Archivos binarios: Imágenes, videos, audio (a menos que sean tipos de documento compatibles)

- Archivos comprimidos:

.zip,.rar,.tar

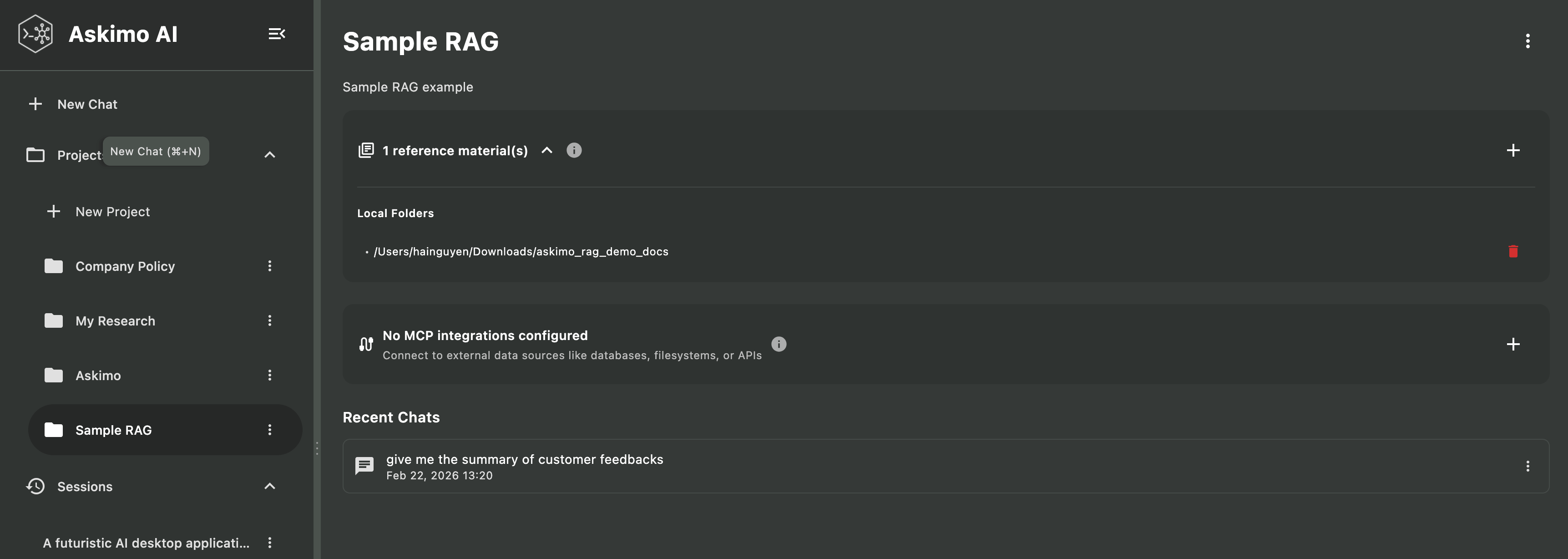

Ejemplo: Chateando con tus artículos de investigación

Crea un proyecto apuntando a tu carpeta de investigación:

my-research/ ├── climate-change-2023.pdf ├── renewable-energy-study.pdf ├── notes/ │ └── literature-review.md └── data/ └── analysis-summary.pdfLa indexación completa en ~20 segundos. Ahora puedes preguntar:

Tú: “¿Cuáles son los principales hallazgos sobre la eficiencia de los paneles solares?”

Llama 3:

Según tus artículos de investigación, los paneles modernos alcanzan una eficiencia del 20-22%, frente al 15% de hace una década. Los paneles bifaciales pueden alcanzar el 25% en condiciones óptimas.

Sources: solar-panel-efficiency.docx, renewable-energy-study.pdf

Observa cómo la IA referencia tus documentos reales, no información genérica de internet.

Funciones avanzadas de RAG

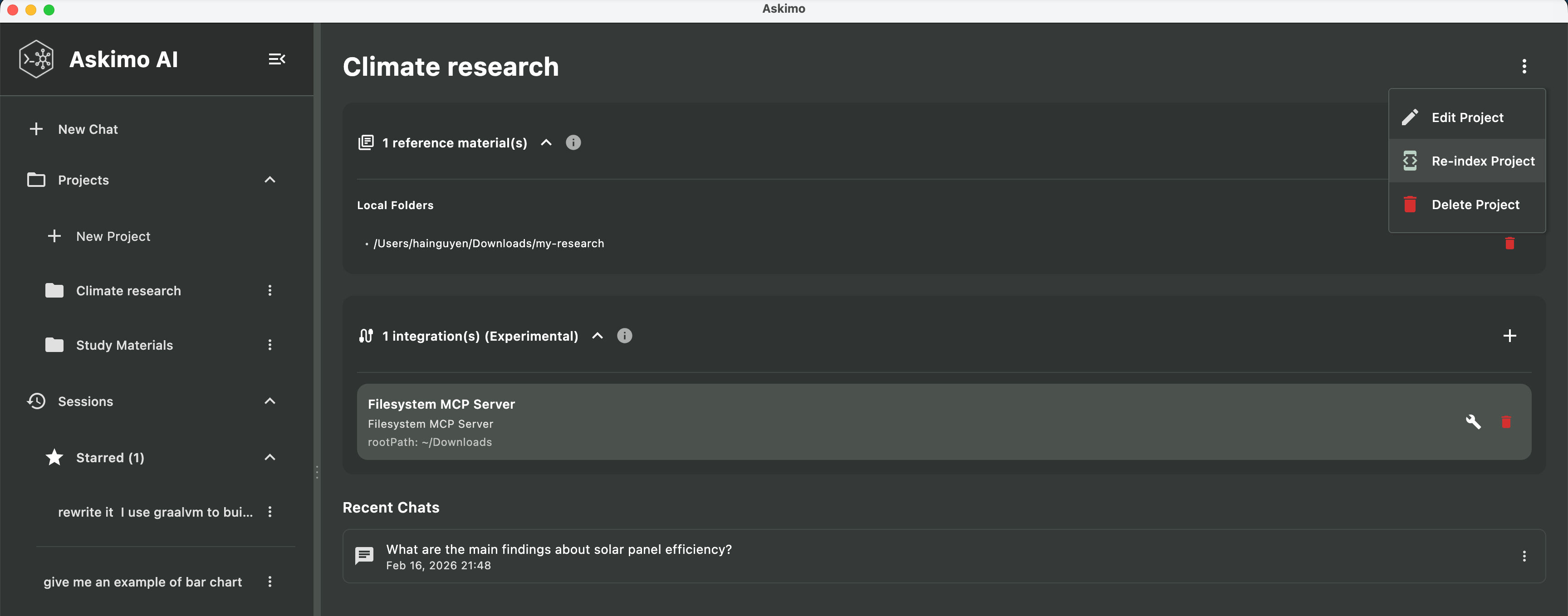

Múltiples proyectos para diferentes temas

Organiza tus documentos en proyectos separados:

- Documentos de trabajo: Informes de negocio, notas de reuniones, archivos de clientes

- Investigación personal: Hobbies, intereses, materiales de aprendizaje

- Trabajo académico: Materiales de estudio, artículos de investigación, notas de tesis

- Proyectos creativos: Escritura, notas de arte, documentos de brainstorming

Actualizaciones automáticas

Askimo detecta cambios en archivos automáticamente:

- Archivo modificado: Re-indexa solo ese archivo

- Archivo añadido: Se añade al índice

- Archivo eliminado: Se elimina del índice

Modelos de embeddings personalizados

Para usuarios avanzados que quieran experimentar:

# Pull a specialized embedding modelollama pull mxbai-embed-large

# In Askimo Settings → Providers → Ollama# Change embedding model to: mxbai-embed-largeConsejos de rendimiento

Elige el modelo adecuado para tu computadora

| Memoria de tu computadora | Modelo recomendado | Mejor para |

|---|---|---|

| 4-8 GB | phi3 | Preguntas rápidas, documentos simples |

| 8-16 GB | llama3 | Uso general, investigación, escritura |

| 16+ GB | mistral | Análisis complejos, documentos largos |

| 32+ GB | deepseek-coder | Grandes colecciones de documentos |

Haz preguntas específicas

En lugar de preguntas amplias, sé específico:

- ❌ “Cuéntame sobre este proyecto”

- ✅ “¿Cuáles son los hallazgos clave en los artículos de investigación climática?”

RAG vs. búsqueda tradicional de documentos

| Función | Búsqueda en Explorador | Búsqueda en PDF | Askimo RAG con Ollama |

|---|---|---|---|

| Búsqueda por palabra clave | ✅ Básica | ✅ Rápida | ✅ Instantánea en todos los archivos |

| Búsqueda semántica | ❌ No | ❌ No | ✅ Entiende el significado |

| Lenguaje natural | ❌ No | ❌ No | ✅ Preguntas en lenguaje natural |

| Entre documentos | ❌ Uno a la vez | ❌ Uno a la vez | ✅ Busca todos los documentos |

| Comprensión contextual | ❌ No | ❌ No | ✅ Entiende relaciones |

| Generación de respuestas | ❌ No | ❌ No | ✅ Explica y resume |

| Privacidad | ✅ Local | ✅ Local | ✅ Totalmente local |

Privacidad y seguridad

Todo se queda local

- Indexación: Se ejecuta en tu máquina usando Lucene

- Embeddings: Generados localmente por Ollama

- Chat: Los modelos Ollama se ejecutan en tu hardware

- Almacenamiento: Los archivos de índice permanecen en

~/.askimo/

Sin dependencias externas

Una vez que hayas descargado los modelos Ollama:

- Funciona completamente offline

- Sin llamadas a la API de servicios externos

- Ningún dato sale de tu máquina

Solución de problemas

”La IA no parece conocer mis documentos”

Posibles causas:

- Proyecto aún no indexado: Revisa el estado de indexación en la vista del proyecto

- Archivos no compatibles: Asegúrate de usar tipos de archivo compatibles (PDF, DOCX, TXT, etc.)

- Archivos demasiado grandes: Los archivos mayores de 5 MB se omiten

Solución:

- Espera a que la indexación finalice

- Intenta re-indexar: Configuración del proyecto → “Re-indexar Proyecto”

- Asegúrate de que RAG esté activado para tu chat

Indexación lenta

Solución:

- Ten paciencia - la indexación inicial lleva tiempo pero solo ocurre una vez

- Las actualizaciones futuras son mucho más rápidas

- Considera organizar en proyectos más pequeños si tienes 10,000+ archivos

Sin memoria suficiente

Solución:

- Usa un modelo más pequeño (

phi3en lugar demistral) - Cierra otras aplicaciones que consuman mucha memoria

- Reinicia tu computadora para liberar memoria

¿Necesitas más ayuda? Pregunta en nuestras discusiones de GitHub.

Qué puedes hacer con RAG

RAG con Ollama en Askimo abre nuevas posibilidades:

- Investigación: Encontrar información rápidamente en decenas de artículos

- Escritura: Hacer seguimiento de personajes, puntos de trama e investigación para tus libros

- Aprendizaje: Estudiar más efectivamente haciendo preguntas sobre tus notas

- Trabajo: Encontrar información en informes, notas de reuniones y documentación de proyectos

- Personal: Organizar recetas, investigación de viajes, notas de hobbies y más

Todo mientras mantienes tus documentos privados y locales - nada sale de tu computadora.

Preguntas frecuentes

¿Funciona RAG con Ollama sin conexión? Sí, completamente. Una vez que los modelos Ollama están descargados y tu proyecto indexado, todo funciona sin conexión a internet. Indexación, recuperación y respuestas de IA ocurren en tu máquina. No hay llamadas a API externas en ninguna etapa.

¿Son privados mis datos al usar RAG con Ollama? Sí. Tus documentos nunca salen de tu máquina. La indexación se hace localmente con Apache Lucene, los embeddings son generados por un modelo local de Ollama, y el modelo de chat corre en tu propio hardware. Nada se envía a ningún servicio en la nube.

¿Qué tipos de archivos admite Askimo RAG? PDFs, documentos Word (.docx, .doc), hojas de cálculo (.xlsx, .xls), presentaciones (.pptx), texto plano, Markdown, archivos de texto enriquecido, correos electrónicos y archivos de código fuente. Los archivos mayores de 5 MB y los archivos binarios (imágenes, video, audio) se excluyen automáticamente.

¿En qué se diferencia RAG con Ollama de subir un documento a ChatGPT? Tres diferencias clave: privacidad (tus archivos nunca salen de tu máquina), escala (RAG busca en cientos de documentos simultáneamente, no solo uno) y precisión (las respuestas se basan en tus documentos reales en lugar de los datos de entrenamiento, lo que reduce significativamente las alucinaciones).

¿Cuánto tarda la indexación? Para una carpeta típica de 50-100 documentos, la indexación inicial tarda 10-60 segundos. Después, solo los archivos cambiados o nuevos se re-indexan automáticamente, por lo que las actualizaciones son casi instantáneas.

¿Qué modelo de Ollama funciona mejor para RAG?

Para la mayoría de usuarios, Llama o Mistral ofrece el mejor equilibrio entre velocidad y calidad de respuesta. Si tienes menos de 8 GB de RAM, usa Phi. Para el modelo de embeddings, nomic-embed-text es el predeterminado recomendado.

Aprende más sobre Askimo y Ollama

¿Listo para explorar más funciones?

- Askimo con Ollama: El mejor escritorio para IA local - Guía completa para usar Askimo como GUI de Ollama

- Mejores clientes Ollama en 2026 - Compara los principales clientes de escritorio de Ollama

- Configuración del proveedor Ollama - Guía de configuración detallada para Ollama en Askimo

- Documentación técnica RAG - Profundización en la indexación y recuperación RAG

Prueba Askimo hoy: 👉 https://askimo.chat

Dale una estrella al proyecto: 👉 https://github.com/haiphucnguyen/askimo

¿Preguntas o comentarios? Abre un issue en GitHub o únete a nuestras discusiones de la comunidad. ¡Nos encantaría escuchar cómo estás usando RAG con tus documentos!