Bạn đã từng muốn đặt câu hỏi về tài liệu, bài nghiên cứu hay file dự án mà không cần upload lên cloud chưa? RAG (Retrieval-Augmented Generation) với Ollama trong Askimo làm được điều đó. Các mô hình AI cục bộ như Llama, Mistral hay Phi có thể trả lời câu hỏi về PDF, Word, ghi chú và mọi file văn bản - tất cả chạy hoàn toàn trên máy của bạn.

Tóm tắt: Cài Ollama, tải mô hình như

llama3hoặcmistral, tải Askimo, tạo dự án trỏ đến thư mục tài liệu rồi bắt đầu hỏi. File được lập chỉ mục cục bộ và AI tìm thông tin liên quan để trả lời. Không cần internet sau khi cài đặt.

Mới dùng Ollama? Xem hướng dẫn tại sao Askimo là ứng dụng desktop tốt nhất cho Ollama.

Tại sao dùng RAG với Ollama cho tài liệu của bạn?

Vấn đề: AI không biết file của bạn

ChatGPT và các AI tương tự được học từ dữ liệu công khai trên internet, nên rất giỏi kiến thức chung. Nhưng khi áp dụng AI vào công việc thực tế, người dùng gặp nhiều hạn chế:

- Bài nghiên cứu: Không phải một bài mà là 20, 50, hơn 100 bài cần tổng hợp

- Chính sách công ty: Hàng chục tài liệu chính sách, hướng dẫn rải rác

- Tài liệu dự án: Biên bản họp, yêu cầu, đặc tả kỹ thuật phân tán trong nhiều file

- Kiến thức cá nhân: Năm tháng ghi chú và nghiên cứu cần tham khảo

AI thông thường trả lời dựa trên dữ liệu học, không phải file của bạn; có thể bịa thông tin nghe có vẻ thuyết phục (ảo giác); không thể tìm kiếm đồng thời nhiều file; và đòi hỏi upload tài liệu nhạy cảm lên cloud.

Giải pháp: RAG giúp AI cục bộ hiểu tài liệu của bạn

Với RAG, các mô hình Ollama trở thành trợ lý nghiên cứu cá nhân thực sự biết file của bạn:

- Câu trả lời có căn cứ: Tham chiếu tài liệu thực của bạn, không phải thông tin chung

- Ghi nhớ file: AI “nhớ” tất cả tài liệu và nội dung

- Ngữ cảnh tức thì: Tự động lấy thông tin liên quan khi bạn hỏi

- Hoàn toàn riêng tư: Tất cả chạy cục bộ - file không bao giờ rời khỏi máy

RAG hoạt động với Ollama như thế nào

- Lập chỉ mục: File được đọc, chia thành chunk và tổ chức để tìm kiếm nhanh

- Lưu trữ: Chỉ mục nằm trên máy (thường chiếm 10-30% kích thước file)

- Tìm kiếm: Khi bạn hỏi, thông tin liên quan được tìm thấy tự động

- Chèn vào: Các đoạn trích này được hiển thị cho AI trước khi trả lời

- Sinh câu trả lời: Mô hình Ollama dùng ngữ cảnh này để đưa ra câu trả lời chính xác

Tất cả diễn ra cục bộ - không có lời gọi API ngoài nào cho việc lập chỉ mục hay tìm kiếm.

Trường hợp sử dụng thực tế

Nghiên cứu: Tổng hợp nhiều bài báo

You: "What are the main findings across all my climate research papers?"

Llama 3: Based on your papers, three key findings emerge:1. Temperature increases correlate with CO2 levels (mentioned in 12 papers)2. Ocean acidification is accelerating faster than predicted (7 papers)3. Renewable energy adoption is cost-effective (15 papers with economic data)

Sources: climate-change-2023.pdf, renewable-study.docx, ocean-research.pdf [and 9 more]Câu hỏi thực tế bạn có thể hỏi:

- “So sánh phương pháp luận được sử dụng trong các nghiên cứu năng lượng tái tạo của tôi”

- “Tìm các kết luận mâu thuẫn về hiệu suất tấm pin mặt trời”

Viết lách: Quản lý dự án dài

You: "Has Elena ever mentioned being afraid of water in any chapter?"

Mistral: Yes, in chapter 7 Elena mentions she nearly drowned as a child. She alsoavoids the harbor scene in chapter 12 saying "I don't do boats." Your characternotes list this as a key personality trait stemming from her childhood incident.

Sources: chapter-07.docx, chapter-12.docx, character-profiles.mdCông việc: Truy cập nhanh kiến thức công ty

You: "What's our policy on remote work expenses?"

Llama 3: According to the HR Policy Handbook (updated Jan 2026), employees canexpense up to $500/month for home office equipment and $150/month for internet.Receipts must be submitted within 30 days. See section 4.2 for full details.

Source: HR-Policies-2026.pdf (page 23)Cài đặt RAG với Ollama

Bước 1: Cài Ollama

macOS:

brew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | shWindows: Tải bộ cài từ ollama.com/download/windows

Kiểm tra cài đặt:

ollama run llama3Bước 2: Tải mô hình embedding

ollama pull nomic-embed-textBước 3: Tải mô hình chat

# RAM 8GB trở lên - Nhanh và mạnhollama pull llama3

# RAM 16GB trở lên - Tuyệt vời cho câu hỏi phức tạpollama pull mistral

# RAM 4-8GB - Nhẹollama pull phi3Bước 4: Cài Askimo

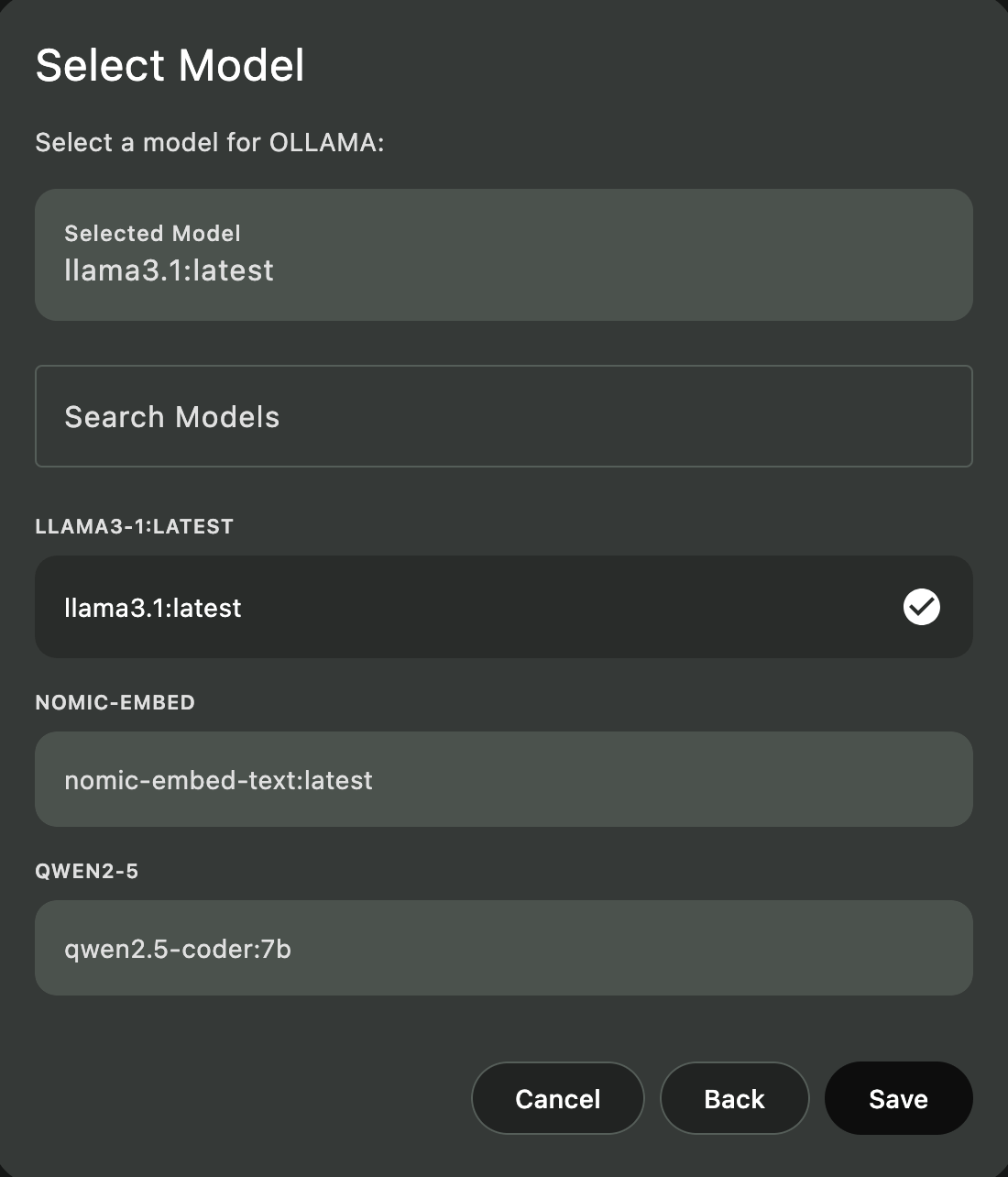

Bước 5: Cấu hình Ollama trong Askimo

- Mở Askimo

- Vào Cài đặt > Nhà cung cấp

- Bật Ollama

- Đặt endpoint:

http://localhost:11434 - Chọn mô hình chat (ví dụ:

llama3) - Đặt mô hình embedding:

nomic-embed-text

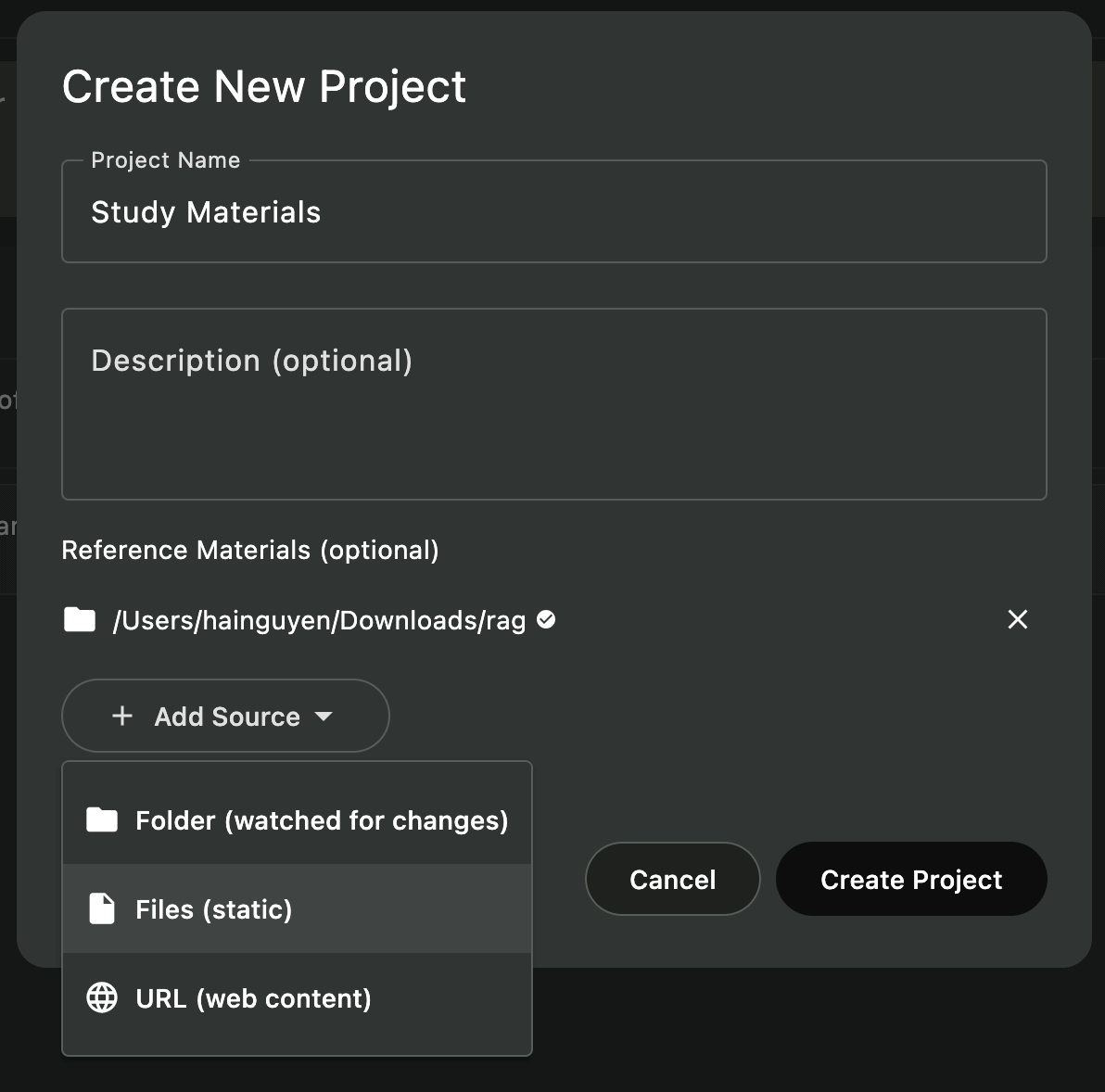

Bước 6: Tạo dự án với RAG

- Nhấn biểu tượng “Dự án” trên thanh bên hoặc

Cmd/Ctrl + P - Nhấn ”+ Dự án mới”, nhập tên, chọn thư mục tài liệu

- Chờ lập chỉ mục tự động (10-60 giây)

- Tạo chat mới trong dự án và bắt đầu đặt câu hỏi

Mẹo: Bạn có thể tạo nhiều dự án cho các mục đích khác nhau - tài liệu công việc, nghiên cứu cá nhân, tài liệu học tập…

File nào được lập chỉ mục

Định dạng được hỗ trợ: .pdf, .docx, .doc, .odt, .xlsx, .xls, .ods, .pptx, .ppt, .txt, .md, .rtf, .eml, .msg, .js, .py, .java, .html, .css, .json, .yaml, .xml

Tự động loại trừ: File ẩn/tạm thời, file trên 5 MB, ảnh/video/âm thanh, file nén (.zip, .rar, .tar)

Tính năng RAG nâng cao

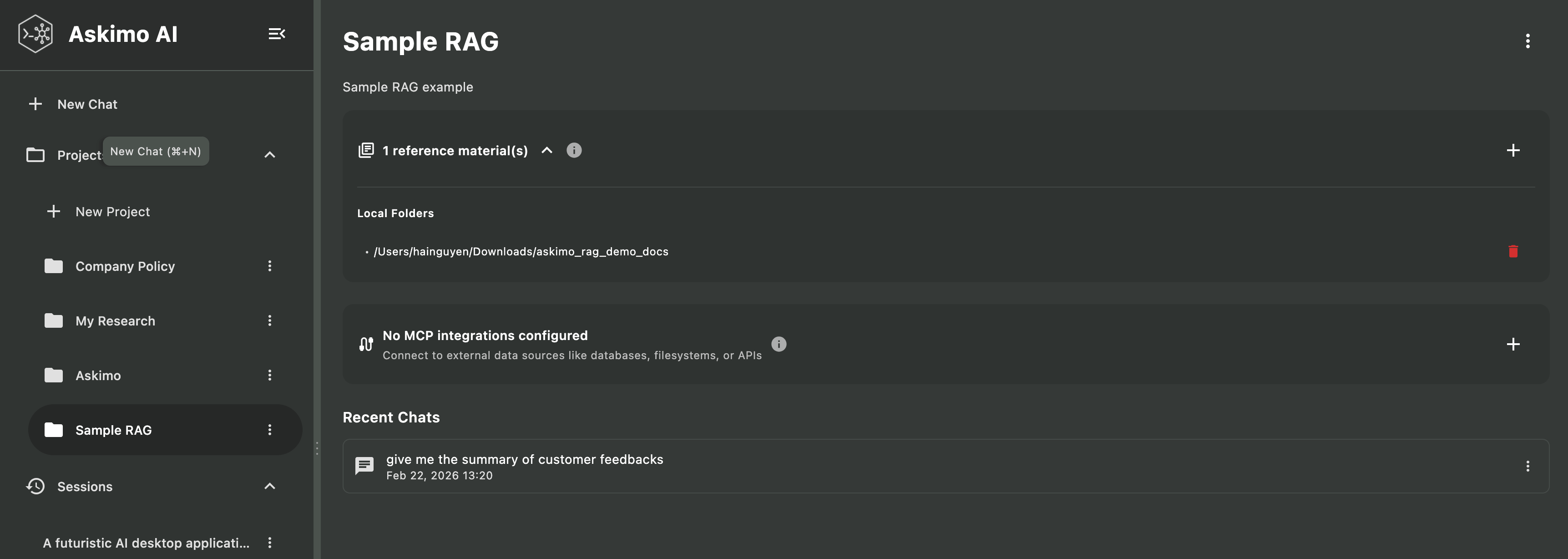

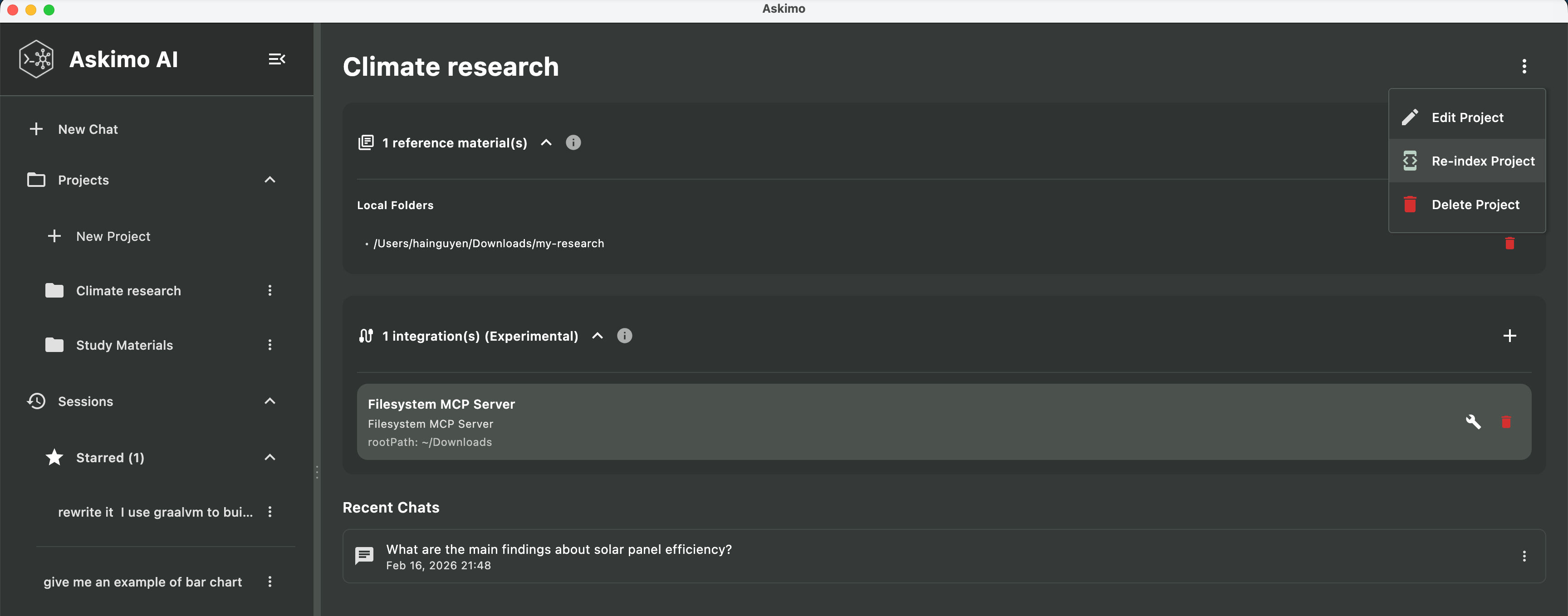

Nhiều dự án cho các chủ đề khác nhau

- Tài liệu công việc: Báo cáo, biên bản họp, file khách hàng

- Nghiên cứu cá nhân: Sở thích, tài liệu học tập

- Nghiên cứu học thuật: Bài nghiên cứu, tài liệu học, ghi chú luận văn

- Dự án sáng tạo: Bản thảo, ghi chú ý tưởng

Cập nhật tự động

- File thay đổi: Lập chỉ mục lại chỉ file đó

- File thêm mới: Thêm vào chỉ mục

- File xóa: Loại khỏi chỉ mục

Mô hình embedding tùy chỉnh

ollama pull mxbai-embed-large# Thay đổi trong Cài đặt > Nhà cung cấp > OllamaMẹo hiệu năng

| Bộ nhớ máy | Mô hình khuyến nghị | Tốt nhất cho |

|---|---|---|

| 4-8 GB | phi3 | Câu hỏi nhanh, tài liệu đơn giản |

| 8-16 GB | llama3 | Sử dụng chung, nghiên cứu, viết lách |

| 16+ GB | mistral | Phân tích phức tạp, tài liệu dài |

| 32+ GB | deepseek-coder | Bộ sưu tập tài liệu lớn |

RAG vs. Tìm kiếm tài liệu truyền thống

| Tính năng | Tìm kiếm File Explorer | Tìm kiếm trong PDF | Askimo RAG + Ollama |

|---|---|---|---|

| Tìm từ khóa | Co ban | Nhanh | Tức thì trên tất cả file |

| Tìm kiếm ngữ nghĩa | Không | Không | Hiểu ý nghĩa |

| Ngôn ngữ tự nhiên | Không | Không | Đặt câu hỏi tự nhiên |

| Đa tài liệu | Từng file | Từng file | Tìm tất cả cùng lúc |

| Sinh câu trả lời | Không | Không | Giải thích và tóm tắt |

| Quyền riêng tư | Cục bộ | Cục bộ | Hoàn toàn cục bộ |

Quyền riêng tư và bảo mật

- Lập chỉ mục: Chạy trên máy bạn bằng Lucene

- Embedding: Tạo cục bộ bởi Ollama

- Chat: Mô hình Ollama chạy trên phần cứng của bạn

- Lưu trữ: File chỉ mục ở

~/.askimo/

Hoạt động hoàn toàn offline. Không có dữ liệu nào rời khỏi máy bạn.

Xử lý sự cố

”AI có vẻ không biết tài liệu của tôi”

- Kiểm tra trạng thái lập chỉ mục trong giao diện dự án

- Thử lập chỉ mục lại: Cài đặt dự án > “Lập chỉ mục lại dự án”

- Đảm bảo dùng định dạng file được hỗ trợ (file trên 5 MB bị bỏ qua)

Lập chỉ mục chậm

- Kiên nhẫn - lập chỉ mục lần đầu tốn thời gian nhưng chỉ xảy ra một lần

- Cập nhật sau đó nhanh hơn nhiều (chỉ lập chỉ mục lại file thay đổi)

- Cân nhắc tổ chức thành dự án nhỏ hơn nếu có hơn 10.000 file

Hết bộ nhớ

- Dùng mô hình nhỏ hơn (

phi3thay vìmistral) - Đóng các ứng dụng tiêu tốn nhiều bộ nhớ

- Khởi động lại máy để giải phóng bộ nhớ

Cần thêm trợ giúp? Đặt câu hỏi trong thảo luận GitHub.

Bạn có thể làm gì với RAG

- Nghiên cứu: Tìm thông tin nhanh trong hàng chục bài báo và bài viết

- Viết lách: Theo dõi nhân vật, cốt truyện và nghiên cứu cho sách

- Học tập: Học hiệu quả hơn bằng cách hỏi về ghi chú và tài liệu

- Công việc: Tìm thông tin trong báo cáo, biên bản họp và tài liệu dự án

- Cá nhân: Tổ chức công thức, nghiên cứu du lịch, ghi chú sở thích

Tất cả trong khi giữ tài liệu riêng tư và cục bộ - không có gì rời khỏi máy.

Câu hỏi thường gặp

RAG với Ollama có hoạt động offline không? Có, hoàn toàn. Sau khi tải mô hình và lập chỉ mục dự án, mọi thứ chạy không cần internet. Không có lời gọi API ngoài ở bất kỳ bước nào.

Dữ liệu của tôi có riêng tư khi dùng RAG với Ollama không? Có. Tài liệu không bao giờ rời khỏi máy. Lập chỉ mục bằng Apache Lucene cục bộ, embedding tạo bởi mô hình Ollama cục bộ, và mô hình chat chạy trên phần cứng của bạn. Không gì được gửi lên cloud.

Askimo RAG hỗ trợ định dạng file nào? PDF, Word (.docx, .doc), bảng tính (.xlsx, .xls), trình chiếu (.pptx), văn bản thuần, Markdown, RTF, email và file source code. File trên 5 MB và file nhị phân tự động bị loại trừ.

RAG với Ollama khác gì so với upload tài liệu lên ChatGPT? Ba điểm khác biệt chính: quyền riêng tư (file không rời khỏi máy), quy mô (RAG tìm kiếm hàng trăm tài liệu đồng thời), và độ chính xác (câu trả lời dựa trên tài liệu thực của bạn, giảm đáng kể ảo giác).

Lập chỉ mục mất bao lâu? Với thư mục điển hình 50-100 tài liệu, lập chỉ mục lần đầu mất 10-60 giây. Sau đó chỉ file thay đổi hoặc mới được lập chỉ mục lại tự động.

Mô hình Ollama nào tốt nhất cho RAG?

Với hầu hết người dùng, Llama hoặc Mistral cân bằng tốt nhất tốc độ và chất lượng. Nếu RAM dưới 8GB, dùng Phi. Cho embedding, nomic-embed-text là mặc định được khuyến nghị.

Tìm hiểu thêm về Askimo và Ollama

- Askimo với Ollama: Desktop tốt nhất cho AI cục bộ

- Các client Ollama tốt nhất 2026

- Cài đặt nhà cung cấp Ollama

- Tài liệu kỹ thuật RAG

Dùng thử Askimo ngay hôm nay: 👉 https://askimo.chat

Đặt sao cho dự án: 👉 https://github.com/haiphucnguyen/askimo

Câu hỏi hoặc phản hồi? Mở issue trên GitHub hoặc tham gia thảo luận cộng đồng.