문서, 연구 논문, 프로젝트 파일을 클라우드에 업로드하지 않고 AI에게 질문하고 싶은 적 있으신가요? Askimo의 Ollama 기반 RAG(검색 증강 생성)가 그것을 가능하게 합니다. Llama, Mistral, Phi 같은 로컬 AI 모델이 PDF, Word 문서, 메모, 텍스트 파일에 답해줍니다. 모두 기기에서 완전히 실행됩니다.

요약: Ollama 설치 후

llama3또는mistral모델을 pull하고 Askimo를 다운로드하세요. 문서 폴더를 가리키는 프로젝트를 만들면 질문을 시작할 수 있습니다. 설정 후 인터넷은 필요 없습니다.

Ollama가 처음이라면 Askimo가 최고의 Ollama 데스크톱 앱인 이유를 확인하세요.

문서에 Ollama와 RAG를 사용하는 이유

문제: AI는 내 파일을 모른다

ChatGPT 같은 AI는 인터넷 공개 데이터로 학습되어 일반 지식은 잘 답합니다. 하지만 실제 업무에 적용하면 벽에 부딪힙니다.

한계:

- 연구 논문: 논문이 20~100개 이상이라 종합 분석이 필요합니다

- 회사 정책: 수십 개의 정책 문서, 매뉴얼, 가이드가 있습니다

- 프로젝트 문서: 회의록, 요구사항, 기술 사양이 파일에 분산되어 있습니다

- 개인 지식: 수년간의 메모와 연구를 참조하고 싶습니다

일반 AI는 내 파일이 아닌 학습 데이터로 답하고, 없는 정보를 만들어내기도 하며, 여러 파일에 걸친 질문에 답하지 못합니다. 민감한 문서를 클라우드에 올려야 하는 프라이버시 문제도 있습니다.

해결책: RAG가 로컬 AI를 문서 인식형으로 만든다

RAG를 사용하면 Ollama 모델이 실제로 내 파일을 아는 개인 리서치 어시스턴트가 됩니다:

- 근거 있는 답변: 일반 정보가 아닌 실제 문서 참조

- 파일 기억: AI가 모든 문서와 내용을 “기억”

- 즉각적 컨텍스트: 질문 시 관련 정보를 자동 검색

- 완전한 프라이버시: 모두 로컬 실행 - 파일이 기기를 벗어나지 않음

자세히 알아보기: 2026년 최고의 Ollama 클라이언트 가이드를 참고하세요.

Ollama에서 RAG 작동 방식

프로젝트를 만들고 RAG를 활성화하면:

- 인덱싱: 파일을 읽어 청크로 분할하고 고속 검색을 위해 정리

- 저장: 인덱스가 기기에 저장 (파일 크기의 약 10-30%)

- 검색: 질문하면 관련 정보를 자동으로 찾음

- 주입: 스니펫이 AI에게 답변 전에 제공됨

- 생성: Ollama 모델이 컨텍스트를 사용해 정확한 답변 생성

모든 과정이 로컬에서 진행됩니다. 외부 API 호출 없음.

실제 활용 사례

연구: 여러 논문 종합

You: "What are the main findings across all my climate research papers?"

Llama 3: Based on your papers, three key findings emerge:1. Temperature increases correlate with CO2 levels (mentioned in 12 papers)2. Ocean acidification is accelerating faster than predicted (7 papers)3. Renewable energy adoption is cost-effective (15 papers with economic data)

Sources: climate-change-2023.pdf, renewable-study.docx, ocean-research.pdf [and 9 more]가능한 질문 예시:

- “재생에너지 연구에서 사용된 방법론을 비교해줘”

- “태양광 패널 효율에 관한 상충되는 결론을 찾아줘”

집필: 장편 프로젝트 관리

You: "Has Elena ever mentioned being afraid of water in any chapter?"

Mistral: Yes, in chapter 7 Elena mentions she nearly drowned as a child. She alsoavoids the harbor scene in chapter 12 saying "I don't do boats." Your characternotes list this as a key personality trait stemming from her childhood incident.

Sources: chapter-07.docx, chapter-12.docx, character-profiles.md업무: 회사 지식에 빠르게 접근

You: "What's our policy on remote work expenses?"

Llama 3: According to the HR Policy Handbook (updated Jan 2026), employees canexpense up to $500/month for home office equipment and $150/month for internet.Receipts must be submitted within 30 days. See section 4.2 for full details.

Source: HR-Policies-2026.pdf (page 23)Ollama로 RAG 설정하기

1단계: Ollama 설치

macOS:

brew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | shWindows: https://ollama.com/download/windows 에서 설치 프로그램 다운로드

설치 테스트:

ollama run llama32단계: 임베딩 모델 pull

ollama pull nomic-embed-text3단계: 채팅 모델 pull

# RAM 8GB 이상 - 빠르고 강력ollama pull llama3

# RAM 16GB 이상 - 복잡한 질문에 탁월ollama pull mistral

# RAM 4-8GB - 가벼운 모델ollama pull phi34단계: Askimo 설치

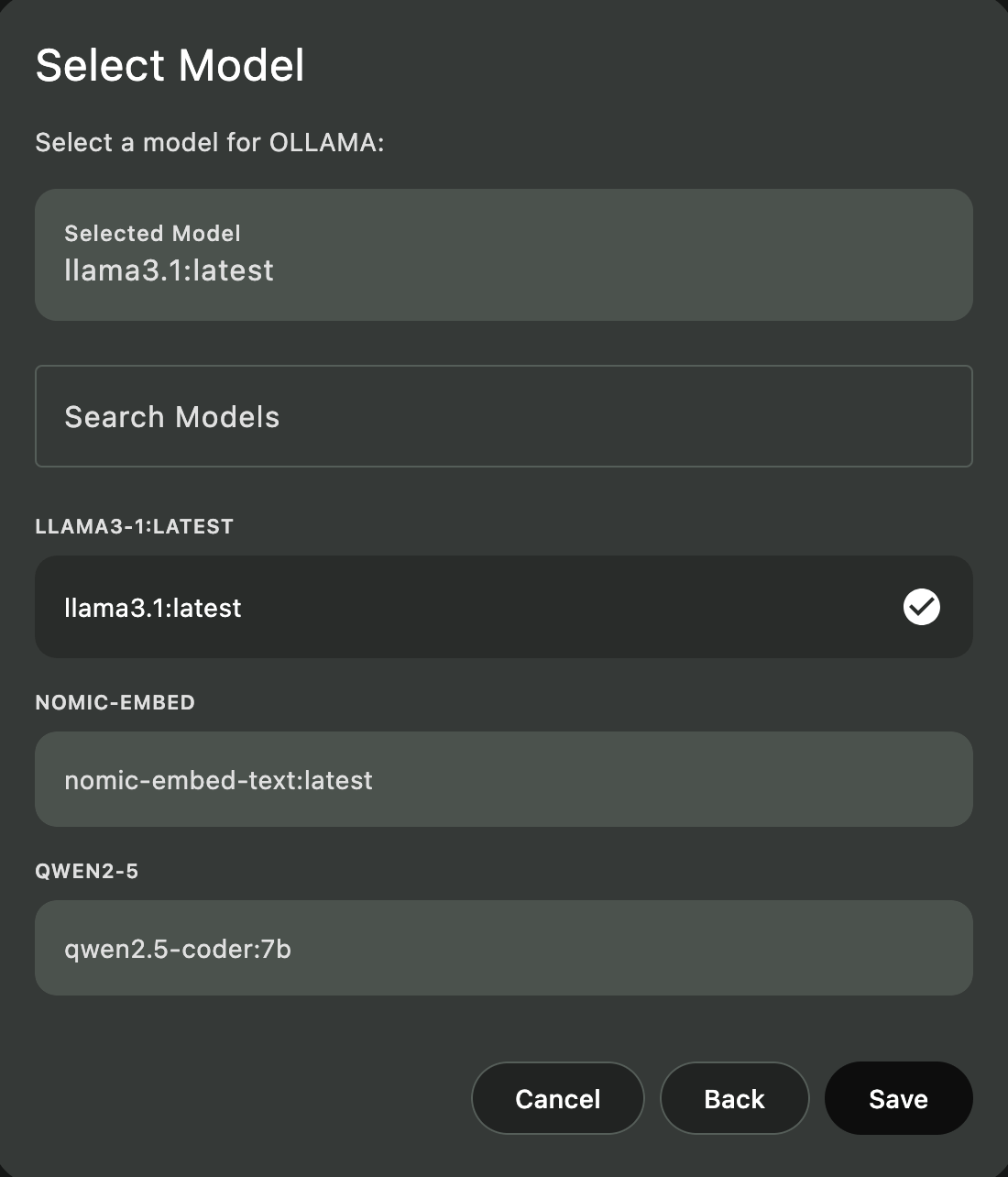

5단계: Askimo에서 Ollama 설정

- Askimo 열기

- 설정 > 공급자 이동

- Ollama 활성화

- 엔드포인트:

http://localhost:11434 - 채팅 모델 선택 (예:

llama3) - 임베딩 모델:

nomic-embed-text

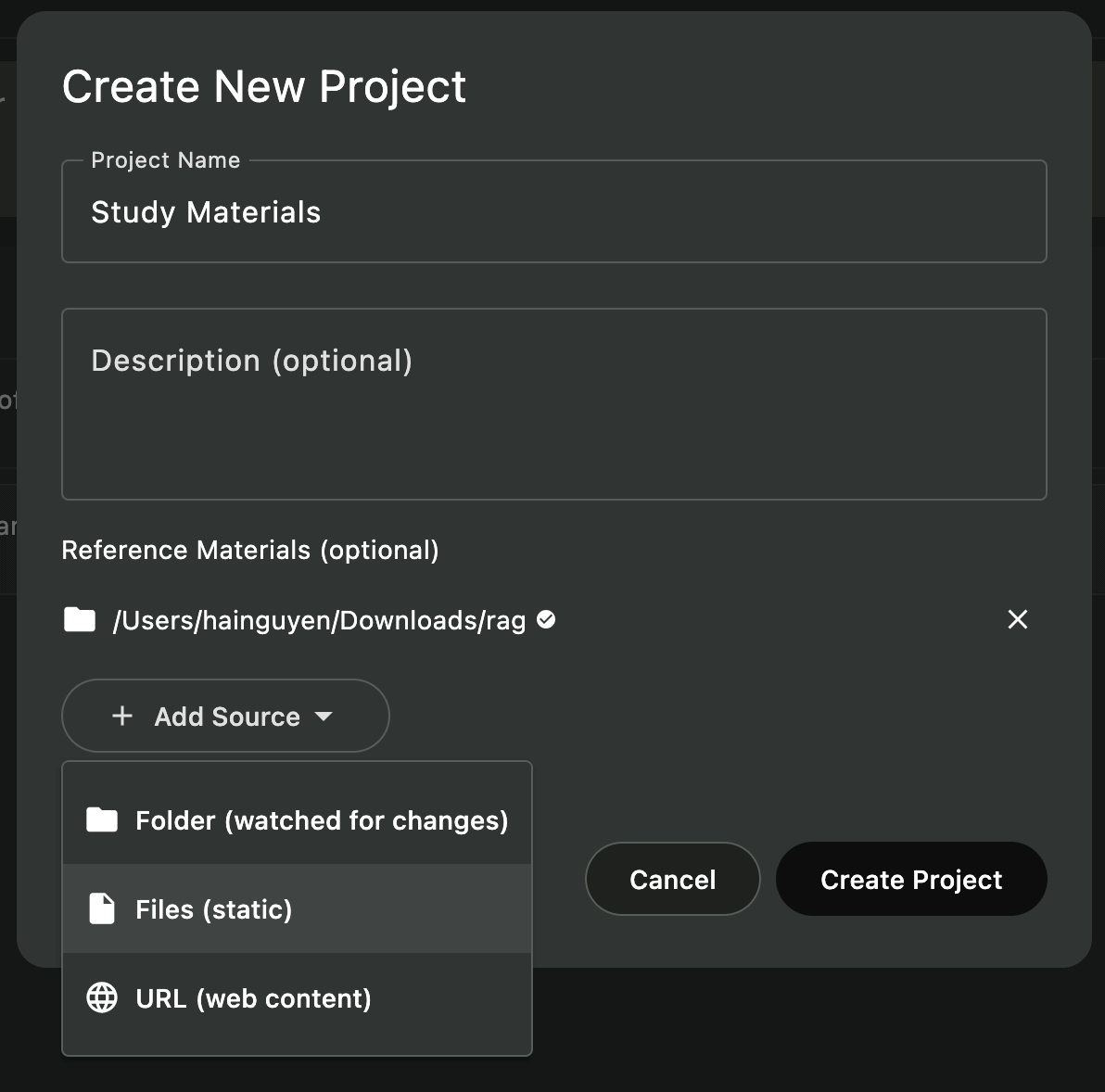

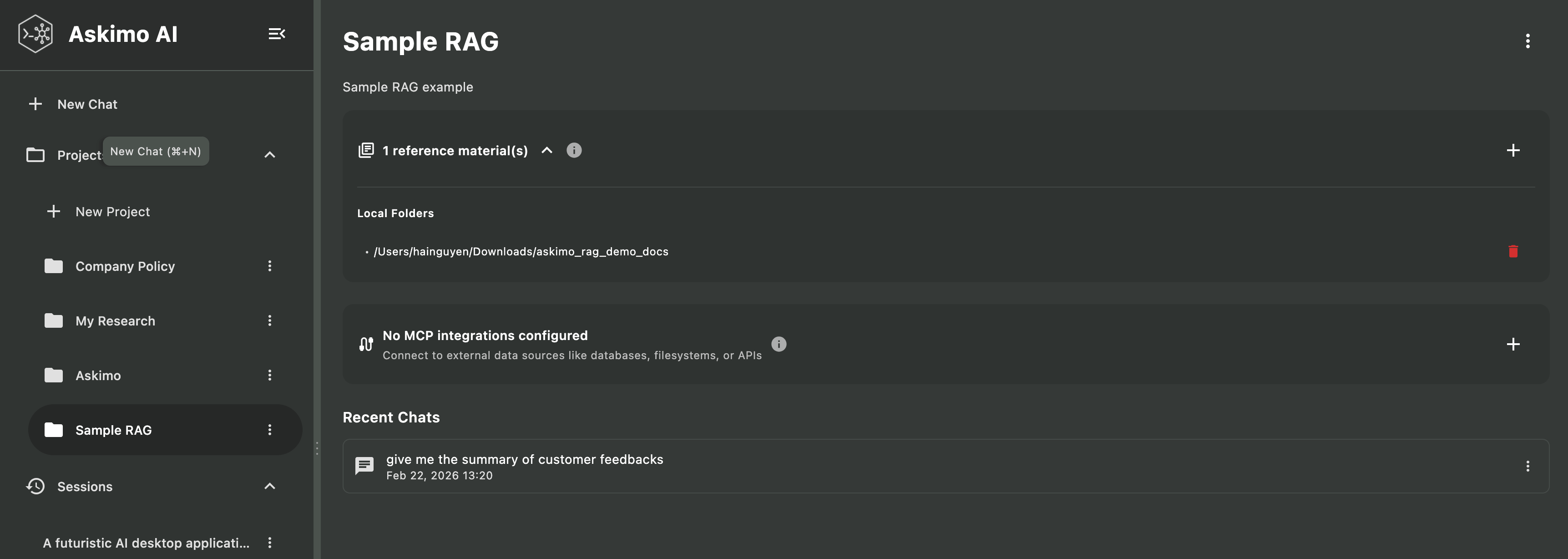

6단계: RAG 프로젝트 생성

- 사이드바의 “프로젝트” 아이콘 클릭 or

Cmd/Ctrl + P - ”+ 새 프로젝트” 클릭 후 이름 입력, 문서 폴더 선택

- 자동 인덱싱 완료 대기 (10-60초)

- 프로젝트 내 새 채팅 생성 후 질문 시작

팁: 업무 문서, 개인 연구, 학습 자료 등 목적별로 여러 프로젝트를 만들 수 있습니다.

인덱싱 대상 파일

포함 형식: .pdf, .docx, .doc, .odt, .xlsx, .xls, .ods, .pptx, .ppt, .txt, .md, .rtf, .eml, .msg, .js, .py, .java, .html, .css, .json, .yaml, .xml

자동 제외: 숨김/임시 파일, 5MB 초과 파일, 이미지/동영상/오디오, 압축 파일(.zip, .rar, .tar)

고급 RAG 기능

주제별 여러 프로젝트

- 업무 문서: 비즈니스 보고서, 회의록, 클라이언트 파일

- 개인 연구: 취미, 관심사, 학습 자료

- 학술 연구: 연구 논문, 학습 자료, 논문 메모

- 크리에이티브 프로젝트: 글쓰기 초안, 아이디어 메모

각 프로젝트는 독립된 인덱스를 가져 쿼리가 관련 문서만 검색합니다.

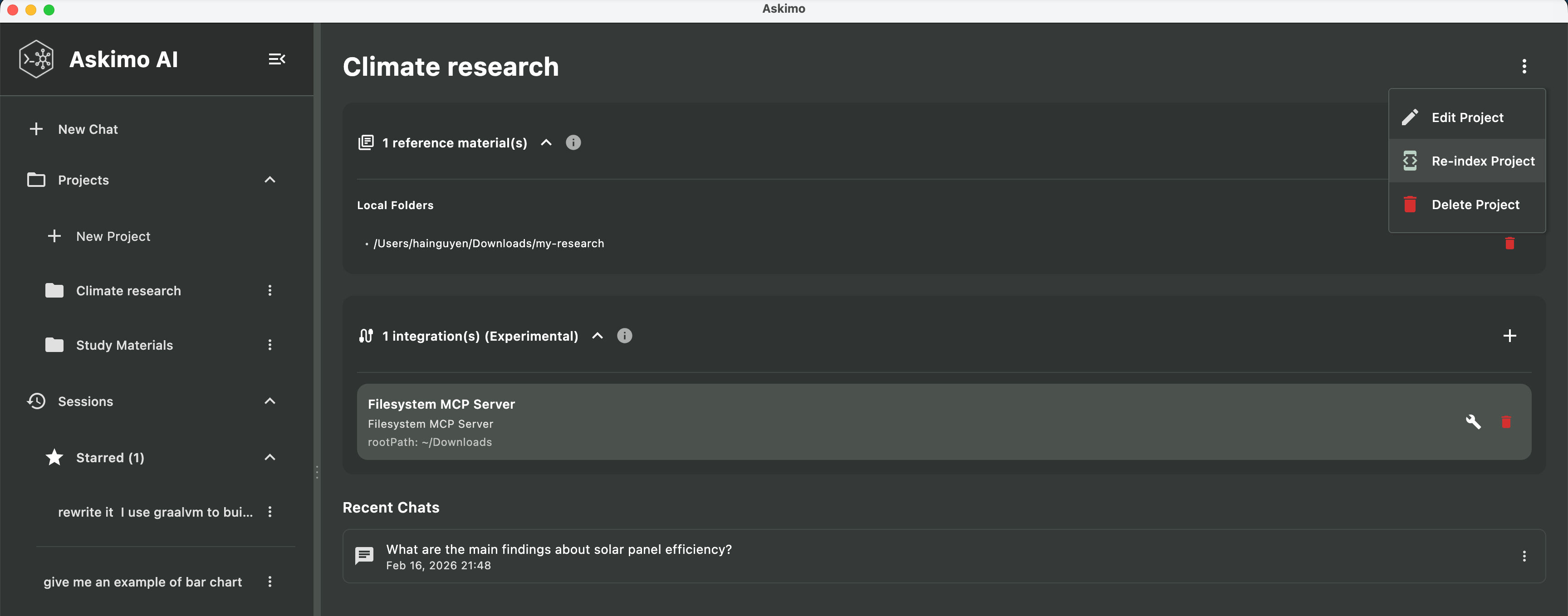

자동 업데이트

파일 변경, 추가, 삭제 시 자동 재인덱싱. 수동 작업 불필요.

사용자 정의 임베딩 모델

# 전문 임베딩 모델 pullollama pull mxbai-embed-large# Askimo 설정 > 공급자 > Ollama에서 임베딩 모델 변경성능 팁

기기에 맞는 모델 선택

| 메모리 | 권장 모델 | 최적 용도 |

|---|---|---|

| 4-8 GB | phi3 | 빠른 질문, 간단한 문서 |

| 8-16 GB | llama3 | 일반 사용, 연구, 글쓰기 |

| 16+ GB | mistral | 복잡한 분석, 긴 문서 |

| 32+ GB | deepseek-coder | 대용량 문서 컬렉션 |

구체적인 질문하기

- X “이 프로젝트에 대해 알려줘”

- O “기후 연구 논문의 주요 발견은 무엇인가요?”

RAG vs. 전통적인 문서 검색

| 기능 | 파일 탐색기 | PDF 리더 | Askimo RAG + Ollama |

|---|---|---|---|

| 키워드 검색 | 기본 | 빠름 | 전체 파일에서 즉시 |

| 시맨틱 검색 | 없음 | 없음 | 의미 이해 |

| 자연어 질문 | 없음 | 없음 | 가능 |

| 교차 문서 | 한 번에 하나 | 한 번에 하나 | 모든 문서 동시 검색 |

| 답변 생성 | 없음 | 없음 | 설명 및 요약 |

| 프라이버시 | 로컬 | 로컬 | 완전 로컬 |

프라이버시 및 보안

- 인덱싱: Lucene으로 로컬 실행

- 임베딩: Ollama로 로컬 생성

- 채팅: Ollama 모델이 내 하드웨어에서 실행

- 저장: 인덱스 파일은

~/.askimo/에 보관

모델 다운로드 후에는 완전 오프라인 동작. 어떤 데이터도 기기를 벗어나지 않습니다.

문제 해결

”AI가 내 문서를 모르는 것 같을 때”

- 인덱싱 완료 여부 확인

- 재인덱싱: 프로젝트 설정 > “프로젝트 재인덱싱”

- 지원 파일 형식인지 확인 (5MB 초과 파일은 건너뜀)

인덱싱이 느릴 때

- 초기 인덱싱은 한 번만 필요하므로 기다리세요

- 이후 업데이트는 변경된 파일만 재인덱싱하므로 빠릅니다

- 파일이 10,000개 이상이면 더 작은 프로젝트로 분할을 고려하세요

메모리 부족 시

- 더 작은 모델 사용 (

mistral대신phi3) - 다른 메모리 집약적 앱 종료

- 컴퓨터 재시작으로 메모리 확보

더 도움이 필요하면 GitHub 토론에 질문하세요.

RAG로 할 수 있는 것들

- 연구: 수십 개의 논문과 기사에서 빠르게 정보 검색

- 글쓰기: 소설의 캐릭터, 플롯, 연구 자료 추적

- 학습: 메모와 자료에 질문하며 효과적으로 공부

- 업무: 보고서, 회의록, 프로젝트 문서에서 정보 검색

- 개인: 레시피, 여행 연구, 취미 메모 정리

모든 문서가 프라이빗하고 로컬로 유지됩니다.

자주 묻는 질문

Ollama RAG는 오프라인으로 동작하나요? 네, 완전히 동작합니다. 모델 다운로드와 프로젝트 인덱싱 후에는 인터넷 없이 모든 것이 실행됩니다. 외부 API 호출이 없습니다.

RAG 사용 시 내 데이터는 안전한가요? 네. 문서는 절대 기기를 벗어나지 않습니다. 인덱싱은 Apache Lucene으로, 임베딩은 로컬 Ollama로, 채팅도 내 하드웨어에서 실행됩니다. 클라우드로 전송되는 것은 없습니다.

지원 파일 형식은? PDF, Word(.docx, .doc), 스프레드시트(.xlsx, .xls), 프레젠테이션(.pptx), 텍스트, Markdown, RTF, 이메일, 소스 코드. 5MB 초과와 바이너리 파일은 자동 제외됩니다.

ChatGPT 파일 업로드와 어떻게 다른가요? 세 가지 차이점: 프라이버시(파일이 기기를 벗어나지 않음), 규모(수백 개 문서를 동시에 검색, 하나가 아님), 정확성(실제 문서 기반 답변으로 환각 현상 크게 감소).

인덱싱은 얼마나 걸리나요? 50-100개 문서는 10-60초. 이후 변경/신규 파일만 자동 재인덱싱되어 업데이트는 즉각적입니다.

RAG에 가장 좋은 Ollama 모델은?

Llama 또는 Mistral이 속도와 품질의 최적 균형. RAM 8GB 미만이면 Phi 사용. 임베딩은 nomic-embed-text가 기본 권장입니다.

Askimo와 Ollama 더 알아보기

오늘 Askimo를 사용해보세요: 👉 https://askimo.chat

GitHub에서 별표를: 👉 https://github.com/haiphucnguyen/askimo

질문 또는 피드백? GitHub에서 이슈를 열거나 커뮤니티 토론에 참여하세요.