Voce ja quis fazer perguntas sobre seus documentos, artigos de pesquisa ou arquivos de projeto sem precisar fazer upload para a nuvem? O RAG (Recuperacao Aumentada por Geracao) com Ollama no Askimo torna isso possivel. Modelos de IA locais como Llama, Mistral ou Phi podem responder perguntas sobre seus PDFs, documentos Word, notas e qualquer arquivo de texto - tudo rodando completamente na sua maquina.

TL;DR: Instale o Ollama, baixe um modelo como

llama3oumistral, baixe o Askimo, crie um projeto apontando para sua pasta de documentos e comece a fazer perguntas. Seus arquivos sao indexados localmente e a IA recupera informacoes relevantes para responder suas perguntas. Sem internet apos a configuracao.

Novo no Ollama? Leia nosso guia sobre por que o Askimo e o melhor app de desktop para Ollama.

Por que usar RAG com Ollama para seus documentos?

O problema: a IA nao conhece seus arquivos

Quando o ChatGPT surgiu, era revolucionario para perguntas gerais. Mas ao tentar aplicar IA ao trabalho real, os usuarios encontraram limitacoes:

- Artigos de pesquisa: Voce nao tem um artigo - tem 20, 50 ou 100+ para sintetizar

- Politicas da empresa: Dezenas de documentos de politica, manuais e guias

- Documentacao de projetos: Notas de reuniao, requisitos, especificacoes dispersas

- Conhecimento pessoal: Anos de notas e pesquisas acumuladas

A IA responde com base em dados de treinamento da internet, nao do que esta nos seus arquivos. Pode inventar informacoes plausively incorretas (alucinacoes), nao consegue buscar em multiplos arquivos simultaneamente, e exige upload de documentos sensiveis para a nuvem.

A solucao: RAG torna a IA local consciente dos documentos

Com RAG, os modelos Ollama se tornam seu assistente de pesquisa pessoal que realmente conhece seus arquivos:

- Respostas fundamentadas: Referenciam seus documentos reais, nao informacoes genericas

- Memoria de arquivos: A IA “lembra” de todos os seus documentos e seu conteudo

- Contexto instantaneo: Recupera automaticamente informacoes relevantes

- Privacidade completa: Tudo roda localmente - seus arquivos nunca saem da sua maquina

Como o RAG funciona com Ollama

- Indexacao: Seus arquivos sao lidos, divididos em pedacos e organizados para busca rapida

- Armazenamento: O indice fica na sua maquina (geralmente 10-30% do tamanho dos arquivos)

- Recuperacao: Quando voce faz uma pergunta, informacoes relevantes sao encontradas automaticamente

- Injecao: Esses trechos sao mostrados a IA antes de ela responder

- Geracao: Os modelos Ollama usam esse contexto para dar respostas precisas e especificas

Tudo acontece localmente - sem chamadas a APIs externas.

Casos de uso do mundo real

Pesquisa: Sintese de multiplos artigos

You: "What are the main findings across all my climate research papers?"

Llama 3: Based on your papers, three key findings emerge:1. Temperature increases correlate with CO2 levels (mentioned in 12 papers)2. Ocean acidification is accelerating faster than predicted (7 papers)3. Renewable energy adoption is cost-effective (15 papers with economic data)

Sources: climate-change-2023.pdf, renewable-study.docx, ocean-research.pdf [and 9 more]Escrita: Gerenciamento de projetos de formato longo

You: "Has Elena ever mentioned being afraid of water in any chapter?"

Mistral: Yes, in chapter 7 Elena mentions she nearly drowned as a child. She alsoavoids the harbor scene in chapter 12 saying "I don't do boats." Your characternotes list this as a key personality trait stemming from her childhood incident.

Sources: chapter-07.docx, chapter-12.docx, character-profiles.mdTrabalho: Acesso rapido ao conhecimento da empresa

You: "What's our policy on remote work expenses?"

Llama 3: According to the HR Policy Handbook (updated Jan 2026), employees canexpense up to $500/month for home office equipment and $150/month for internet.Receipts must be submitted within 30 days. See section 4.2 for full details.

Source: HR-Policies-2026.pdf (page 23)Configurando RAG com Ollama

Passo 1: Instalar o Ollama

macOS:

brew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | shWindows: Baixe o instalador em ollama.com/download/windows

Teste a instalacao:

ollama run llama3Passo 2: Baixar um modelo de embeddings

ollama pull nomic-embed-textPasso 3: Baixar um modelo de chat

# Para 8GB+ de RAM - Rapido e capazollama pull llama3

# Para 16GB+ de RAM - Excelente para perguntas complexasollama pull mistral

# Para 4-8GB de RAM - Leveollama pull phi3Passo 4: Instalar o Askimo

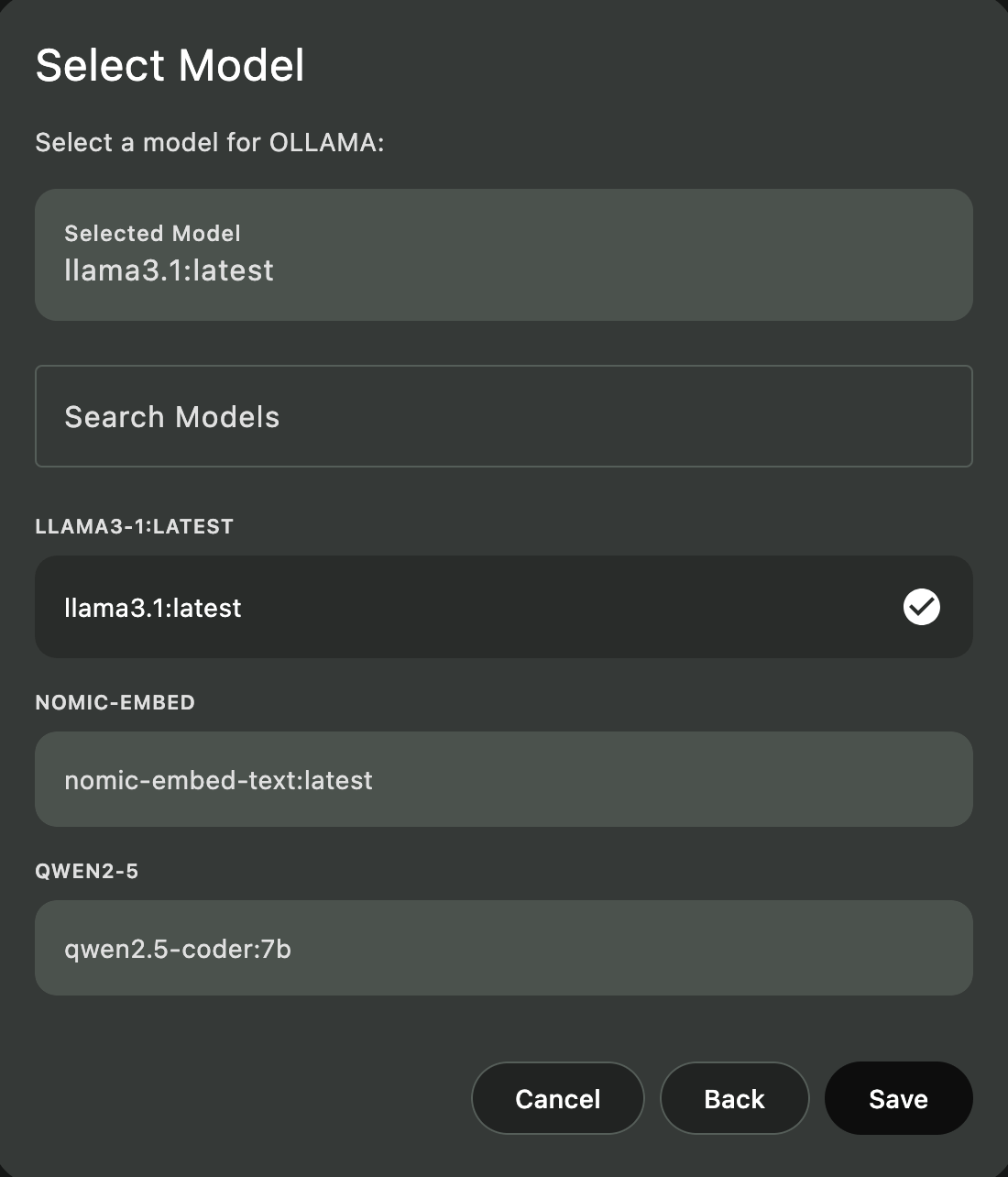

Passo 5: Configurar Ollama no Askimo

- Abra o Askimo

- Va para Configuracoes > Provedores

- Ative Ollama

- Defina o endpoint como

http://localhost:11434 - Selecione seu modelo de chat (ex.

llama3) - Defina o modelo de embeddings como

nomic-embed-text

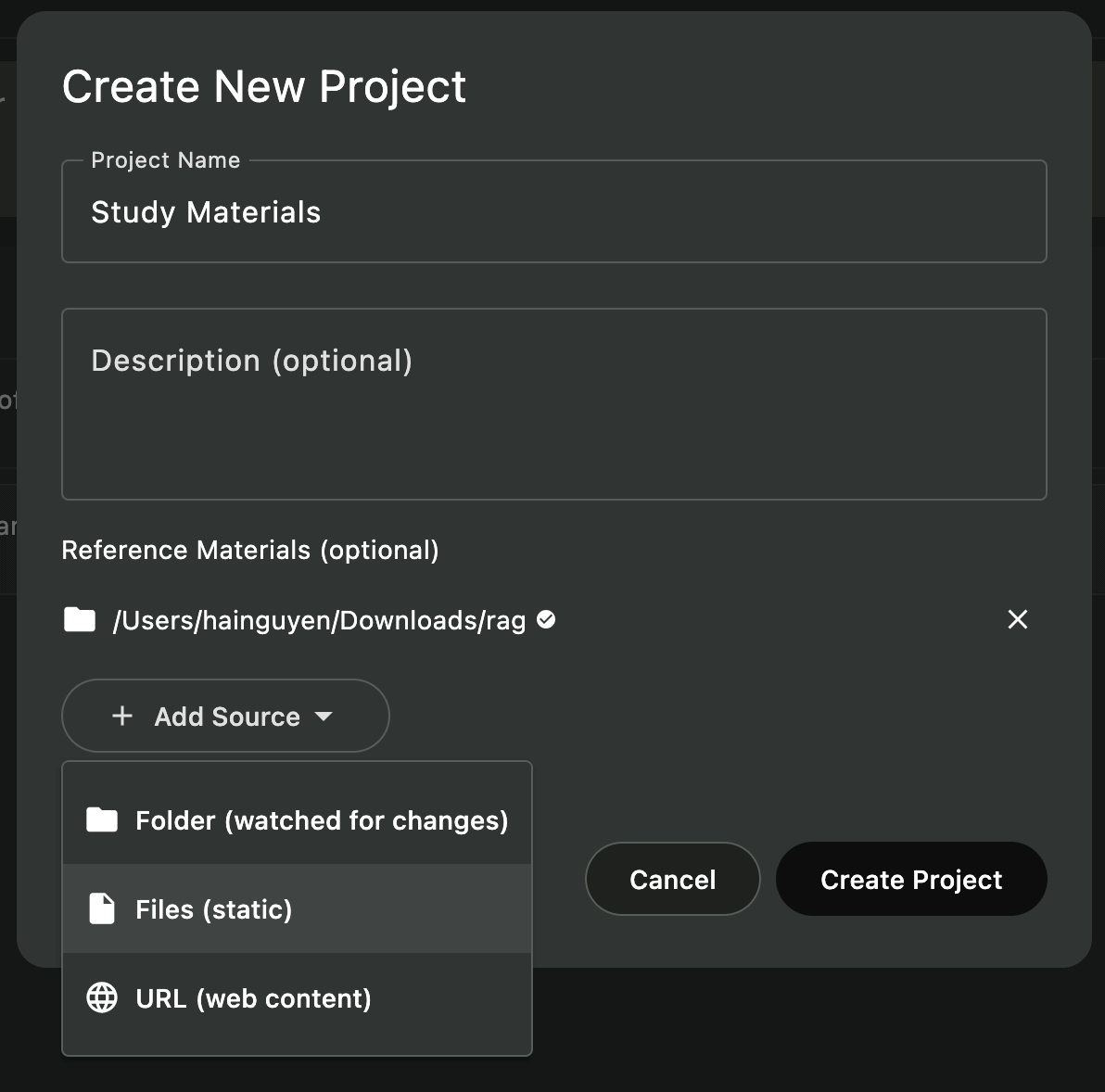

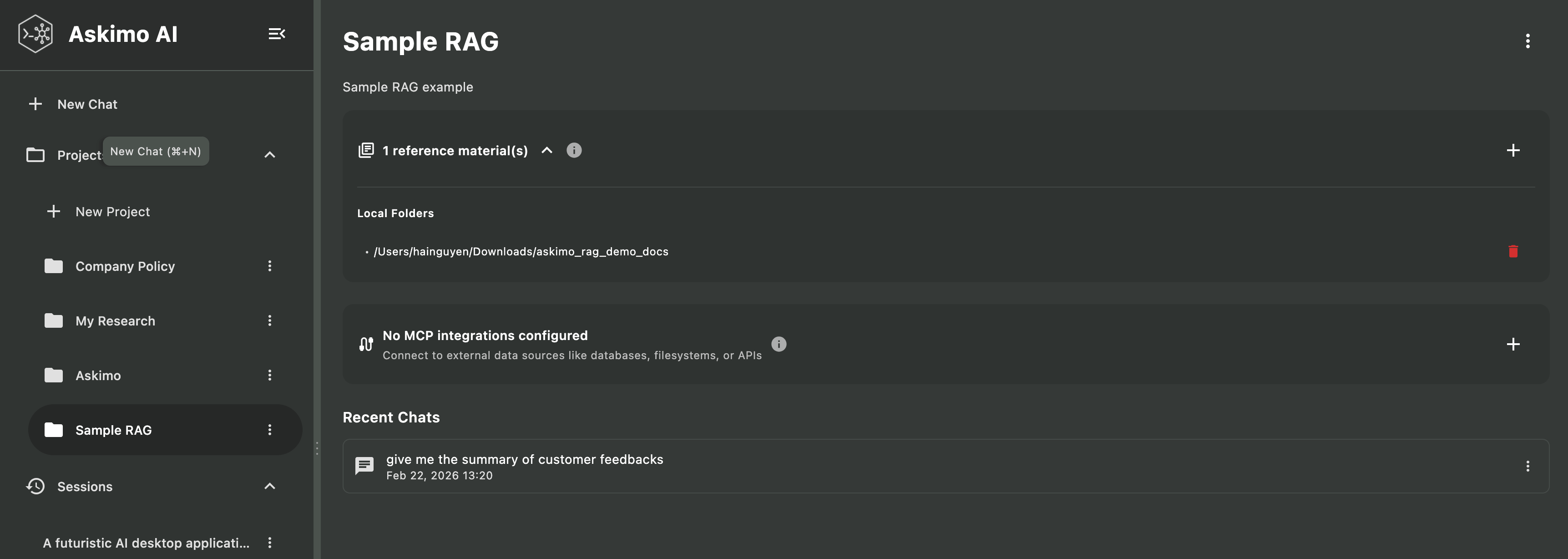

Passo 6: Criar um projeto com RAG

- Clique no icone “Projetos” na barra lateral ou use

Cmd/Ctrl + P - Clique em ”+ Novo Projeto”, insira um nome, selecione sua pasta de documentos

- Aguarde a indexacao automatica (10-60 segundos)

- Crie um novo chat no projeto e comece a fazer perguntas

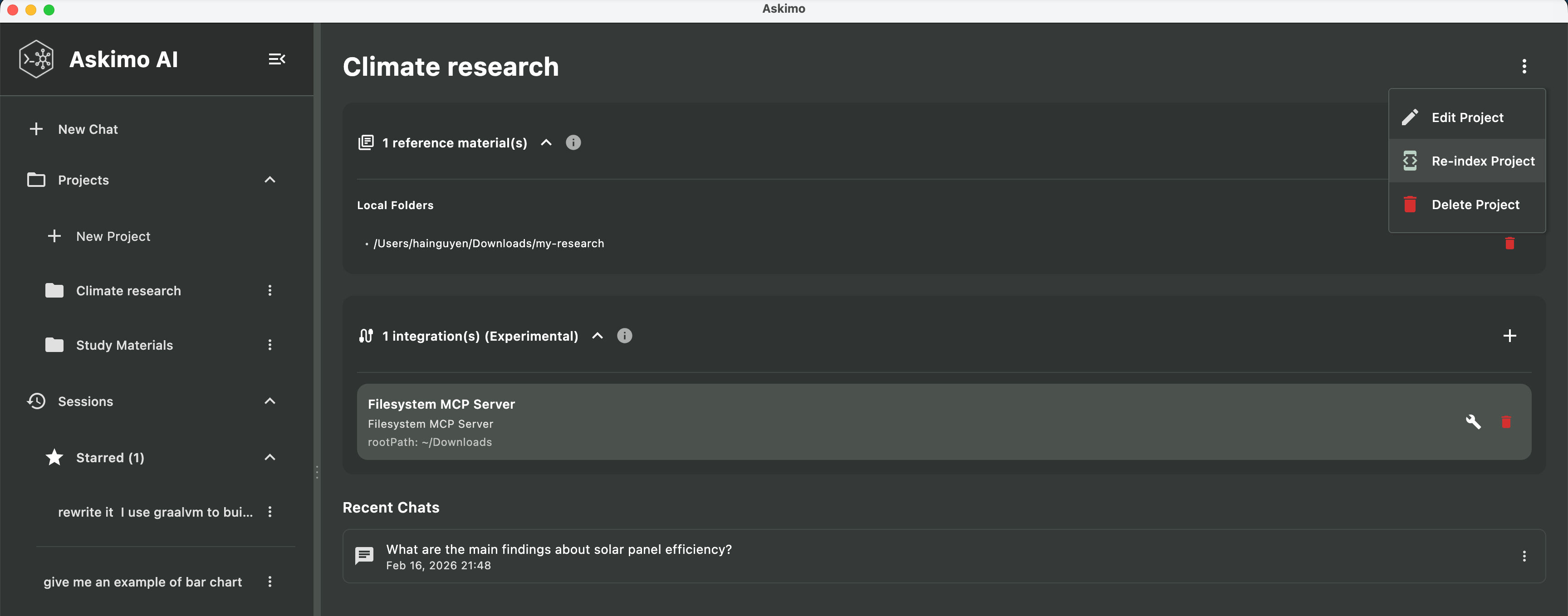

Dica profissional: Crie multiplos projetos para diferentes propositos - trabalho, pesquisa pessoal, materiais de estudo, etc.

O que e indexado

Formatos incluidos: .pdf, .docx, .doc, .odt, .xlsx, .xls, .ods, .pptx, .ppt, .txt, .md, .rtf, .eml, .msg, .js, .py, .java, .html, .css, .json, .yaml, .xml

Excluidos automaticamente: Arquivos ocultos/temporarios, arquivos maiores de 5 MB, imagens/videos/audio, arquivos comprimidos (.zip, .rar, .tar)

Funcionalidades avancadas do RAG

Multiplos projetos para diferentes topicos

- Documentos de trabalho: Relatorios, notas de reuniao, arquivos de clientes

- Pesquisa pessoal: Hobbies, interesses, materiais de aprendizado

- Trabalho academico: Materiais de estudo, artigos de pesquisa, notas de tese

- Projetos criativos: Escrita, notas de arte, documentos de brainstorming

Atualizacoes automaticas

- Arquivo modificado: Re-indexa apenas esse arquivo

- Arquivo adicionado: Adicionado ao indice

- Arquivo excluido: Removido do indice

Modelos de embeddings personalizados

ollama pull mxbai-embed-large# Em Configuracoes > Provedores > Ollama, altere o modelo de embeddingsDicas de desempenho

| Memoria do seu computador | Modelo recomendado | Melhor para |

|---|---|---|

| 4-8 GB | phi3 | Perguntas rapidas, documentos simples |

| 8-16 GB | llama3 | Uso geral, pesquisa, escrita |

| 16+ GB | mistral | Analise complexa, documentos longos |

| 32+ GB | deepseek-coder | Grandes colecoes de documentos |

RAG vs. busca tradicional de documentos

| Funcionalidade | Explorador de Arquivos | Leitor de PDF | Askimo RAG com Ollama |

|---|---|---|---|

| Busca por palavra-chave | Basica | Rapida | Instantanea em todos os arquivos |

| Busca semantica | Nao | Nao | Entende o significado |

| Linguagem natural | Nao | Nao | Perguntas em linguagem natural |

| Entre documentos | Um por vez | Um por vez | Busca em todos os documentos |

| Geracao de respostas | Nao | Nao | Explica e resume |

| Privacidade | Local | Local | Totalmente local |

Privacidade e seguranca

- Indexacao: Feita na sua maquina com Lucene

- Embeddings: Gerados localmente pelo Ollama

- Chat: Modelos Ollama rodam no seu hardware

- Armazenamento: Arquivos de indice ficam em

~/.askimo/

Funciona completamente offline. Nenhum dado sai da sua maquina.

Solucao de problemas

”A IA nao parece conhecer meus documentos”

- Verifique se a indexacao foi concluida

- Tente re-indexar: Configuracoes do projeto > “Re-indexar Projeto”

- Verifique se o tipo de arquivo e compativel (arquivos maiores de 5 MB sao ignorados)

Indexacao lenta

- Tenha paciencia - a indexacao inicial leva tempo mas ocorre apenas uma vez

- Atualizacoes futuras sao muito mais rapidas

- Considere organizar em projetos menores se tiver 10.000+ arquivos

Sem memoria suficiente

- Use um modelo menor (

phi3em vez demistral) - Feche outros aplicativos que consomem muita memoria

- Reinicie o computador para liberar memoria

Precisa de mais ajuda? Pergunte em nossas discussoes no GitHub.

O que voce pode fazer com RAG

- Pesquisa: Encontrar informacoes rapidamente em dezenas de artigos

- Escrita: Acompanhar personagens, enredos e pesquisas para seus livros

- Aprendizado: Estudar mais efetivamente fazendo perguntas sobre suas notas

- Trabalho: Encontrar informacoes em relatorios, notas de reuniao e documentacao

- Pessoal: Organizar receitas, pesquisas de viagem, notas de hobbies

Tudo mantendo seus documentos privados e locais.

Perguntas frequentes

O RAG com Ollama funciona offline? Sim, completamente. Apos baixar os modelos e indexar o projeto, tudo funciona sem internet. Nao ha chamadas a APIs externas em nenhuma etapa.

Meus dados sao privados com RAG e Ollama? Sim. Seus documentos nunca saem da maquina. A indexacao e feita localmente com Apache Lucene, os embeddings sao gerados por um modelo Ollama local e o modelo de chat roda no seu proprio hardware. Nada e enviado a nenhum servico em nuvem.

Quais tipos de arquivo o Askimo RAG suporta? PDFs, documentos Word (.docx, .doc), planilhas (.xlsx, .xls), apresentacoes (.pptx), texto simples, Markdown, RTF, emails e arquivos de codigo-fonte. Arquivos maiores de 5 MB e arquivos binarios sao excluidos automaticamente.

Como o RAG com Ollama difere do upload de um documento no ChatGPT? Tres diferencas-chave: privacidade (arquivos nunca saem da maquina), escala (RAG busca em centenas de documentos simultaneamente) e precisao (respostas baseadas em seus documentos reais, nao em dados de treinamento, reduzindo significativamente alucinacoes).

Quanto tempo leva a indexacao? Para 50-100 documentos, a indexacao inicial leva 10-60 segundos. Depois, apenas arquivos alterados ou novos sao re-indexados automaticamente.

Qual modelo Ollama funciona melhor para RAG?

Para a maioria dos usuarios, Llama ou Mistral oferece o melhor equilibrio entre velocidade e qualidade. Com menos de 8 GB de RAM, use Phi. Para embeddings, nomic-embed-text e o padrao recomendado.

Saiba mais sobre Askimo e Ollama

- Askimo com Ollama: O melhor desktop para IA local

- Melhores clientes Ollama em 2026

- Configuracao do provedor Ollama

- Documentacao tecnica do RAG

Experimente o Askimo hoje: 👉 https://askimo.chat

Deixe uma estrela no projeto: 👉 https://github.com/haiphucnguyen/askimo

Perguntas ou comentarios? Abra um issue no GitHub ou participe das nossas discussoes da comunidade.