ドキュメント・研究論文・プロジェクトファイルをクラウドにアップロードせずに質問したいと思ったことはありませんか?AskimoのOllama対応RAG(検索拡張生成)がそれを可能にします。Llama、Mistral、PhiなどのローカルAIモデルが、PDF・Word文書・メモ・テキストファイルに回答してくれます。すべてあなたのマシン上で完結します。

要約: Ollamaをインストールし、

llama3やmistralなどのモデルをpullし、Askimoをダウンロードして、ドキュメントフォルダを指定したプロジェクトを作成するだけで質問を始められます。ファイルはローカルにインデックス化され、AIが関連情報を取得して回答します。セットアップ後はインターネット不要。

Ollamaが初めての方は AskimoがなぜOllamaの最高デスクトップアプリなのか をご覧ください。

なぜドキュメント管理にOllamaとRAGを使うのか?

問題: AIはあなたのファイルを知らない

ChatGPTなどのAIアシスタントが登場した当初、一般的な質問への回答は革命的でした。どんな都市についても聞けて、概念を説明でき、商品のおすすめも得られました。膨大な公開データで学習されているため、一般知識は得意です。

しかし実際の業務にAIを使おうとすると、壁にぶつかります:

単一ドキュメントの限界: 当初から、1つのドキュメントをアップロードして質問することはできました。「このレポートを要約して」「この記事のポイントを教えて」といった簡単なタスクには使えます。しかし実際の業務はそれ以上のものを必要とします:

- 研究論文: 1本ではなく、まとめる必要のある20本・50本・100本以上の論文がある

- 社内規定: 組織には数十の規定文書・手順書・ガイドラインがある

- プロジェクト文書: 会議メモ・要件定義・技術仕様・クライアントとのやり取りがファイルに散在している

- 個人の知識: 何年もかけて蓄積したメモ・研究・文章を参照したい

より深い問題: 一般的なAIアシスタントに仕事について聞くと:

-

一般的な回答: AIはあなたの特定ファイルではなく、インターネットの学習データをもとに回答します。「返品ポリシーは?」と聞いても、あなたの会社の実際のポリシーではなく、一般的なEコマースのアドバイスが返ってくる可能性があります。

-

幻覚: ドキュメントにアクセスできないAIは、もっともらしいが実際にはファイルに存在しない情報を作り上げることがあります。研究・法務・正確さが求められるあらゆる分野で特に危険です。

-

複数ファイルをまたぐコンテキストがない: 「すべての研究論文で方法論について何と言っているか?」や「ポリシー文書内の矛盾を見つけて」といった質問はできません。AIはドキュメントコレクション全体を俯瞰できません。

-

埋もれた知識: 長年蓄積したメモ・研究・文書の中に、AIが見つけられるパターン・つながり・忘れかけたインサイトが眠っています。

-

プライバシーへの懸念: ドキュメント固有のサポートを得るには、機密文書をクラウドサービスにアップロードする必要があります。機密研究・独自のビジネス情報・個人データには使えません。

本当の課題: 人々は一度に1つではなく、知識ベース全体を深く知るAIを求めています。次のことができるアシスタントが必要です:

- 100本以上の研究論文を横断して共通テーマを探す

- 社員の質問に答えるとき、すべての社内規定を参照する

- 何年分ものメモや文章をまたいでアイデアをつなぐ

- インターネットの学習データではなく、実際のドキュメントに根ざした正確な回答を提供する

これがまさにOllamaを使ったRAGが解決することです。

解決策: RAGがローカルAIをドキュメント対応にする

RAGを使うと、Ollamaモデルはあなたのファイルをしっかりと知る個人専属のリサーチアシスタントになります:

- 根拠のある回答: 一般的な情報ではなく、あなたの実際のドキュメントを参照した回答

- ファイル記憶: AIがすべてのドキュメントとその内容を「記憶」する

- 即座のコンテキスト: 質問すると関連情報を自動的に取得

- 完全なプライバシー: すべてがローカルで動作 - ファイルはマシン外に出ない

詳細情報: Ollamaクライアントの詳細な比較については、2026年ベストOllamaクライアントガイドをご覧ください。

OllamaでRAGがどのように動作するか

Askimoでプロジェクトを作成しRAGを有効にすると:

- インデックス化: ファイルが読み込まれ、チャンクに分割され、高速検索のために整理される

- ストレージ: インデックスはマシン上に保存(通常ファイルサイズの10〜30%を使用)

- 取得: 質問すると、関連情報が自動的に見つかる

- 注入: これらのスニペットが回答前にAIに提示される

- 生成: Ollamaモデルがこのコンテキストを使って正確なドキュメント固有の回答を生成

これらすべてがローカルで行われます - インデックス化や取得のための外部APIコールはありません。

技術的な詳細は RAGドキュメントをご覧ください。

実際のユースケース

研究: 複数の論文を横断した統合

課題: 気候変動に関する50本以上の研究論文がある。従来の検索はキーワードを見つけられるが、ドキュメント間の知見を統合できない。

RAGを使うと:

You: "What are the main findings across all my climate research papers?"

Llama 3: Based on your papers, three key findings emerge:1. Temperature increases correlate with CO2 levels (mentioned in 12 papers)2. Ocean acidification is accelerating faster than predicted (7 papers)3. Renewable energy adoption is cost-effective (15 papers with economic data)

Sources: climate-change-2023.pdf, renewable-study.docx, ocean-research.pdf [and 9 more]実際に使える質問例:

- “再生可能エネルギー研究全体で使われている方法論を比較して”

- “研究コレクションで最も頻繁に登場するデータセットは?”

- “太陽光パネル効率についての矛盾する結論を見つけて”

執筆: 長編プロジェクトの管理

課題: 小説に30章・キャラクターメモ・世界設定資料・プロットのあらすじがある。数百ページにわたる詳細を把握するのが難しい。

RAGを使うと:

You: "Has Elena ever mentioned being afraid of water in any chapter?"

Mistral: Yes, in chapter 7 Elena mentions she nearly drowned as a child. She alsoavoids the harbor scene in chapter 12 saying "I don't do boats." Your characternotes list this as a key personality trait stemming from her childhood incident.

Sources: chapter-07.docx, chapter-12.docx, character-profiles.md実際に使える質問例:

- “敵役がこれまでに見せた魔法の能力は?”

- “東の王国で描写した場所をすべてリストアップして”

- “3章・8章・15章の間にあるタイムラインの矛盾は?“

仕事: 会社の知識への素早いアクセス

課題: チームには数百のドキュメントがある - ポリシー・会議メモ・プロジェクト仕様・クライアントのフィードバック。特定の情報を見つけるのに毎週何時間も無駄にしている。

RAGを使うと:

You: "What's our policy on remote work expenses?"

Llama 3: According to the HR Policy Handbook (updated Jan 2026), employees canexpense up to $500/month for home office equipment and $150/month for internet.Receipts must be submitted within 30 days. See section 4.2 for full details.

Source: HR-Policies-2026.pdf (page 23)実際に使える質問例:

- “先週のチームミーティングのアクションアイテムは?”

- “モバイルアプリに言及しているクライアントのフィードバックをすべて見つけて”

- “2025年Q4のパフォーマンス指標をまとめて”

OllamaでRAGをセットアップする

ステップ1: Ollamaをインストールする

OllamaはmacOS・Windows・Linuxのローカルで動作します。

macOS:

# Download from https://ollama.com/download/mac# Or use Homebrewbrew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | shWindows:

# Download installer from https://ollama.com/download/windowsインストールのテスト:

ollama run llama3Ollamaの詳細なセットアップ: AskimoとOllamaを設定する手順については Ollamaプロバイダーガイドをご覧ください。

ステップ2: 埋め込みモデルをpullする

RAGにはドキュメントを検索可能な情報に変換するための埋め込みモデルが必要です:

ollama pull nomic-embed-textこれはOllama向けAskimoのデフォルト埋め込みモデルで、高速ですべての種類のドキュメントに対応しています。

ステップ3: チャットモデルをpullする

コンピュータのメモリに基づいてモデルを選択してください:

# For 8GB+ RAM - Fast and capableollama pull llama3

# For 16GB+ RAM - Excellent for complex questionsollama pull mistral

# For 4-8GB RAM - Lightweightollama pull phi3ステップ4: Askimoをインストールする

お使いのプラットフォーム向けにAskimoをダウンロードしてください:

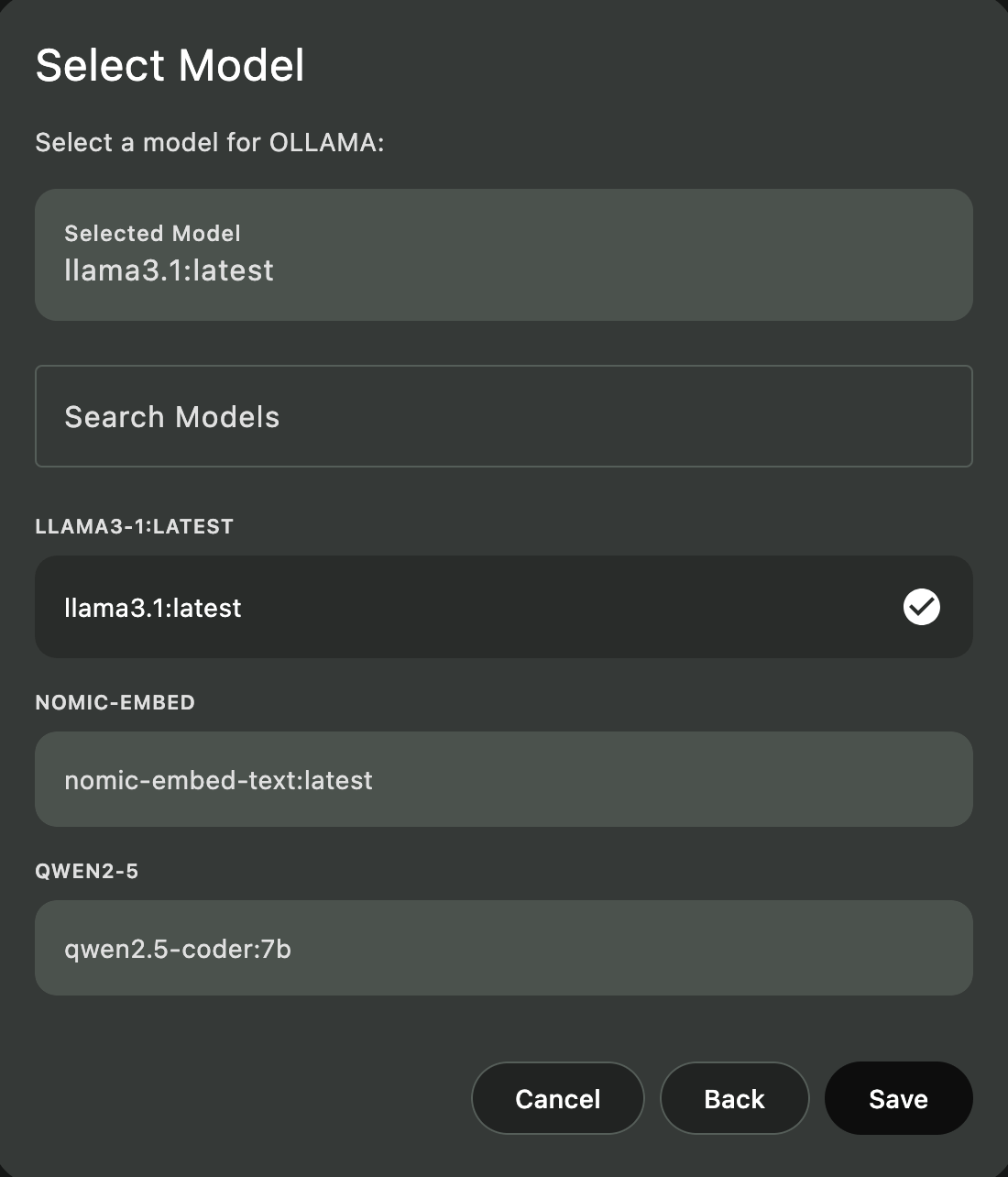

ステップ5: AskimoでOllamaを設定する

- Askimoを開く

- 設定 → プロバイダー へ移動

- Ollama を有効にする

- エンドポイントを

http://localhost:11434に設定 - チャットモデルを選択(例:

llama3) - 埋め込みモデルを

nomic-embed-textに設定

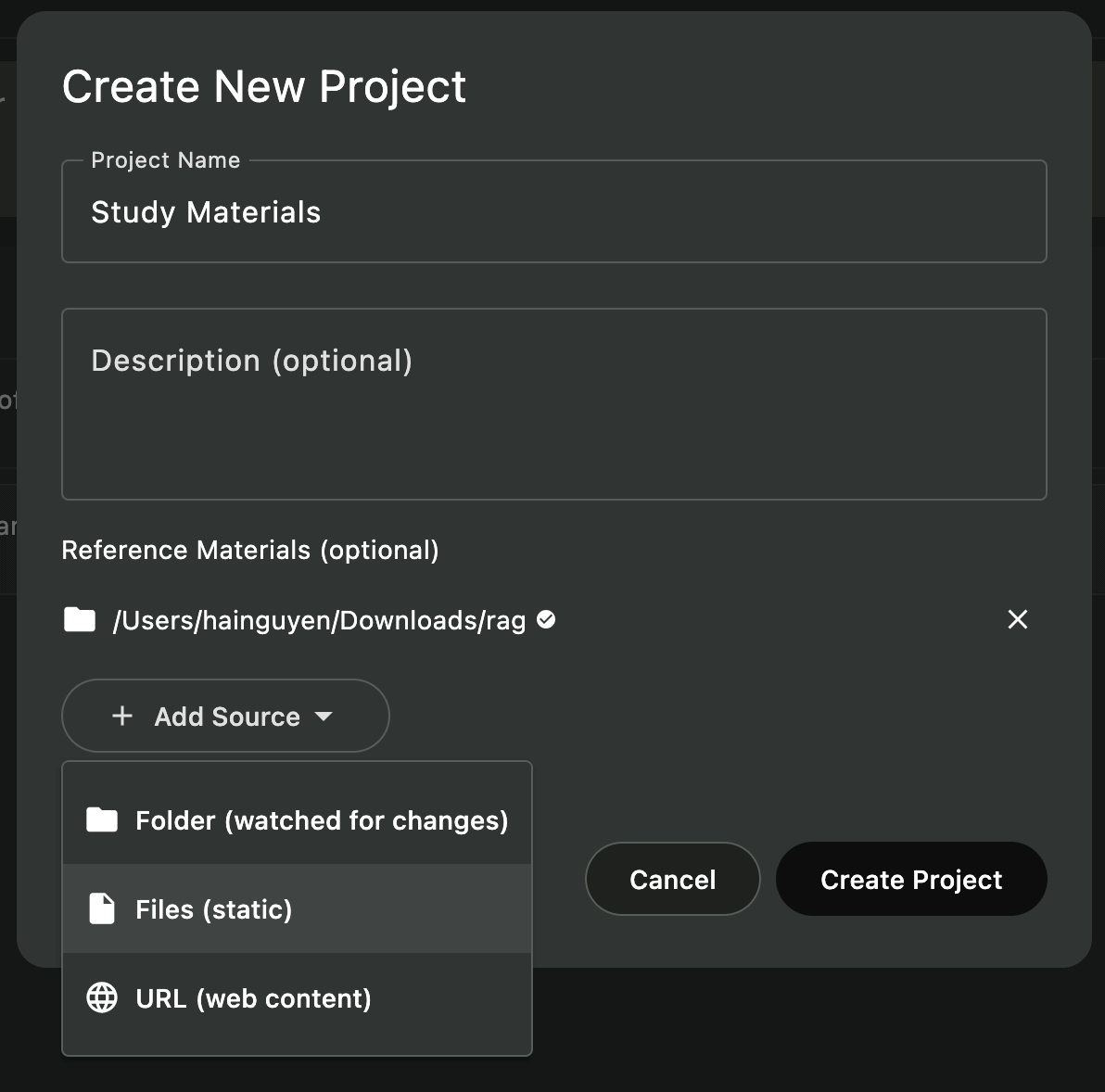

ステップ6: RAG付きプロジェクトを作成する

-

プロジェクトマネージャーを開く

- サイドバーの「プロジェクト」アイコンをクリック

- または

⌘/Ctrl + Pを使用

-

新規プロジェクトを作成

- 「+ 新規プロジェクト」をクリック

- 名前を入力(例: 「研究論文」「本のメモ」「学習素材」)

- 「フォルダを選択」をクリックしてドキュメントフォルダを選択

-

自動インデックス化

- Askimoが自動的にファイルを検出

- バックグラウンドでインデックス化が開始

- 完了まで待機(一般的なドキュメントコレクションで10〜60秒)

-

チャットを開始

- プロジェクト内で新しいチャットを作成

- RAGは自動的に有効になっています

- ドキュメントについて質問してください!

プロのヒント: 目的別に複数のプロジェクトを作成できます。業務文書用・個人リサーチ用・学習素材用など。

インデックス化されるもの

Askimoはインテリジェントにファイルをインデックス化します:

対象ファイル

- 文書:

.pdf,.docx,.doc,.odt(テキストは自動的に抽出) - スプレッドシート:

.xlsx,.xls,.ods - プレゼンテーション:

.pptx,.ppt,.odp - テキストファイル:

.txt,.md,.rtf - メール:

.eml,.msg - メモ・文章: Markdown、プレーンテキスト、リッチテキスト

- ソースコード:

.js,.py,.java,.html,.css(技術ユーザー向け) - 設定:

.json,.yaml,.xml

自動的に除外されるもの

- システムファイル: 隠しファイル、一時ファイル

- 大きなファイル: 5MBを超えるファイル(高速インデックス化のため)

- バイナリ: 画像、動画、音声(対応文書タイプでない限り)

- 圧縮アーカイブ:

.zip,.rar,.tar

詳細情報: インデックス化の動作・ファイル除外・高度な設定については RAGドキュメントをご覧ください。

例: 研究論文とのチャット

研究フォルダを指定したプロジェクトを作成してください:

my-research/ ├── climate-change-2023.pdf ├── renewable-energy-study.pdf ├── notes/ │ └── literature-review.md └── data/ └── analysis-summary.pdfインデックス化は約20秒で完了します。その後質問できます:

あなた: 「太陽光パネル効率に関する主な知見は?」

Llama 3:

研究論文によると、現代のパネルは20〜22%の効率を達成しており、10年前の15%から向上しています。両面パネルは最適条件下で25%に達することがあります。

Sources: solar-panel-efficiency.docx, renewable-energy-study.pdf

あなた: 「すべての再生可能エネルギー論文の結論を比較して」

Llama 3:

すべての論文で、太陽光と風力が最もスケーラブルなソリューションであること、コストが劇的に低下したこと、ストレージが主要な課題であることで一致しています。

AIがインターネットの一般情報ではなく、実際のドキュメントを参照していることに注目してください。

例: 社内規定ナレッジベース

会社のドキュメントをインデックス化してください:

company-docs/ ├── policies/ │ ├── return-policy.pdf │ ├── shipping-policy.docx │ └── customer-service-guidelines.pdf ├── meeting-notes/ │ └── 2026-Q1-updates.docx └── procedures/ └── refund-process.pdf会社の知識に即座にアクセス:

あなた: 「不良品の返品ポリシーは?」

Llama 3:

return-policy.pdf(2026年1月更新)によると、不良品は購入証明があれば90日以内に返品できます。返送費用を含む全額返金が受けられます。refund-process.pdfでは、返金は5〜7営業日以内に処理されると記載されています。

Sources: return-policy.pdf (section 3.2), refund-process.pdf

あなた: 「Q1の会議でポリシー変更について話し合われましたか?」

Llama 3:

はい、Q1の会議メモに不良品の返品期間を60日から90日に延長することが記載されており、2026年2月1日付で施行と書かれています。返品ポリシー文書にも更新されています。

RAGにより、チームは数十のファイルを検索する代わりに数秒で正確なポリシー情報を見つけられます。

高度なRAG機能

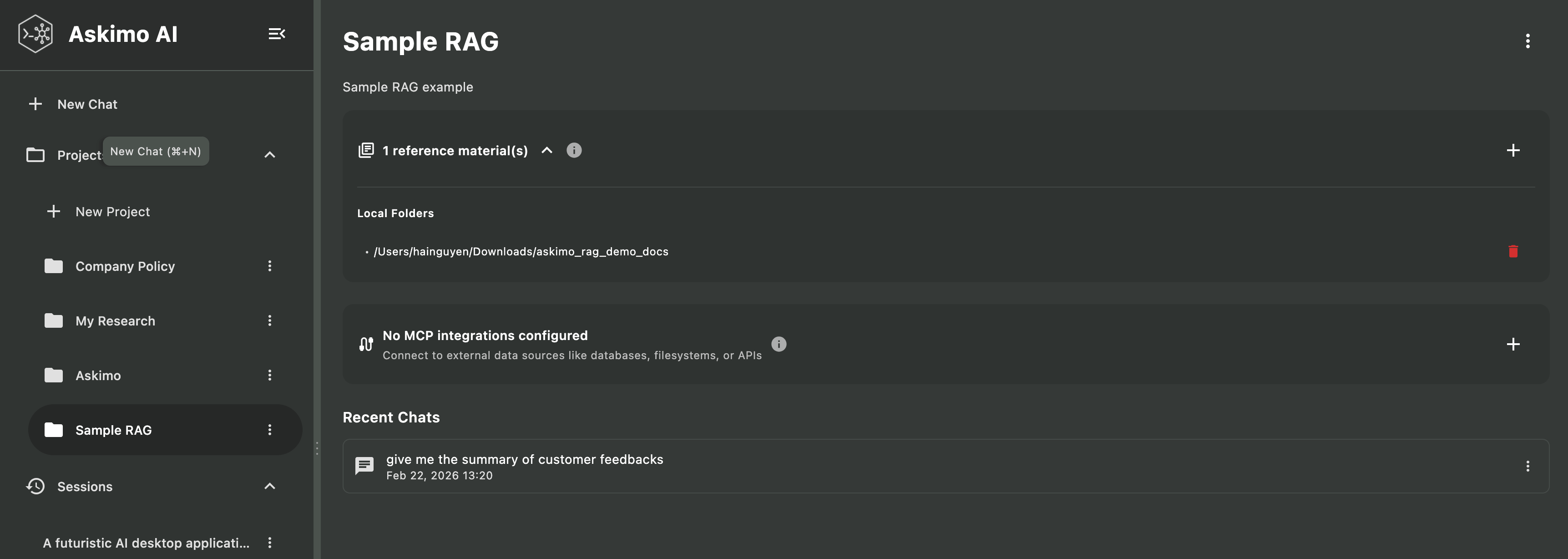

異なるトピックへの複数プロジェクト

ドキュメントを別々のプロジェクトに整理してください:

- 業務文書: ビジネスレポート・会議メモ・クライアントファイル

- 個人リサーチ: 趣味・興味・学習素材

- 学術研究: 学習素材・研究論文・論文メモ

- クリエイティブプロジェクト: 執筆・アートメモ・ブレインストーミング文書

各プロジェクトは独自の隔離されたインデックスを持ち、クエリは関連するドキュメントのみを検索します。

自動更新

Askimoはファイルの変更を自動的に検出します:

- ファイル変更: そのファイルのみ再インデックス化

- ファイル追加: インデックスに追加

- ファイル削除: インデックスから削除

日常的な編集には手動操作は不要です。

カスタム埋め込みモデル

実験したい上級ユーザー向け:

# Pull a specialized embedding modelollama pull mxbai-embed-large

# In Askimo Settings → Providers → Ollama# Change embedding model to: mxbai-embed-large技術的な詳細: 埋め込みモデル・ベクター検索・インデックス化アーキテクチャについては 包括的なRAGドキュメントをご覧ください。

パフォーマンスのヒント

コンピュータに合ったモデルを選択する

| コンピュータのメモリ | 推奨モデル | 最適な用途 |

|---|---|---|

| 4-8 GB | phi3 | 素早い質問、シンプルなドキュメント |

| 8-16 GB | llama3 | 一般的な利用、研究、執筆 |

| 16+ GB | mistral | 複雑な分析、長いドキュメント |

| 32+ GB | deepseek-coder | 大規模なドキュメントコレクション |

具体的な質問をする

広い質問ではなく、具体的に:

-

❌ 「このプロジェクトについて教えて」

-

✅ 「気候研究論文の主な知見は?」

-

❌ 「すべてを要約して」

-

✅ 「2023年の研究で使われた方法論は?」

RAGと従来のドキュメント検索の比較

| 機能 | ファイルエクスプローラー検索 | PDFリーダー検索 | AskimoのRAG + Ollama |

|---|---|---|---|

| キーワード検索 | ✅ 基本 | ✅ 高速 | ✅ 全ファイルで即座 |

| セマンティック検索 | ❌ なし | ❌ なし | ✅ 意味を理解 |

| 自然言語 | ❌ なし | ❌ なし | ✅ 自然な言葉で質問 |

| クロスドキュメント | ❌ 一度に1つ | ❌ 一度に1つ | ✅ 全ドキュメントを検索 |

| コンテキスト理解 | ❌ なし | ❌ なし | ✅ 関係性を理解 |

| 回答生成 | ❌ なし | ❌ なし | ✅ 説明・要約 |

| プライバシー | ✅ ローカル | ✅ ローカル | ✅ 完全ローカル |

例:

従来の検索: 「方法論」と検索すると、その単語を含むファイルのリストが表示されます。

Askimo RAG: 「どんな研究方法論が使われましたか?」と質問すると: 「この研究では、定量的調査(300名参加)と定性的インタビュー(専門家30名)を組み合わせた混合法が使用されており、methodology.pdfファイルに記載されています。」 と返ってきます。

プライバシーとセキュリティ

すべてがローカルに留まる

- インデックス化: LuceneによりマシンI上で実行

- 埋め込み: OllamaによりローカルI生成

- チャット: Ollamaモデルはあなたのハードウェア上で動作

- ストレージ: インデックスファイルは

~/.askimo/に保存

外部依存なし

Ollamaモデルをpullした後は:

- 完全にオフラインで動作

- 外部サービスへのAPIコールなし

- データはマシン外に出ない

プロジェクト分離

各プロジェクトは独自の隔離されたインデックスを持ちます:

- プロジェクト間でデータにアクセスできない

- プロジェクトを削除するとインデックスも削除

- クロスプロジェクトのデータ漏洩なし

トラブルシューティング

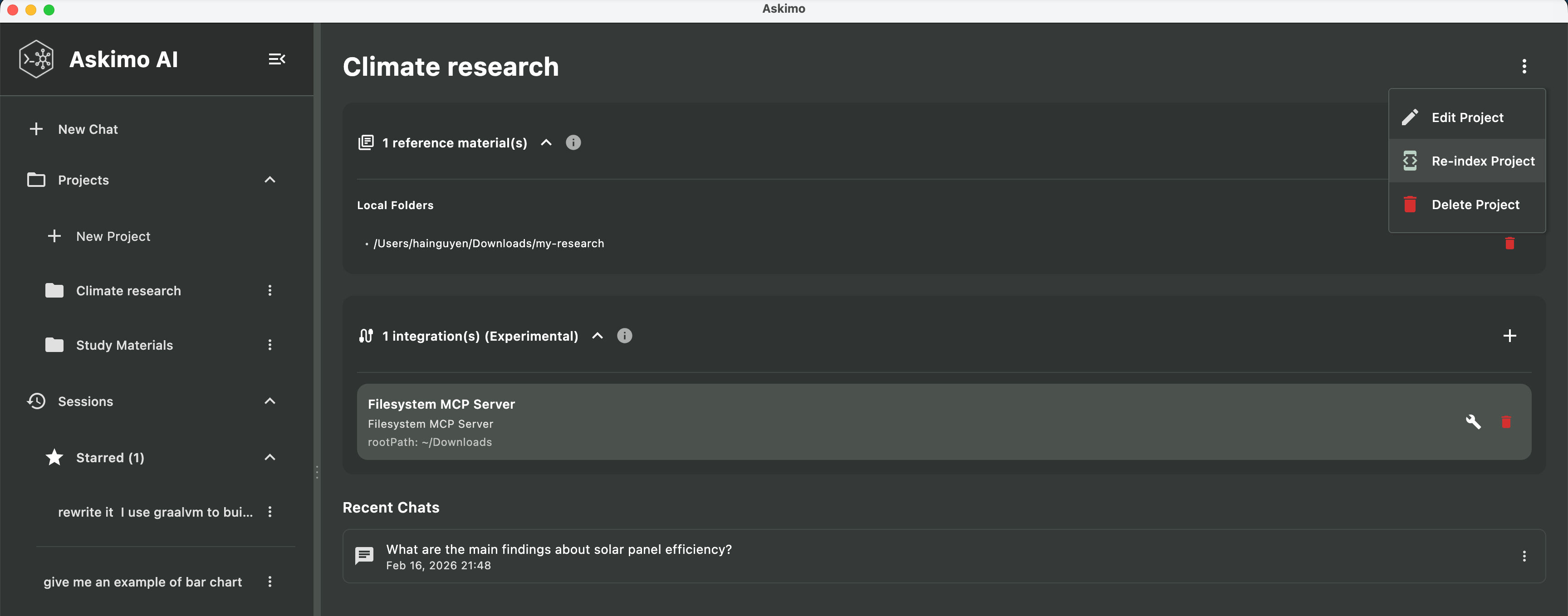

「AIがドキュメントを知らないようだ」

考えられる原因:

- プロジェクトがまだインデックス化されていない: プロジェクトビューでインデックス化の状態を確認

- 対応していないファイル形式: 対応ファイル形式(PDF、DOCX、TXTなど)を使用しているか確認

- ファイルが大きすぎる: 5MBを超えるファイルはスキップされます

解決策:

- インデックス化の完了を待つ(ステータスインジケータを確認)

- 再インデックス化を試みる: プロジェクト設定 → 「プロジェクトを再インデックス化」

- チャットでRAGが有効になっているか確認(プロジェクトチャットでは自動的に有効になるはず)

インデックス化が遅い

考えられる原因:

- 非常に大きなドキュメントコレクション(1,000件以上のファイル)

- 遅いハードドライブ

- 多数の大きなPDFファイル

解決策:

- 初回インデックス化は時間がかかりますが一度だけです。辛抱強く待ちましょう。

- 以降の更新はずっと速くなります(変更されたファイルのみ再インデックス化)

- 10,000件以上のファイルがある場合は、より小さなプロジェクトに整理することを検討してください

メモリ不足

考えられる原因:

- モデルがコンピュータには大きすぎる

- 多数のアプリケーションが動作している

解決策:

- より小さなモデルを使用(

mistralの代わりにphi3) - メモリを多く使う他のアプリケーションを閉じる

- コンピュータを再起動してメモリを解放する

さらにサポートが必要な場合は GitHub discussionsでお気軽にどうぞ。

RAGでできること

AskimoのOllamaを使ったRAGは新しい可能性を開きます:

- 研究: 数十の論文や記事から素早く情報を見つける

- 執筆: 本のキャラクター・プロット・リサーチを追跡する

- 学習: メモや資料に質問することでより効果的に勉強する

- 仕事: レポート・会議メモ・プロジェクト文書から情報を見つける

- 個人: レシピ・旅行リサーチ・趣味のメモを整理する

ドキュメントをプライベートかつローカルに保ちながら、何もコンピュータを離れません。

よくある質問

OllamaのRAGはオフラインで動作しますか? はい、完全に動作します。Ollamaモデルをダウンロードしてプロジェクトをインデックス化した後は、インターネット接続なしですべてが動作します。インデックス化・取得・AI回答のすべてがあなたのマシン上で行われます。どの段階でも外部APIコールはありません。

OllamaのRAGを使う際、データはプライベートですか? はい。ドキュメントはあなたのマシン外に出ることはありません。インデックス化はApache LuceneによりローカルI行われ、埋め込みはローカルのOllamaモデルにより生成され、チャットモデルはあなたのハードウェアで動作します。クラウドサービスには何も送信されません。

AskimoのRAGはどのファイル形式に対応していますか? PDF・Wordドキュメント(.docx、.doc)・スプレッドシート(.xlsx、.xls)・プレゼンテーション(.pptx)・プレーンテキスト・Markdown・リッチテキストファイル・メール・ソースコードファイルに対応。5MBを超えるファイルとバイナリファイル(画像・動画・音声)は自動的に除外されます。

OllamaのRAGはChatGPTへのファイルアップロードとどう違いますか? 3つの主な違い: プライバシー(ファイルがマシン外に出ない)・スケール(RAGは一度に1つではなく数百のドキュメントを同時に検索)・精度(模型の学習データではなく実際のドキュメントに基づく回答により幻覚が大幅に減少)。

インデックス化にどのくらい時間がかかりますか? 50〜100件のドキュメントの一般的なフォルダの場合、初回インデックス化は10〜60秒かかります。その後は変更・新規ファイルのみ自動的に再インデックス化されるため、更新はほぼ即座です。

RAGに最適なOllamaモデルはどれですか?

ほとんどのユーザーには、LlamaまたはMistralが速度と回答品質の最良のバランスを提供します。RAMが8GB未満の場合はPhiを使用してください。埋め込みモデルにはnomic-embed-textが推奨デフォルトです。

AskimoとOllamaについてもっと詳しく

さらに多くの機能を探求する準備はできていますか?

- AskimoとOllama: ローカルAIの最高デスクトップ - チャット検索・エクスポート・カスタムディレクティブなどOllamaのGUIとしてAskimoを使う完全ガイド

- 2026年ベストOllamaクライアント - 主要Ollamaデスクトップクライアントを比較し、AskimoのRAG機能が際立つ理由をご確認ください

- Ollamaプロバイダー設定 - AskimoでのOllama詳細設定ガイド

- RAG技術ドキュメント - RAGインデックス化と取得の仕組みの詳細

今日Askimoを試してみてください: 👉 https://askimo.chat

プロジェクトにスターを: 👉 https://github.com/haiphucnguyen/askimo

質問やフィードバックは? GitHubでissueを開くか、コミュニティのdiscussionに参加してください。RAGをどのように使っているか、ぜひ教えてください!