Avez-vous deja voulu poser des questions sur vos documents, articles de recherche ou fichiers de projet sans les envoyer dans le cloud ? RAG (Retrieval-Augmented Generation) avec Ollama dans Askimo le rend possible. Des modeles d’IA locaux comme Llama, Mistral ou Phi peuvent repondre a des questions sur vos PDFs, documents Word, notes et tous vos fichiers texte - tout s’execute entierement sur votre machine.

TL;DR: Installez Ollama, telechargez un modele comme

llama3oumistral, telechargez Askimo, creez un projet pointant vers votre dossier de documents et commencez a poser des questions. Vos fichiers sont indexes localement et l’IA recupere les informations pertinentes pour repondre. Aucun internet requis apres la configuration.

Nouveau sur Ollama ? Lisez notre guide sur pourquoi Askimo est la meilleure app de bureau pour Ollama.

Pourquoi utiliser RAG avec Ollama pour vos documents ?

Le probleme : l’IA ne connait pas vos fichiers

Quand ChatGPT est apparu, il etait revolutionnaire pour les questions generales. Mais quand les utilisateurs ont essaye d’appliquer l’IA a leur travail reel, ils ont rencontre des limites :

- Articles de recherche : Vous n’avez pas un article - vous en avez 20, 50 ou 100+ a synthetiser

- Politiques d’entreprise : Des dizaines de documents de politique, manuels et guides

- Documentation de projet : Notes de reunion, exigences, specifications dispersees dans des fichiers

- Connaissances personnelles : Des annees de notes et de recherches a consulter

L’IA repond sur la base de ses donnees d’entrainement internet, pas de vos fichiers specifiques. Elle peut inventer des informations plausibles mais inexactes (hallucinations), ne peut pas chercher dans plusieurs fichiers simultanement, et traiter des documents sensibles necessite de les televerser dans le cloud.

La solution : RAG rend l’IA locale consciente des documents

Avec RAG, les modeles Ollama deviennent votre assistant de recherche personnel qui connait vraiment vos fichiers :

- Reponses fondees : Les reponses referenceent vos documents reels, pas des informations generiques

- Memoire des fichiers : L’IA “se souvient” de tous vos documents et de leur contenu

- Contexte instantane : Recupere automatiquement les informations pertinentes quand vous posez des questions

- Confidentialite complete : Tout s’execute localement - vos fichiers ne quittent jamais votre machine

En savoir plus : Consultez notre guide Meilleurs clients Ollama 2026.

Comment RAG fonctionne avec Ollama

Quand vous creez un projet dans Askimo et activez RAG :

- Indexation : Vos fichiers sont lus, decoupes en morceaux et organises pour une recherche rapide

- Stockage : L’index vit sur votre machine (prend generalement 10-30% de la taille de vos fichiers)

- Recuperation : Quand vous posez une question, les informations pertinentes sont trouvees automatiquement

- Injection : Ces extraits sont montres a l’IA avant qu’elle reponde

- Generation : Les modeles Ollama utilisent ce contexte pour donner des reponses precises et specifiques

Tout cela se passe localement - pas d’appels API externes pour l’indexation ou la recuperation.

Details techniques ? Visitez notre documentation RAG.

Cas d’usage concrets

Recherche : Synthese sur plusieurs articles

Le defi : Vous avez 50+ articles de recherche sur le changement climatique. La recherche traditionnelle trouve des mots-cles mais ne peut pas synthetiser les resultats entre documents.

Avec RAG :

You: "What are the main findings across all my climate research papers?"

Llama 3: Based on your papers, three key findings emerge:1. Temperature increases correlate with CO2 levels (mentioned in 12 papers)2. Ocean acidification is accelerating faster than predicted (7 papers)3. Renewable energy adoption is cost-effective (15 papers with economic data)

Sources: climate-change-2023.pdf, renewable-study.docx, ocean-research.pdf [and 9 more]Questions reelles que vous pouvez poser :

- “Compare les methodologies utilisees dans mes etudes sur les energies renouvelables”

- “Trouve des conclusions contradictoires sur l’efficacite des panneaux solaires”

- “Quels ensembles de donnees apparaissent le plus frequemment dans ma collection ?”

Ecriture : Gestion de projets long format

Le defi : Votre roman a 30 chapitres, des notes de personnages et des plans d’intrigue. Garder le suivi des details sur des centaines de pages est difficile.

Avec RAG :

You: "Has Elena ever mentioned being afraid of water in any chapter?"

Mistral: Yes, in chapter 7 Elena mentions she nearly drowned as a child. She alsoavoids the harbor scene in chapter 12 saying "I don't do boats." Your characternotes list this as a key personality trait stemming from her childhood incident.

Sources: chapter-07.docx, chapter-12.docx, character-profiles.mdQuestions reelles que vous pouvez poser :

- “Quelles capacites magiques l’antagoniste a-t-il montrees jusqu’a present ?”

- “Liste tous les lieux que j’ai decrits dans le Royaume Oriental”

- “Quelles inconsistances de chronologie existent entre les chapitres 3, 8 et 15 ?”

Travail : Acces rapide aux connaissances de l’entreprise

Le defi : Votre equipe a des centaines de documents. Trouver des informations specifiques gaspille des heures chaque semaine.

Avec RAG :

You: "What's our policy on remote work expenses?"

Llama 3: According to the HR Policy Handbook (updated Jan 2026), employees canexpense up to $500/month for home office equipment and $150/month for internet.Receipts must be submitted within 30 days. See section 4.2 for full details.

Source: HR-Policies-2026.pdf (page 23)Questions reelles que vous pouvez poser :

- “Quels etaient les points d’action de la reunion d’equipe de la semaine derniere ?”

- “Trouve tous les retours clients mentionnant l’application mobile”

- “Resume les metriques de performance du T4 2025”

Configurer RAG avec Ollama

Etape 1 : Installer Ollama

macOS:

# Download from https://ollama.com/download/mac# Or use Homebrewbrew install ollamaLinux:

curl -fsSL https://ollama.com/install.sh | shWindows:

# Download installer from https://ollama.com/download/windowsTestez l’installation :

ollama run llama3Configuration detaillee d’Ollama : Consultez notre guide du fournisseur Ollama.

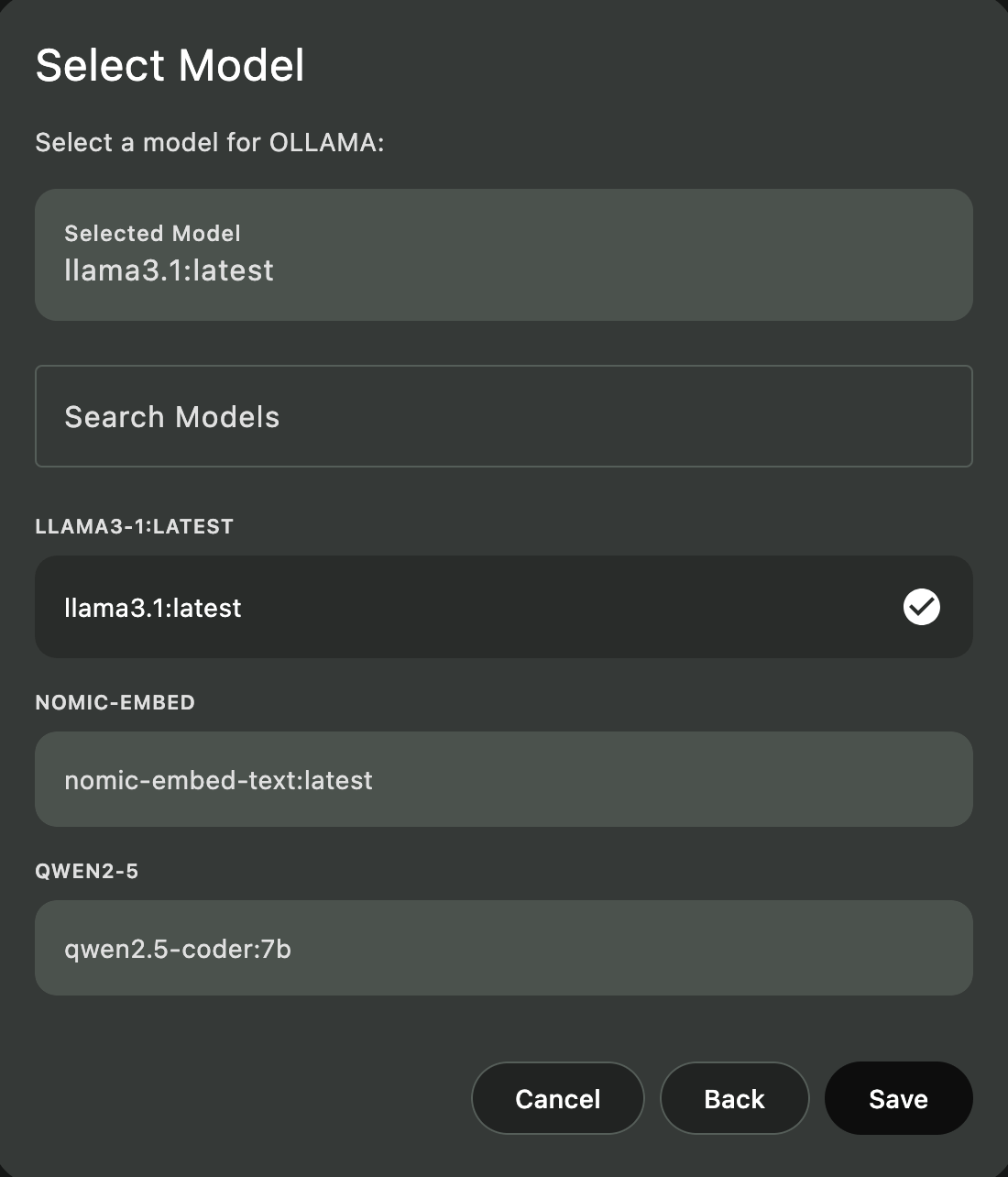

Etape 2 : Telecharger un modele d’embeddings

ollama pull nomic-embed-textC’est le modele d’embeddings par defaut d’Askimo pour Ollama - rapide et adapte a tous les types de documents.

Etape 3 : Telecharger un modele de chat

# Pour 8Go+ de RAM - Rapide et performantollama pull llama3

# Pour 16Go+ de RAM - Excellent pour les questions complexesollama pull mistral

# Pour 4-8Go de RAM - Legerollama pull phi3Etape 4 : Installer Askimo

Etape 5 : Configurer Ollama dans Askimo

- Ouvrez Askimo

- Allez dans Parametres > Fournisseurs

- Activez Ollama

- Definissez l’endpoint sur

http://localhost:11434 - Selectionnez votre modele de chat (ex.

llama3) - Definissez le modele d’embeddings sur

nomic-embed-text

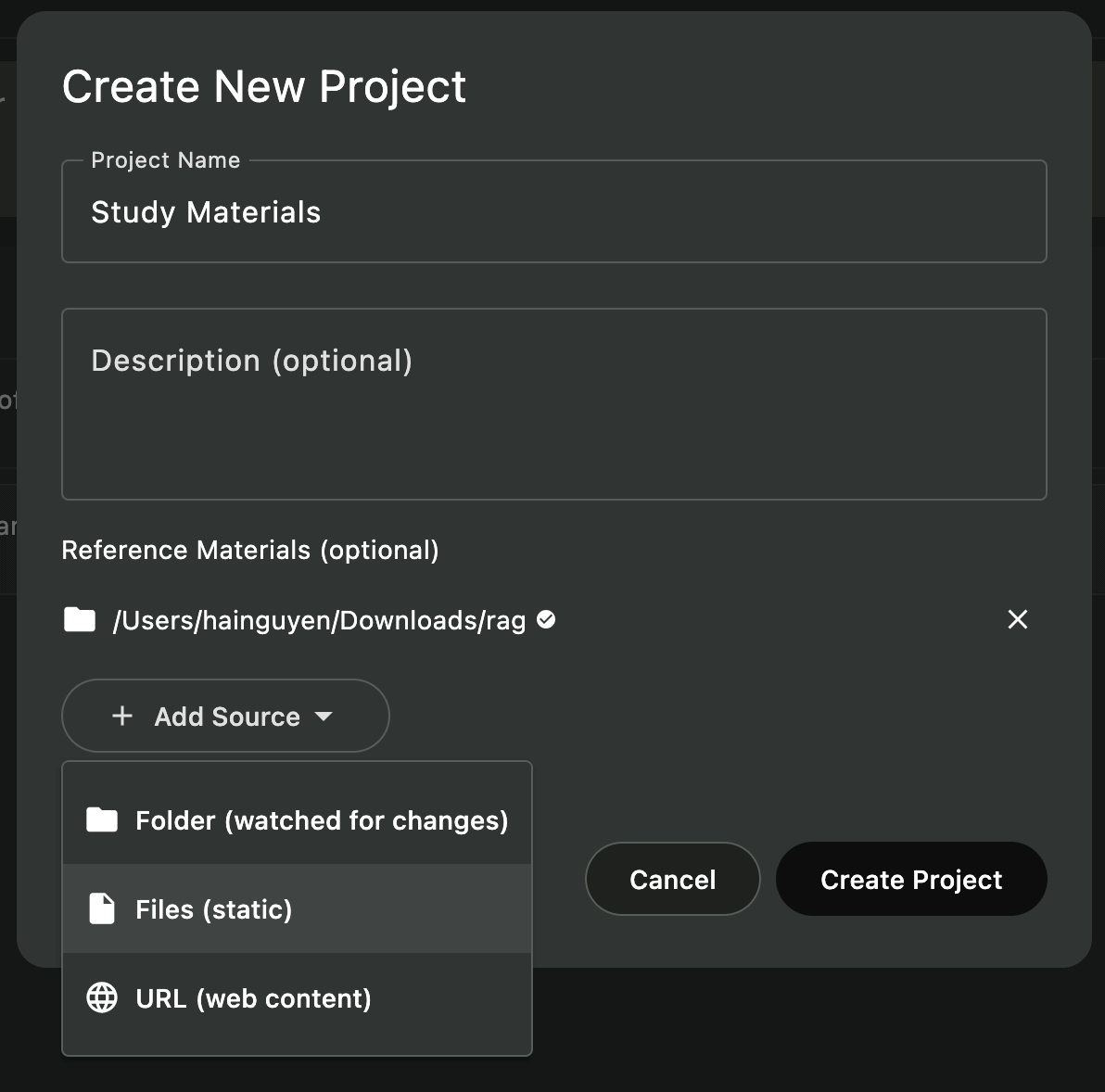

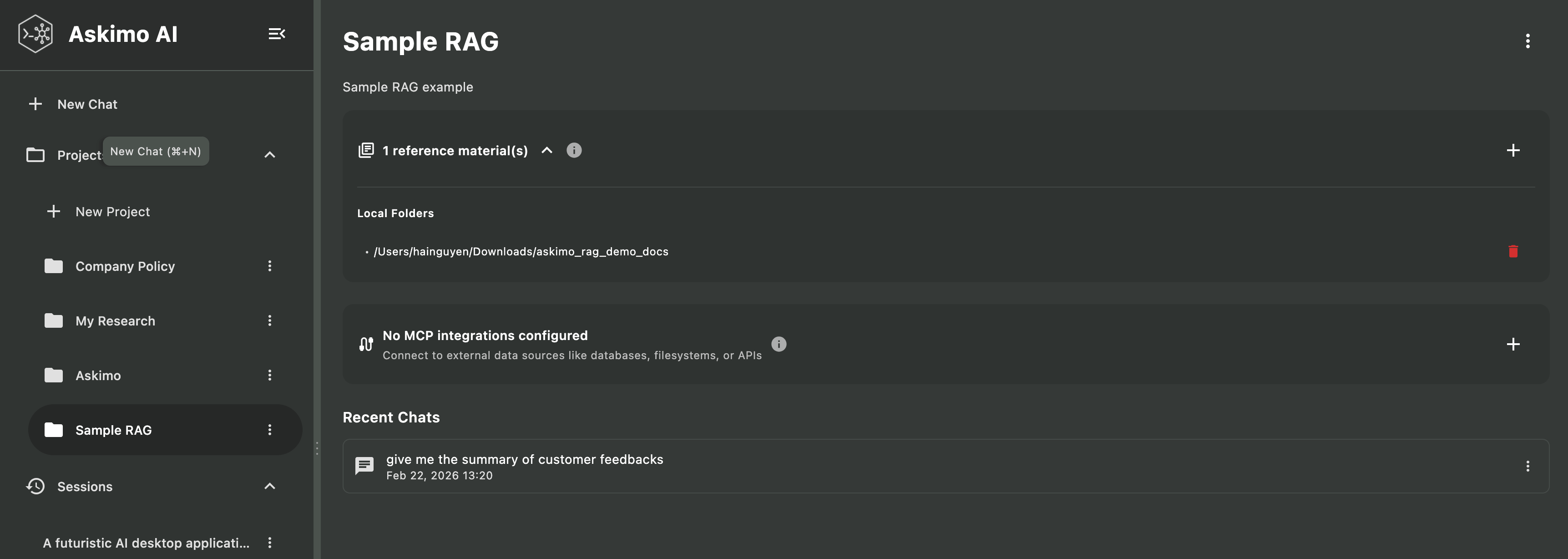

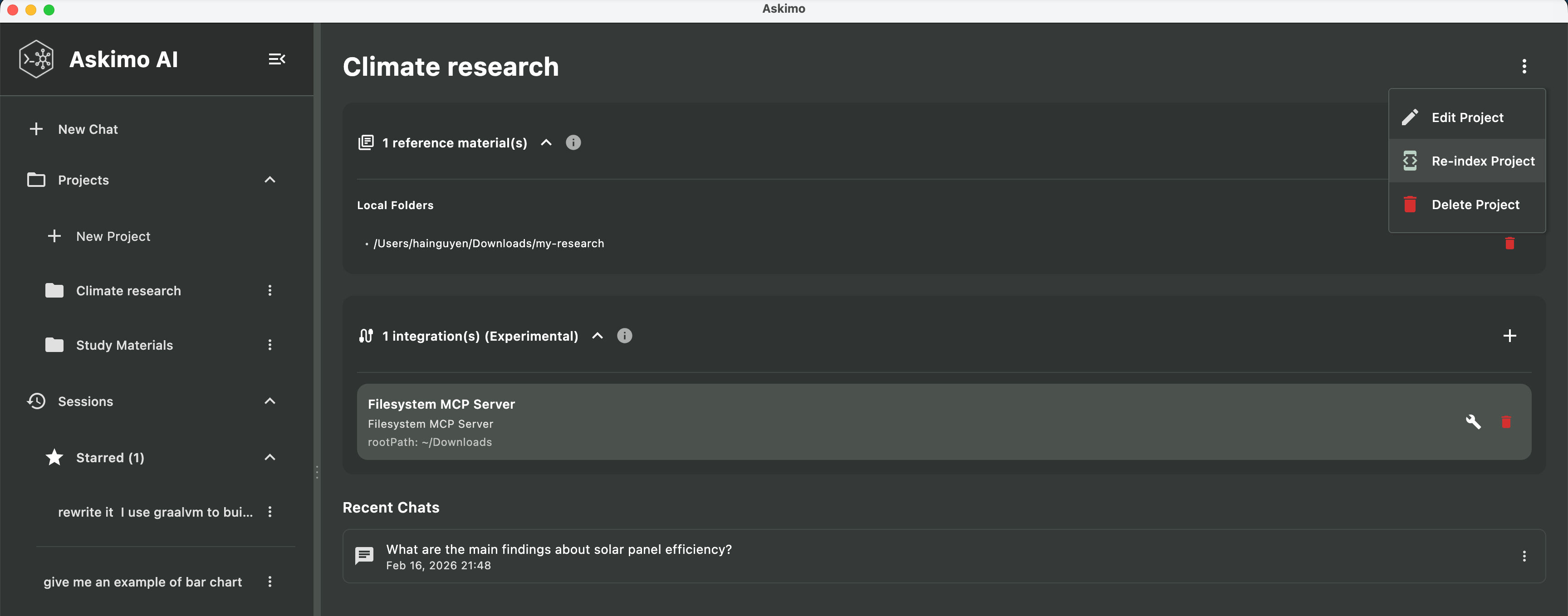

Etape 6 : Creer un projet avec RAG

- Ouvrir le Gestionnaire de Projets - Cliquez sur l’icone “Projets” dans la barre laterale ou utilisez

Cmd/Ctrl + P - Creer un nouveau projet - Cliquez sur ”+ Nouveau Projet”, entrez un nom, selectionnez votre dossier de documents

- Indexation automatique - Askimo detecte vos fichiers automatiquement, l’indexation demarre en arriere-plan (10-60 secondes)

- Commencer a chatter - Creez un nouveau chat dans le projet, RAG est active automatiquement

Conseil pro : Creez plusieurs projets pour differents usages - documents de travail, recherche personnelle, materiaux d’etude, etc.

Ce qui est indexe

Fichiers inclus

- Documents :

.pdf,.docx,.doc,.odt(le texte est extrait automatiquement) - Tableurs :

.xlsx,.xls,.ods - Presentations :

.pptx,.ppt,.odp - Fichiers texte :

.txt,.md,.rtf - Emails :

.eml,.msg - Notes et ecrits : Markdown, texte brut, texte enrichi

- Code source :

.js,.py,.java,.html,.css - Configuration :

.json,.yaml,.xml

Exclus automatiquement

- Fichiers systeme : Fichiers caches, fichiers temporaires

- Fichiers volumineux : Fichiers de plus de 5 Mo

- Fichiers binaires : Images, videos, audio

- Archives compressees :

.zip,.rar,.tar

Fonctionnalites RAG avancees

Plusieurs projets pour differents themes

Organisez vos documents en projets separes :

- Documents de travail : Rapports d’affaires, notes de reunion, fichiers clients

- Recherche personnelle : Loisirs, interets, materiaux d’apprentissage

- Travail academique : Materiaux d’etude, articles de recherche, notes de these

- Projets creatifs : Ecriture, notes artistiques, documents de brainstorming

Chaque projet a son propre index isole, donc les requetes ne cherchent que les documents pertinents.

Mises a jour automatiques

Askimo detecte automatiquement les changements de fichiers :

- Fichier modifie : Re-indexe seulement ce fichier

- Fichier ajoute : Ajoute a l’index

- Fichier supprime : Retire de l’index

Modeles d’embeddings personnalises

# Pull a specialized embedding modelollama pull mxbai-embed-large

# In Askimo Settings → Providers → Ollama# Change embedding model to: mxbai-embed-largeConseils de performance

Choisir le bon modele pour votre ordinateur

| Memoire de votre ordinateur | Modele recommande | Meilleur pour |

|---|---|---|

| 4-8 Go | phi3 | Questions rapides, documents simples |

| 8-16 Go | llama3 | Usage general, recherche, ecriture |

| 16+ Go | mistral | Analyses complexes, documents longs |

| 32+ Go | deepseek-coder | Grandes collections de documents |

Poser des questions specifiques

Plutot que des questions larges, soyez specifique :

- X “Dis-moi tout sur ce projet”

- O “Quelles sont les conclusions cles dans les articles de recherche climatique ?”

RAG vs. recherche traditionnelle de documents

| Fonctionnalite | Recherche Explorateur | Recherche PDF | Askimo RAG avec Ollama |

|---|---|---|---|

| Recherche par mot-cle | Basique | Rapide | Instantanee sur tous les fichiers |

| Recherche semantique | Non | Non | Comprend le sens |

| Langage naturel | Non | Non | Questions en langage naturel |

| Multi-documents | Un a la fois | Un a la fois | Recherche tous les documents |

| Generation de reponses | Non | Non | Explique et resume |

| Confidentialite | Local | Local | Entierement local |

Confidentialite et securite

Tout reste local

- Indexation : Se fait sur votre machine avec Lucene

- Embeddings : Generes localement par Ollama

- Chat : Les modeles Ollama s’executent sur votre materiel

- Stockage : Les fichiers d’index restent dans

~/.askimo/

Une fois les modeles Ollama telecharges : fonctionne completement hors ligne, sans appels API a des services externes, aucune donnee ne quitte votre machine.

Depannage

”L’IA ne semble pas connaitre mes documents”

Causes possibles :

- Projet pas encore indexe : Verifiez le statut dans la vue projet

- Fichiers non pris en charge : Assurez-vous d’utiliser des types de fichiers compatibles

- Fichiers trop volumineux : Les fichiers de plus de 5 Mo sont ignores

Solution :

- Attendez la fin de l’indexation

- Essayez de re-indexer : Parametres du projet > “Re-indexer le projet”

- Assurez-vous que RAG est active pour votre chat

Indexation lente

- Patience - l’indexation initiale prend du temps mais ne se fait qu’une fois

- Les mises a jour futures sont beaucoup plus rapides

- Envisagez d’organiser en projets plus petits si vous avez 10 000+ fichiers

Memoire insuffisante

- Utilisez un modele plus petit (

phi3au lieu demistral) - Fermez les autres applications gourmandes en memoire

- Redemarrez votre ordinateur pour liberer de la memoire

Besoin d’aide ? Posez votre question dans nos discussions GitHub.

Ce que vous pouvez faire avec RAG

- Recherche : Trouver des informations rapidement dans des dizaines d’articles

- Ecriture : Garder le suivi des personnages, points d’intrigue et recherches pour vos livres

- Apprentissage : Etudier plus efficacement en posant des questions sur vos notes

- Travail : Trouver des informations dans les rapports, notes de reunion et documentation

- Personnel : Organiser des recettes, recherches de voyage, notes de loisirs

Tout en gardant vos documents prives et locaux - rien ne quitte votre ordinateur.

Questions frequentes

Le RAG avec Ollama fonctionne-t-il hors ligne ? Oui, completement. Une fois les modeles Ollama telecharges et votre projet indexe, tout fonctionne sans connexion internet. Pas d’appels API externes a aucune etape.

Mes donnees sont-elles privees avec RAG et Ollama ? Oui. Vos documents ne quittent jamais votre machine. L’indexation est faite localement avec Apache Lucene, les embeddings sont generes par un modele Ollama local, et le modele de chat s’execute sur votre propre materiel. Rien n’est envoye a un service cloud.

Quels types de fichiers Askimo RAG prend-il en charge ? PDFs, documents Word (.docx, .doc), tableurs (.xlsx, .xls), presentations (.pptx), texte brut, Markdown, fichiers RTF, emails et fichiers de code source. Les fichiers de plus de 5 Mo et les fichiers binaires sont exclus automatiquement.

En quoi RAG avec Ollama differe-t-il de l’upload d’un document a ChatGPT ? Trois differences cles : confidentialite (vos fichiers ne quittent jamais votre machine), echelle (RAG recherche des centaines de documents simultanement, pas un seul) et precision (les reponses sont fondees sur vos documents reels, reduisant significativement les hallucinations).

Combien de temps prend l’indexation ? Pour un dossier typique de 50-100 documents, l’indexation initiale prend 10-60 secondes. Ensuite, seuls les fichiers modifies ou nouveaux sont re-indexes automatiquement.

Quel modele Ollama fonctionne le mieux pour RAG ?

Pour la plupart des utilisateurs, Llama ou Mistral offre le meilleur equilibre entre vitesse et qualite de reponse. Si vous avez moins de 8 Go de RAM, utilisez Phi. Pour le modele d’embeddings, nomic-embed-text est le defaut recommande.

En savoir plus sur Askimo et Ollama

- Askimo avec Ollama : Le meilleur bureau pour l’IA locale

- Meilleurs clients Ollama 2026

- Configuration du fournisseur Ollama

- Documentation technique RAG

Essayez Askimo aujourd’hui : 👉 https://askimo.chat

Mettez une etoile au projet : 👉 https://github.com/haiphucnguyen/askimo

Questions ou retours ? Ouvrez un issue sur GitHub ou rejoignez nos discussions communautaires. Nous aimerions entendre comment vous utilisez RAG avec vos documents !